Clear Sky Science · es

Un marco flexible para la optimización de hiperparámetros mediante homotopía y modelos sustitutos

Por qué importa afinar los controles de la IA

Los sistemas de inteligencia artificial modernos dependen no solo de algoritmos ingeniosos y grandes volúmenes de datos, sino también de una capa sorprendentemente exigente de configuraciones llamadas «hiperparámetros». Estos son los mandos que determinan qué tamaño debe tener un modelo, con qué rapidez aprende y cómo maneja datos ruidosos. Equivocarse al ajustarlos puede convertir un sistema prometedor en un fracaso. Este artículo presenta HomOpt, una nueva forma de afinar esos controles de manera más eficiente y fiable, especialmente cuando el espacio de búsqueda es enorme y desordenado, lo que lo hace atractivo para quien quiera mejorar el rendimiento de la IA con menos prueba y error.

Una nueva forma de orientar la búsqueda

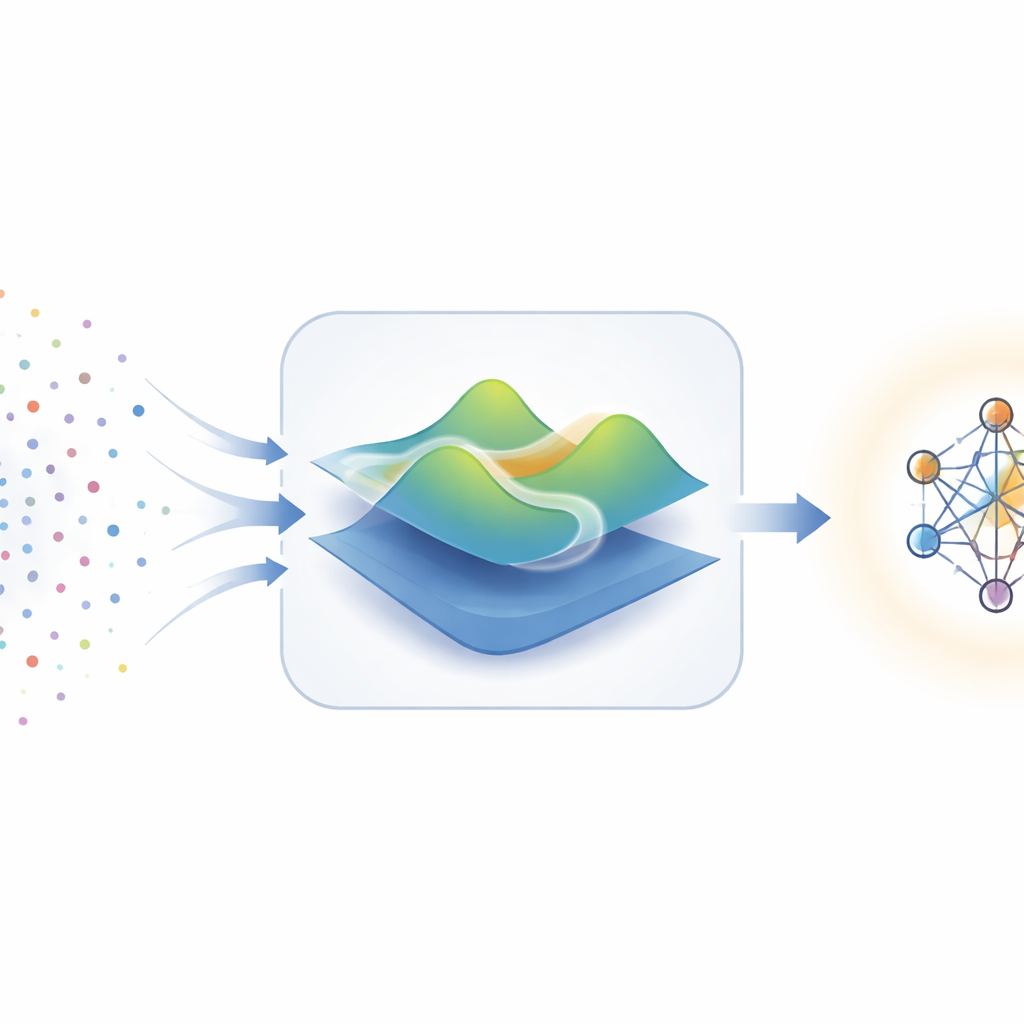

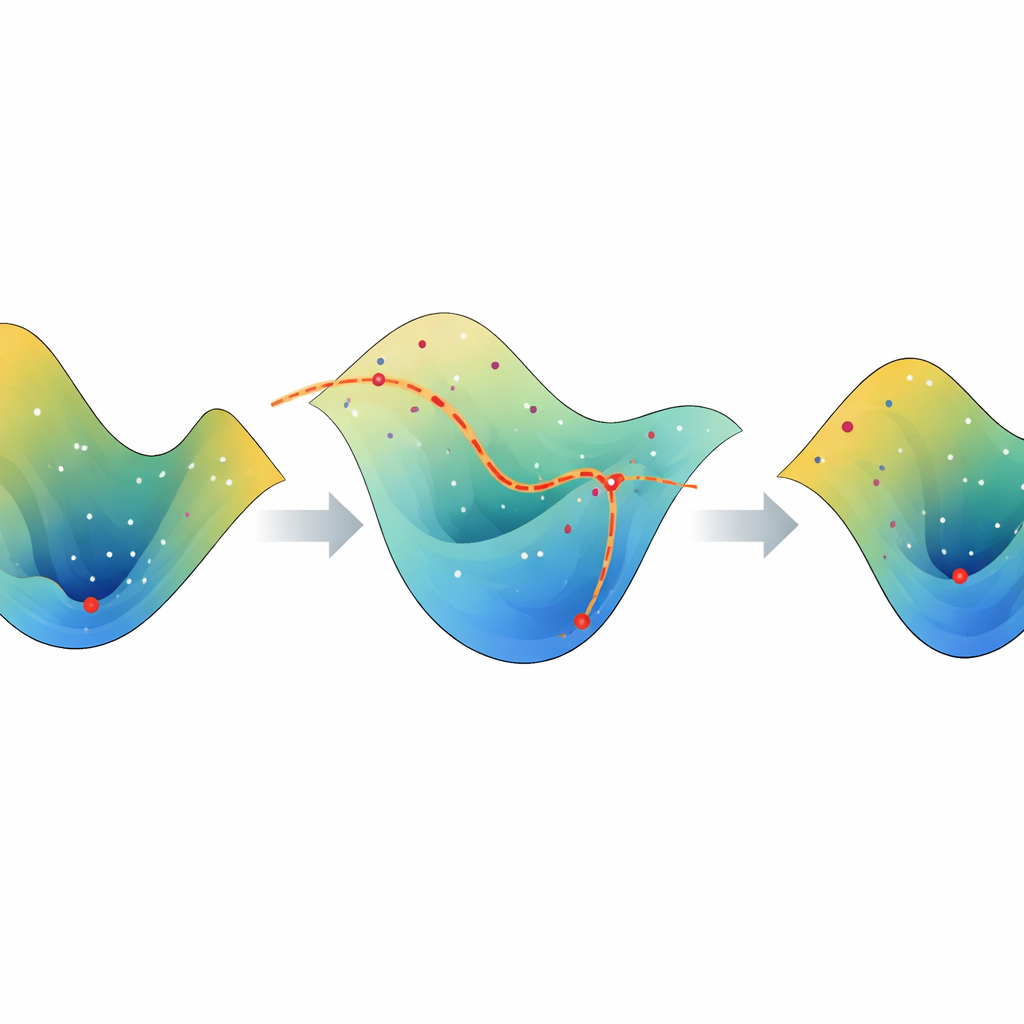

Los enfoques tradicionales para el ajuste de hiperparámetros, como la búsqueda en cuadrícula o la búsqueda aleatoria, son un poco como probar recetas tirando ingredientes y esperando que algo salga bien. Métodos más refinados, como la optimización bayesiana, intentan ser más inteligentes creando un modelo aproximado de cómo las configuraciones afectan al rendimiento y luego usando ese modelo para elegir la siguiente combinación a probar. Pero estos métodos asumen que el «paisaje» de rendimiento es suave y bien comportado, lo que a menudo no se cumple en problemas reales llenos de peculiaridades, ruido y saltos abruptos. HomOpt afronta este desafío construyendo repetidamente sustitutos aproximados del paisaje real—llamados modelos sustitutos—y transformando uno en otro de forma suave a medida que llegan más datos, mientras sigue cómo se desplaza la mejor solución durante esa transformación.

Modelos que se transforman suavemente en lugar de empezar de cero

La idea clave detrás de HomOpt proviene de un concepto matemático llamado homotopía que, en términos sencillos, trata de transformar gradualmente una forma en otra sin desgarrarla ni provocar saltos. En este marco, cada modelo sustituto es una imagen suavizada de cómo distintas configuraciones de hiperparámetros afectan el rendimiento de un modelo. A medida que se recogen nuevos resultados experimentales, HomOpt construye un sustituto actualizado y define una transformación continua entre la versión antigua y la nueva. En lugar de descartar el trabajo previo y reiniciar la búsqueda, sigue cómo el mejor punto en la superficie antigua se desliza por este paisaje en transformación hasta aterrizar en un buen punto de la nueva superficie. Este movimiento guiado hace que la búsqueda sea más dirigida y menos aleatoria, mejorando las probabilidades de encontrar mejores configuraciones en menos pasos.

Herramientas flexibles para distintos tipos de datos

Para demostrar que la idea funciona en la práctica, los autores integran dos tipos muy diferentes de modelos sustitutos en HomOpt. Primero usan Modelos Aditivos Generalizados, que son suaves y bastante interpretables, útiles cuando las relaciones entre configuraciones y rendimiento cambian de forma gradual. En segundo lugar, emplean CatBoost, un método de ensamblado potente y bien adaptado a problemas complicados y de alta dimensionalidad como el reconocimiento de imágenes. HomOpt no se encierra en un único sustituto; en su lugar trata la elección del sustituto como un componente enchufable que puede ajustarse a la dificultad y estructura de la tarea. El marco puede manejar configuraciones continuas, discretas y categóricas, y puede aplicarse sobre estrategias de búsqueda comunes como la búsqueda aleatoria, la optimización bayesiana o métodos basados en árboles, actuando como una capa de refinamiento más que como un reemplazo.

Poniendo el método a prueba

Los investigadores evalúan HomOpt en un conjunto diverso de pruebas. En tareas clásicas de aprendizaje automático extraídas de conjuntos de datos tabulares públicos, afinan modelos como máquinas de vectores de soporte, bosques aleatorios, regresión logística, perceptrones multicapa y árboles potenciados por gradiente. También examinan problemas exigentes de reconocimiento con conjuntos abiertos, donde un sistema debe lidiar con categorías no vistas previamente, usando un clasificador especializado llamado Extreme Value Machine. Finalmente, prueban HomOpt en tablas de búsqueda de arquitecturas neuronales para conjuntos de datos de imágenes conocidos como CIFAR-10 y colecciones estilo ImageNet, donde el espacio de diseños posibles es especialmente amplio y accidentado. En muchos de estos escenarios, HomOpt acelera la convergencia hacia buenas soluciones o mejora el rendimiento final en comparación con los métodos subyacentes por sí solos, a menudo empleando menos evaluaciones de modelos costosas.

Qué significa esto para la práctica cotidiana de la IA

Para los profesionales, el mensaje principal es que HomOpt ofrece una forma estructurada de hacer el ajuste de hiperparámetros más inteligente en lugar de simplemente más exhaustivo. Al refinar continuamente una imagen aproximada del paisaje de rendimiento y seguir suavemente cómo su punto óptimo se desplaza a medida que esa imagen mejora, el método reduce la búsqueda desperdiciada y aprovecha mejor cada ejecución de modelo. Dado que funciona con una amplia gama de medidas de pérdida, tipos de modelos y estrategias de búsqueda, HomOpt puede considerarse un complemento de propósito general para las herramientas de optimización existentes. En términos sencillos, promete obtener sistemas de IA más precisos y robustos con el mismo presupuesto de cómputo, y hacerlo de manera escalable desde pequeños problemas tabulares hasta tareas de visión grandes y complejas.

Cita: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Palabras clave: optimización de hiperparámetros, modelos sustitutos, métodos de homotopía, aprendizaje automático automatizado, búsqueda de arquitecturas neuronales