Clear Sky Science · es

AsynDBT: ajuste biescalar distribuido asincrónico para aprendizaje en contexto eficiente con modelos de lenguaje grandes

Por qué los prompts más inteligentes importan para la IA cotidiana

Los modelos de lenguaje grandes ahora impulsan chatbots, motores de búsqueda y asistentes de redacción que muchas personas usan a diario. Sin embargo, obtener respuestas útiles sigue dependiendo en gran medida de cómo formulamos las preguntas y de qué ejemplos mostramos al modelo. Este artículo presenta una nueva manera de refinar automáticamente esos prompts y ejemplos a través de muchos dispositivos, manteniendo al mismo tiempo los datos de cada usuario privados. El resultado es un sistema de IA que aprende a responder con mayor precisión y eficiencia, especialmente en tareas especializadas como el mantenimiento de redes de telecomunicaciones.

Enseñar a la IA mostrando, no reentrenando

En lugar de reentrenar constantemente modelos gigantescos, una tendencia creciente es enseñarles “en el momento” suministrando unos pocos ejemplos cuidadosamente elegidos en el prompt —un proceso conocido como aprendizaje en contexto. Por ejemplo, para clasificar reseñas de películas como positivas o negativas, se puede mostrar al modelo un pequeño conjunto de ejemplos etiquetados y luego pedirle que etiquete una reseña nueva. El problema es que la elección de ejemplos y la redacción exacta de las instrucciones pueden cambiar dramáticamente el rendimiento del modelo. Encontrar buenas combinaciones a mano es lento y costoso, y compartir datos sin procesar entre organizaciones a menudo es imposible debido a normas de privacidad.

Cooperar sin compartir datos privados

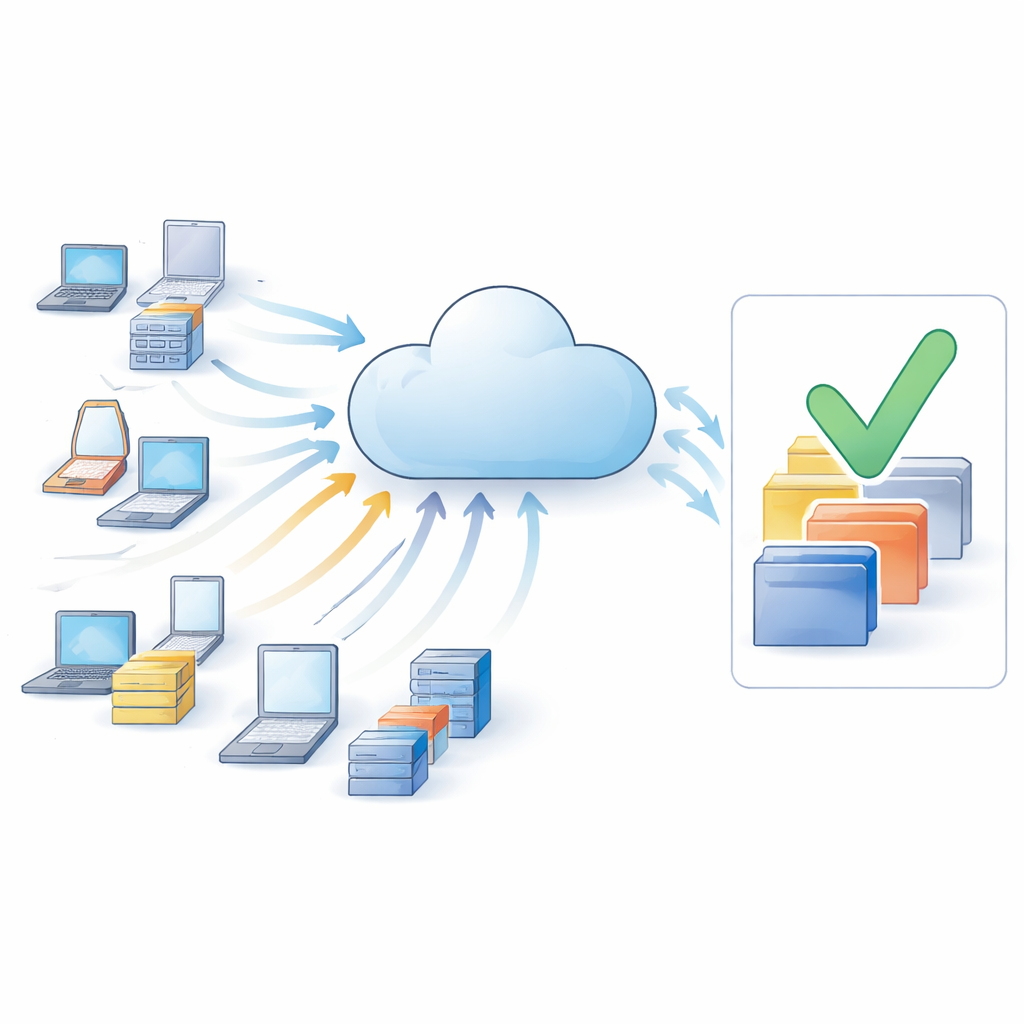

Para sortear las barreras de intercambio de datos, los autores se apoyan en el aprendizaje federado, un esquema en el que muchos dispositivos u organizaciones distintos mantienen sus datos localmente pero colaboran a través de un servidor central. Cada trabajador —por ejemplo, una estación base de telecomunicaciones o un servidor empresarial— se comunica con el mismo modelo de lenguaje alojado en la nube, pero nunca sube su texto en bruto. En su lugar, solo envía señales de retroalimentación sobre qué tan bien parecen funcionar distintos prompts y selecciones de ejemplos. Un nuevo algoritmo llamado AsynDBT (ajuste biescalar distribuido asincrónico) coordina a estos trabajadores para que mejoren conjuntamente una estrategia compartida de prompting respetando la privacidad y afrontando conexiones de red lentas o poco fiables.

Optimizar tanto la pregunta como los ejemplos

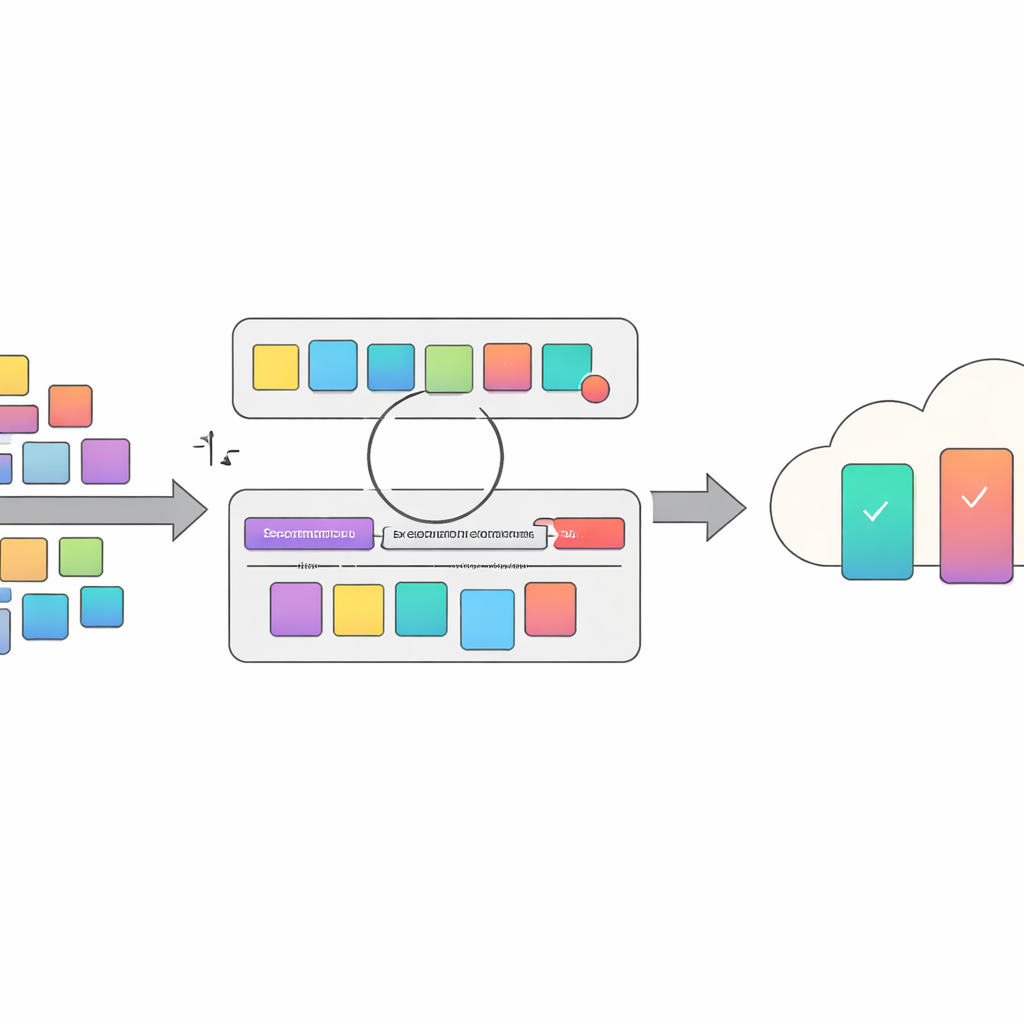

Una idea clave del artículo es tratar el diseño de prompts como un problema de optimización de dos capas. En la capa inferior, el sistema ajusta fragmentos breves que se añaden a la instrucción de la tarea —pequeños cambios en la redacción que pueden orientar al modelo hacia un razonamiento mejor. En la capa superior, decide qué ejemplos etiquetados incluir como demostraciones. Estas dos capas interactúan: distintos conjuntos de ejemplos exigen diferentes ajustes del prompt, y viceversa. AsynDBT formaliza esta relación matemáticamente y utiliza un método de aproximación eficiente para que cada trabajador pueda actualizar gradualmente sus elecciones locales mientras un servidor central mantiene una vista global consistente de las decisiones de la capa inferior.

Gestionar dispositivos lentos y participantes maliciosos

En redes reales, algunos dispositivos responden tarde o se desconectan, creando “rezagados” que pueden paralizar el entrenamiento sincronizado estándar. AsynDBT funciona de forma asincrónica: el servidor actualiza sus variables siempre que un subconjunto de trabajadores informa, sin esperar a todos. El método también protege frente a trabajadores que puedan enviar actualizaciones engañosas, intencionalmente o por error. Al combinar técnicas de regularización con reglas de agregación robustas, el algoritmo reduce el impacto de selecciones de ejemplos envenenadas o de baja calidad sobre la estrategia global, ayudando a que el sistema permanezca estable y fiable incluso bajo ataque.

Ganancias demostradas en tareas de lenguaje y telecomunicaciones

Los investigadores probaron AsynDBT en seis problemas de clasificación de texto, incluido un exigente conjunto de datos de redes 5G donde el modelo debía juzgar si términos técnicos especializados estaban relacionados, usando solo fragmentos de estándares de telecomunicaciones como contexto. En comparación con una gama de métodos existentes de prompting y selección de ejemplos, el nuevo enfoque logró la mejor o la segunda mejor precisión en casi todas las tareas. En la tarea de 5G en particular, mejoró la precisión en unos diez puntos porcentuales respecto a la mejor línea base. Al mismo tiempo, el diseño asincrónico redujo el tiempo de entrenamiento en aproximadamente un 40 por ciento en relación con un método centralizado similar que no distribuye el trabajo.

Qué significa esto para las futuras herramientas de IA

Para los no expertos, la conclusión es que mejores prompts y elecciones de ejemplos más inteligentes pueden mejorar notablemente el comportamiento de los sistemas de IA —sin cambiar el modelo subyacente. AsynDBT ofrece una forma automatizada y que preserva la privacidad para lograr esto en muchos dispositivos colaboradores, produciendo herramientas de lenguaje más precisas y eficientes para dominios como operaciones de telecomunicaciones, atención al cliente y otros campos especializados. Mirando hacia el futuro, los autores planean combinar su marco con recuperación de conocimientos basada en grafos para que los prompts también puedan apoyarse en información factual actualizada, reduciendo aún más las alucinaciones y haciendo los asistentes de IA más confiables en entornos de alta exigencia.

Cita: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

Palabras clave: aprendizaje en contexto, optimización de prompts, aprendizaje federado, modelos de lenguaje grandes, IA con preservación de la privacidad