Clear Sky Science · es

Evaluación comparativa de modelos de lenguaje visual en la valoración de la calidad de vídeos de divulgación científica sobre ojo seco

Por qué esto importa para los espectadores cotidianos

Las aplicaciones de vídeo breve se están convirtiendo rápidamente en la primera parada de muchas personas en busca de consejos de salud, incluidos problemas oculares como el ojo seco, que afecta a cientos de millones en todo el mundo. Pero junto con clips útiles, es fácil encontrar vídeos de baja calidad o engañosos, y los médicos tienen dificultades para controlarlos. Este estudio pregunta si los nuevos sistemas de inteligencia artificial capaces de “ver” vídeos podrían ayudar a comprobar automáticamente la calidad de estos clips de salud, y muestra por qué, de momento, esas herramientas no están listas para sustituir el juicio experto.

Ojos secos y el auge de los vídeos de salud

El ojo seco es más que una molestia menor; puede provocar visión borrosa, dolor y alterar el trabajo y la vida diaria. A medida que la dolencia se vuelve más frecuente, especialmente entre personas mayores y quienes pasan muchas horas frente a pantallas, mucha gente busca en línea explicaciones y consejos de autocuidado. Plataformas como TikTok alojan incontables vídeos breves sobre ojo seco, pero su naturaleza abierta permite que cualquiera publique contenido, independientemente de su formación médica. Los consejos pobres o exagerados pueden retrasar un tratamiento adecuado o promover remedios caseros inseguros, por lo que hace falta con urgencia formas fiables de evaluar la calidad de los vídeos a gran escala.

Cómo los investigadores probaron a los revisores de vídeo basados en IA

El equipo recopiló 185 vídeos en chino sobre ojo seco en TikTok usando una cuenta nueva y neutral y criterios estrictos para mantener solo clips originales y educativos. Dos especialistas en oftalmología puntuaron cada vídeo con tres herramientas establecidas que se usan a menudo en investigación sobre educación médica. Una herramienta valoró la facilidad de comprensión de los vídeos y lo claramente que sugerían pasos concretos que los espectadores podrían seguir. Otra ofreció una calificación global de la calidad, de pobre a excelente. La tercera desglosó la calidad en aspectos como la fluidez de la presentación de la información, su exactitud, el uso de elementos complementarios como animaciones y la correspondencia entre el contenido y el título del vídeo.

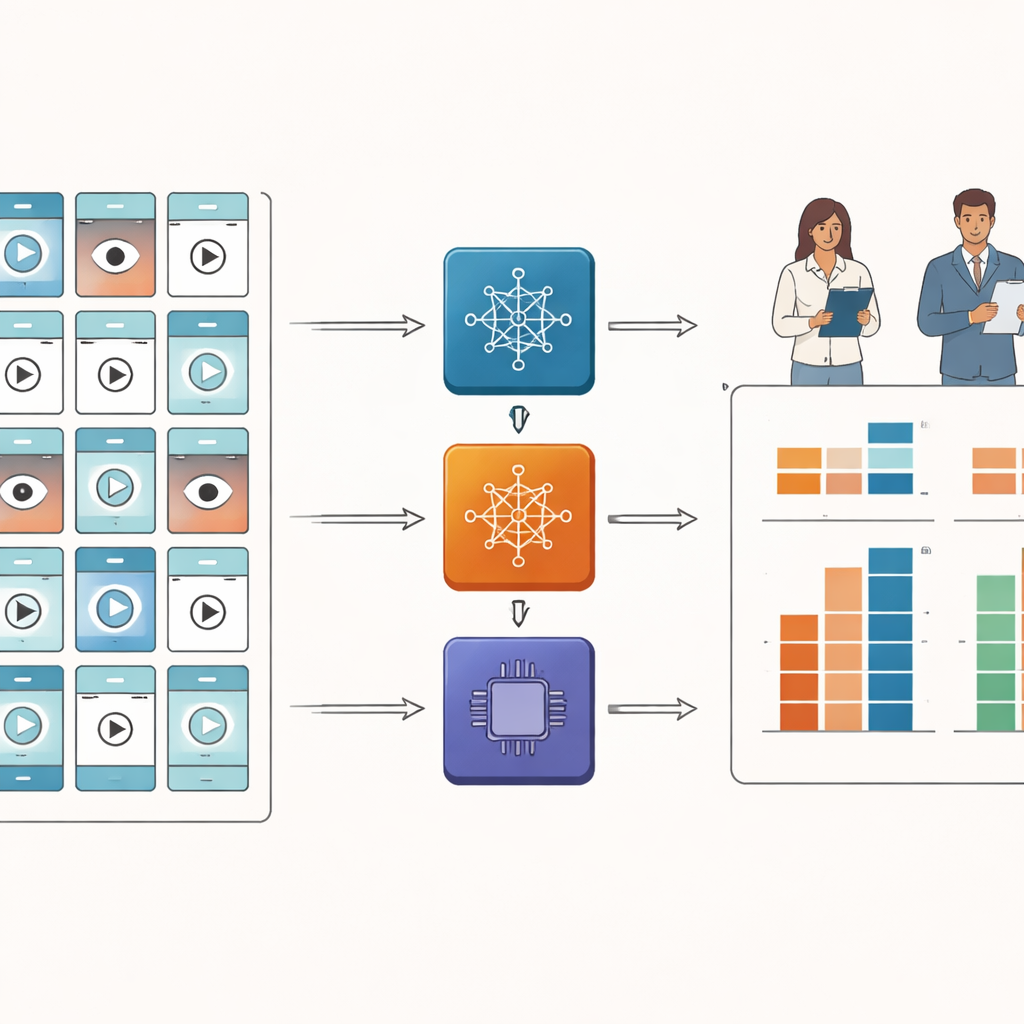

Poniendo a prueba modelos de IA preparados para vídeo

A continuación, los investigadores introdujeron los mismos vídeos en tres avanzados “modelos de lenguaje visual” —sistemas de IA diseñados para interpretar información visual cuadro por cuadro y responder preguntas sobre lo que ven—. Prepararon instrucciones detalladas para que cada modelo imitara lo más fielmente posible las herramientas de puntuación empleadas por los médicos. La cuestión clave era si la IA y los expertos humanos asignarían puntuaciones similares. Para medirlo, el equipo usó una estadística estándar de fiabilidad que captura cuán estrechamente coinciden dos “evaluadores”, no solo en tendencias sino en cifras concretas.

Qué acertó y qué falló la IA

Los evaluadores humanos coincidieron en gran medida entre sí, lo que sugiere que sus puntuaciones eran estables y fiables. En contraste, los tres sistemas de IA mostraron pobre concordancia con los expertos en la mayoría de ámbitos. Ninguno de los modelos pudo igualar de forma fiable a los médicos en la calidad global del vídeo ni en características detalladas como la correspondencia entre títulos y contenido. Un modelo tendía a otorgar puntuaciones más altas que los expertos, otro tendía a puntuaciones más bajas, y solo uno, en ocasiones, quedó en un punto intermedio. El único aspecto relativamente mejor fue la “accionabilidad”: cómo de claramente los vídeos indicaban a los espectadores qué hacer, donde dos modelos alcanzaron un nivel de acuerdo moderado, pero aún insuficiente para la toma de decisiones en el mundo real.

Por qué la IA actual se queda corta

Los autores sugieren varias razones para esta brecha. Los sistemas de IA probados se entrenaron principalmente con escenas cotidianas y tareas genéricas de vídeo, no con educación sanitaria cuidadosamente estructurada. Muchos vídeos científicos dependen en gran medida de explicaciones habladas, subtítulos, gráficos y metáforas más que de imágenes en movimiento explícitas, y los modelos de este estudio analizaron solo los fotogramas visuales sin escuchar el audio ni leer los títulos u otra información descriptiva que los humanos usan para juzgar la relevancia y la exactitud. Como resultado, grandes porciones del significado nunca llegaron a la IA, especialmente cuando los detalles clave se pronunciaban en lugar de mostrarse. El lenguaje figurado, común en la divulgación sanitaria en chino, también puede confundir a sistemas que interpretan las declaraciones de forma literal.

Qué significa esto para pacientes y plataformas

Este trabajo proporciona una guía inicial, no una red de seguridad lista para usar. Muestra que, en principio, las listas de verificación de calidad conocidas para información sanitaria pueden traducirse en instrucciones para modelos de IA que analizan vídeos. También deja claro que los sistemas de propósito general actuales no son todavía lo bastante fiables para calificar vídeos médicos o vigilar la desinformación sin supervisión humana. Al publicar su marco de evaluación y el conjunto de datos anotados de vídeos, los autores esperan impulsar modelos mejores y más especializados que puedan integrar imágenes, sonido y contexto adicional, y que funcionen a través de enfermedades e idiomas. Por ahora, los espectadores deberían seguir considerando los vídeos breves de salud como puntos de partida, no como consejos médicos, y las plataformas no deben confiar solo en la IA para garantizar información de confianza.

Cita: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

Palabras clave: enfermedad del ojo seco, vídeos de salud, inteligencia artificial, desinformación, TikTok