Clear Sky Science · es

Optimización de medidas de intervención frente a enfermedades infecciosas mediante aprendizaje por refuerzo con datos de la epidemia de COVID-19 en el Reino Unido

Herramientas inteligentes para decisiones sanitarias difíciles

Cuando una nueva enfermedad se propaga por un país, los responsables deben decidir rápidamente cuán drástico será el freno a la actividad cotidiana. Cerrar todo puede salvar vidas pero destrozar la economía; actuar con lentitud provoca el colapso hospitalario. Este artículo explora si una forma de inteligencia artificial, denominada aprendizaje por refuerzo, puede ayudar a los gobiernos a hallar respuestas más inteligentes y equilibradas usando simulaciones detalladas de cómo un virus como el COVID‑19 se propaga realmente en comunidades reales.

Simular un país en un ordenador

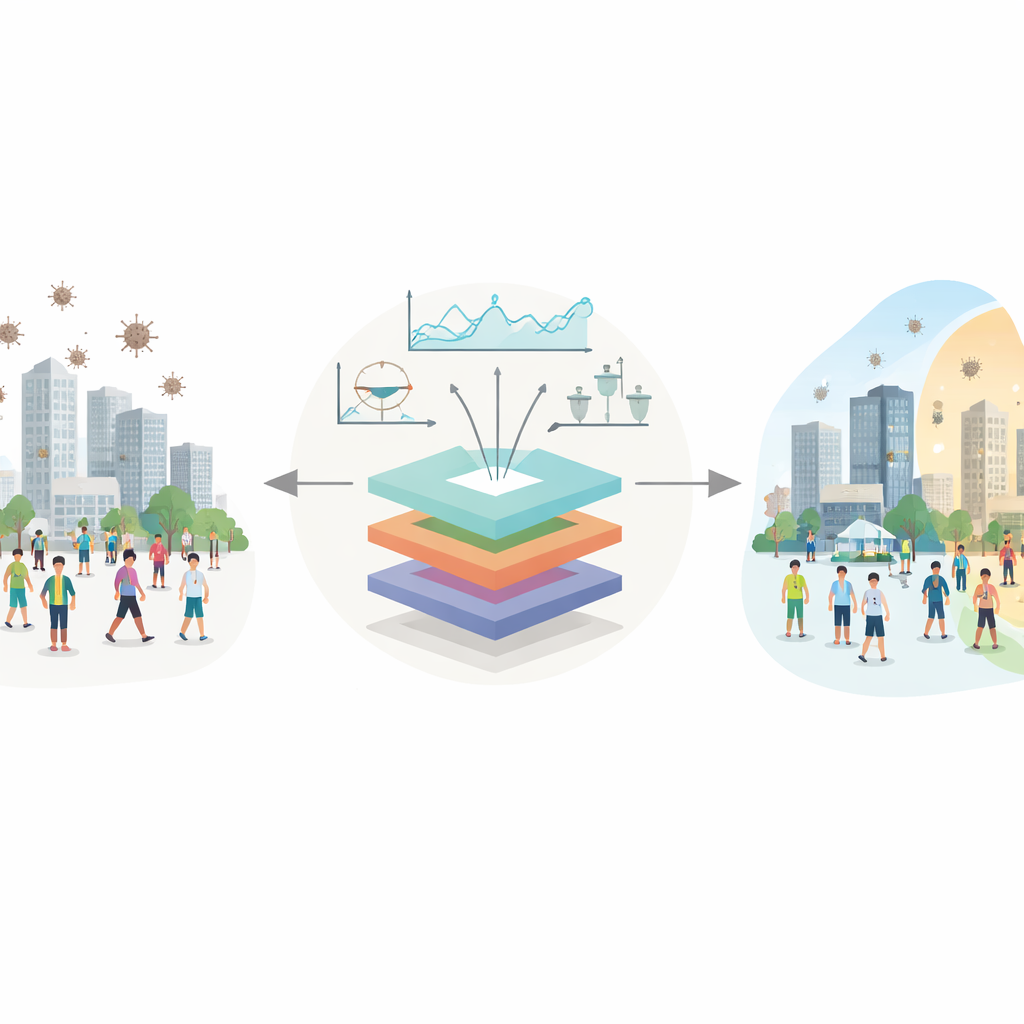

En lugar de usar ecuaciones sencillas que tratan a las personas como idénticas, los autores parten de Covasim, un modelo informático rico que sigue a miles de individuos virtuales mientras viven, trabajan, estudian e interactúan. Cada persona simulada tiene una edad, un lugar en redes familiares, escolares y laborales, y un estado de salud que puede cambiar de sano a infectado, recuperado o fallecido. Ajustando con cuidado los parámetros del modelo, el equipo hace que este Reino Unido virtual se comporte como el real durante la primera ola de COVID‑19, coincidiendo con los recuentos oficiales de casos y muertes de principios de 2020. Este paso de calibración es crucial, porque cualquier estrategia que el ordenador aprenda debe funcionar en un mundo que se parezca al nuestro, no en un universo de juguete.

Enseñar a un asesor digital a actuar

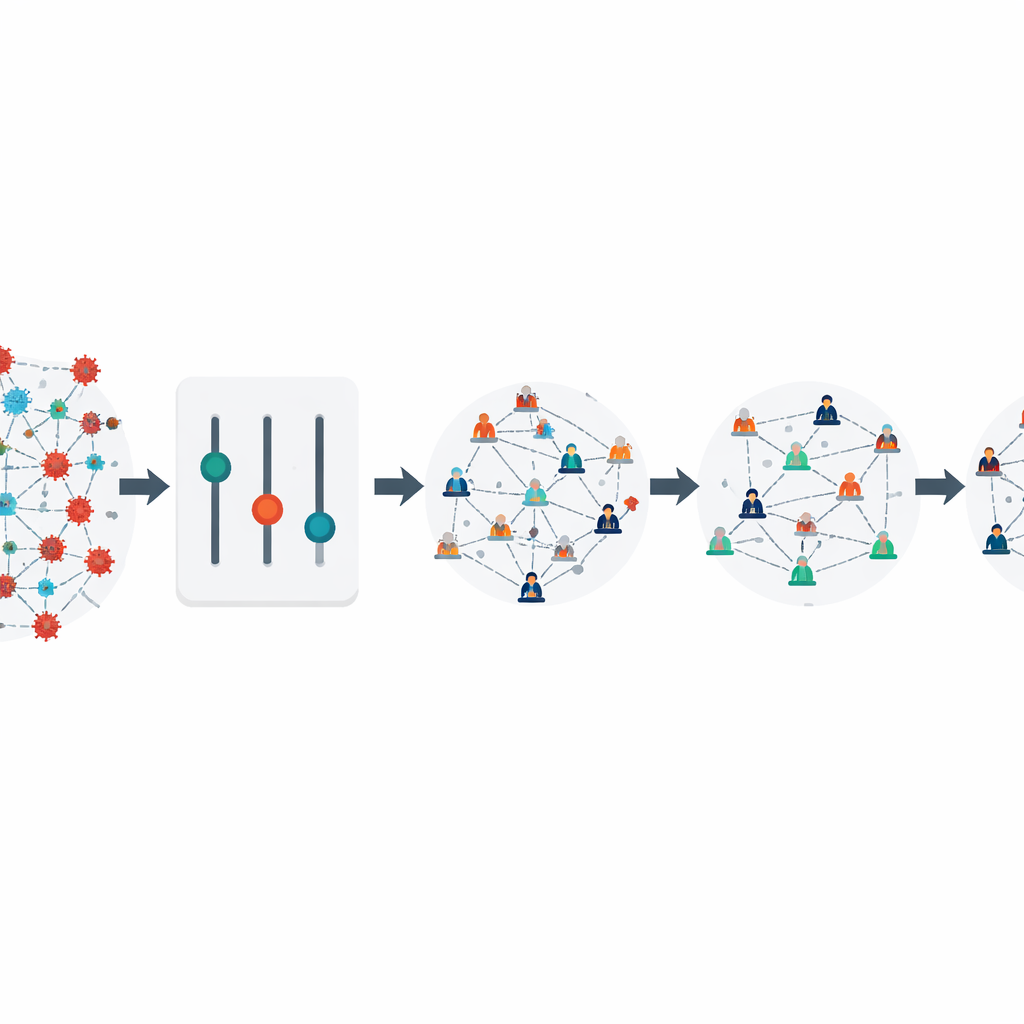

Una vez que el modelo reproduce la realidad, los investigadores incorporan aprendizaje por refuerzo, una rama de la IA en la que un “agente” de software prueba decisiones repetidamente y recibe recompensas o penalizaciones según los resultados. Aquí, el agente puede ajustar tres palancas principales cada semana simulada: la severidad de los confinamientos parciales, cuántas personas se someten a pruebas y con qué intensidad se realiza el rastreo de contactos. El sistema de recompensa está diseñado para capturar dos objetivos en competencia: mantener bajas las infecciones, las formas graves y las muertes, a la vez que limitar el daño económico causado por el cierre de centros de trabajo y el aislamiento de personas. Ejecutando miles de epidemias simuladas, el agente descubre qué combinaciones y sincronizaciones de medidas obtienen la puntuación global más alta.

Encontrar un mejor equilibrio que las reglas fijas

El estudio compara varios métodos de aprendizaje y maneras de describir las opciones del agente. Un método que trata las acciones como ajustes continuos, en lugar de un pequeño menú de opciones fijas, rinde especialmente bien. Aprende a responder rápido cuando el virus empieza a propagarse, imponiendo restricciones cortas pero fuertes combinadas con pruebas y rastreo intensos. A medida que el brote simulado queda controlado, relaja los confinamientos manteniendo cierto nivel de pruebas y rastreo, y vuelve a endurecer brevemente si las infecciones amenazan con repuntar. Este patrón flexible mantiene el número total de infecciones en torno a 300.000 en el modelo, muy por debajo de lo que ocurrió bajo las políticas reales aplicadas en el Reino Unido durante el mismo periodo, y también inferior a una simple regla de “siete días abiertos, siete días cerrados”. Las pérdidas económicas en el modelo se reducen en más de dos tercios en comparación con esa estrategia rígida de alternancia de confinamientos.

El momento lo es todo

Los autores examinan también cómo estas distintas estrategias afectan al número reproductivo en tiempo real, una medida de cuántas nuevas infecciones genera cada caso. En sus simulaciones, la política diseñada por la IA reduce este número por debajo del valor crítico de uno aproximadamente un mes antes que la respuesta real del Reino Unido. Ese desplazamiento aparentemente pequeño reduce de forma drástica las infecciones acumuladas, subrayando la diferencia que puede hacer una acción temprana y bien planificada. Además ponen a prueba la política aprendida en un escenario muy distinto, usando datos de la gran ola de COVID‑19 en Hong Kong en 2022, y encuentran que la misma estrategia sigue funcionando bien, lo que sugiere que las reglas aprendidas capturan principios generales en lugar de sobreajustarse a un solo país.

Qué significa esto para futuros brotes

Para quienes no son especialistas, el mensaje principal es que no tenemos que elegir a ciegas entre salvar vidas y salvar medios de vida. Combinando simulaciones detalladas de cómo un virus circula por redes sociales reales con una IA que aprende por ensayo y error, los responsables políticos podrían recibir guías basadas en datos que se adaptan a medida que cambian las condiciones. Los autores enfatizan que tales herramientas no pretenden reemplazar el juicio humano, sino actuar como potentes ayudas a la decisión, explorando innumerables escenarios hipotéticos mucho más rápido de lo que las personas pueden. A medida que surjan nuevas epidemias, este enfoque podría ayudar a los dirigentes a actuar antes y con mayor precisión, usando pruebas, rastreo y cierres parciales dirigidos para mantener la enfermedad bajo control preservando la mayor parte posible de la vida normal y la actividad económica.

Cita: Zhang, B., Chen, Y., Li, H. et al. Optimization of infectious disease intervention measures using reinforcement learning with UK COVID-19 epidemic data. Sci Rep 16, 10627 (2026). https://doi.org/10.1038/s41598-026-39377-8

Palabras clave: política COVID-19, aprendizaje por refuerzo, simulación epidémica, intervenciones no farmacéuticas, estrategia de salud pública