Clear Sky Science · es

Análisis de la relación entre rasgos del hablante conscientes de la privacidad y características multimodales en entrevistas de trabajo

Por qué tu voz en las entrevistas de trabajo plantea nuevas preguntas

Cada vez más empresas recurren a entrevistas de vídeo automatizadas, donde algoritmos escuchan cómo hablas e infieren rasgos como confianza, fiabilidad o sociabilidad. Pero la voz transmite mucho más que una primera impresión: puede insinuar identidad, salud y antecedentes. Este artículo explora si es posible ocultar quién eres en una grabación manteniendo que las máquinas evalúen cómo te perciben como candidato. En otras palabras, ¿podemos conservar los beneficios de la contratación asistida por IA sin sacrificar nuestra privacidad en silencio?

De las primeras impresiones a los juicios automatizados

Los psicólogos de la contratación saben desde hace tiempo que los patrones amplios de personalidad —a menudo descritos como los cinco grandes rasgos: apertura, responsabilidad, extraversión, amabilidad y estabilidad emocional— influyen en el éxito laboral. Los avances recientes en inteligencia artificial permiten a las computadoras estimar estos rasgos a partir de la forma en que las personas hablan en entrevistas de trabajo, capturando no solo lo que dicen sino cómo lo dicen: su tono, volumen, ritmo y estilo general de habla. Estos sistemas prometen una selección de candidatos más rápida y consistente. Sin embargo, también plantean una inquietante cuestión: si una empresa almacena tu voz, ¿podría ese mismo dato usarse más adelante para reconocerte, perfilarte o inferir detalles sensibles que nunca aceptaste compartir?

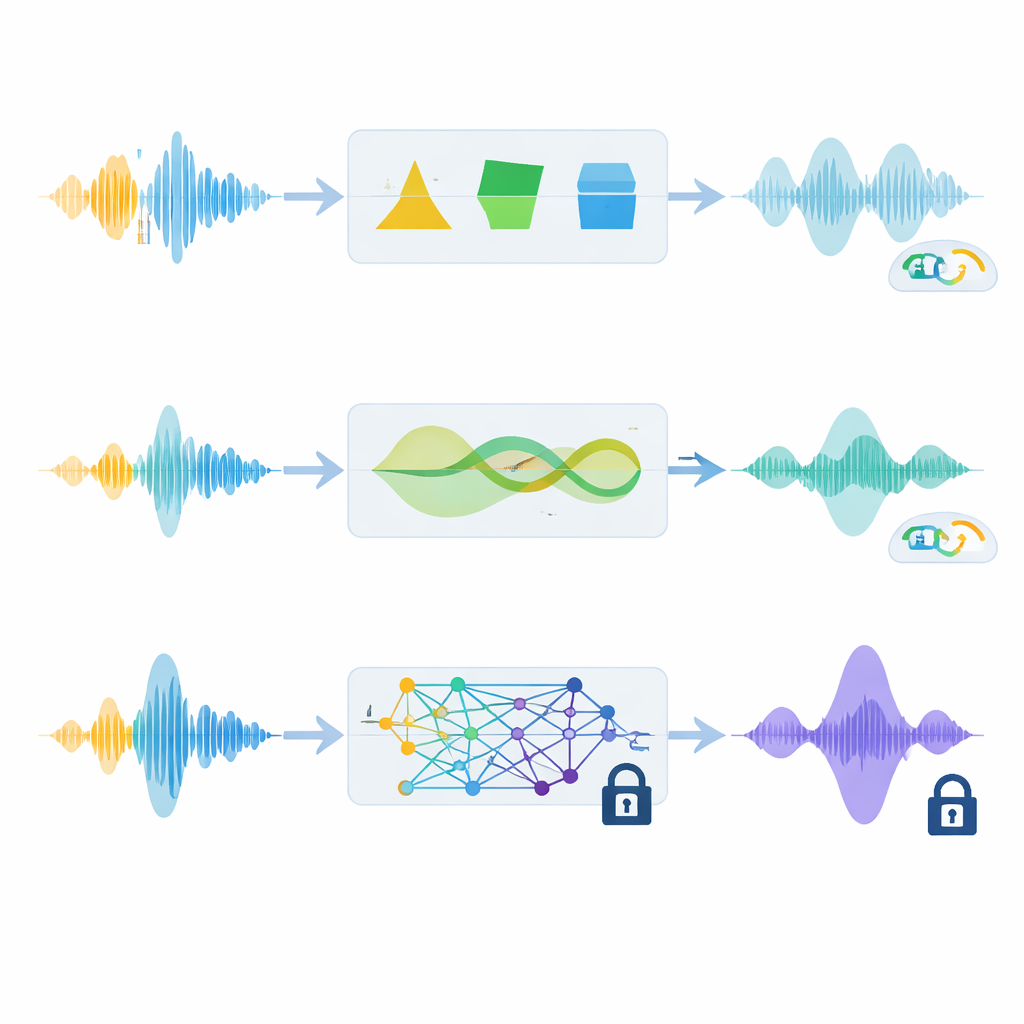

Cómo ocultar una voz sin perder su carácter

Para abordar este dilema, los investigadores estudiaron técnicas que modifican la voz de una persona para que deje de sonar como ella, conservando al mismo tiempo las señales necesarias para juzgar la personalidad y la idoneidad laboral. Se centraron en tres métodos de anonimización. Dos de ellos emplean trucos de audio tradicionales, como remodelar sutilmente las frecuencias sonoras y estirar o desplazar el tono a lo largo del tiempo. El tercero se basa en un códec de audio neuronal moderno, que comprime la voz en una serie de códigos digitales y luego la reconstruye como una voz nueva, de alta calidad pero con timbre distinto. De forma crucial, el equipo ajustó todos los métodos para que el género percibido del hablante se mantuviera igual y la voz convertida fuera coherente a lo largo de varias respuestas en una entrevista online larga.

Poner a prueba la privacidad y la utilidad

Con casi 1.900 vídeos reales de entrevistas online de personas de Estados Unidos, los autores plantearon dos preguntas principales. Primero: ¿qué tan difícil sería para un atacante emparejar voces anonimizada s con los hablantes originales usando un sistema avanzado de reconocimiento de voz? Segundo: después de la anonimización, ¿podrían los algoritmos seguir prediciendo con similar precisión las puntuaciones de personalidad clave y las recomendaciones de contratación? Evaluaron la privacidad usando una tasa de error en la verificación automática del hablante —a mayor error, mejor protección— y midieron la utilidad mediante la precisión del reconocimiento de voz, la calidad de audio percibida y la capacidad de modelos de aprendizaje automático para inferir rasgos y decisiones de contratación a partir de características acústicas y lingüísticas.

Cómo se ve realmente el equilibrio

Los resultados muestran un equilibrio matizado entre seguridad y rendimiento. El método más simple, que remodela ligeramente las frecuencias de la voz, ofreció solo una privacidad modesta y pudo fallar casi por completo cuando el sistema del atacante se adaptó a las voces anonimizadas. Una técnica de señalización más avanzada que altera la sincronía y el tono funcionó mucho mejor: redujo de forma significativa las probabilidades de reidentificación exitosa mientras preservaba el ritmo y la expresividad del habla. Como resultado, las predicciones de contratación y de rasgos se mantuvieron cercanas a las realizadas con las grabaciones originales. El método basado en el códec neuronal ofreció la mayor privacidad, dificultando mucho más enlazar las voces anonimizadas con hablantes reales e incluso limpiando el ruido de fondo en ocasiones. Sin embargo, en las grabaciones de entrevistas ruidosas y del mundo real, este método también alteró señales prosódicas sutiles que influyen en la percepción de los rasgos, provocando una caída notable en el rendimiento de estimación de rasgos y mayores errores en la transcripción automática.

Qué significa esto para una contratación justa y privada

El estudio demuestra que no existe una solución única: una mayor privacidad suele implicar un coste en la capacidad de la IA para leer la personalidad y recomendar candidatos. Para entornos de contratación típicos, donde la prioridad son las estimaciones de rasgos y decisiones justas, los enfoques refinados de procesamiento de señal —especialmente el método basado en fase probado aquí— pueden ofrecer el mejor compromiso, protegiendo la identidad sin perder la “sensación” de la voz de una persona. En situaciones con mayores exigencias de privacidad, como el intercambio amplio de datos de voz o la protección frente a atacantes potentes, los métodos neuronales de códec pueden proporcionar mayor protección, pero los diseñadores deben aceptar cierta pérdida en la precisión de la evaluación de personalidad y idoneidad. En última instancia, el trabajo sostiene que proteger la voz de los candidatos debe tratarse como un requisito ético y no como una ocurrencia tardía, y que las herramientas futuras deben definir con cuidado qué aspectos del habla ocultar y cuáles preservar.

Cita: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Palabras clave: anonimización de la voz, IA en contratación, rasgos del hablante, privacidad en datos de voz, entrevistas de trabajo