Clear Sky Science · es

Reconocimiento de emociones dominado por vídeo para dispositivos portátiles basados en EEG

Por qué tus vídeos pueden saber cómo te sientes

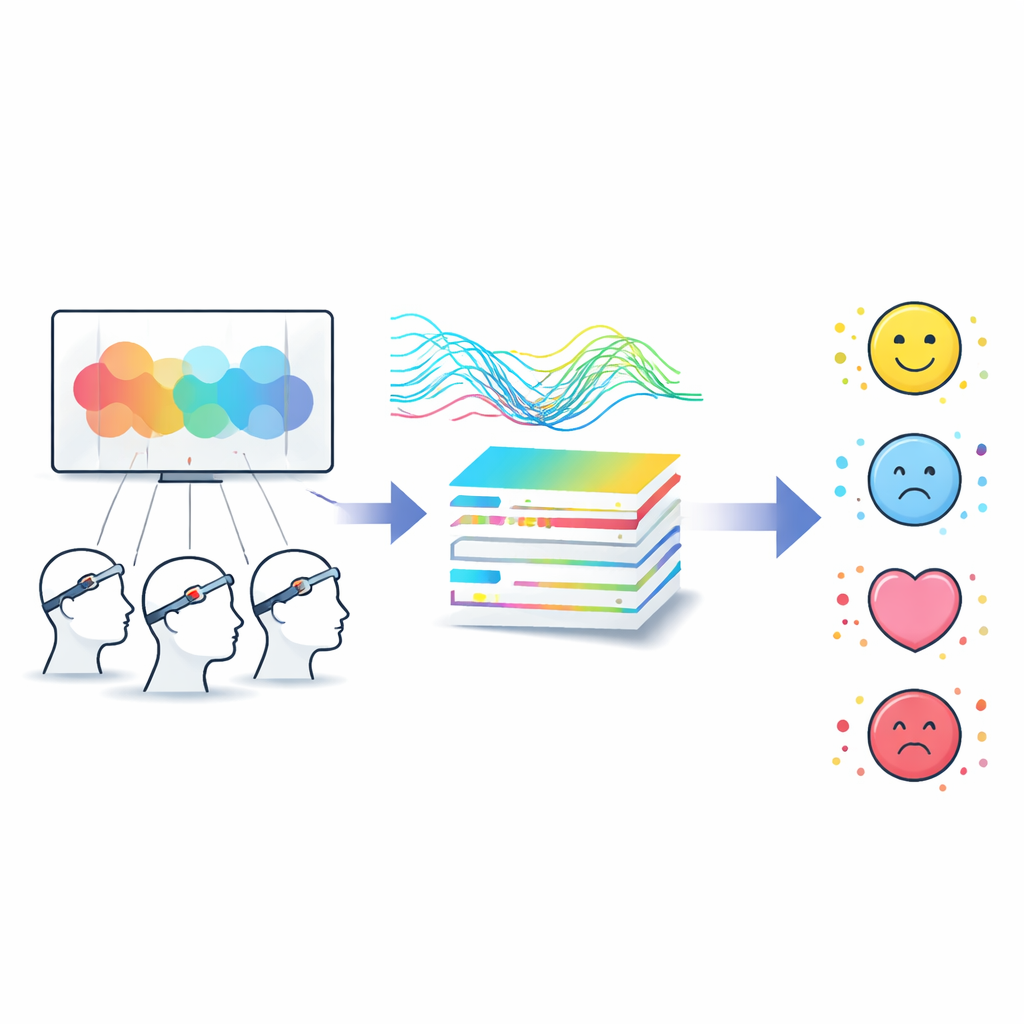

Imagina ver el tráiler de una película mientras una diadema ligera escucha discretamente tu cerebro y adivina si te sientes feliz, relajado, triste o asustado. Este estudio explora cómo hacer realista ese escenario utilizando un pequeño dispositivo portátil de ondas cerebrales (EEG) en lugar de equipos voluminosos de laboratorio. El trabajo importa para cualquiera interesado en medios más inteligentes: desde anunciantes que quieren entender las reacciones del público, hasta plataformas de streaming que podrían recomendar programas en función de cómo se sienten los espectadores, no solo de lo que eligen.

Leer sentimientos a partir de las ondas cerebrales

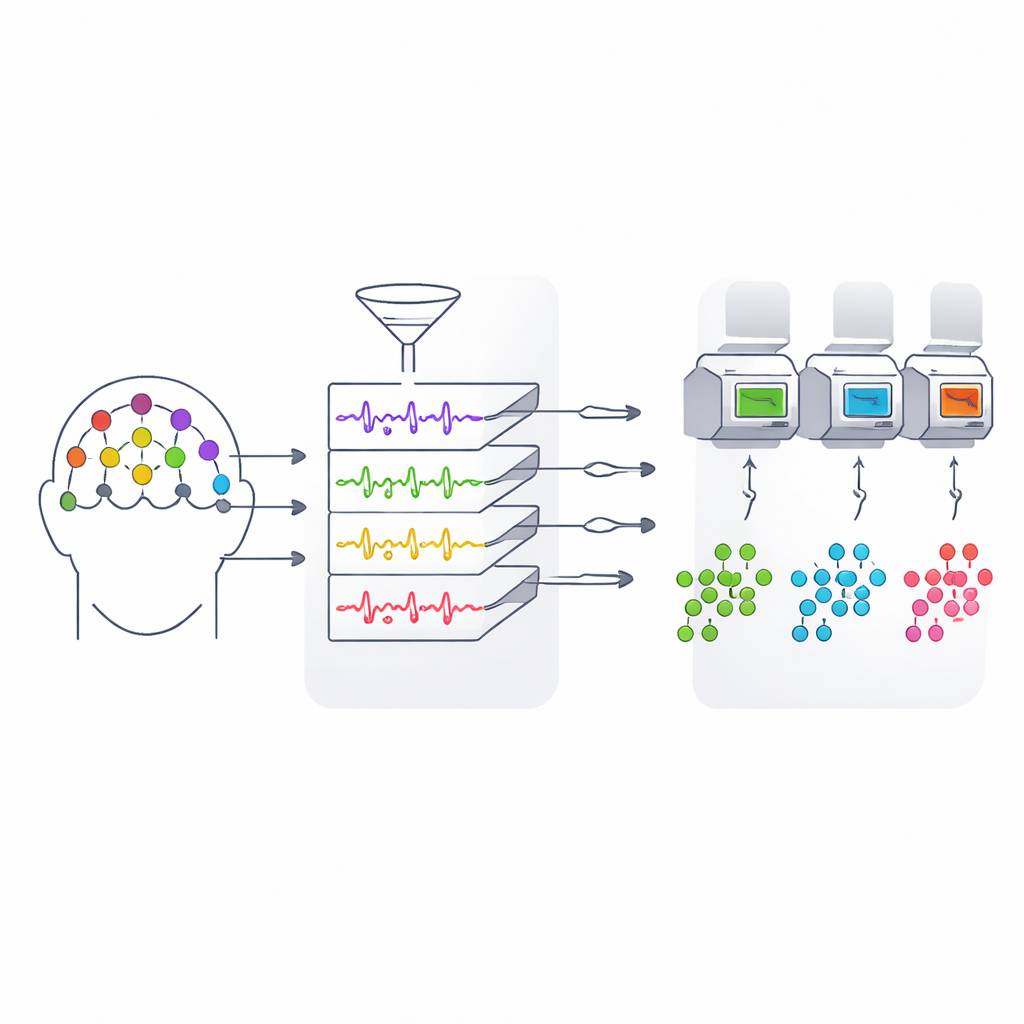

Nuestros cerebros generan señales eléctricas débiles que pueden captarse en el cuero cabelludo usando electroencefalografía, o EEG. Estas señales cambian sutilmente cuando experimentamos distintas emociones. Un conjunto de datos popular, llamado DEAP, registró el EEG de personas mientras veían videoclips musicales y luego les pidió que valoraran cuán placenteros, intensos, controlados y agradables les parecían. La mayoría de estudios previos intentaron exprimir la máxima precisión posible usando muchos electrodos y ordenadores potentes, pero bajo condiciones ideales de laboratorio que no coinciden con la vida real. Este artículo plantea en cambio una pregunta más práctica: con un dispositivo portátil de bajo coste y menos electrodos, ¿podemos aún capturar la emoción principal que un vídeo tiende a evocar en muchas personas?

Encontrar una historia emocional compartida

Un obstáculo es que las personas no describen sus sentimientos de la misma manera. Dos espectadores pueden ver el mismo fragmento: uno lo llama «emocionante» y otro «más o menos». Los investigadores abordan esto construyendo un sistema de calibración de etiquetas paso a paso que busca patrones entre espectadores en lugar de confiar en la valoración de una sola persona. Primero, todas las valoraciones se ponen en una escala común y se comprimen en unas pocas dimensiones clave. Luego, un agrupamiento no supervisado reúne respuestas emocionales similares, con el objetivo de dividir los vídeos en cuatro grandes esquinas del espacio emocional: feliz (placentero e intenso), relajado (placentero y tranquilo), temeroso (desagradable e intenso) y triste (desagradable y tranquilo). Una etapa final de refinamiento ajusta los casos inciertos basándose en información adicional de las valoraciones, produciendo una etiqueta de emoción dominante para cada vídeo que refleja mejor la impresión general del grupo.

Obtener más con menos hardware

Otro desafío es el hardware: las gorras EEG completas con 32 o más electrodos son incómodas y caras. El equipo diseña una manera de reducir esto a solo 11 ubicaciones cuidadosamente elegidas en frente, centro, laterales y parte posterior de la cabeza —regiones vinculadas al control emocional, la excitación, la audición, la visión y la atención. Luego realizan un análisis detallado de cómo se distribuye la energía de la señal a través de las bandas clásicas de ondas cerebrales (de ritmos lentos a rápidos) bajo diferentes estados emocionales. Al comparar estos patrones, muestran que ciertas combinaciones de frecuencias y ubicaciones en el cuero cabelludo aportan pistas especialmente fuertes sobre si un espectador está, por ejemplo, muy excitado o profundamente relajado. Este enfoque de relación de energía multibanda les permite conservar las señales más informativas mientras eliminan gran parte de la redundancia.

Dejar que los datos resalten lo importante

Aun con menos electrodos, cada segundo de registro contiene un aluvión de números. Para evitar saturar los modelos, los autores combinan varios tipos de características —como medidas de energía basadas en wavelets, cuánto fluctúan conjuntamente distintas regiones cerebrales y cómo cambia la potencia en varias frecuencias a lo largo del tiempo— en una descripción rica pero estructurada de cada visualización. Un paso de selección guiado por saliencia ordena estas características según su utilidad para distinguir emociones, conservando solo un subconjunto compacto. Usando esta representación reducida, se entrenan tres modelos estándar de aprendizaje automático para reconocer cuál de las cuatro emociones dominantes se ajusta mejor a un vídeo dado. En pruebas exigentes donde el sistema debe generalizar a personas completamente nuevas, el mejor modelo alcanza alrededor del 45% de precisión, un resultado sólido para una elección de cuatro clases con datos cerebrales ruidosos y solo 11 canales.

Qué significa esto para la tecnología cotidiana

Para los no especialistas, el mensaje clave es que podemos empezar a medir cómo se sienten grupos de personas respecto a vídeos usando dispositivos portátiles de ondas cerebrales en lugar de instalaciones de laboratorio completas. Al limpiar las etiquetas emocionales, centrarse en las partes más informativas de la señal EEG y seleccionar solo un puñado de sensores bien colocados, los autores demuestran que es posible detectar el tono emocional dominante de un vídeo —feliz, relajado, temeroso o triste— entre los espectadores. El sistema no es perfecto, pero apunta hacia herramientas prácticas para el seguimiento del sentimiento de la audiencia, pruebas de contenido y recomendaciones sensibles a la emoción que se basan en respuestas cerebrales objetivas en lugar de solo encuestas o clics.

Cita: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Palabras clave: Reconocimiento de emociones por EEG, interfaz cerebro-ordenador, análisis afectivo de vídeo, neurociencia portátil, computación afectiva