Clear Sky Science · es

Usar un modelo de lenguaje grande para mejorar el razonamiento de otro modelo de lenguaje grande mediante GRPO con recompensa actualizada

Enseñar a las máquinas a razonar

Muchos de los modelos de lenguaje actuales pueden chatear, traducir y responder preguntas, pero aún tienen dificultades para mostrar su proceso de la misma manera que un buen estudiante de matemáticas o un analista detallista. Este artículo explora cómo un sistema de inteligencia artificial puede utilizarse para mejorar las habilidades de razonamiento de otro, y cómo hacerlo sin construir manualmente grandes conjuntos de datos especializados. Para lectores interesados en cómo la IA puede volverse más fiable en campos como las finanzas, la medicina o la investigación científica, el trabajo ofrece una receta práctica para lograr que los modelos expliquen sus respuestas con mayor claridad y consistencia.

De documentos sin procesar a ejemplos enseñables

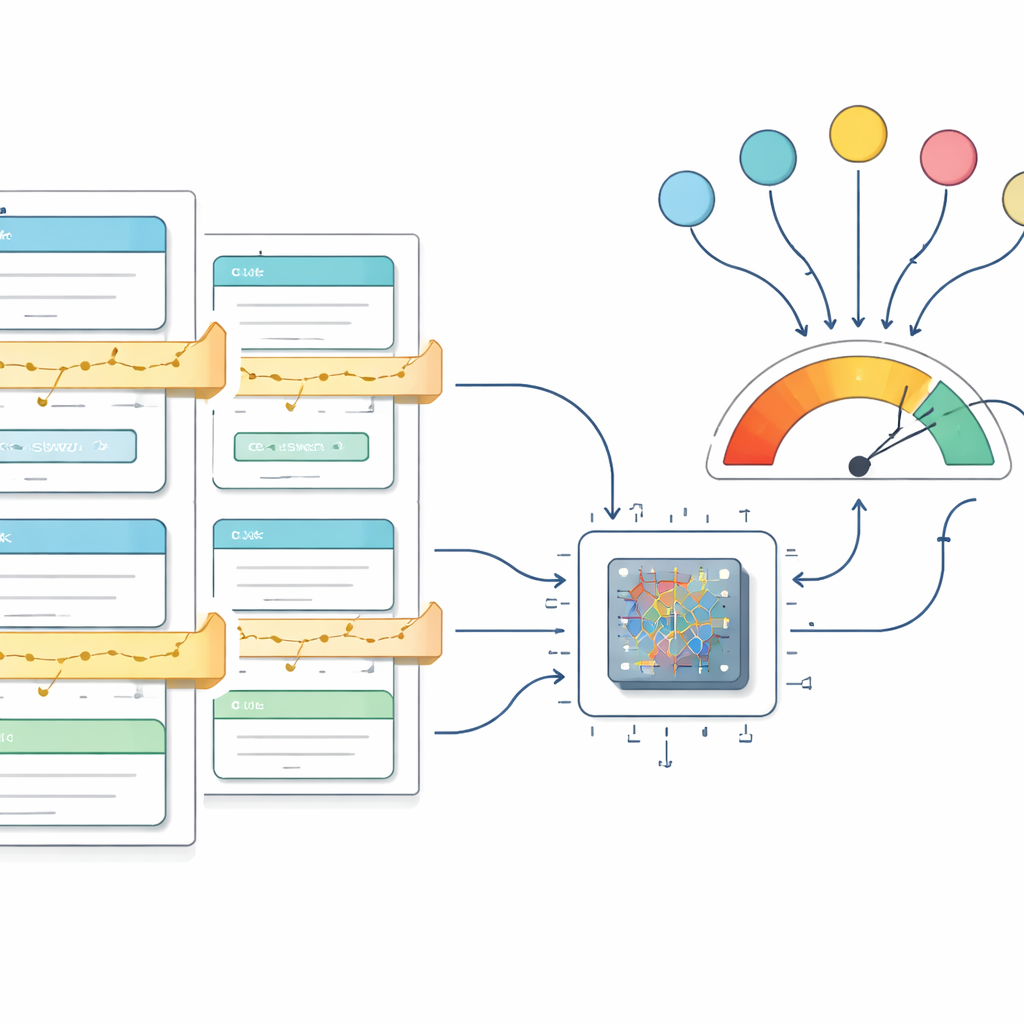

Los autores parten de una observación simple: la mayoría de la información del mundo real vive en formas desordenadas, como informes, cartas a accionistas o páginas web, no en un formato limpio de pregunta y respuesta. Para salvar esa brecha, introducen dos herramientas de software, Huggify-Data y el Generador de Datos CoT. Estas herramientas toman texto no estructurado y lo convierten automáticamente en pares de preguntas y respuestas, y luego piden a un potente modelo de lenguaje que aporte los pasos de razonamiento que faltan entre ambos. El resultado es un triple estructurado para cada ejemplo: una pregunta, una cadena de razonamiento y una respuesta. De forma crucial, esta cadena puede aplicarse a casi cualquier dominio, desde matemáticas escolares hasta finanzas corporativas, lo que hace posible crear datos de entrenamiento centrados en el razonamiento sin ejércitos de anotadores humanos.

Cómo un modelo entrena a otro

Una vez creados estos tripletes de pregunta–razonamiento–respuesta, se usan para entrenar a un modelo “estudiante” más pequeño para que piense de la misma manera estructurada. Al estudiante se le pide no solo que dé una respuesta final, sino que produzca una explicación claramente separada seguida de la conclusión. El entrenamiento se guía mediante un método llamado Group Relative Policy Optimization, que compara varias respuestas candidatas a la misma pregunta y empuja al modelo hacia mejores opciones. El artículo actualiza este método con un término de recompensa adicional que comprueba si la salida del modelo sigue el formato deseado, incluso hasta qué punto coincide con un ejemplo de referencia bien formado. Esta recompensa penaliza suavemente las explicaciones desordenadas o incompletas, impulsando al modelo hacia respuestas ordenadas e interpretables.

Poniendo el enfoque a prueba

Para comprobar si el marco funciona en la práctica, los autores lo aplican a dos conjuntos de datos muy distintos. El primero, GSM8K, consiste en problemas de primaria que requieren razonamiento aritmético en varios pasos. El segundo se construye a partir de las cartas anuales de Warren Buffett a los accionistas, donde el objetivo es captar razonamientos extendidos sobre inversión y decisiones corporativas. En ambos casos, la canalización convierte texto sin procesar en datos de entrenamiento estructurados y afina un modelo de tamaño medio llamado Qwen 2.5. Durante el entrenamiento, una regla de puntuación simple recompensa respuestas correctas y bien formateadas; a medida que el aprendizaje avanza, la recompensa media sube de forma sostenida y se estabiliza en su máximo teórico, lo que muestra que el modelo ha dominado en gran medida el comportamiento objetivo sobre los datos de entrenamiento.

Qué tan bien rinde el modelo mejorado

El rendimiento se mide usando la “precisión media por token”, que pregunta, en términos generales, qué fracción de las pequeñas piezas de texto (tokens) en las salidas del modelo coincide con las esperadas. Aunque esto difiere de la puntuación habitual de todo o nada en respuestas de prueba, es adecuado para juzgar si las explicaciones y respuestas se producen con la estructura correcta. En GSM8K, el mejor modelo alcanza un 98,2 por ciento de precisión por token, y en las cartas de Buffett alcanza un 98,5 por ciento. Estas puntuaciones son superiores a las reportadas para sistemas ampliamente conocidos como GPT‑4 y Claude 3.5 Sonnet bajo la misma métrica, todo ello usando solo un modelo de 3 000 millones de parámetros que puede entrenarse en menos de dos días en hardware alquilado. Los autores también comparten detalles sobre costes de cómputo y configuraciones de hardware, y publican todo el código, los modelos y los conjuntos de datos para que otros los inspeccionen y amplíen.

Qué significa esto para el uso cotidiano de la IA

Para los no especialistas, la principal conclusión es que se puede enseñar a los sistemas de IA no solo a responder, sino a hacerlo de forma disciplinada y fácil de seguir, usando datos extraídos automáticamente de documentos ordinarios. Al combinar un modelo profesor con riqueza de razonamiento, una canalización de datos flexible y un esquema de recompensas que valora tanto la corrección como la claridad, los autores muestran cómo esculpir modelos más pequeños en solucionadores de problemas más fiables. Aunque señalan limitaciones —como la necesidad de pruebas más sólidas de comprensión real y seguridad—, el marco apunta a un futuro en el que las organizaciones puedan convertir sus propios archivos de texto en asistentes de IA transparentes y personalizados para la educación, las finanzas y más allá.

Cita: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Palabras clave: modelos de lenguaje grandes, razonamiento en cadena de pensamiento, optimización por recompensa, curación de datos, IA específica de dominio