Clear Sky Science · es

Un análisis comparativo de modelos de chatbot integrados y ChatGPT-4 para responder consultas sobre tratamiento de ortodoncia

Por qué importan chatbots más inteligentes para los frenillos

Cualquiera que haya llevado frenillos sabe que las preguntas no esperan al horario de la clínica: ¿Se acabará este dolor? ¿Puedo comer esto? ¿Debo preocuparme por mi mandíbula? Este estudio explora si un chatbot de ortodoncia diseñado específicamente para responder estas preguntas cotidianas puede ofrecer respuestas más claras y fiables que un sistema de inteligencia artificial general, ChatGPT‑4. El trabajo ofrece una visión de cómo herramientas de IA cuidadosamente adaptadas podrían apoyar tanto a pacientes como a clínicos en la atención dental moderna.

Un chatbot diseñado solo para preguntas sobre frenillos

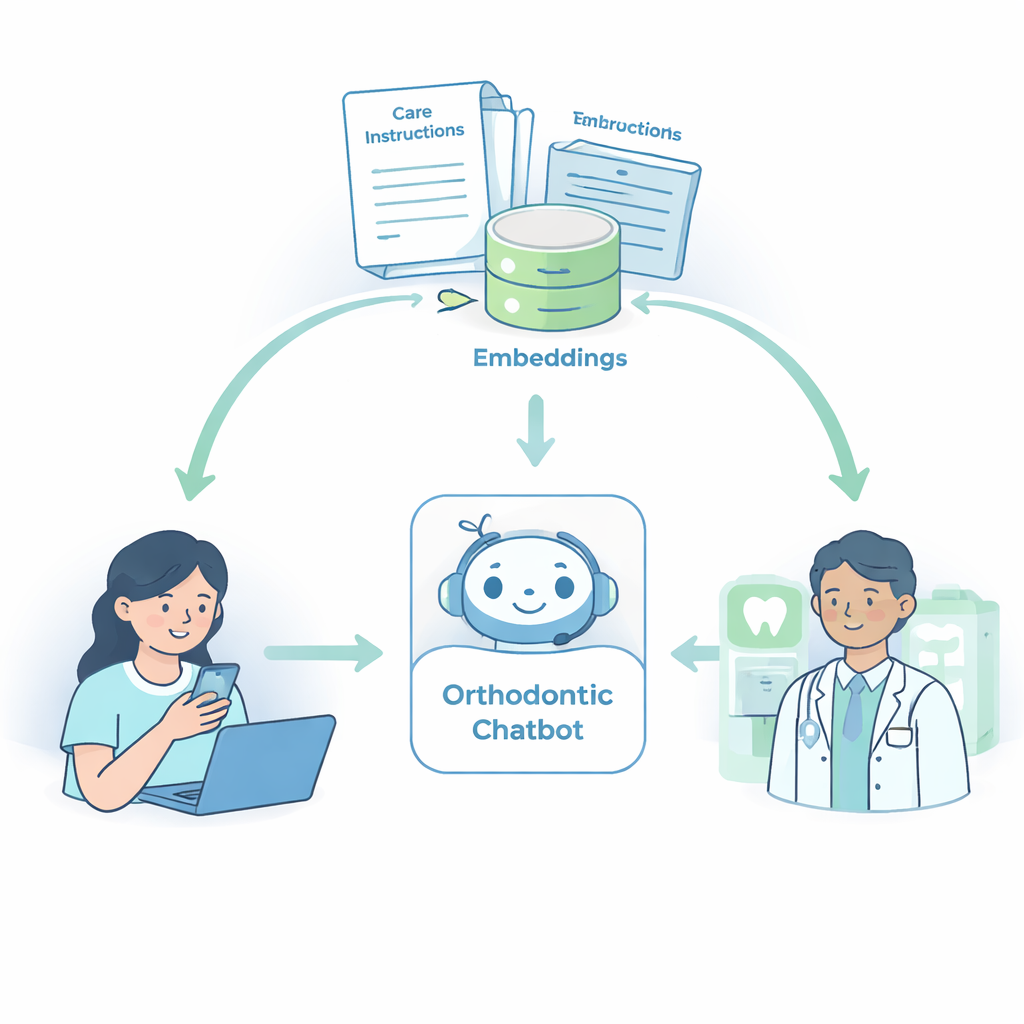

Los investigadores crearon un chatbot integrado centrado exclusivamente en el tratamiento ortodóntico. En lugar de entrenar una IA nueva desde cero, conectaron un modelo de lenguaje avanzado a una biblioteca seleccionada de materiales para pacientes y extractos clave de manuales. Esta biblioteca incluía folletos de la British Orthodontic Society sobre temas como higiene oral, dieta, cuidado de aparatos, elásticos y retenedores, junto con explicaciones breves de libros de texto ortodónticos estándar. Usando una técnica llamada generación aumentada por recuperación, el sistema buscaba en esta biblioteca los pasajes relevantes cada vez que se hacía una pregunta y los utilizaba para dar forma a su respuesta, con la intención de reflejar lo que un paciente escucharía durante una conversación típica en la consulta.

Cómo se evaluaron los dos sistemas

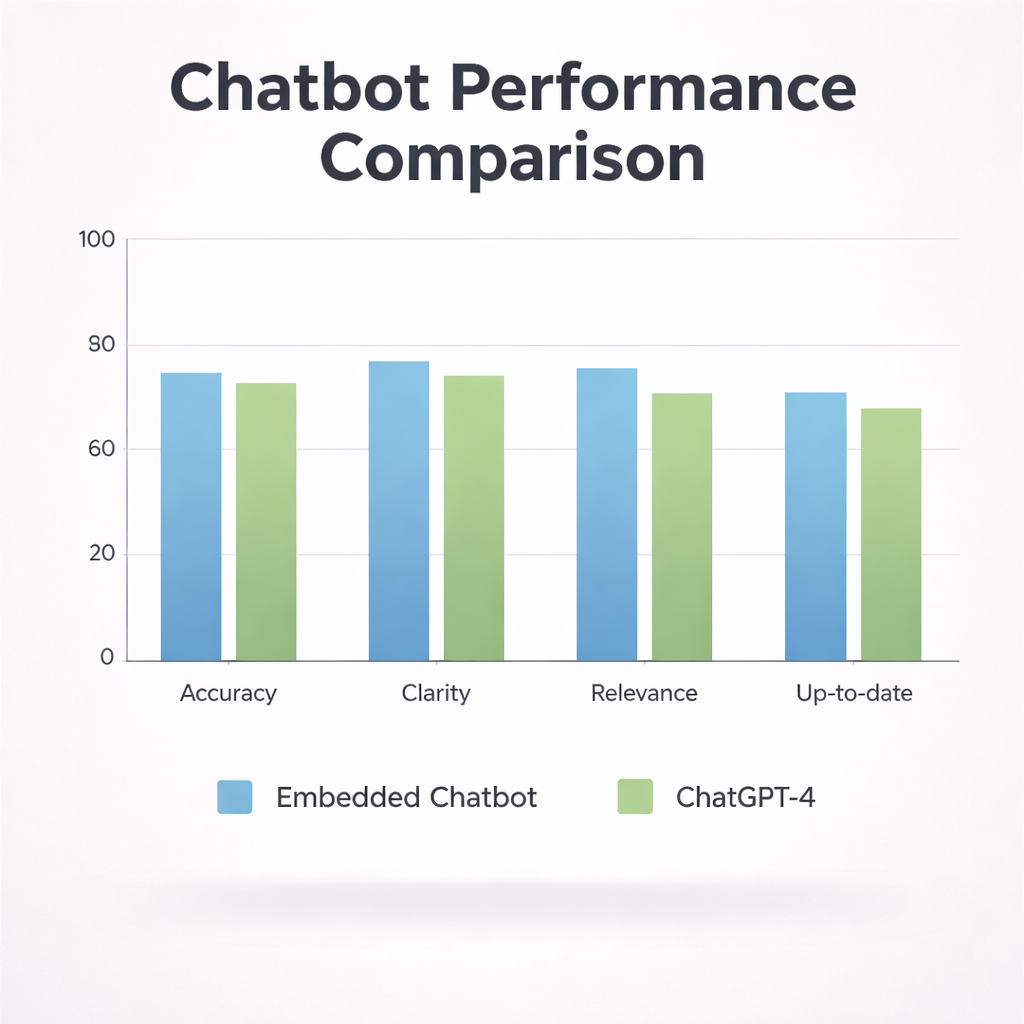

Para ver qué tal funcionaba este chatbot especializado, el equipo lo comparó con ChatGPT‑4, usado de la forma habitual a través de la interfaz de ChatGPT Plus. Reunieron 30 preguntas reales que los pacientes suelen hacer antes, durante y después del tratamiento con frenillos —por ejemplo, si los frenillos causan dolor, cómo afectan al habla o al canto, cada cuánto son necesarias las revisiones y si los frenillos pueden ayudar con problemas de la articulación de la mandíbula. A ambos sistemas se les dieron los mismos indicaciones, pidiéndoles que respondieran como expertos en ortodoncia usando un lenguaje claro y accesible para pacientes. Seis consultores ortodónticos con experiencia valoraron luego cada respuesta anonimizada en cuatro aspectos: exactitud, claridad, relevancia respecto a la pregunta y actualidad de la información, mediante una escala de cinco puntos.

Midiendo calidad, no solo opiniones

En lugar de confiar en impresiones generales, los investigadores usaron un método de puntuación estructurado llamado Índice de Validez de Contenido. Para cada pregunta y cada aspecto de calidad contaron cuántos expertos valoraron una respuesta como “de acuerdo” o “muy de acuerdo” y convirtieron esto en una puntuación entre cero y uno. Las puntuaciones altas significaban que la mayoría de los expertos consideraba la respuesta precisa, clara, relevante o actual. También calcularon promedios a lo largo de todas las preguntas para ver cómo se comportaba cada sistema en términos generales. Se aplicaron pruebas estadísticas para comprobar si las diferencias entre los dos chatbots eran lo bastante grandes como para considerarse significativas y no debidas al azar.

Qué opinaban los ortodoncistas sobre las respuestas

El chatbot integrado, en general, salió mejor parado. Aproximadamente tres cuartas partes de sus respuestas alcanzaron un umbral de calidad aceptable, frente a algo más de la mitad de las respuestas de ChatGPT‑4. En promedio, el chatbot especializado obtuvo mejores puntuaciones en exactitud, claridad y relevancia, y también pareció estar algo más alineado con la guía actual. Por ejemplo, al explicar el dolor durante el tratamiento con frenillos o si los frenillos afectan al habla, sus respuestas eran directas, concretas y coincidían estrechamente con el consejo estándar para pacientes. En cambio, las respuestas de ChatGPT‑4, aunque a menudo razonables, tendían a ser más generales y a veces más técnicas, lo que pudo reducir su claridad a ojos de los expertos. Sin embargo, cuando los investigadores aplicaron pruebas estadísticas formales, las diferencias entre los dos sistemas no fueron lo bastante grandes como para considerarse estadísticamente significativas.

Límites y lecciones para la futura IA en la clínica

El estudio también reveló que incluso los expertos no siempre coinciden sobre lo que cuenta como la “mejor” respuesta. El acuerdo global entre los ortodoncistas fue más débil de lo esperado, especialmente para aspectos subjetivos como claridad y relevancia. Los investigadores señalaron varios límites adicionales: solo estudiaron dos configuraciones de IA, no involucraron a pacientes directamente y basaron su chatbot especializado en un conjunto específico de materiales escritos. Aun así, su trabajo suma evidencia de que los sistemas de IA pueden responder razonablemente bien muchas preguntas dentales comunes, y que añadir material de referencia enfocado y actualizado puede empujar el rendimiento hacia arriba.

Qué significa esto para las personas con frenillos

Para los pacientes, la conclusión es alentadora pero cauta. Un chatbot bien diseñado y enfocado en ortodoncia puede ofrecer respuestas claras y de confianza a muchas preguntas cotidianas y ayudar a reducir la ansiedad entre citas. Al mismo tiempo, este estudio muestra que dicha herramienta aún no sustituye el juicio profesional ni el asesoramiento presencial. La verdadera promesa reside en combinar estos asistentes de IA adaptados con la atención experta, de modo que las personas con frenillos puedan obtener información oportuna y fácil de entender mientras siguen confiando en su ortodoncista para las decisiones finales.

Cita: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Palabras clave: chatbot de ortodoncia, IA dental, preguntas sobre frenillos, educación del paciente, comparación con ChatGPT