Clear Sky Science · es

Evaluación de asistentes de aprendizaje impulsados por IA en la educación superior de ingeniería: implicaciones para la participación estudiantil, la ética y las políticas

Por qué esto importa para los estudiantes universitarios de hoy

Los estudiantes universitarios recurren a chatbots y otras herramientas de inteligencia artificial para pedir ayuda con tareas, programación y conceptos de clase difíciles. Pero, ¿pueden estas herramientas apoyar realmente el aprendizaje, y qué pasa con cuestiones como el fraude académico, la justicia y la confianza cuando el software se convierte en un compañero de estudio? Este artículo sigue un experimento en condiciones reales en cursos de ingeniería civil y ambiental que probó un “Centro Educativo de IA” impulsado por IA y preguntó a los estudiantes qué funcionaba, qué les preocupaba y cómo creen que la IA debería encajar en el futuro de la enseñanza superior.

Un compañero de estudio digital, muchas herramientas integradas

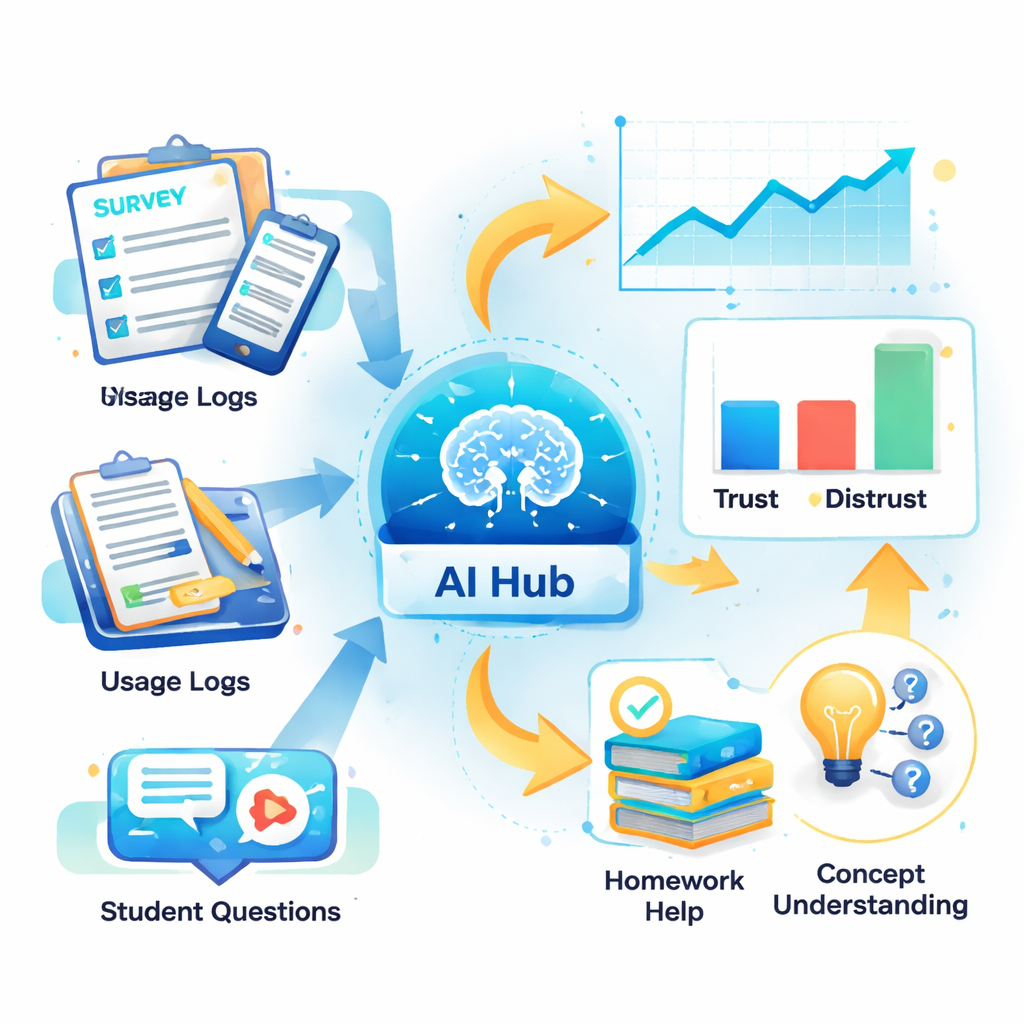

El Centro Educativo de IA es un asistente de aprendizaje específico del curso que vive dentro de la plataforma de aprendizaje en línea de la universidad. En lugar de enviar preguntas a un chatbot general entrenado con todo Internet, los estudiantes interactúan con un asistente estrechamente vinculado a sus propias clases, tareas y programa. Detrás de escena, el sistema lee los PDFs del curso aprobados por el docente, los convierte en fragmentos buscables y alimenta únicamente esos fragmentos a un modelo de lenguaje avanzado para responder a las preguntas de los estudiantes. El Hub ofrece seis herramientas principales: notas breves generadas por IA, un chatbot de preguntas y respuestas, tarjetas de repaso, cuestionarios autoevaluados, un “sandbox” de ayuda para programación y respuestas rápidas sobre la logística del programa. Está diseñado para actuar como un ayudante docente amigable y siempre disponible, en lugar de un motor de atajos.

Cómo se llevó a cabo el estudio

Para ver cómo usaban realmente los estudiantes este asistente, los investigadores lo integraron en dos cursos de pregrado de ingeniería en una gran universidad pública de investigación. Sesenta y cinco de los 77 estudiantes matriculados se ofrecieron como voluntarios para participar. Completaron encuestas al inicio y al final del semestre sobre su experiencia con la IA, su confianza en esas herramientas y sus preocupaciones sobre ética e integridad académica. Al mismo tiempo, el sistema registró silenciosamente cada interacción: qué funciones usaban los estudiantes, con qué frecuencia volvían y qué tipo de preguntas hacían. El equipo también codificó cientos de consultas estudiantiles en temas como “ayuda con software”, “preguntas teóricas” y “aclaración de tareas” para entender qué tipo de ayuda buscaban realmente los estudiantes.

Lo que les gustó a los estudiantes —y en qué no confiaban completamente

La función más popular, con diferencia, fue el chatbot, que representó más del 90 por ciento de todas las interacciones. Los estudiantes lo usaron intensamente para desbloquear tareas técnicas en herramientas como ArcGIS y MATLAB, y para aclarar conceptos y fórmulas fundamentales de ingeniería. Muchos dijeron que el asistente facilitaba la comprensión del material del curso y la realización de las tareas, y algunos afirmaron sentirse más cómodos preguntándole a la IA que a profesores o ayudantes docentes. Sin embargo, la mayoría seguía valorando la ayuda humana como igual o superior en calidad. Las preocupaciones sobre respuestas incorrectas o engañosas de la IA —a veces llamadas “alucinaciones”— hicieron que muchos usuarios trataran al asistente como un primer recurso conveniente y no como una autoridad final.

Zonas grises éticas y confusión sobre políticas

Aun cuando los estudiantes apreciaban la herramienta, se mostraban inseguros sobre las normas que rigen su uso. Muchos no tenían claro exactamente qué se consideraba mala conducta académica al trabajar con IA y temían ser acusados falsamente de hacer trampa. Casi la mitad creía que la IA no socavaba automáticamente la integridad académica, pero una proporción similar se mostraba reticente a usarla en trabajos calificados. Es importante destacar que los estudiantes no querían que se prohibiera la IA; en su lugar, pedían políticas de curso “algo restrictivas” con indicaciones claras. La mayoría coincidió en que usar la IA como ayuda académica puede ser ético y dijo que les gustaría herramientas similares en otros cursos, siempre que las expectativas se expliquen de forma sencilla y se vinculen a hábitos responsables como comprobar las fuentes y citar la asistencia.

De los datos a una mejor enseñanza y aprendizaje

Los registros de uso y las respuestas de las encuestas contaron una historia coherente: los estudiantes usaban más el Hub de IA cuando confiaban en él, se sentían cómodos con él y lo percibían como realmente útil para tareas del curso, como repasar conceptos y hacer deberes. Menos confianza en la IA iba de la mano con menor uso, mientras que comodidad y utilidad percibida se asociaron con mayor participación. Aun así, los estudiantes no atribuyeron al instrumento por sí solo la mejora de sus notas, y muchos seguían recurriendo a chatbots de uso general para programación o matemáticas que iban más allá del material del curso. Estos patrones sugieren que los asistentes de IA funcionan mejor como una capa de apoyo dirigida dentro de un curso —no como un reemplazo de los docentes, ni como una solución única para todos.

Qué significa esto para el aula del futuro

Para el público general, la conclusión es que los ayudantes de estudio con IA pueden hacer que las materias técnicas sean más accesibles y ofrecer a los estudiantes una forma de bajo estrés para preguntar a cualquier hora, pero no arreglan el aprendizaje por sí solos. En este estudio, los estudiantes de ingeniería trataron al Centro Educativo de IA como un compañero útil que podía desbloquear problemas y explicar ideas difíciles, sin dejar de apoyarse en los profesores y en los hábitos de estudio tradicionales. Sus mayores preocupaciones no giraban tanto en torno a la tecnología en sí, sino a las normas poco claras y al miedo a acusaciones de trampa. Los autores sostienen que si las universidades quieren que la IA mejore genuinamente la educación, deben combinar herramientas inteligentes y conscientes del curso con políticas claras y transparentes y con la orientación activa del profesorado, ayudando a los estudiantes no solo a aprender de la IA, sino también a usarla de forma responsable.

Cita: Sajja, R., Sermet, Y., Fodale, B. et al. Evaluating AI-powered learning assistants in engineering higher education with implications for student engagement, ethics, and policy. Sci Rep 16, 7565 (2026). https://doi.org/10.1038/s41598-026-39237-5

Palabras clave: IA en la educación, estudiantes de ingeniería, asistente de aprendizaje, integridad académica, participación estudiantil