Clear Sky Science · es

Modelos de lenguaje multimodales plantean un desafío al Image Challenge de NEJM

Por qué esto importa para pacientes y médicos

Obtener el diagnóstico correcto en el momento adecuado puede marcar la diferencia entre un tratamiento rápido y años de sufrimiento. Sin embargo, los médicos, incluso los muy formados, siguen pasando por alto o retrasando diagnósticos, sobre todo en enfermedades raras o atípicas. Este estudio plantea una pregunta contundente: cuando se introducen imágenes médicas y detalles clínicos en los sistemas de inteligencia artificial más avanzados de hoy, ¿pueden diagnosticar casos complejos mejor que un gran número de médicos reales—y, de ser así, qué implica eso para la atención médica futura?

Un gran rompecabezas construido a partir de casos del mundo real

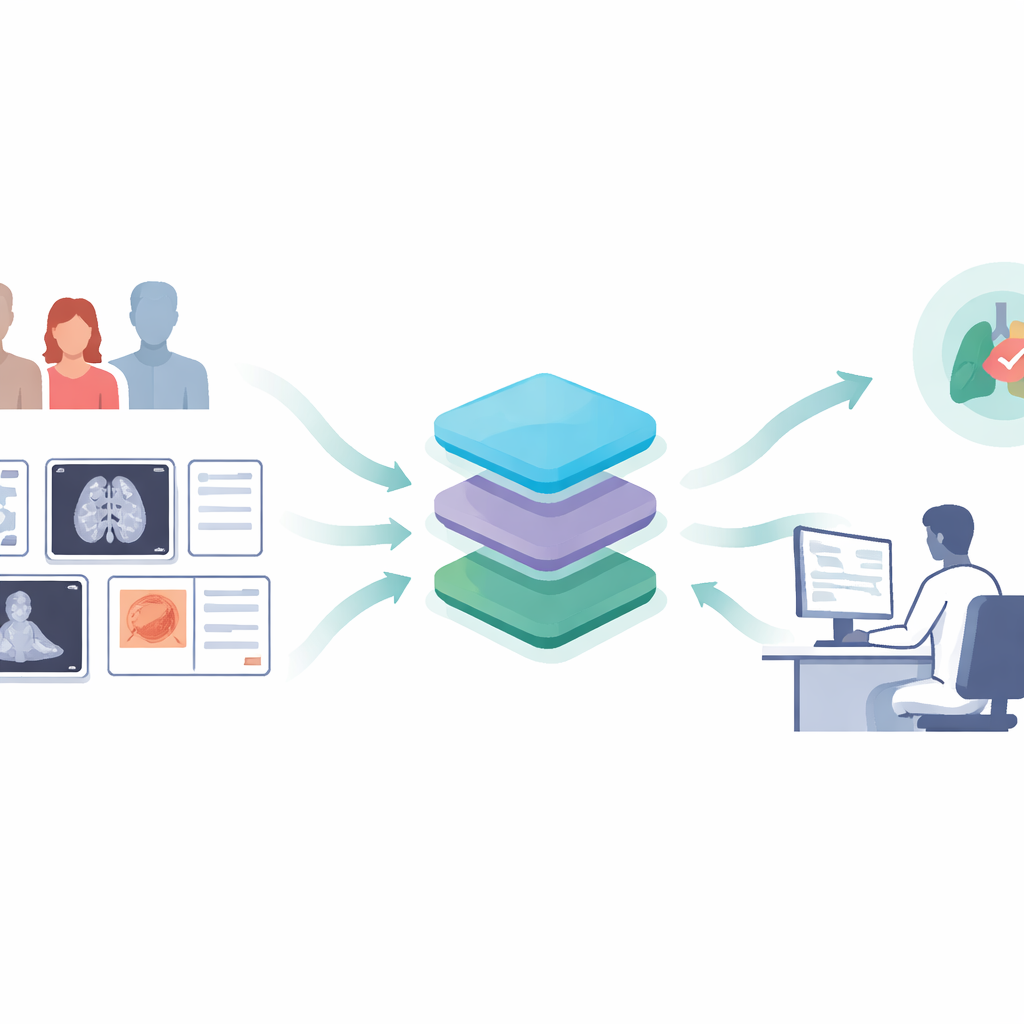

Los investigadores recurrieron a una sección de larga duración del New England Journal of Medicine llamada "Image Challenge". Cada reto presenta la imagen médica de un paciente real—como una fotografía de piel, una radiografía, una resonancia magnética o una preparación microscópica—junto con una breve historia clínica y cinco diagnósticos posibles. Desde 2009 se han acumulado más de 16 millones de respuestas de más de 60.000 médicos por caso, creando un registro global único de cómo rinden los médicos ante las mismas preguntas difíciles. A partir de este archivo, el equipo seleccionó 272 casos que abarcan todas las edades, ambos sexos y una amplia gama de afecciones, desde infecciones y trastornos inmunitarios hasta cánceres, enfermedades genéticas y lesiones.

Poniendo a la IA y a los médicos en el mismo terreno

El estudio evaluó tres modelos multimodales de gran tamaño líderes—sistemas capaces de ver imágenes y leer texto conjuntamente: GPT‑4o, Claude 3.7 y Doubao. Para cada caso, los modelos primero vieron solo la imagen y tuvieron que elegir una de las cinco opciones con una explicación. Luego vieron la imagen más la descripción clínica y respondieron de nuevo. Para mantener la prueba justa, los modelos se usaron en configuraciones estándar, con la búsqueda web y funciones de razonamiento adicionales desactivadas, y cada caso se ejecutó en una sesión nueva para evitar contaminación por respuestas previas. Dos médicos calificaron las respuestas de la IA frente a las soluciones oficiales del New England Journal, centrándose en si la elección final coincidía con el diagnóstico verdadero, tal como hace la referencia humana.

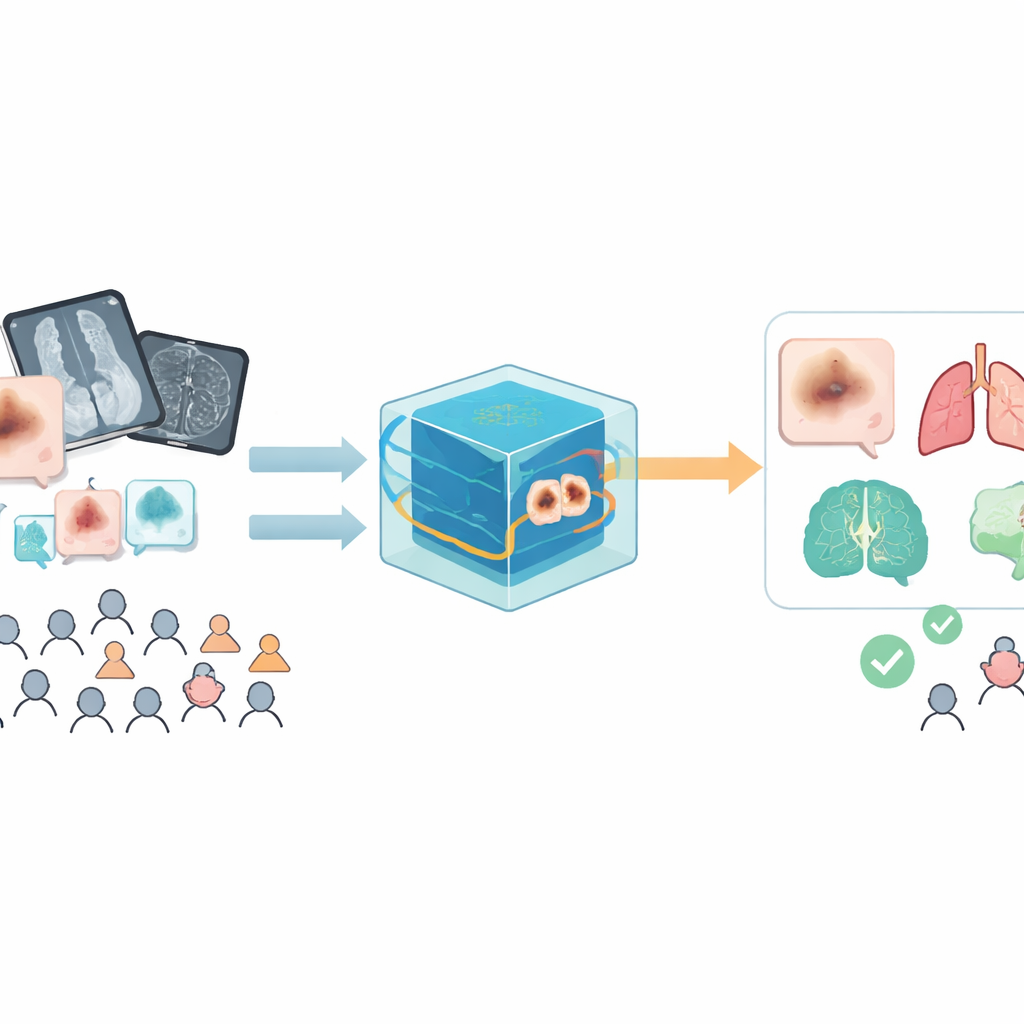

Rendimiento sobrehumano a través de enfermedades e imágenes

Cuando recibieron imagen y texto, los tres sistemas de IA superaron claramente al grupo global de médicos. Claude 3.7 y GPT‑4o alcanzaron cada uno alrededor del 89–90% de precisión, frente al 46,7% de la votación mayoritaria de los médicos—una brecha de más de 40 puntos porcentuales. Incluso en los casos más difíciles, donde menos del 40% de los médicos acertaron, Claude 3.7 siguió acertando el 86,5% de los diagnósticos. La ventaja se mantuvo en la mayoría de los tipos de enfermedad y formatos de imagen: los modelos fueron especialmente fuertes en afecciones relacionadas con fármacos y en condiciones genéticas, y manejaron no solo fotos y radiografías sino también conjuntos endoscópicos, patológicos y mixtos. El rendimiento fue igual de sólido para hombres y mujeres, y en algunos de los grupos más vulnerables, como lactantes menores de un año, los modelos fueron drásticamente más precisos que los médicos.

Mentes diferentes, no solo más rápidas

Quizá el hallazgo más sorprendente fue la frecuencia con la que los modelos acertaban cuando los médicos no lo hacían. En casi la mitad de los casos, Claude 3.7 fue correcto mientras la mayoría de médicos se equivocó, y lo inverso—médicos correctos, modelo equivocado—fue raro. En conjunto, para Claude 3.7 hubo aproximadamente quince casos con "ventaja del modelo" por cada uno con "ventaja del médico". Aun así, el acuerdo entre humanos y IA sobre qué respuesta elegir fue bajo, una señal de que los sistemas no están simplemente repitiendo patrones humanos sino que llegan a diagnósticos correctos por vías diferentes. La adición del texto clínico generalmente ayudó mucho, incrementando la precisión de la IA entre 28 y 42 puntos porcentuales respecto a la imagen sola. Aún así, en una fracción pequeña de casos, detalles adicionales hicieron que los modelos pasaran de una respuesta correcta basada en la imagen a una incorrecta, lo que apunta a nuevos tipos de sesgos y modos de fallo que necesitarán estudio cuidadoso.

Qué podría significar esto para la atención futura

Los autores concluyen que los modelos multimodales de gran tamaño han alcanzado un nivel "sobrehumano" en este exigente cuestionario diagnóstico: son más precisos que la multitud promedio de médicos y mantienen su ventaja incluso cuando los casos confunden a la mayoría de los clínicos. Al mismo tiempo, su baja superposición con las elecciones humanas sugiere que piensan de maneras complementarias en lugar de actuar como copias digitales de los clínicos. Usados con prudencia, estos sistemas podrían servir como potentes segundos lectores, ofreciendo opiniones independientes en casos difíciles o raros y ayudando a detectar problemas que los médicos humanos podrían pasar por alto. No están listos para reemplazar el juicio clínico, pero pronto podrían convertirse en socios valiosos junto al paciente y en la sala de lectura, revisando silenciosamente nuestro trabajo y ampliando la red de seguridad para los pacientes.

Cita: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Palabras clave: diagnóstico médico, inteligencia artificial, imágenes médicas, enfermedades raras, apoyo a la decisión clínica