Clear Sky Science · es

Un modelo híbrido ligero de CNN y transformer para la clasificación de enfermedades foliares medicinales con IA explicable

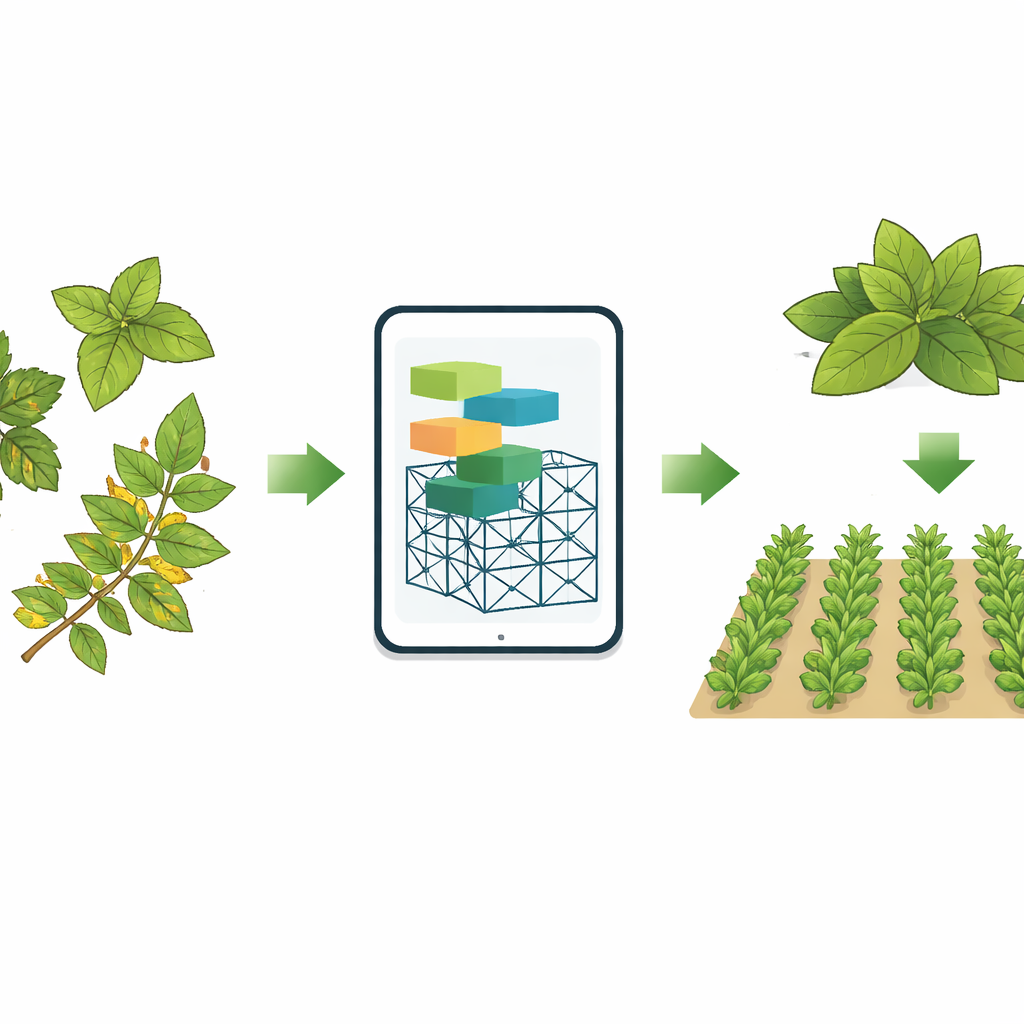

Por qué importa un cuidado vegetal más inteligente

Muchas de las hierbas utilizadas en remedios caseros y en fármacos modernos —como tulsi (albahaca santa), neem y patharkuchi— dependen de hojas sanas para producir sus compuestos terapéuticos. Cuando las enfermedades atacan estas hojas, las plantas pierden tanto rendimiento como potencia medicinal. El artículo presenta un sistema compacto de inteligencia artificial (IA) que puede detectar diferentes enfermedades foliares a partir de fotografías con una precisión notable. Diseñado para ejecutarse en dispositivos de bajo coste y para mostrar de forma clara qué «está observando», este enfoque podría ayudar a agricultores y jardineros a proteger en tiempo real plantas medicinales valiosas.

Amenazas ocultas en hojas conocidas

El estudio se centra en tres plantas medicinales de amplio uso: Kalanchoe pinnata (patharkuchi), Azadirachta indica (neem) y Ocimum tenuiflorum (tulsi). Estas plantas ofrecen beneficios antibacterianos, antiinflamatorios e incluso anticancerígenos, pero sus hojas son vulnerables a telas fúngicas, amarilleo por estrés y diversas enfermedades con manchas. El diagnóstico tradicional se basa en la observación experta en campo o en pruebas de laboratorio lentas y exigentes en equipo, lo que dificulta detectar problemas tempranos o abarcar áreas extensas. Dado que la salud vegetal afecta tanto a la salud pública como a las economías locales, existe una fuerte necesidad de herramientas automáticas, precisas y comprensibles que puedan señalar enfermedades con rapidez usando solo imágenes.

Construyendo un ojo inteligente para hojas enfermas

Para abordar este desafío, los autores crearon un nuevo modelo llamado LSeTNet, un híbrido ligero de dos ideas de IA populares para imágenes: redes convolucionales, adecuadas para detectar texturas finas y bordes, y capas transformer, que destacan en captar patrones de largo alcance en una imagen. El sistema aprendió primero a partir de un conjunto de imágenes cuidadosamente recopilado llamado MedicinalLeaf‑12, que contiene 12 clases que cubren versiones sanas y enfermas de las tres plantas. Las fotos se tomaron en condiciones reales de campo con iluminación, ángulos y fondos variados, y luego se limpiaron y mejoraron para que las manchas de enfermedad y las venas de las hojas destacaran con mayor claridad. El equipo también empleó amplia augmentación de imágenes —rotaciones, zoom, cambios de brillo y más— para imitar la variedad desordenada observada en las explotaciones reales mientras mantenían el conjunto de datos balanceado.

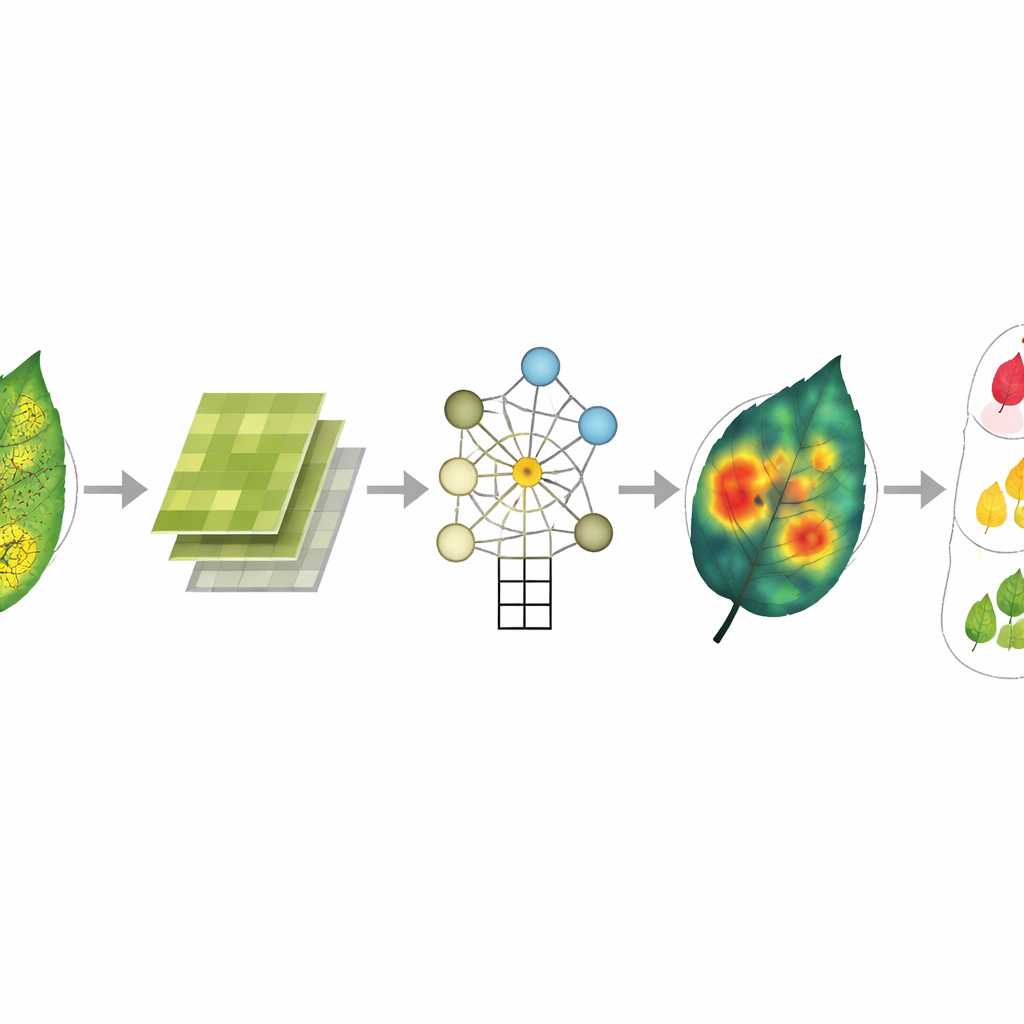

Cómo el modelo piensa sobre las hojas

LSeTNet procesa cada imagen foliar por etapas. Capas convolucionales ligeras captan pistas locales como pequeñas manchas, telas y la nitidez de los bordes foliares. Módulos especiales de «squeeze‑and‑excitation» reponderan estas pistas, amplificando silenciosamente los canales que portan señales relacionadas con la enfermedad y atenuando los dominados por el fondo. A continuación ocurre un bloque transformer, que conecta regiones distantes de la hoja para que el modelo pueda, por ejemplo, relacionar parches amarillos dispersos o patrones que siguen las venas. Finalmente, un clasificador compacto decide cuál de las 12 condiciones se ajusta mejor a cada imagen. A pesar de usar solo alrededor de 9,4 millones de parámetros y requerir potencia de cálculo modesta, el modelo mantiene alta velocidad y bajo uso de memoria, haciéndolo apto para teléfonos, tabletas o pequeños ordenadores de placa única.

Viendo dentro de la caja negra

Puesto que los agricultores y agrónomos deben confiar en cualquier diagnóstico automatizado, los autores incorporaron explicabilidad en su sistema. Utilizaron herramientas como Grad‑CAM y LIME para crear mapas de calor que muestran dónde el modelo «presta atención» en cada hoja, y diagramas t‑SNE para visualizar cómo se agrupan distintas enfermedades en el espacio de características interno del modelo. Estas explicaciones revelan que la IA se centra de forma consistente en lesiones, tejido descolorido y telas fúngicas en lugar de en el fondo neutro o los tallos. Incluso en las raras malas clasificaciones —solo cinco errores de 1.800 imágenes de prueba—, las regiones destacadas se mantienen en áreas biológicamente relevantes; la confusión surge principalmente cuando dos enfermedades se parecen mucho también al ojo humano.

Qué significan los resultados para los cultivadores

En el conjunto de datos principal, LSeTNet clasificó correctamente las imágenes de hojas con una precisión de aproximadamente 99,7%, y alcanzó un rendimiento igualmente alto al probarse en un conjunto de datos externo separado de plantas medicinales de Bangladés que no había visto antes. Al mismo tiempo, funciona con rapidez (alrededor de siete milésimas de segundo por imagen en una GPU) y tiene una huella de memoria pequeña, lo que abre la puerta a aplicaciones de campo de bajo coste. En términos prácticos, este trabajo muestra que la IA compacta y transparente puede detectar de forma fiable signos tempranos de enfermedad en plantas medicinales importantes y mostrar claramente a los usuarios por qué llegó a una determinada decisión. Con pruebas adicionales en más especies y condiciones de campo más duras, sistemas similares podrían ayudar a proteger las cadenas de suministro de la medicina herbal, apoyar la agricultura de precisión y ofrecer a pequeños agricultores una «segunda opinión» accesible en su bolsillo.

Cita: Ahmmed, J., Kabir, M.A., Rehman, A.u. et al. A lightweight hybrid CNN and transformer model for medicinal leaf disease classification with explainable AI. Sci Rep 16, 8243 (2026). https://doi.org/10.1038/s41598-026-39182-3

Palabras clave: plantas medicinales, detección de enfermedades foliares, aprendizaje profundo, IA explicable, agricultura de precisión