Clear Sky Science · es

RFGLNet para la segmentación semántica generalizada frente a condiciones meteorológicas adversas con mejora de baja clasificación en frecuencia

Ver la carretera cuando el tiempo se pone mal

Los coches autónomos y los robots repartidores prometen calles más seguras y eficientes, pero solo si pueden «ver» el mundo que les rodea con fiabilidad. La lluvia, la niebla, la nieve y las noches oscuras hacen que esa visión sea extremadamente difícil: reducen el contraste, añaden salpicaduras de ruido y difuminan los contornos de personas, vehículos y bordillos. Este artículo presenta RFGLNet, un nuevo sistema de visión por ordenador diseñado para mantener nítida la comprensión del entorno por parte de las máquinas incluso cuando el tiempo es pésimo.

Por qué el mal tiempo deja ciegas a las máquinas

Los sistemas actuales de conducción autónoma suelen apoyarse en un proceso llamado segmentación semántica, en el que un algoritmo asigna una clase —como carretera, coche, peatón o edificio— a cada píxel de la imagen. Con luz diurna clara, las redes neuronales modernas lo hacen extraordinariamente bien. Sin embargo, con lluvia intensa o niebla densa, las imágenes pierden brillo, ganan ruido y muestran límites difusos entre objetos. Recopilar y etiquetar enormes conjuntos de datos para cada condición meteorológica adversa es prohibitivamente caro, por lo que la mayoría de los sistemas se entrenan principalmente con imágenes normales y soleadas. Al enfrentarse a tormentas o nieve no vistas durante el entrenamiento, el rendimiento cae drásticamente. Soluciones anteriores intentaron limpiar primero las imágenes y luego segmentarlas, o adaptar modelos a condiciones objetivo específicas. Ambos enfoques tienden a ser frágiles, lentos o excesivamente dependientes de datos etiquetados en mal tiempo.

Una nueva red diseñada para condiciones difíciles

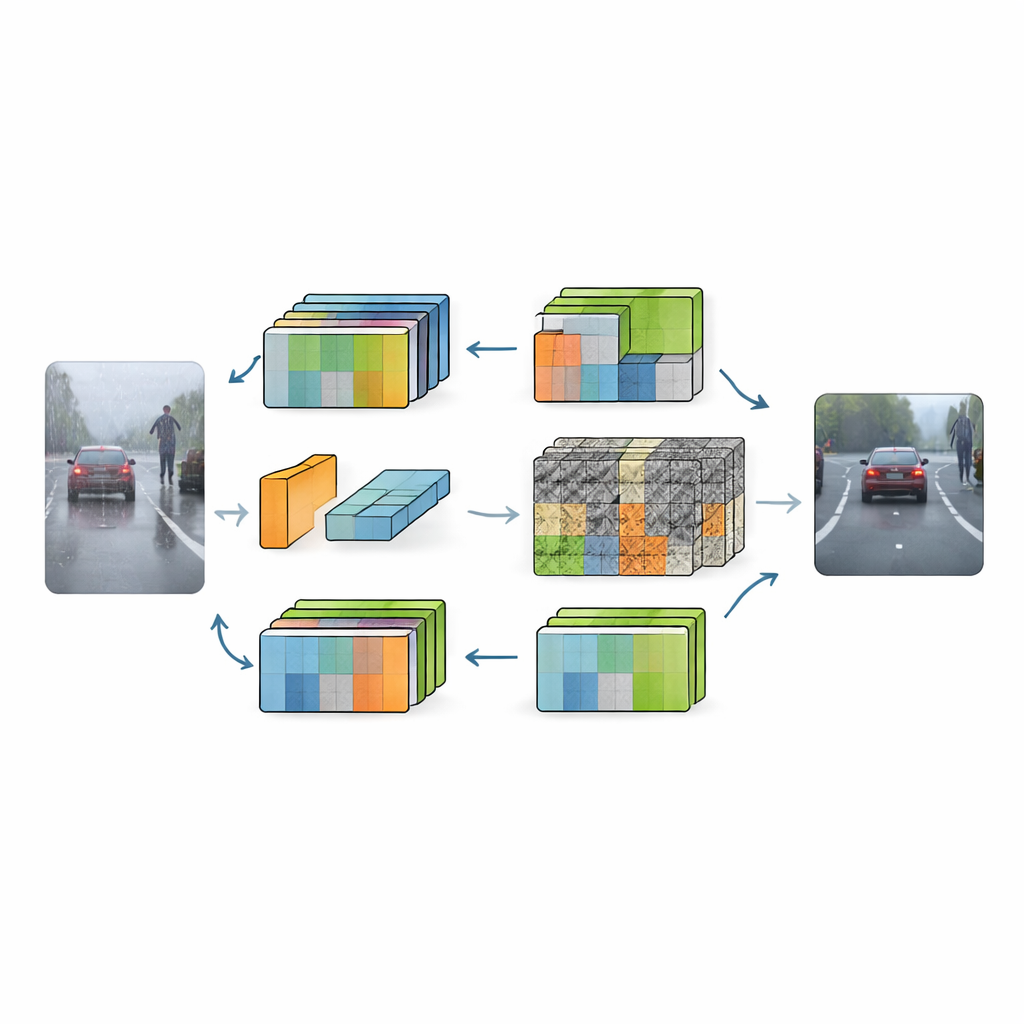

RFGLNet aborda este problema con una estrategia distinta: aprende únicamente a partir de escenas urbanas diurnas estándar y, aun así, se generaliza a una amplia gama de condiciones adversas. Los autores parten de DINOv2, un gran modelo visual preentrenado conocido por capturar una rica estructura de escena. En lugar de reentrenar este pesado backbone desde cero, congelan sus parámetros y añaden un conjunto ligero de módulos encima. Estos módulos actúan como adaptadores inteligentes que remodelan las representaciones internas del backbone para que se confundan menos por el desorden visual causado por copos de nieve, gotas de lluvia o la oscuridad. El resultado es un sistema que emplea solo 4,32 millones de parámetros entrenables —mínimo en comparación con modelos de visión típicos— y aun así aprende a manejar condiciones meteorológicas que nunca vio durante el entrenamiento.

Cómo la red aprende a filtrar el mal tiempo

La primera innovación de RFGLNet es un módulo de baja clasificación que se conecta en cada capa del backbone congelado. Antes del entrenamiento, este módulo ejecuta un procedimiento matemático conocido como descomposición en valores singulares sobre una matriz de características simulada. Esto le proporciona un conjunto de componentes compactos que coinciden, de forma aproximada, con la estructura de las características internas de DINOv2 desde el principio, en lugar de partir de ruido aleatorio. Durante el entrenamiento, estos componentes se ajustan, lo que permite al módulo corregir suavemente las características del backbone para la nueva tarea sin alterar su conocimiento central. A continuación, la red aplica un bloque de atención basado en Fourier que traslada las características al dominio de la frecuencia. Allí, las estructuras amplias y de variación lenta tienden a representar objetos significativos, mientras que los patrones agudos y erráticos suelen corresponder al ruido meteorológico. Al suprimir el desorden de alta frecuencia y amplificar los componentes más suaves, el sistema refuerza la comprensión global de la escena al tiempo que atenúa las interferencias.

Afinar los detalles sin distraerse

Incluso con características globales más limpias, los pequeños detalles —marcas de carril, travesaños de vallas y el contorno de un peatón a lo lejos— siguen siendo vulnerables al desenfoque en mal tiempo. Para abordarlo, los autores introducen un módulo de atención espacial agrupada en la parte del decodificador de la red. En lugar de tratar todos los canales de características conjuntamente, los divide en grupos y aprende mapas de pesos espaciales separados para cada grupo. Los canales que aportan estructura importante, como los bordes, pueden enfatizarse, mientras que los canales dominados por ruido se atenúan. Estos mapas específicos por grupo se fusionan en un ponderado espacial global que realza los detalles finos y agudiza los contornos de los objetos a múltiples resoluciones. En efecto, RFGLNet aprende dónde mirar con detalle y dónde ignorar las motas distractoras de niebla o lluvia.

Beneficio en el mundo real sobre escenas de carretera desafiantes

Para evaluar su enfoque, los investigadores entrenaron RFGLNet en el conocido conjunto de datos Cityscapes de escenas urbanas diurnas claras y luego lo evaluaron en el conjunto ACDC, centrado en conducción con lluvia, nieve, niebla y de noche. Sin ver nunca las etiquetas de ACDC durante el entrenamiento, RFGLNet alcanzó una intersección sobre unión media (mIoU) del 78,3 por ciento —superando a varios métodos líderes de generalización y adaptación de dominio, muchos de los cuales son más grandes y computacionalmente más exigentes. Fue especialmente eficaz segmentando clases difíciles como muros y vallas, cuyos bordes se pierden fácilmente en condiciones adversas. Al mismo tiempo, el modelo funcionó de manera eficiente en una GPU de grado consumidor, procesando decenas de imágenes por segundo, un requisito clave para sistemas de conducción en tiempo real.

Visión más clara para una autonomía más segura

Para el público no especializado, la conclusión es que RFGLNet muestra cómo actualizar backbones de visión existentes para una autonomía más segura sin necesidad de reentrenamientos interminables para cada posible tormenta. Al combinar ajuste compacto de baja clasificación, filtrado de ruido basado en frecuencia y atención espacial agrupada, el sistema aprende a conservar la estructura esencial de la escena mientras elimina el desorden asociado al clima. A medida que estos métodos maduren y se entrenen con colecciones más amplias de condiciones reales, podrían ayudar a que los coches y robots autónomos mantengan una conciencia situacional fiable cuando el cielo se oscurezca y la carretera por delante sea cualquier cosa menos clara.

Cita: Ye, X., Shi, X. & Li, Y. RFGLNet for adverse weather domain-generalized semantic segmentation with frequency low-rank enhancement. Sci Rep 16, 8253 (2026). https://doi.org/10.1038/s41598-026-39052-y

Palabras clave: conducción autónoma, percepción en condiciones meteorológicas adversas, segmentación semántica, robustez en visión por computador, generalización de dominio