Clear Sky Science · es

Efectos locales acumulados y redes neuronales de grafos para la predicción de enlaces

Por qué importa entender los enlaces ocultos

Muchos de los sistemas que moldean nuestras vidas —las redes sociales, las colaboraciones científicas, las redes cerebrales e incluso la propia web— pueden describirse como redes de puntos conectados. Una pregunta clave es qué nuevas conexiones es probable que se formen en el futuro, por ejemplo quién colaborará con quién o qué artículo citará a cuál. Las redes neuronales de grafos modernas son herramientas potentes para este tipo de “predicción de enlaces”, pero también son cajas negras: funcionan bien, pero es difícil ver por qué toman una decisión concreta. Este artículo aborda ese problema adaptando una técnica general de explicación para poder ver cómo cambiar una única propiedad de un nodo afecta las probabilidades de que aparezcan enlaces hacia él.

De puntuaciones simples a cerebros de grafos opacos

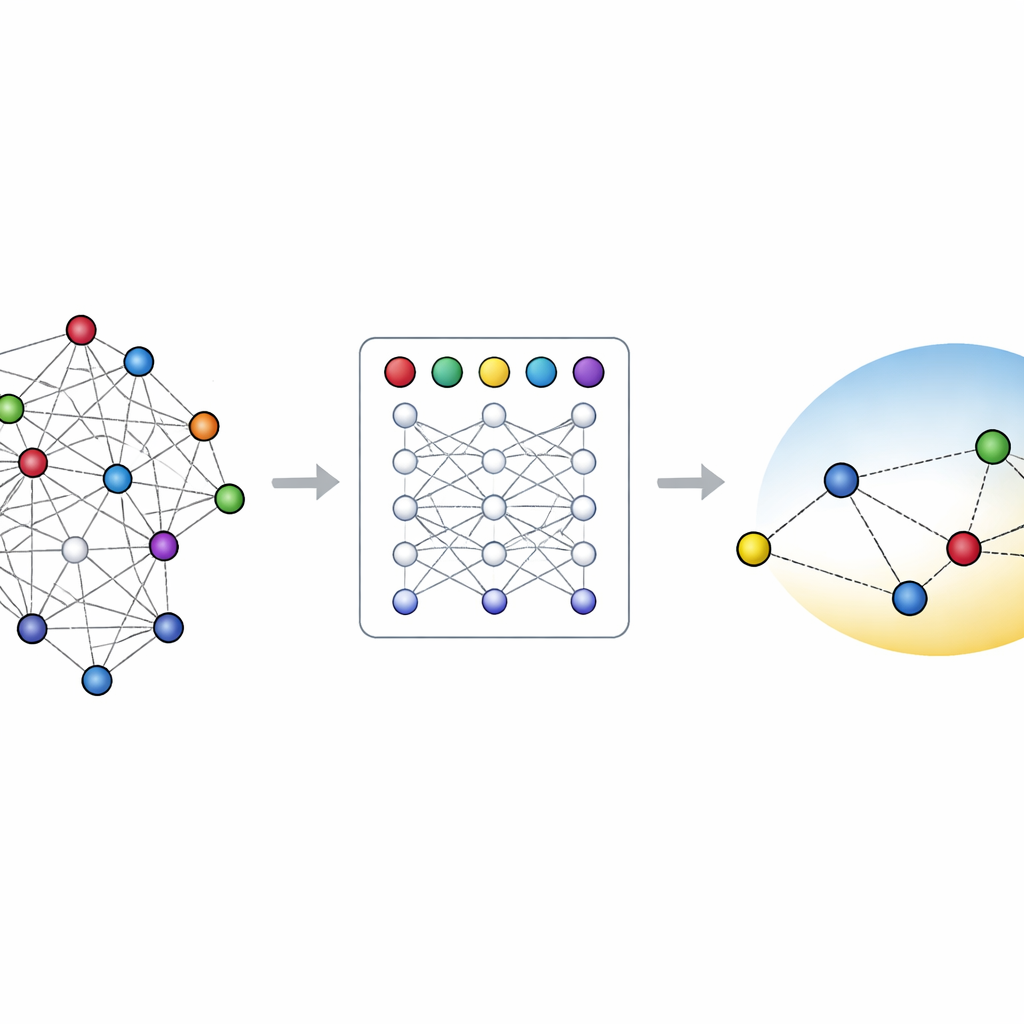

La ciencia de redes temprana se basaba en reglas sencillas para adivinar enlaces faltantes o futuros. Por ejemplo, dos personas con muchos amigos en común tienen más probabilidades de hacerse amigas, y las páginas web muy conectadas tienden a atraer aún más enlaces. En la última década, estas puntuaciones manuales han sido superadas por métodos que aprenden descripciones numéricas compactas, o incrustaciones, de cada nodo. Las redes neuronales de grafos van más allá: retransmiten mensajes repetidamente a lo largo de los enlaces para que la incrustación de cada nodo recoja información de sus vecinos y de los vecinos de sus vecinos. Esto las hace excelentes en la predicción de enlaces, pero también significa que sus mecanismos internos están enredados y son difíciles de interpretar.

Ver cómo una sola característica empuja las predicciones

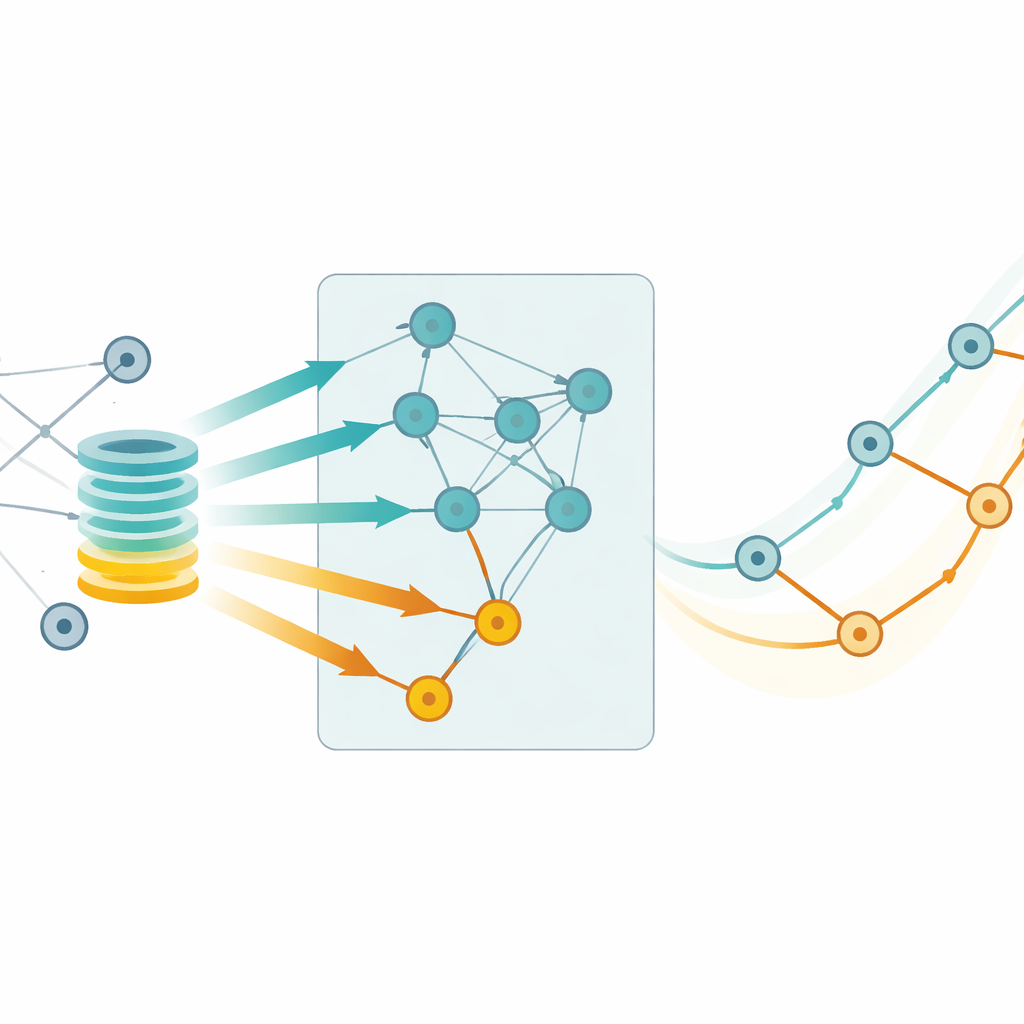

Fuera del mundo de los grafos, una forma popular de interpretar modelos de caja negra se llama Efectos Locales Acumulados (ALE). En lugar de limitarse a decir qué características son importantes, ALE pregunta cómo cambia la predicción del modelo cuando se desplaza una característica hacia arriba o hacia abajo a lo largo de sus valores posibles, y luego acumula esos cambios locales en una curva suave. Los autores adaptan ALE a la predicción de enlaces con redes neuronales de grafos alterando la característica de un nodo a la vez y comprobando cómo responde la probabilidad predicha de enlaces entre ese nodo y muchos otros. Esto produce una visualización que muestra, por ejemplo, cómo aumentar la proporción de autores de “Big Tech” en un artículo o cambiar la posición vertical de un segmento vascular en el cerebro modifica la probabilidad estimada por el modelo de que exista una conexión.

Dos formas de calcular efectos: exacta y rápida

Las redes neuronales de grafos añaden una complicación a ALE: cuando se cambian muchos nodos a la vez, pueden influirse mutuamente mediante el paso de mensajes, distorsionando potencialmente la explicación. Por ello, los autores comparan dos estrategias. En la versión “exacta”, la característica de cada nodo se modifica de forma aislada, de modo que no hay dos nodos alterados que se contaminen las incrustaciones entre sí—pero esto es computacionalmente caro. En la versión “aproximada”, se cambian muchos nodos al mismo tiempo, tratando los datos más como una tabla ordinaria e ignorando estas interacciones; esto es mucho más rápido pero puede introducir sesgo. Variando sistemáticamente cuántos nodos se modifican y contra cuántos posibles socios se prueban, los autores miden cómo estas elecciones afectan a las curvas ALE.

Pruebas en grafos sintéticos y datos reales

Para sondear la precisión, el equipo primero construye una red sintética donde se conoce la regla verdadera que gobierna la formación de enlaces: las aristas son más probables cuando una característica especial de “señal” es alta en ambos extremos. Aquí pueden comparar las curvas ALE directamente con la verdad de referencia. Encuentran que, a medida que se modifican más nodos a la vez, el método aproximado se desvía de la relación real, mientras que el método exacto se mantiene fiel. En grandes conjuntos de datos del mundo real —una red de citas de artículos sobre inteligencia artificial y un mapa 3D detallado de vasos sanguíneos en el cerebro de ratón— ya no pueden ver la regla verdadera, así que usan el método exacto, agregado a lo largo de muchas ejecuciones, como explicación de referencia y comprueban cuánto se aleja el método aproximado. Pruebas estadísticas y experimentos de permutación muestran que, en la mayoría de las combinaciones modelo–conjunto de datos, las diferencias entre los dos métodos son modestas, aunque las curvas aproximadas son más variables entre ejecuciones.

Lo que estos efectos revelan sobre el mundo

Más allá de la metodología, las curvas ALE ofrecen vislumbres de lo que los modelos realmente han aprendido. En la red de citas, indican que los artículos con una mayor fracción de autores afiliados a grandes empresas tecnológicas tienen, según el modelo, más probabilidad de recibir citas, lo que hace eco de las preocupaciones sobre la creciente influencia de la industria en la investigación en IA. En el grafo de vasos, dos arquitecturas diferentes de redes neuronales de grafos aprenden tendencias opuestas sobre cómo la altura de un vaso en el cerebro se relaciona con su conectividad, subrayando que ALE expone las creencias del modelo, no necesariamente la verdad biológica. Tales desajustes pueden señalar lugares donde la arquitectura del modelo, los datos de entrenamiento o la evaluación necesitan replantearse.

Conclusión para lectores y profesionales

El estudio muestra que los Efectos Locales Acumulados pueden reformularse para explicar las predicciones de enlaces en redes neuronales de grafos, ofreciendo curvas intuitivas que muestran cómo cambiar una característica de nodo aumenta o disminuye las probabilidades de enlace. Calcular estas curvas de forma exacta es más fiable pero más lento, mientras que una aproximación más rápida suele ser suficiente si se tolera algo de ruido adicional, especialmente al promediar muchas ejecuciones. Para quienes ya usan herramientas de explicación en modelos de aprendizaje automático estándar, esto aporta una vía visual y familiar para asomarse a sistemas complejos basados en grafos y cuestionar si lo que el modelo ha aprendido coincide realmente con nuestra comprensión de las redes que nos interesan.

Cita: Kaczyńska, P., Sienkiewicz, J. & Ślęzak, D. Accumulated local effects and graph neural networks for link prediction. Sci Rep 16, 8574 (2026). https://doi.org/10.1038/s41598-026-39000-w

Palabras clave: redes neuronales de grafos, predicción de enlaces, explicabilidad de modelos, efectos locales acumulados, ciencia de redes