Clear Sky Science · es

Optimización energética potenciada por DQN para redes de comunicación alimentadas inalámbricamente

Alimentando dispositivos diminutos por el aire

Desde farolas inteligentes hasta detectores de incendios ocultos en bosques, innumerables dispositivos diminutos forman hoy el Internet de las Cosas. Mantener a todos ellos con suministro energético es un quebradero de cabeza: las baterías se agotan y tender cables por doquier es impráctico. Este artículo explora una forma de transmitir energía inalámbrica a esos dispositivos y emplear inteligencia artificial para repartirla de manera inteligente, de modo que los sensores críticos permanezcan activos más tiempo y la red en su conjunto funcione con mayor fluidez.

Por qué la energía inalámbrica necesita control más inteligente

Las redes de comunicación alimentadas inalámbricamente emiten ondas de radio que los dispositivos pueden convertir en electricidad mientras las usan para transmitir datos. En la mayoría de estudios previos, esta conversión de energía se trataba como si fuera lineal y simple: más señal significaba proporcionalmente más potencia. En realidad, los circuitos de captura de energía empiezan a “aplanarse” cuando la señal entrante es fuerte, desperdiciando parte de la potencia. Al mismo tiempo, los entornos reales son desordenados: la luz solar para paneles fotovoltaicos puede oscilar, los edificios bloquean señales y eventos repentinos como incendios pueden generar demandas de datos urgentes en nodos concretos. Reglas estáticas que ignoran estas variaciones pueden dejar a algunos sensores sin energía y hacer que otros la desperdicien, acortando la vida útil de la red.

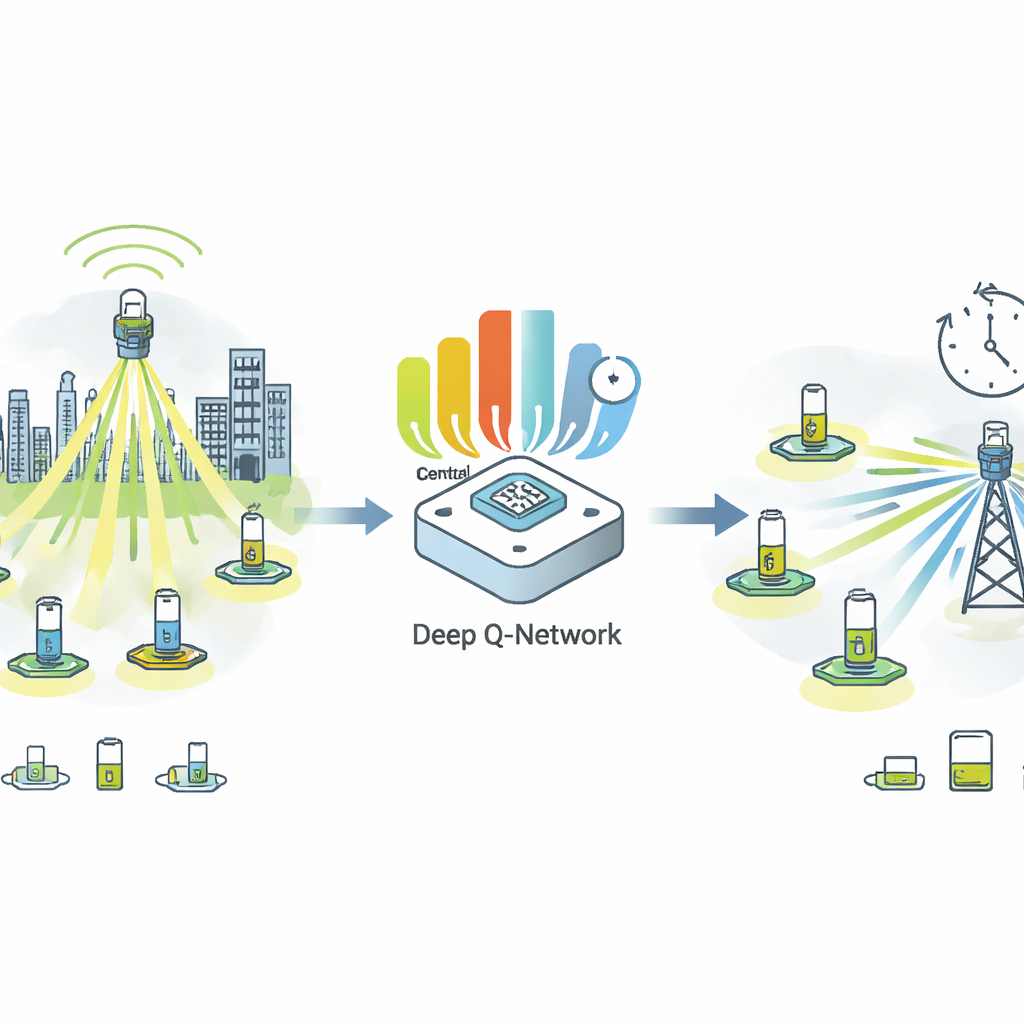

Un cerebro que aprende para la red de energía

Para abordar esto, los autores diseñan un controlador basado en aprendizaje construido sobre una técnica llamada Deep Q-Networks, una forma de aprendizaje por refuerzo. En lugar de depender de fórmulas matemáticas fijas, este controlador trata la red como un juego que se desarrolla en el tiempo. En cada ronda observa la energía restante en cada nodo, la calidad de los enlaces de radio y la urgencia de cada tarea—por ejemplo, monitorización de incendios frente a comprobaciones rutinarias de temperatura. Con base en estas observaciones decide cuánto potencia dirigir a cada nodo. Tras cada decisión recibe retroalimentación que combina varios objetivos: enviar la mayor cantidad posible de datos útiles, repartir la energía con equidad para que ningún dispositivo quede sistemáticamente desatendido y evitar el uso derrochador de la fuente compartida. A lo largo de muchas rondas, el controlador aprende qué patrones de reparto energético conducen al mejor rendimiento a largo plazo.

Anticipar y equilibrar objetivos en conflicto

Un ingrediente clave en el marco es la predicción. El sistema emplea un método estadístico llamado regresión por procesos gaussianos para pronosticar cuánto es probable que los nodos capturen energía en el corto plazo, por ejemplo conforme cambian las condiciones de luz solar. También utiliza un modelo flexible de cómo las señales de radio se atenúan y reflejan en entornos realistas de tipo urbano. Estos elementos alimentan un proceso de decisión que se actualiza cada pocos segundos, permitiendo que el controlador responda con rapidez cuando cambian las condiciones de la red. La señal de recompensa que guía el aprendizaje mezcla tres ideas sencillas: eficiencia (cuántos bits de información se entregan por unidad de energía), equidad (qué tan uniformemente se distribuye la energía entre los nodos) y prioridad (asegurar que las tareas de alta urgencia obtengan lo que necesitan). Al ajustar la importancia relativa de estos tres componentes, los operadores de la red pueden optar entre maximizar la vida útil, imponer equidad estricta o priorizar tasas de datos máximas.

Qué revelan las simulaciones

Dado que los experimentos en el mundo real aún están en progreso, los autores evalúan su método en simulaciones por ordenador detalladas de una red con 30 dispositivos alimentados inalámbricamente y también exploran escenarios de hasta 100 nodos. En comparación con una simple división fija de energía y con un método de aprendizaje más tradicional, el nuevo controlador mantiene la red funcionando mucho más tiempo: aproximadamente la mitad más de rondas antes de que los nodos se apaguen. También mantiene la dispersión de los niveles de energía entre dispositivos mucho más ajustada, lo que significa muchos menos “puntos muertos” donde los nodos fallan pronto. La estrategia aprendida se adapta varias veces más rápido a cambios repentinos, como una caída en la calidad de la señal o un aumento en la urgencia de las tareas, y mantiene un mayor rendimiento de datos en una amplia gama de condiciones de radio. Es importante que los autores prestan atención a detalles prácticos, mostrando que una versión compacta del modelo de aprendizaje puede ejecutarse en microcontroladores de bajo coste usados en muchos dispositivos IoT, con tiempos de decisión del orden de decenas de milisegundos.

De la simulación a redes reales de sensores

El estudio concluye que emparejar energía inalámbrica con un controlador basado en aprendizaje puede extender significativamente la vida y la fiabilidad de las redes de sensores, especialmente cuando las condiciones son impredecibles y las tareas varían en urgencia. Al reconocer que los circuitos de captura se saturan, que el entorno radioeléctrico fluctúa y que algunos sensores importan más que otros en cada momento, el enfoque propuesto aprende a equilibrar mejor las necesidades en conflicto que las reglas estáticas. Los autores son claros en que sus resultados hasta ahora provienen de simulaciones y que las ganancias exactas deberán confirmarse en hardware real. Aun así, su trabajo apunta hacia un futuro en el que vastas redes de pequeños dispositivos puedan funcionar durante largos periodos con mínima intervención humana, bebiendo energía del aire de forma inteligente mientras mantienen fluido el envío de datos vitales.

Cita: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

Palabras clave: energía inalámbrica, Internet de las cosas, captación de energía, aprendizaje por refuerzo, redes de sensores