Clear Sky Science · es

VolE: Un marco basado en nubes de puntos para la reconstrucción 3D de alimentos y la estimación de volumen

Por qué medir tu cena importa

Contar calorías a partir de una foto suena a magia, pero para médicos y dietistas podría ser una herramienta poderosa. Conocer con precisión cuánto come la gente es vital para controlar enfermedades como la diabetes y la obesidad, sin embargo pesar cada comida en una balanza de cocina no es realista en la vida diaria. Este artículo presenta VolE, un nuevo método que permite a un smartphone moderno ordinario construir un modelo tridimensional detallado de un único alimento y estimar su volumen con sorprendente exactitud: no se requiere hardware especial, tarjeta de referencia ni sensor de profundidad.

De fotos simples a formas sólidas

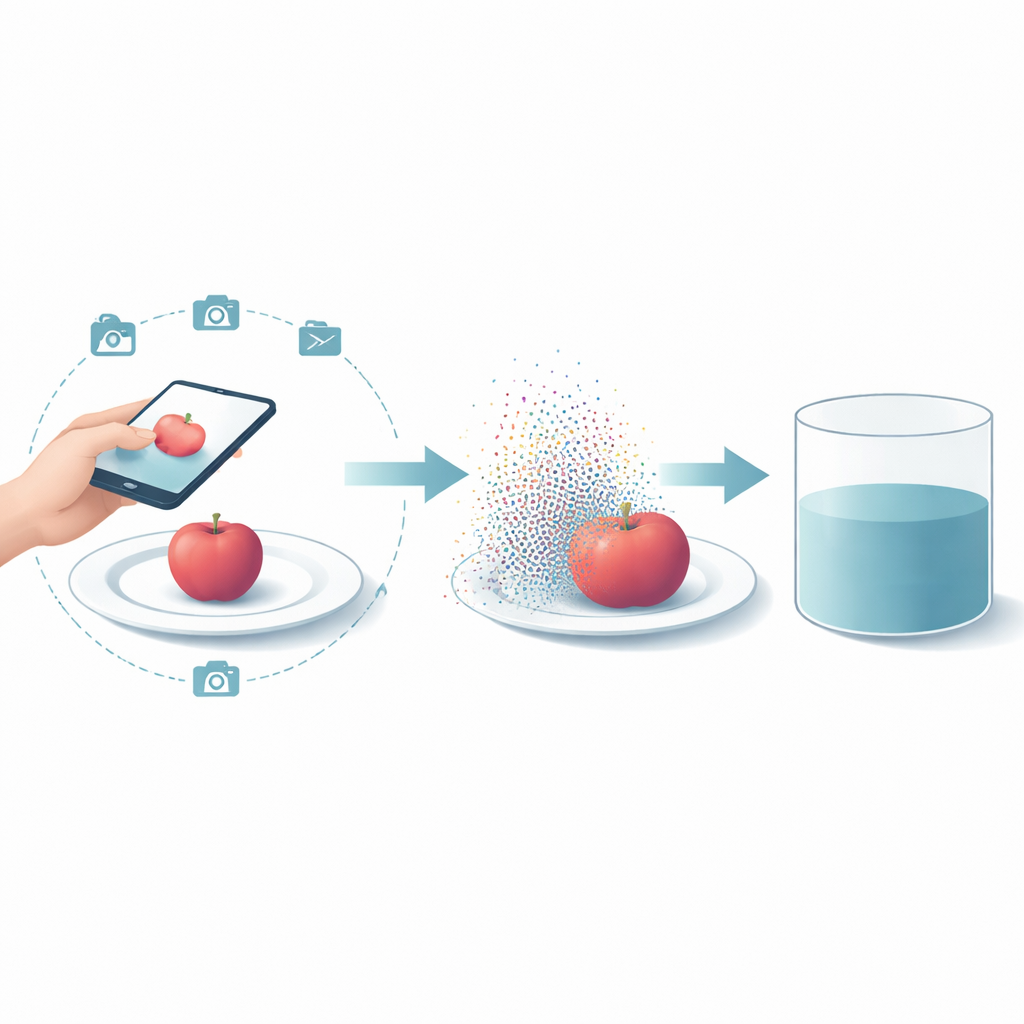

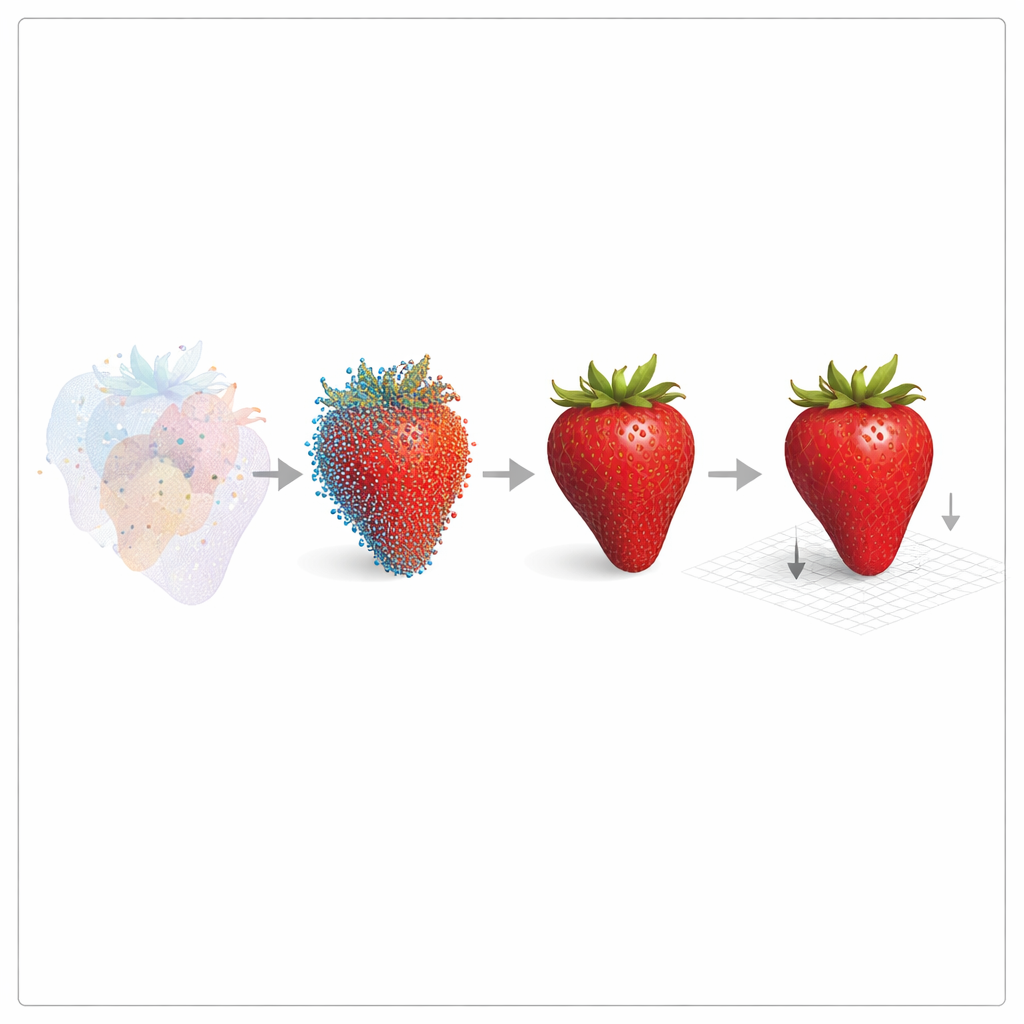

La idea central de VolE es convertir un breve video casual tomado con el teléfono de tu comida en una forma 3D precisa que pueda medirse. Mientras el usuario mueve el teléfono lentamente alrededor del plato, las funciones de realidad aumentada integradas en el dispositivo (ARCore en Android o ARKit en iOS) registran tanto las imágenes como la posición y orientación exactas de la cámara en el espacio real. VolE combina estas secuencias de imágenes y las trayectorias de la cámara para reconstruir una “nube de puntos” densa del alimento: miles de pequeños puntos suspendidos en el espacio que trazan la superficie del objeto. Dado que el sistema de RA del teléfono ya conoce las distancias del mundo real, este objeto virtual se crea a la escala física correcta, resolviendo un problema antiguo en la investigación de visión donde se puede recuperar la forma 3D pero no su tamaño verdadero.

Localizar el alimento y limpiar la escena

Las fotos de comida están recargadas: platos, mesas y desorden de fondo compiten por la atención. VolE aborda esto con un paso automático de segmentación de video que actúa como unas tijeras inteligentes. Un modelo llamado FoodMem identifica qué píxeles pertenecen al alimento a lo largo de todos los fotogramas del video, incluso a medida que el teléfono se mueve y el alimento queda parcialmente oculto. Usando las posiciones de cámara refinadas, VolE proyecta los puntos 3D en cada imagen segmentada y conserva solo aquellos que caen de forma consistente sobre el alimento en cada vista. El resultado es una nube de puntos limpia e aislada que pertenece únicamente al ítem objetivo, mientras que la mayoría de los puntos de fondo y los errores de segmentación se filtran.

De puntos a un objeto medible

Las nubes de puntos por sí solas son difíciles de medir, por lo que VolE las convierte en una superficie digital continua llamada malla. Software 3D especializado une puntos vecinos formando pequeños triángulos que envuelven el alimento como una piel ajustada, rellenando pequeñas lagunas y haciendo que el objeto sea “estanco”. La malla se refina mediante pasos de suavizado, eliminación de ruido y optimización que quitan protuberancias y huecos sin cambiar el tamaño verdadero de forma significativa. Finalmente, se emplea un truco matemático conocido como el teorema de la divergencia: la superficie se descompone en muchas piezas pequeñas, cada una tratada como una pequeña pirámide anclada en el origen. Sumar los volúmenes firmados de todas estas piezas produce el volumen total del alimento en centímetros cúbicos, listo para convertirse en peso y calorías mediante tablas de densidad estándar.

Pruebas con alimentos reales y benchmarks exigentes

Para medir qué tan bien funciona VolE, los autores crearon un nuevo conjunto de datos “Foodkit” con 21 alimentos reales—desde manzanas y plátanos hasta wraps y bollería—capturados con 700–1200 imágenes cada uno. Midieron el volumen verdadero usando desplazamiento de agua y la masa con una balanza de laboratorio, y luego compararon esos valores con las estimaciones de VolE. En todos los ítems, el error medio de volumen fue de aproximadamente 1–2%, lo que corresponde a cerca del 99% de precisión, y se mantuvo estable en ejecuciones repetidas a pesar del componente aleatorio interno del software de reconstrucción. VolE también se evaluó en conjuntos de datos públicos desafiantes usados en competiciones internacionales, superando o igualando a los mejores métodos existentes para la estimación de volumen de alimentos mientras no requiere tableros de calibración, sensores de profundidad ni rigs de cámara fijos.

Qué implica esto para la salud cotidiana

En términos sencillos, este trabajo muestra que un teléfono que ya posees puede, con los algoritmos adecuados, medir tu comida casi tan bien como equipo de laboratorio. Al convertir videos casuales en modelos 3D precisos, VolE elimina la necesidad de básculas, escáneres especializados o fotos cuidadosamente preparadas con objetos de referencia. Aunque actualmente funciona mejor para un único elemento principal en un plato y todavía se ejecuta en un ordenador potente en lugar de directamente en el teléfono, el método apunta hacia un futuro cercano en el que las aplicaciones de control dietético puedan estimar automáticamente y de forma fiable el tamaño de las porciones. Eso podría hacer el seguimiento nutricional a largo plazo más objetivo, menos oneroso y mucho más accesible para las personas que gestionan su salud en situaciones cotidianas.

Cita: Haroon, U., AlMughrabi, A., Zoumpekas, T. et al. VolE: A point-cloud framework for food 3D reconstruction and volume estimation. Sci Rep 16, 8648 (2026). https://doi.org/10.1038/s41598-026-38756-5

Palabras clave: estimación del volumen de alimentos, reconstrucción 3D, salud móvil, realidad aumentada, evaluación dietética