Clear Sky Science · es

MM-GradCAM: un método multimodal GradCAM mejorado con datos de ECG 1D y 2D para la detección de arritmias cardíacas

Por qué este estudio del corazón importa para usted

Los latidos irregulares, conocidos como arritmias, pueden provocar desmayos, accidentes cerebrovasculares o muerte súbita, y a menudo no muestran señales de advertencia hasta que es demasiado tarde. Los médicos dependen de los electrocardiogramas (ECG)—esas líneas puntiagudas que registran la actividad cardíaca—para detectar problemas. En los últimos años, los programas informáticos han mejorado mucho en la interpretación de estos trazados, a veces alcanzando el nivel de especialistas. Pero por lo general funcionan como una caja cerrada: dan una respuesta sin mostrar cómo llegaron a ella. Este estudio introduce una nueva forma de hacer estas herramientas potentes más transparentes, ayudando a los médicos a ver exactamente qué partes del ECG de un paciente guiaron la decisión del ordenador.

Mirando dentro de la caja negra

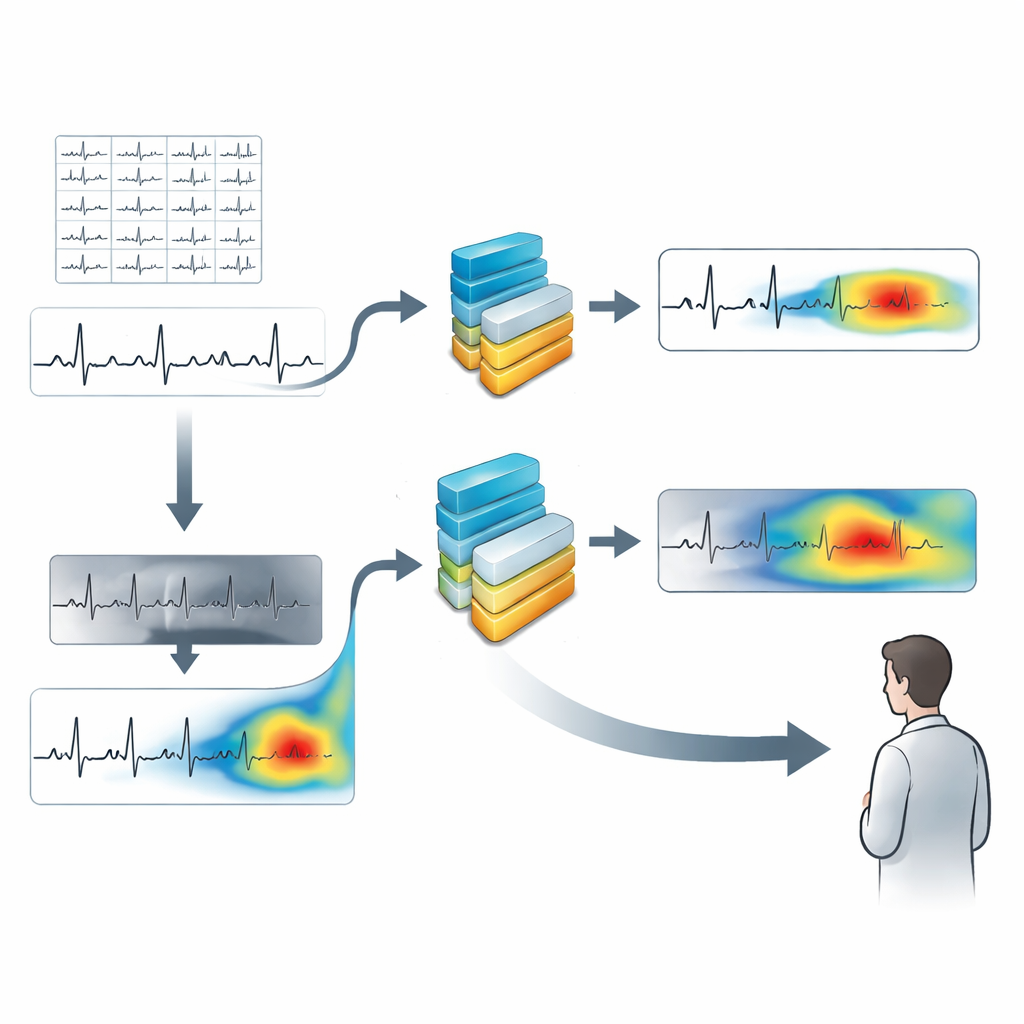

Muchos sistemas modernos de IA médica usan aprendizaje profundo, una técnica que descubre automáticamente patrones en los datos en lugar de apoyarse en reglas diseñadas a mano. Aunque esto suele mejorar la precisión, también oculta el proceso de razonamiento, lo cual es una preocupación seria cuando están en juego vidas humanas. Para generar confianza, los investigadores han recurrido a métodos de “IA explicable” que resaltan las regiones de una imagen o señal que más influyeron en el juicio del modelo. Una de las herramientas más utilizadas para esto se llama Grad-CAM, que crea mapas de calor—superposiciones de color que muestran dónde prestaba atención el algoritmo. Hasta ahora, sin embargo, estas explicaciones normalmente se limitaban a un solo tipo de entrada, como la señal cruda del ECG o una imagen, pero no a ambas simultáneamente.

Dos vistas del mismo latido

En este trabajo, los autores se centraron en un único canal de ECG de uso común, denominado Derivación II, extraído de una gran base de datos pública de más de 10 000 pacientes. Cada registro de 10 segundos se trató de dos maneras distintas. Primero, se conservó en su forma unidimensional original, una simple línea que traza el voltaje en el tiempo. Segundo, se convirtió en una imagen en escala de grises—esencialmente una tira de ECG trazada y guardada como imagen. Para cada forma, el equipo construyó un modelo de aprendizaje profundo correspondiente basado en una red neuronal convolucional de 17 capas, una arquitectura popular para el reconocimiento de patrones. Una red aprendió de la señal 1D, la otra de la imagen 2D, y ambas fueron entrenadas para clasificar los latidos en cuatro grupos rítmicos: ritmo normal, ritmo lento, un grupo de ritmos rápidos y ritmos relacionados con fibrilación auricular.

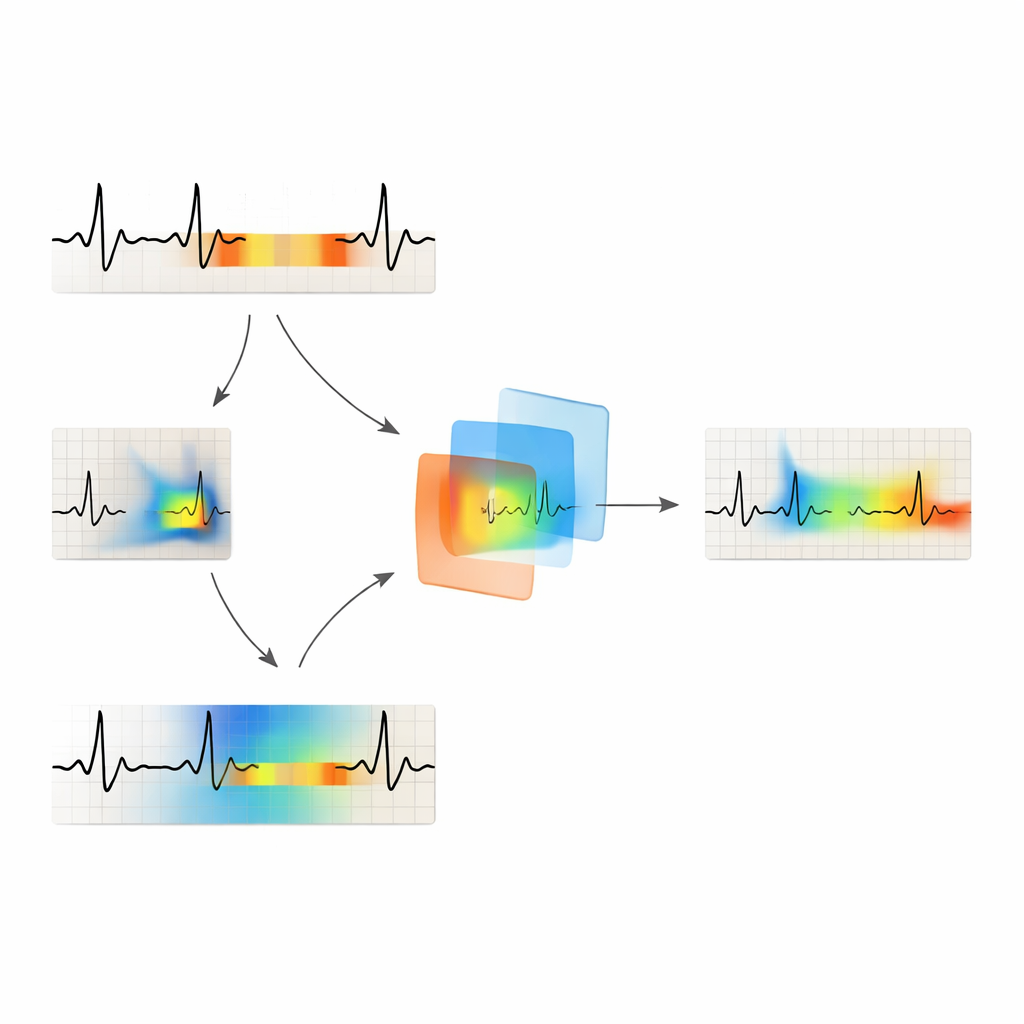

Combinando dos explicaciones en una

Tras el entrenamiento, los investigadores aplicaron Grad-CAM por separado a los modelos basados en señal y en imagen. Para el modelo 1D, produjeron segmentos coloreados sobre la línea del ECG donde la red se concentraba más. Para el modelo de imagen, generaron mapas de calor que destacaban puntos calientes en la imagen del ECG. El nuevo método, llamado MM-GradCAM (Grad-CAM multimodal), alineó entonces estas dos vistas en tiempo y espacio y las fusionó en una única explicación. Este mapa unificado muestra, en una tira de ECG combinada, tanto las pistas de la serie temporal como los patrones basados en la imagen que impulsaron la decisión de la IA. Un cardiólogo revisó numerosos ejemplos, comparando las regiones resaltadas con características conocidas de distintos ritmos, como la ausencia de ondas P en la fibrilación auricular o latidos muy rápidos y regulares en ciertos ritmos acelerados.

Qué tan bien interpreta el sistema el latido

En pacientes de prueba no vistos anteriormente, el modelo basado en imagen clasificó correctamente los ritmos en torno al 97% de las veces, mientras que el modelo basado en la señal alcanzó aproximadamente un 93% de precisión. El rendimiento varió según el tipo de ritmo, siendo el modelo de imagen generalmente superior, especialmente para patrones más complejos o sutiles. Al mismo tiempo, los mapas fusionados de MM-GradCAM mostraron que cada vista aporta algo distinto. En algunos pacientes con fibrilación auricular, la explicación basada en la señal pasó por alto regiones clave, mientras que el mapa basado en imagen se centró correctamente en tramos donde faltaban las formas de onda normales. En otros casos, como ciertos ritmos rápidos, el mapa de la señal ofreció una imagen más clara y clínicamente sensata. Al presentar ambas vistas juntas, MM-GradCAM puso de manifiesto fortalezas y debilidades que serían invisibles si solo se usara una forma de entrada.

Lo que esto significa para la atención cardiaca futura

El mensaje principal del estudio no es solo que un ordenador puede detectar ritmos cardíacos anormales con precisión—muchos sistemas ya pueden hacerlo—sino que su razonamiento ahora puede hacerse más comprensible para los expertos humanos. Al combinar explicaciones basadas en señal e imagen en una vista coherente, MM-GradCAM ofrece a los cardiólogos una forma de comprobar si la IA está “mirando” las partes del ECG que son médicamente relevantes. Esto puede mejorar la confianza, ayudar a detectar errores e incluso servir como herramienta docente para quienes se forman en la lectura de ritmos complejos. Aunque el método aún debe probarse en grupos de pacientes más diversos y en flujos de trabajo clínicos reales, apunta hacia un futuro en el que las herramientas de IA potentes no solo proporcionen respuestas, sino que también muestren claramente su razonamiento.

Cita: Murat Duranay, F., Murat, E., Yıldırım, Ö. et al. MM-GradCAM: an improved multimodal GradCAM method with 1D and 2D ECG data for detection of cardiac arrhythmia. Sci Rep 16, 7919 (2026). https://doi.org/10.1038/s41598-026-38654-w

Palabras clave: arritmia cardíaca, electrocardiograma, aprendizaje profundo, IA explicable, Grad-CAM