Clear Sky Science · es

Predicción de cargas de trabajo basada en atención y asignación dinámica de recursos para entornos de computación heterogéneos

Por qué unos ordenadores más inteligentes importan para todos

Detrás de cada película que transmites, mapa que consultas o asistente de IA con el que hablas, enormes naves repletas de ordenadores trabajan silenciosamente las 24 horas. A medida que la inteligencia artificial se vuelve más potente, estos centros de datos son llevados al límite: deben gestionar muchos tipos de tareas en muchos tipos de máquinas al mismo tiempo que mantienen bajo control los costes, la latencia y el consumo energético. Este artículo presenta una nueva forma de predecir qué necesitarán esos ordenadores en un futuro inmediato y de redistribuir el trabajo entre distintos tipos de hardware para que los servicios sigan siendo rápidos y fiables mientras se desperdicia menos electricidad.

Muchas tareas, muchas máquinas

Los centros de datos modernos ya no dependen de un único tipo de servidor. En su lugar, combinan procesadores tradicionales con potentes unidades gráficas, tarjetas específicas para IA y circuitos reprogramables. Diferentes tareas de IA —como entrenar un gran modelo de lenguaje, ofrecer recomendaciones en tiempo real o analizar imágenes— encajan en estas máquinas de maneras muy distintas. Hoy en día, los operadores suelen asignar recursos usando reglas fijas o predicciones sencillas basadas en el uso de ayer. Cuando la demanda se dispara de forma inesperada, esto puede causar respuestas lentas o incumplimientos de acuerdos de servicio; cuando la demanda cae, el hardware caro puede permanecer ocioso, consumiendo energía pero realizando poco trabajo.

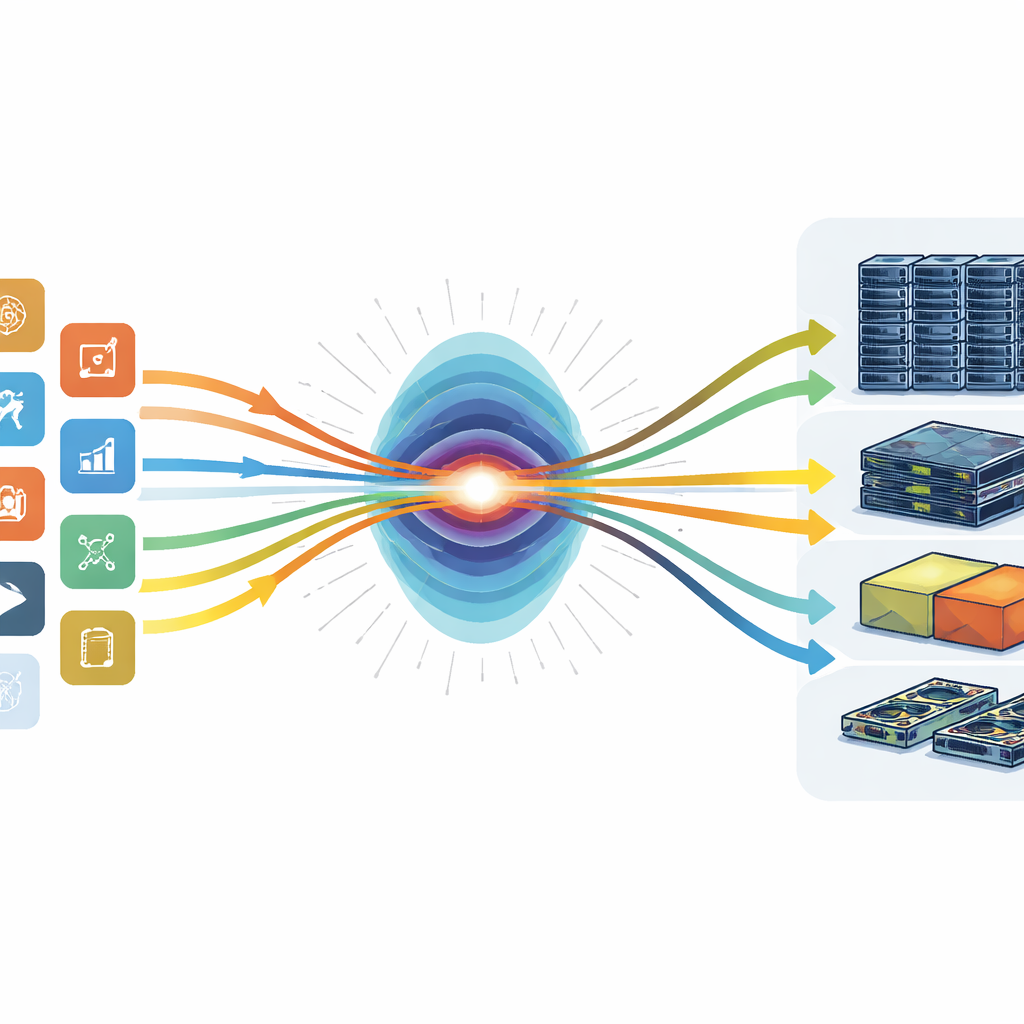

Aprender a mirar donde importa

Los autores toman un concepto de los modelos de IA más avanzados llamado «atención» y lo aplican a la gestión de centros de datos. En lugar de tratar todos los datos de uso pasado por igual, su sistema aprende qué momentos en el tiempo y qué tipos de tareas son más útiles para inferir lo que ocurrirá a continuación. Una parte del modelo se centra en cómo cambia cada carga de trabajo —como un trabajo de entrenamiento o un servicio en línea— a lo largo del tiempo. Otra parte observa de forma horizontal las distintas cargas que se ejecutan al mismo tiempo para descubrir conexiones ocultas, como un patrón en el que terminar un lote de trabajos de entrenamiento suele provocar un aumento de consultas en servicios relacionados. Al superponer estas dos perspectivas, el sistema puede prever con mayor precisión las demandas futuras de procesadores, memoria y aceleradores que los métodos anteriores.

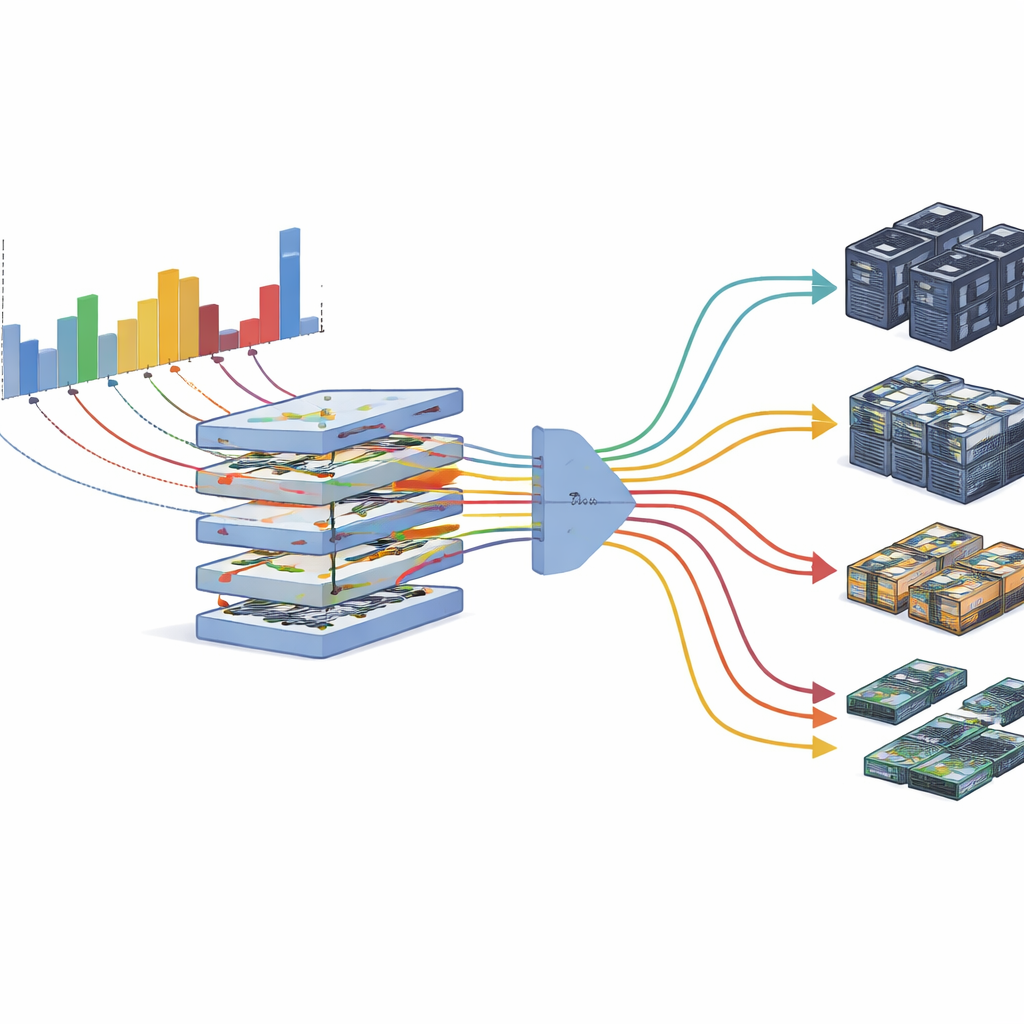

Convertir predicciones en mejores decisiones

La predicción por sí sola no basta; el centro de datos debe actuar en consecuencia. La segunda mitad del marco convierte estas previsiones en decisiones concretas sobre dónde ejecutar cada trabajo. Los autores tratan esto como un acto de equilibrio entre tres objetivos: terminar los trabajos rápidamente, usar la menor energía posible y mantener las máquinas ocupadas en lugar de inactivas. Su planificador representa el centro de datos como una red de distintos dispositivos y emplea un procedimiento de optimización para elegir ubicaciones que compensen estos objetivos según las preferencias del operador. Dado que las predicciones nunca son perfectas, el sistema también estima su propia incertidumbre y deja márgenes de seguridad cuando es necesario, para luego monitorizar la realidad en tiempo real y ajustarse pausando trabajos de baja prioridad o migrando tareas cuando el uso se desvía de lo esperado.

Poner el sistema a prueba

Para ver cómo funciona este enfoque en la práctica, los investigadores construyeron un clúster de prueba con una mezcla realista de procesadores, GPUs y hardware de IA especializado, y le alimentaron registros de actividad detallados procedentes de centros de datos reales de Google, Alibaba y un laboratorio académico. Compararon su método con herramientas de previsión y estrategias de planificación populares, incluidas técnicas usadas en sistemas de producción y controladores basados en aprendizaje por refuerzo. El predictor basado en atención realizó con consistencia predicciones más precisas, especialmente para los picos bruscos que suelen producirse en cargas de trabajo de IA. Cuando se combinó con su asignador dinámico, el sistema aumentó el uso global del hardware hasta aproximadamente cuatro quintas partes de la capacidad, redujo el tiempo medio de finalización de trabajos en cerca de una cuarta parte y disminuyó el consumo energético en alrededor de un 15 por ciento, todo ello manteniendo las violaciones de servicio en un nivel muy bajo.

Qué significa esto para los usuarios de a pie

Para los no especialistas, la conclusión principal es que una coordinación más inteligente dentro de los centros de datos puede hacer que los servicios de IA sean más rápidos, baratos y ecológicos sin requerir nuevos chips o edificios. Al aprender dónde «prestar atención» en la avalancha de datos de uso, este marco ayuda al hardware existente a hacer más trabajo útil y a permanecer inactivo con menos frecuencia. Eso significa que las empresas pueden ofrecer aplicaciones más rápidas y herramientas de IA más potentes mientras contienen las facturas de electricidad y la huella de carbono. A medida que sistemas similares de predicción y asignación se difundan y maduren, la maquinaria invisible de internet puede volverse no solo más capaz, sino también más sostenible.

Cita: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Palabras clave: planificación de centros de datos, predicción de cargas de trabajo de IA, computación heterogénea, computación con eficiencia energética, asignación de recursos