Clear Sky Science · es

Auditoría de privacidad más ajustada del descenso por gradiente estocástico con privacidad diferencial en el modelo de amenaza de estado oculto

Por qué importa para la tecnología cotidiana

Las aplicaciones modernas aprenden constantemente de nuestros datos, desde fotos y mensajes hasta registros médicos. Uno de los métodos principales para mantener segura esta formación es la privacidad diferencial, que añade ruido cuidadosamente calibrado para que los datos de una sola persona no destaquen. Pero, ¿cómo sabemos que estas protecciones funcionan realmente en la práctica, especialmente para las redes neuronales profundas usadas hoy en día? Este artículo investiga esa cuestión y muestra cuándo ocultar la «película de entrenamiento» de un modelo realmente ayuda a la privacidad y cuándo no.

Cómo debería funcionar el aprendizaje privado

El descenso por gradiente estocástico con privacidad diferencial (DP-SGD) es el algoritmo fundamental para el aprendizaje automático que preserva la privacidad. Entrena modelos paso a paso sobre pequeños lotes de datos, recortando el gradiente de cada paso (la dirección de mejora) y añadiendo ruido aleatorio antes de actualizar el modelo. La teoría ofrece cotas superiores sobre cuánto pueden influir los datos de una persona en el modelo final, resumidas por un número de privacidad a menudo llamado épsilon. En paralelo, la «auditoría de privacidad» intenta atacar el modelo entrenado y ver cuánta información puede extraerse en la práctica. Si la teoría y la auditoría coinciden, podemos confiar en nuestro cálculo de privacidad; si no, algo importante se está pasando por alto.

Qué cambia cuando solo se revela el modelo final

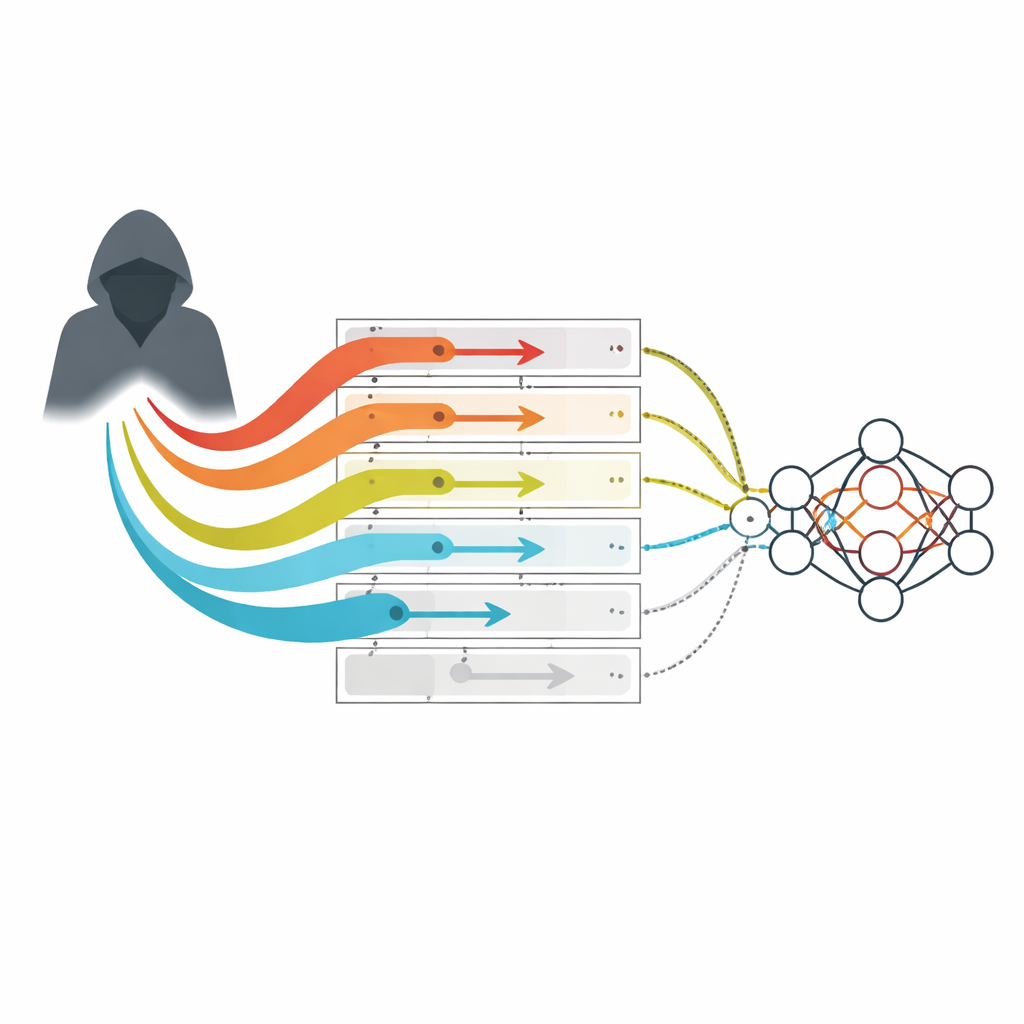

La mayoría de auditorías anteriores asumían un adversario potente que puede ver cada punto de control intermedio del modelo durante el entrenamiento. En la realidad, muchas organizaciones solo publican el modelo final, no el historial completo de entrenamiento. Este escenario más realista se denomina modelo de amenaza de estado oculto. Trabajos teóricos recientes sugerían que, al menos para problemas convexos simples, ocultar los modelos intermedios podría amplificar la privacidad con el tiempo: los datos usados al principio del entrenamiento se «lavan» por las actualizaciones ruidosas posteriores. Sin embargo, el aprendizaje profundo moderno se basa en modelos altamente no convexos, donde la superficie de pérdida es rugosa y compleja. No estaba claro si la misma amplificación ocurre allí, o si los ataques existentes eran simplemente demasiado débiles para exponer la pérdida de privacidad completa.

Una nueva forma de empujar el modelo para el adversario

El autor introduce una nueva familia de adversarios de «confección de gradientes» diseñados para el modelo de estado oculto. En lugar de intentar diseñar un punto de datos especial y luego observar cómo cambia su pérdida durante el entrenamiento (como en los ataques tradicionales basados en la pérdida), estos adversarios prescriben directamente la secuencia de gradientes que se aplicarían si estuviera presente un punto de datos peor caso. Eligen gradientes que siempre alcanzan el umbral de recorte y se alinean con direcciones de parámetros raramente usadas, lo que hace que su influencia sea más fácil de detectar incluso sin ver modelos intermedios. Se estudian dos variantes simples: una que selecciona aleatoriamente una dirección de parámetro y otra que simula el proceso de entrenamiento para encontrar la dirección menos actualizada antes de inyectar gradientes fuertes y repetidos a lo largo de ella.

Lo que revelan los experimentos sobre el riesgo real de privacidad

Usando este marco, el artículo audita DP-SGD en conjuntos de datos de imágenes y tabulares con arquitecturas comunes como redes convolucionales y residuales, así como un pequeño modelo totalmente conectado. Cuando el gradiente confeccionado se usa en cada paso de entrenamiento, los nuevos adversarios igualan las estrictas cotas teóricas de privacidad, aunque solo vean el modelo final. Esto significa que, en este caso extremo, ocultar los puntos de control intermedios no proporciona privacidad adicional. Cuando el gradiente confeccionado se inserta con menor frecuencia, el panorama cambia: para lotes grandes en relación con el nivel de ruido, las auditorías permanecen cercanas a la teoría (lo que sugiere nuevamente poca amplificación real), pero para lotes más pequeños y ruido mayor, aparece una brecha que apunta a una amplificación de privacidad genuina, aunque modesta, en entornos no convexos.

Asomarse al límite del peor caso

Para entender los límites absolutos de la privacidad en el modelo de estado oculto, el artículo también estudia un adversario teórico más extremo que no solo confecciona gradientes sino que además diseña todo un paisaje de pérdida para mantener la influencia de un punto de datos especial viva a lo largo de las iteraciones. En este entorno controlado, los resultados separan claramente dos regímenes: con tamaños de lote grandes, el cálculo de privacidad basado en la teoría estándar es esencialmente ajustado, pero con lotes pequeños y ruido considerable, la información temprana sobre un punto de datos se olvida parcialmente con el tiempo. De forma crucial, esta amplificación es más débil que la conocida para problemas convexos simples y nunca borra por completo el riesgo de privacidad.

Qué significa esto para usuarios y profesionales

Para los no expertos, la conclusión es que ocultar simplemente el historial de entrenamiento de un modelo de aprendizaje profundo no garantiza mágicamente una privacidad mucho más fuerte. Cuando los datos de una persona se usan con mucha frecuencia durante el entrenamiento, su riesgo se aproxima a lo que ya predice la teoría conservadora actual. Surge cierta protección adicional en regímenes más favorables —lotes pequeños con ruido significativo—, pero es modesta y no reduce el riesgo a cero. Estos hallazgos validan partes del cálculo de privacidad existente y ponen de relieve sus límites, ofreciendo una imagen más clara y realista de cuánto puede proteger DP-SGD cuando solo se comparte el modelo final.

Cita: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Palabras clave: privacidad diferencial, DP-SGD, auditoría de privacidad, seguridad en aprendizaje automático, modelo de estado oculto