Clear Sky Science · es

Un enfoque en el dominio de la frecuencia basado en wavelets para la detección precisa de enfermedades en múltiples cultivos

Ojos más inteligentes para la salud de los cultivos

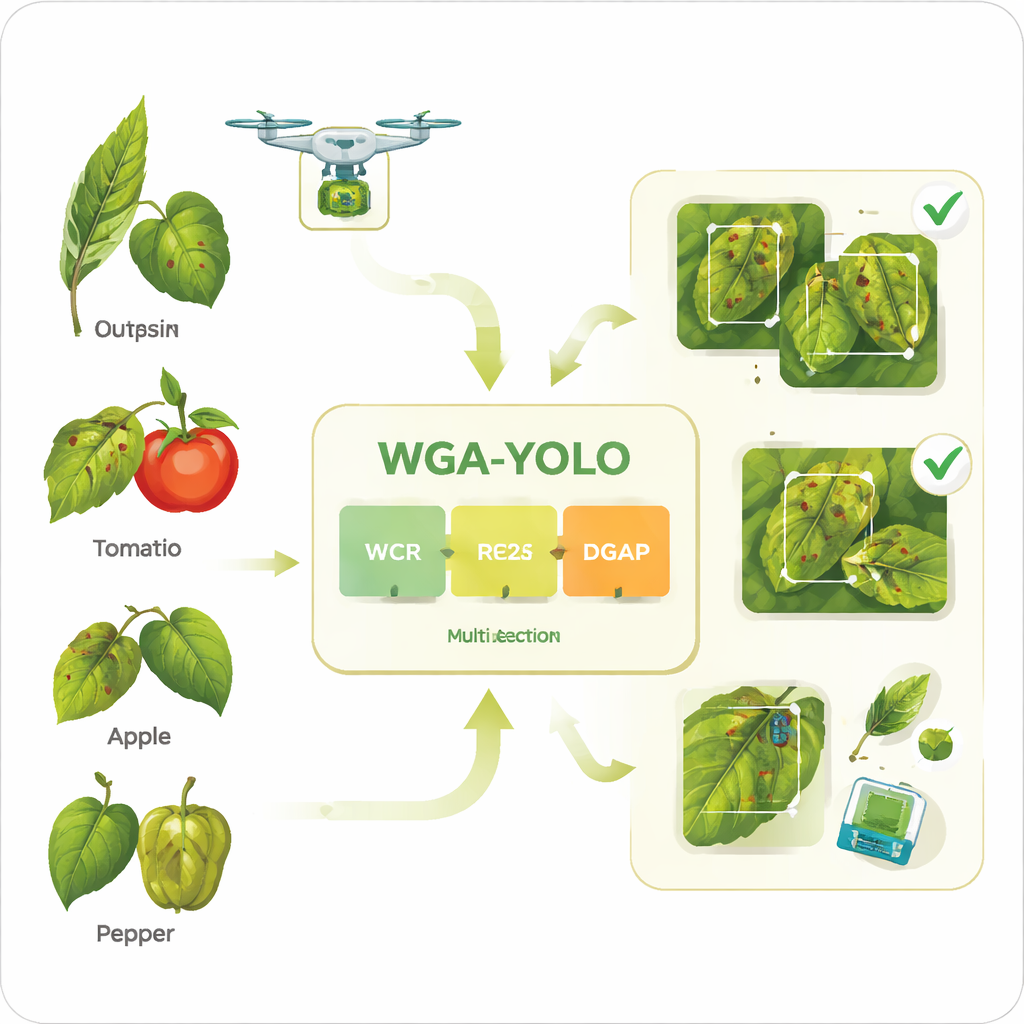

Los agricultores y los investigadores confían cada vez más en cámaras y drones para detectar enfermedades de las plantas de forma temprana, antes de que se propaguen y arruinen las cosechas. Pero los campos reales son desordenados: las hojas se solapan, la luz solar cambia segundo a segundo y muchas manchas de enfermedad son pequeñas y se confunden fácilmente con la textura normal de la hoja. Este artículo presenta WGA‑YOLO, un sistema compacto de inteligencia artificial diseñado para localizar áreas enfermas en muchos tipos de cultivos de manera rápida y precisa, incluso en condiciones tan desafiantes.

Por qué es tan difícil encontrar manchas en las hojas

A primera vista, reconocer una hoja enferma en una foto parece sencillo. En la práctica, no lo es. En los campos reales, las lesiones por enfermedad pueden ser muy pequeñas, de forma irregular y dispersas por las hojas. Su color y textura a menudo se asemejan a patrones naturales como venas o motas. La iluminación puede ser intensa, tenue o desigual debido a sombras. Los sistemas tradicionales de aprendizaje automático dependen de señales visuales diseñadas a mano y tienden a fallar cuando el fondo está abarrotado o la iluminación cambia. Los sistemas modernos de aprendizaje profundo, como los modelos YOLO estándar, son más potentes, pero aun así pueden pasar por alto lesiones diminutas o requerir una gran capacidad de cálculo que resulta impracticable para dispositivos de bajo coste usados en las granjas.

Limpiar la visión de las enfermedades de las plantas

Para entrenar y evaluar cualquier sistema de detección, es esencial un conjunto de datos fiable. Los autores empezaron por revisar una colección pública popular de imágenes de plantas llamada PlantDoc. Encontraron muchos problemas que podían inducir a error al modelo de IA: etiquetas ausentes o inconsistentes, dibujos en lugar de fotos reales e imágenes con marcas de agua o anotaciones manuscritas. Volvieron a comprobar, corregir y eliminar con cuidado las muestras problemáticas, y luego ampliaron el conjunto con nuevas imágenes documentadas provenientes de fuentes públicas. El resultado, PlantDoc_boost, incluye 13 cultivos comunes y 17 tipos de enfermedades, con escenas exteriores realistas y muchas áreas enfermas pequeñas. Este conjunto de datos más limpio y rico refleja mejor lo que realmente “ve” una cámara en el campo y permite evaluar si un modelo se generaliza más allá del laboratorio.

Cómo es el nuevo modelo por dentro

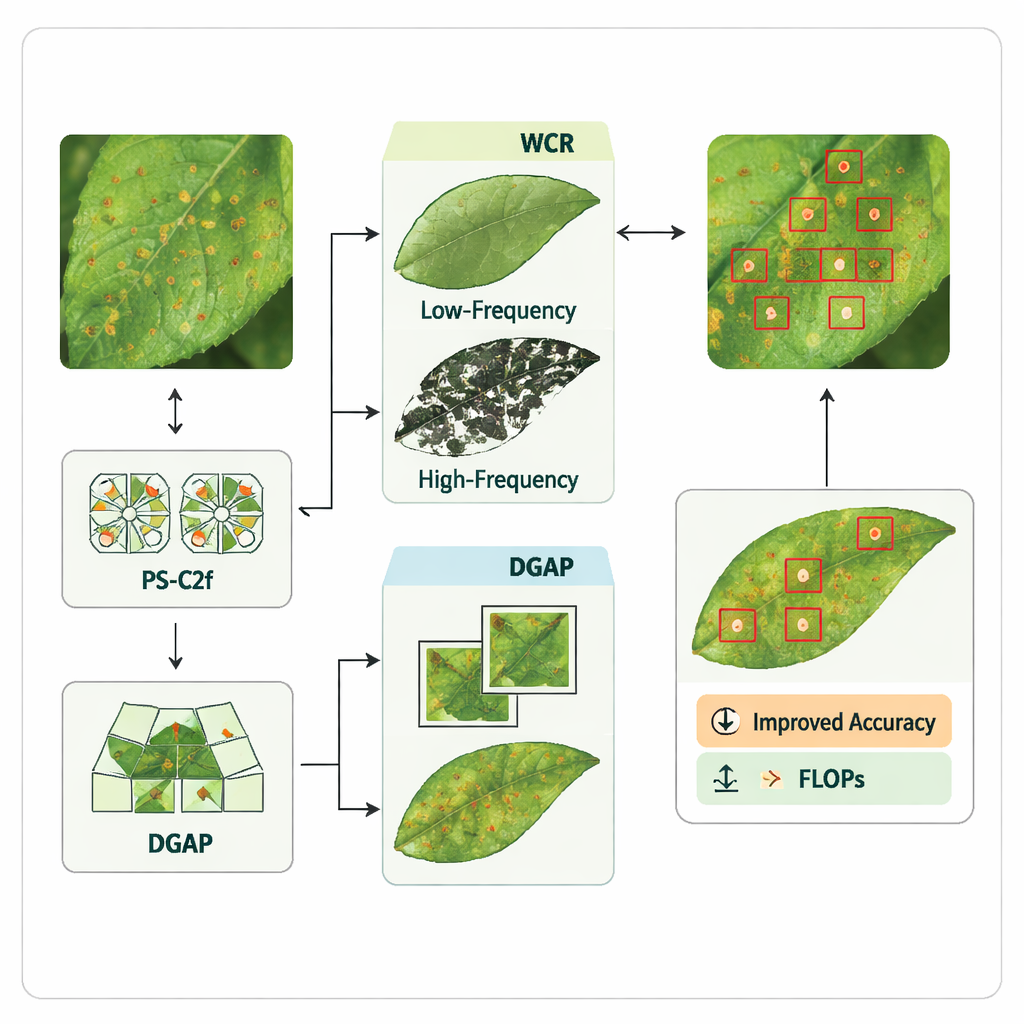

WGA‑YOLO se basa en YOLOv8n, un detector de objetos de una sola etapa conocido por su rapidez. Los autores rediseñaron partes clave de la red para preservar detalles finos manteniéndola ligera. Primero, sustituyen algunos pasos estándar de reducción de resolución por un módulo llamado Recalibración de Canal por Wavelets (WCR). En lugar de reducir simplemente las imágenes y perder información, WCR realiza una transformada wavelet que separa las características en contenido suave de baja frecuencia y bordes y texturas agudos de alta frecuencia. Al recombinar estos componentes de forma juiciosa, la red conserva tanto la forma general de las hojas como las pequeñas manchas que señalan enfermedad, todo con muy poco coste computacional adicional.

Ampliar la mirada sobre las lesiones diminutas a múltiples escalas

Las lesiones pequeñas son especialmente fáciles de pasar por alto, por lo que los autores introducen un bloque personalizado llamado PS‑C2f. Utiliza filtros con forma de hélice que observan en varias direcciones alrededor de cada punto, lo que hace que el modelo sea más sensible a cambios sutiles en la forma y la textura que delimitan las lesiones. Otra pieza nueva, DGAP (Dynamic Group Attention Pooling), ayuda a la red a combinar información de distintas escalas —desde manchas pequeñas hasta regiones casi del tamaño de la hoja. Al aprender cuánto peso dar a las vistas local, intermedia y global, DGAP fomenta que el modelo destaque las áreas de lesión realmente importantes mientras resta importancia a patrones de fondo confusos, como venas o texturas del suelo.

Qué tan bien funciona en la práctica

Probado en el conjunto PlantDoc_boost, WGA‑YOLO detecta regiones enfermas con mayor precisión que varias alternativas bien conocidas, incluyendo Faster R‑CNN y múltiples versiones de YOLO, mientras utiliza menos parámetros y ligeramente menos cómputo que su punto de partida YOLOv8n. También obtiene buenos resultados en varios conjuntos de datos externos de enfermedades del maíz, tomate y manzana, que presentan escenas más simples pero cubren muchas imágenes y tipos de enfermedad. En estas pruebas, WGA‑YOLO se centra mejor en las áreas de lesión reales y se deja engañar menos por texturas o iluminación distractoras. Esta combinación de precisión y eficiencia sugiere que el modelo podría ejecutarse en hardware modesto, como dispositivos en el borde montados en drones o robots agrícolas, y ofrecer orientación casi en tiempo real.

Qué significa esto para los agricultores

En términos sencillos, este trabajo ofrece un “ojo” digital más nítido y eficiente para los cultivos. Al limpiar los datos de entrenamiento y reingenierizar la forma en que el modelo de IA maneja el detalle fino y la escala, los autores crearon un detector que detecta más enfermedades sin requerir equipos voluminosos. Eso podría ayudar a los agricultores a detectar problemas antes, orientar el uso de pesticidas con mayor precisión y reducir tanto costes como impacto ambiental. Aunque se requiere un ajuste adicional para infecciones muy tempranas y sutiles y para el despliegue en los dispositivos más pequeños, WGA‑YOLO supone un avance significativo hacia la monitorización práctica y lista para el campo de enfermedades en una amplia variedad de cultivos.

Cita: Zhao, J., Liang, Y., Wei, G. et al. A wavelet-based frequency-domain approach for accurate multi-crop disease detection. Sci Rep 16, 7099 (2026). https://doi.org/10.1038/s41598-026-38476-w

Palabras clave: detección de enfermedades de cultivos, agricultura de precisión, visión por ordenador, YOLO, monitoreo de la salud de las plantas