Clear Sky Science · es

Una red YOLOv11 mejorada para la detección de residuos marinos en entornos subacuáticos

Por qué importa detectar basura bajo el agua

Muy por debajo de la superficie del océano, bolsas de plástico, botellas, líneas de pesca y otros desechos se acumulan de forma silenciosa. Esta basura perjudica la vida marina, obstruye hábitats sensibles e incluso puede interferir con los robots submarinos que los científicos usan para estudiar y proteger el mar. El artículo resumido aquí describe un sistema de visión por ordenador más inteligente que ayuda a cámaras y robots a encontrar y etiquetar automáticamente los desechos submarinos en tiempo real, incluso en aguas turbias y con mucho ruido visual.

El reto de ver con claridad bajo el mar

A diferencia de las fotos diurnas y nítidas en tierra, las imágenes submarinas suelen ser oscuras, brumosas y teñidas de azul o verde. La luz se atenúa rápidamente con la profundidad, la arena y el plancton nublan el agua, y los objetos de desecho a menudo son pequeños, están parcialmente ocultos o se confunden con rocas y plantas. Los métodos tradicionales de procesamiento de imágenes tienen dificultades en estas condiciones, e incluso los detectores modernos de aprendizaje profundo pueden pasar por alto objetos minúsculos o confundir texturas de fondo con residuos. Sin embargo, una detección precisa y rápida es crucial para cartografiar la contaminación, guiar robots de limpieza y seguir cómo cambian los desechos marinos a lo largo del tiempo.

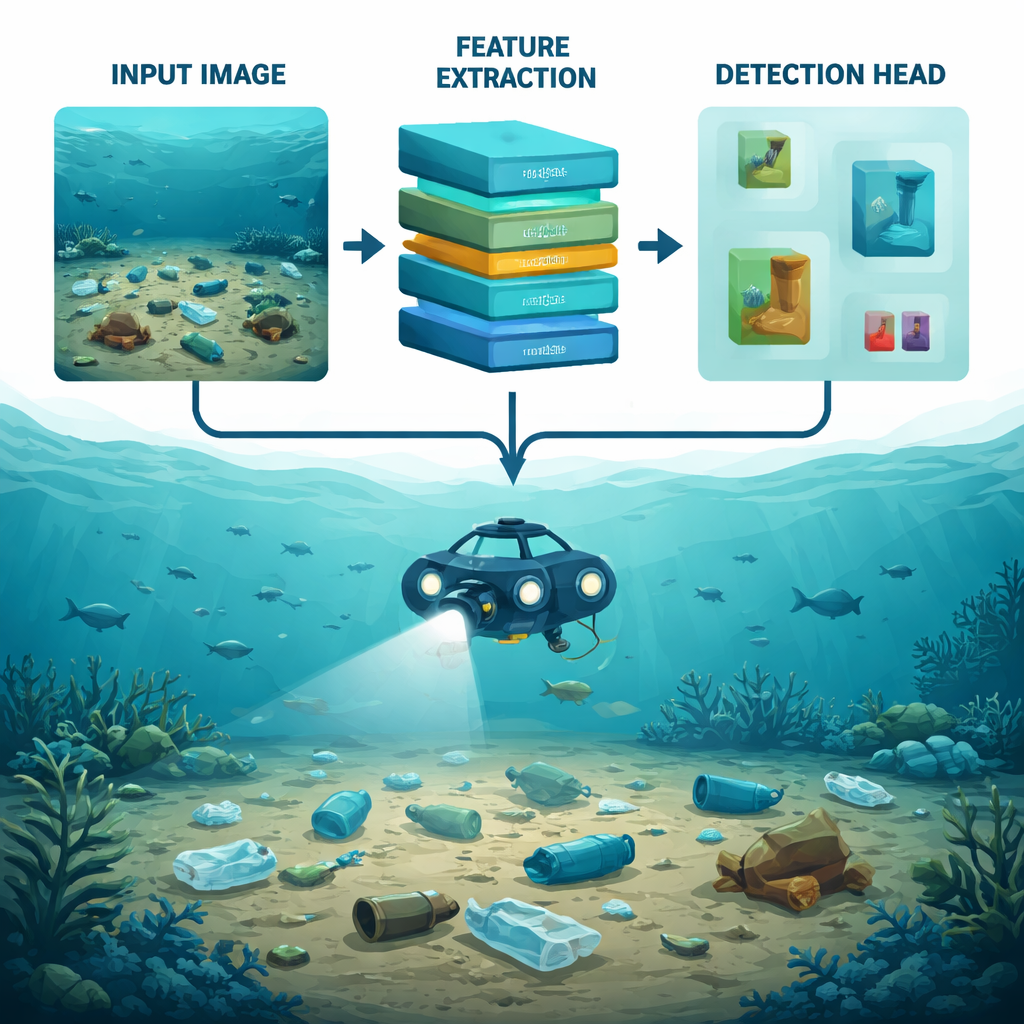

Basándose en un caballo de batalla visual rápido

Los autores parten de YOLOv11, un miembro reciente de la familia “You Only Look Once” de detectores de objetos. Los modelos YOLO son populares porque analizan una imagen una sola vez y predicen en tiempo real las ubicaciones y las clases de muchos objetos. No obstante, el diseño estándar de YOLOv11 se creó para escenas más típicas, como calles o fotos interiores, no para el mundo visualmente adverso submarino. Para salvar esta brecha, los investigadores rediseñan dos partes clave de la red: cómo primero extrae patrones visuales de una imagen y cómo, posteriormente, decide qué partes son objetos de interés y cuáles son solo ruido de fondo.

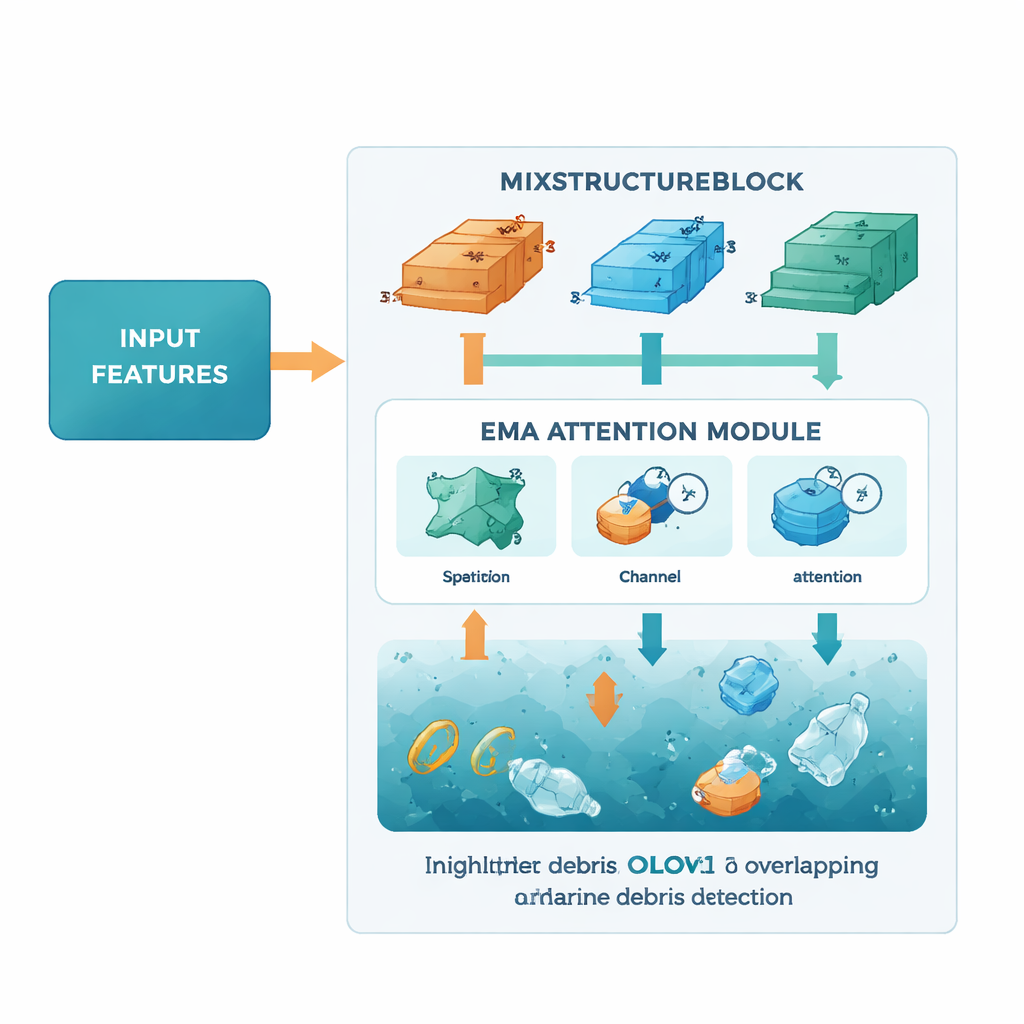

Una nueva forma de captar detalles a varias escalas

La primera mejora es un módulo llamado MixStructureBlock, que sustituye a un bloque estándar en el backbone de YOLOv11. En lugar de usar un patrón fijo de filtros, MixStructureBlock ejecuta varias ramas en paralelo que observan la escena con diferentes “tamaños de ventana” y espaciamientos. Esto ayuda a la red a detectar tanto detalles finos, como el borde de una tapa de botella, como formas más grandes, como una bolsa a la deriva. Además, el bloque incluye mecanismos de atención sencillos que aprenden a enfatizar colores y ubicaciones informativas mientras atenúan parches de fondo poco útiles. El resultado es un conjunto de características más rico y limpio que facilita observar pedazos pequeños y tenues de desechos.

Enseñar a la red dónde enfocarse

La segunda mejora es un módulo Efficient Multi-scale Attention (EMA), añadido en las etapas tardías de la red donde se realizan las detecciones. EMA observa los mapas de características tanto en el espacio como entre canales, formulando en la práctica dos preguntas a la vez: “¿Dónde en la imagen está ocurriendo algo importante?” y “¿Qué tipos de patrones son más relevantes ahora mismo?”. Al agrupar información a múltiples escalas y usar operaciones matemáticas ligeras, EMA agudiza el enfoque de la red sobre las regiones probables de basura —como objetos superpuestos o elementos tenues y lejanos— manteniendo al mismo tiempo el modelo compacto y lo bastante rápido para uso en tiempo real en hardware embebido.

Poniendo el sistema a prueba

Para evaluar su diseño, el equipo entrenó y testó el modelo en TrashCan, una gran colección pública de imágenes de aguas profundas compilada en Japón. Una versión del conjunto de datos etiqueta los desechos por tipo de objeto específico (como vaso, bolsa o tubería metálica), mientras que otra agrupa los elementos por material (como plástico o tejido). En ambas versiones, la red mejorada supera a varias líneas base fuertes, incluido el YOLOv11 original, sistemas anteriores de detección de residuos marinos y otras variantes de YOLO enfocadas al entorno submarino. No solo detecta más desechos correctamente, especialmente objetos pequeños y en áreas concurridas, sino que lo hace con un tamaño de modelo sorprendentemente reducido de aproximadamente 5 megabytes, adecuado para vehículos submarinos con limitaciones de energía.

Qué significa esto para océanos más limpios

En términos sencillos, el estudio muestra que replantear con cuidado cómo una IA “mira” las imágenes submarinas puede marcar una diferencia real a la hora de encontrar basura bajo las olas. Al combinar la extracción de patrones a múltiples escalas con una atención inteligente a las regiones importantes, el sistema propuesto detecta más desechos y sigue siendo lo bastante eficiente para uso en tiempo real. Desplegado en sistemas de cámara y robots submarinos, este tipo de tecnología podría ayudar a científicos y agencias ambientales a mapear puntos calientes de contaminación, guiar esfuerzos de limpieza y monitorizar si las políticas para reducir los residuos marinos funcionan —acercándonos un paso más a océanos más saludables.

Cita: Yuanwei, J., Yijiang, D., Xuemei, W. et al. An improved YOLOv11 network for marine debris detection in underwater environment. Sci Rep 16, 7074 (2026). https://doi.org/10.1038/s41598-026-38305-0

Palabras clave: detección de residuos marinos, robótica subacuática, detección de objetos, aprendizaje profundo, contaminación oceánica