Clear Sky Science · es

Aprovechamiento de modelos de aprendizaje profundo para la detección temprana y la clasificación de enfermedades de los frutos: hacia una agricultura sostenible y una mejor calidad alimentaria

Por qué importa detectar la fruta enferma de forma temprana

La fruta magullada o manchada es algo más que un problema estético: puede indicar enfermedades de las plantas que reducen drásticamente las cosechas, malgastan agua y productos químicos y, de forma silenciosa, encarecen los alimentos. En todo el mundo, los agricultores siguen confiando en gran medida en la inspección visual para juzgar si las frutas están sanas, un proceso lento y propenso a errores. Este estudio explora cómo la inteligencia artificial moderna puede convertir fotos simples de fruta en un sistema de alerta temprana, ayudando a los agricultores a proteger los cultivos, reducir pérdidas y ofrecer alimentos de mejor calidad.

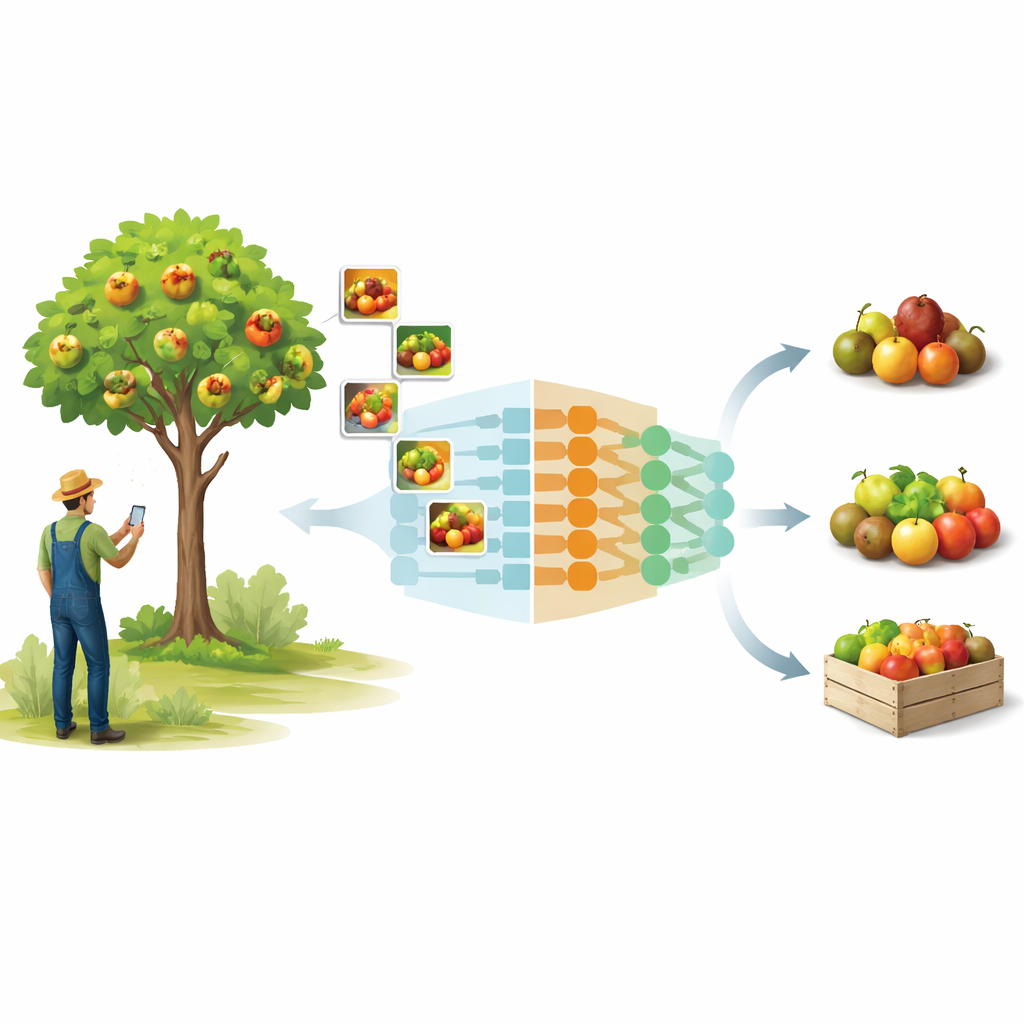

De las fotos de smartphone a los campos inteligentes

Los investigadores se propusieron crear herramientas que reconozcan automáticamente las enfermedades en frutas comunes analizando solo imágenes de hojas y frutos. Se centraron en seis cultivos muy extendidos —manzanas, uvas, mangos, plátanos, guayabas y naranjas— y recopilaron miles de imágenes que mostraban ejemplares sanos y enfermos. Enseñando a los ordenadores a distinguir manchas sutiles, decoloraciones y cambios de textura mucho antes de que un humano pueda notarlos, el objetivo es ofrecer a los agricultores retroalimentación rápida y objetiva sobre la salud de las plantas en el campo.

Enseñar a los ordenadores a leer las "huellas" de la fruta

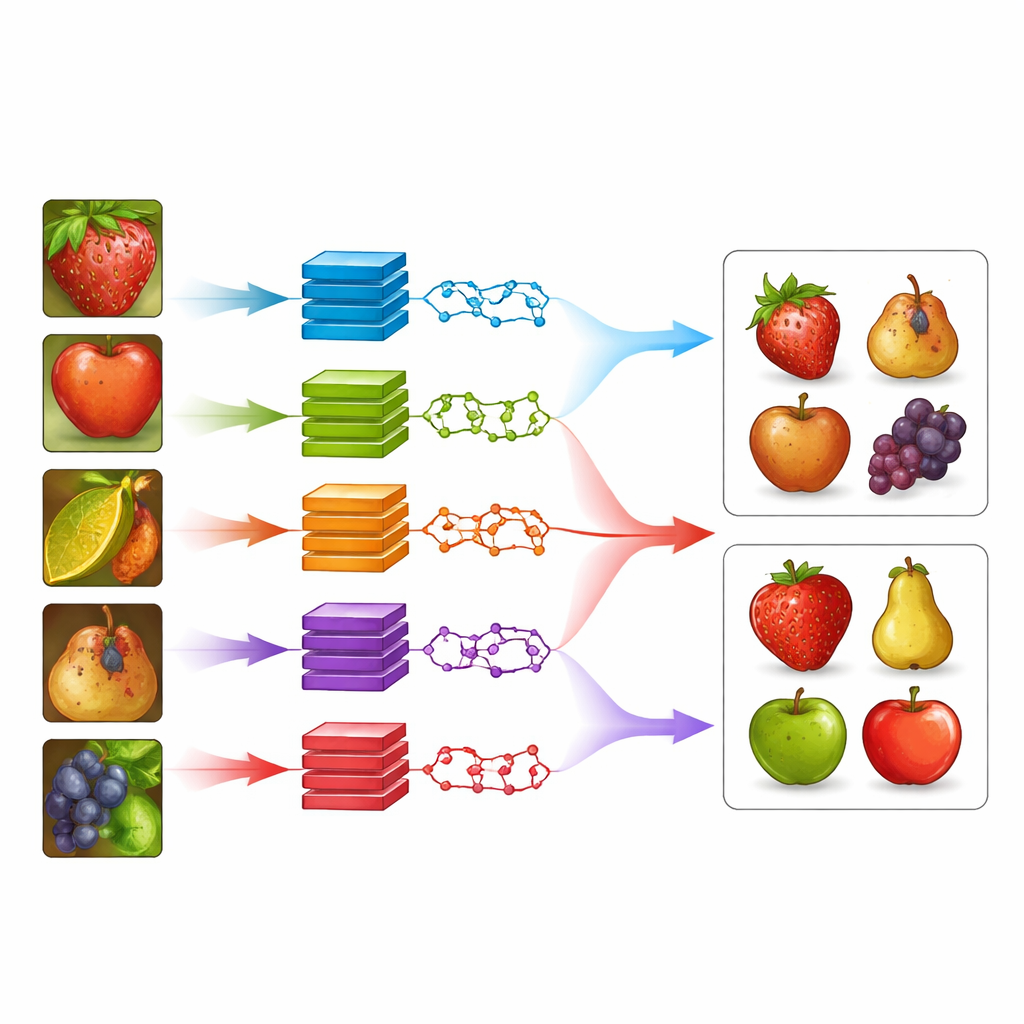

Para ello, el equipo empleó aprendizaje profundo, una rama de la inteligencia artificial que destaca por encontrar patrones en imágenes. En lugar de programar manualmente reglas como “busca círculos marrones”, entrenaron cinco arquitecturas de redes neuronales diferentes —conocidas como CNN, DenseNet121, EfficientNet B3, Xception y ResNet50— para que aprendieran directamente a partir de los datos de imagen. Antes del entrenamiento, limpiaron y prepararon las imágenes: redimensionarlas, corregir colores y usar técnicas como rotación y volteo para crear ejemplos de entrenamiento adicionales. Este paso de “acondicionamiento” de las imágenes ayuda a los modelos a aprender las huellas visuales importantes de la enfermedad mientras ignoran distracciones como el desorden de fondo o los cambios de iluminación.

Seis frutas, muchas enfermedades, un enfoque común

La misma receta general se aplicó en seis estudios de caso separados, cada uno centrado en una fruta específica y sus enfermedades clave. Por ejemplo, las imágenes de naranja incluían fruta sana así como casos de cancrosis cítrica, mancha negra y greening (enverdecimiento). Las uvas tenían categorías como pudrición negra y tizón foliar; los mangos y las guayabas abarcaron una gama más amplia de problemas; los plátanos y las manzanas se centraron en varias infecciones importantes de hoja y fruto. Para cada fruta, los investigadores entrenaron los cinco modelos de aprendizaje profundo y luego midieron con qué precisión podía cada uno clasificar imágenes nuevas y no vistas en la categoría correcta de enfermedad o “sano”. Esto permitió una comparación justa de qué diseños eran más fiables y eficientes en condiciones realistas.

Cómo se comportaron los inspectores digitales

Los médicos digitales de la fruta demostraron ser notablemente precisos. En muchas pruebas, los mejores modelos clasificaron correctamente más de 95 de cada 100 imágenes. Un modelo llamado EfficientNet B3 destacó, alcanzando alrededor del 99% de precisión para enfermedades de la uva y la manzana mientras usaba los recursos de cómputo de forma eficiente. ResNet50 rindió especialmente bien para mango y guayaba, y una CNN más simple funcionó mejor para naranjas. Incluso en casos más difíciles, como conjuntos de datos complejos de plátano o guayaba, al menos un modelo alcanzó todavía más del 94–96% de precisión. El estudio también comparó estos resultados con investigaciones anteriores y encontró que sus modelos, afinados cuidadosamente y reforzados por una preparación de imágenes considerada, generalmente igualaron o superaron los enfoques previos.

Qué significa esto para las granjas y la alimentación

Para los agricultores, estos resultados sugieren que una cámara y un modelo de aprendizaje profundo entrenado podrían pronto actuar como un asistente siempre activo de la salud de las plantas, señalando problemas con suficiente antelación como para salvar árboles y vides en lugar de limitarse a rescatar lo que queda. La detección temprana y precisa facilita tratar solo a las plantas que realmente necesitan atención, reduciendo pesticidas desperdiciados y preservando el suelo y el agua. Con el tiempo, tales sistemas podrían apoyar una agricultura más sostenible —mayores rendimientos, menos desperdicio y fruta de mejor calidad en los mercados— al convertir imágenes cotidianas en controles de salud rápidos y confiables para nuestros cultivos alimentarios.

Cita: Alrashdi, I., Sharawi, M., Ali, A.M. et al. Utilizing deep learning models for early detection and classification of fruit diseases: towards sustainable agriculture and enhanced food quality. Sci Rep 16, 8167 (2026). https://doi.org/10.1038/s41598-026-38259-3

Palabras clave: detección de enfermedades de frutas, aprendizaje profundo en la agricultura, monitorización de la salud vegetal, visión por computador, agricultura sostenible