Clear Sky Science · es

DeepLab V3+ con atención multinivel y EfficientNetB0 para la segmentación de órganos del tracto gastrointestinal en exploraciones MRI

Tiro más preciso a los tumores

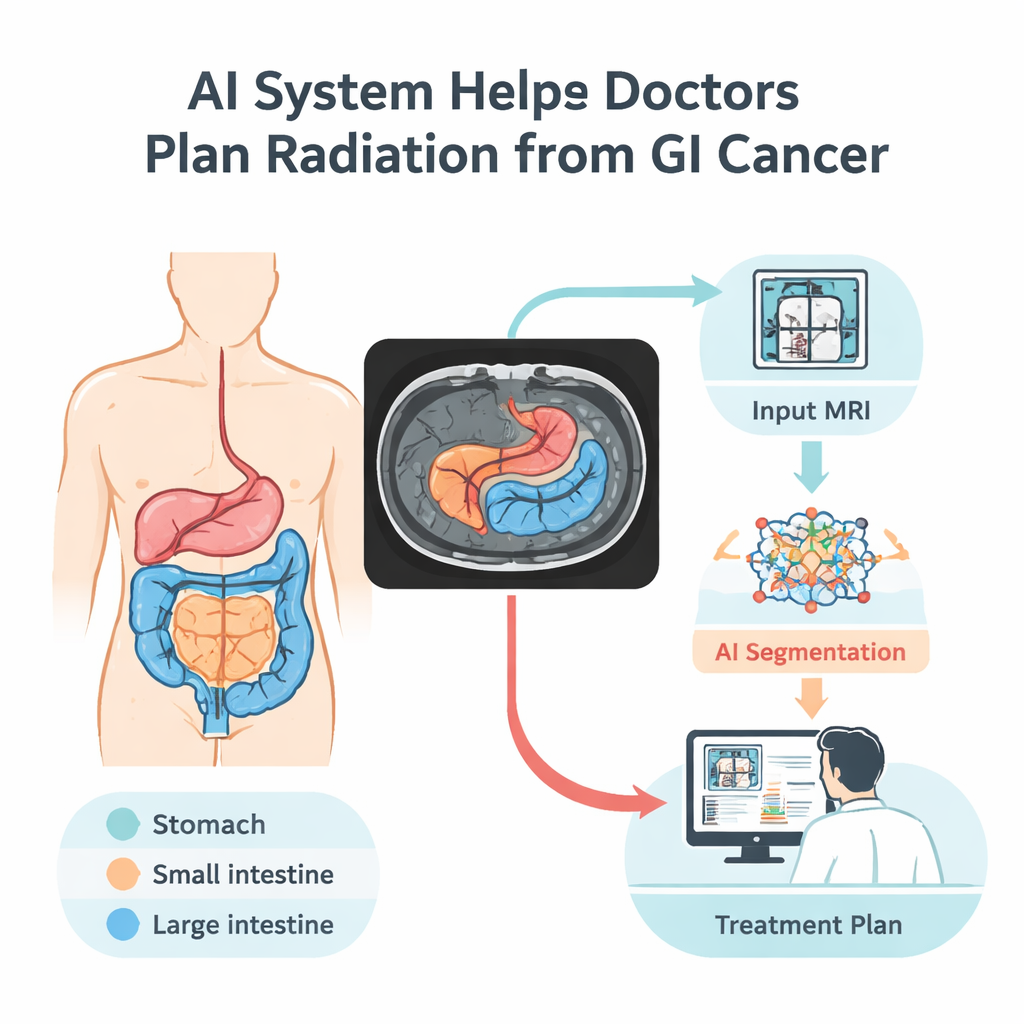

Cuando los médicos tratan cánceres del sistema digestivo con radiación, afrontan un delicado acto de equilibrio: golpear el tumor con fuerza mientras se preservan órganos sanos cercanos como el estómago y los intestinos. Hoy en día, delinear esos órganos a mano en cada exploración por resonancia magnética (MRI) puede llevar hasta una hora por paciente y por sesión. Este estudio presenta un sistema de visión por ordenador que traza automáticamente estos órganos en imágenes MRI, prometiendo una planificación del tratamiento más rápida, más precisa y con menos efectos secundarios para los pacientes.

Por qué importa cartografiar el intestino

Los cánceres gastrointestinales son frecuentes y a menudo mortales, con una supervivencia global en torno al 30 por ciento. La radioterapia es una pieza clave del tratamiento, pero el tracto digestivo está muy compacto dentro del abdomen y los órganos sanos pueden desplazarse ligeramente de un día a otro. Para evitar dañar el estómago, el intestino delgado y el intestino grueso, los especialistas deben saber exactamente dónde están antes de cada sesión de tratamiento. El delineado manual es lento y susceptible a variaciones entre expertos. Una forma automatizada y fiable de trazar estos límites podría acortar las citas, permitir que los médicos traten a más pacientes y mejorar la seguridad y la precisión de las dosis de radiación.

Enseñar a los ordenadores a leer MRI

Los investigadores construyeron un modelo de inteligencia artificial que aprende a reconocer tres órganos digestivos clave en las exploraciones MRI: el estómago, el intestino delgado y el intestino grueso. Lo entrenaron con el conjunto de datos UW–Madison GI Tract, la única colección pública con contornos detallados de órganos en MRI abdominal. Este conjunto incluye 38.496 imágenes de 85 pacientes, junto con etiquetas cuidadosamente preparadas que marcan dónde aparece cada órgano —o dónde no hay órgano presente—. Para sacar el máximo partido a esta muestra relativamente pequeña, el equipo dividió los datos por paciente (de modo que el modelo nunca vea a la misma persona en entrenamiento y prueba) y amplió el conjunto de datos mediante volteos, rotaciones, aumento del brillo y deformaciones suaves de las imágenes. Estos cambios controlados ayudan al sistema a afrontar variaciones del mundo real en la posición del paciente, la luminosidad de la imagen y diferencias sutiles de forma.

Cómo el nuevo modelo de IA detecta patrones

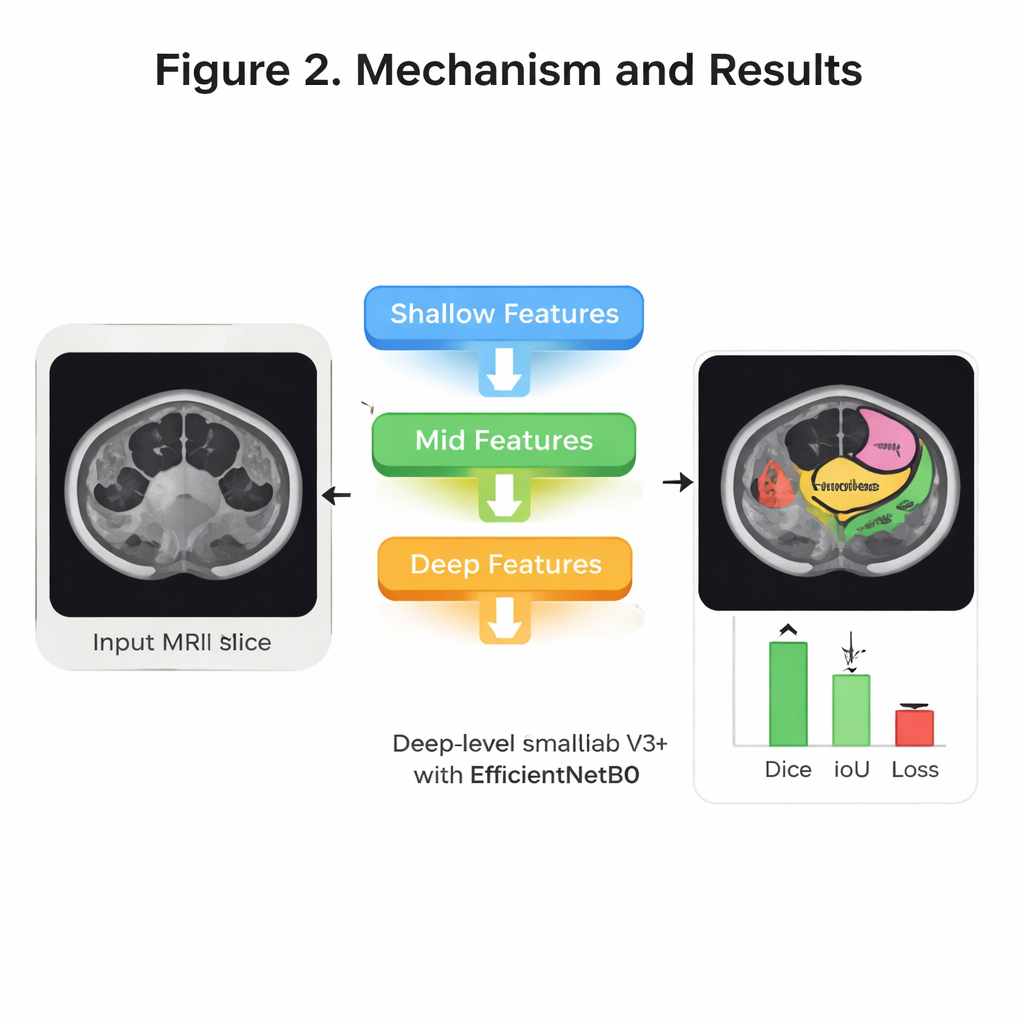

Dentro del modelo se combinan varias ideas de la reconocida moderna de imágenes para afinar su “vista” de la anatomía. Primero, una red compacta llamada EfficientNet B0 analiza cada imagen y va construyendo capas de características visuales —desde bordes simples hasta formas complejas de órganos— manteniendo modestos los requerimientos computacionales. A continuación, una estructura conocida como DeepLab V3+ examina la imagen a múltiples escalas, como hacer zoom dentro y fuera para entender tanto el detalle fino como el contexto general. Sobre esto, los autores añaden un mecanismo de “atención” a varios niveles de detalle. En términos sencillos, la atención ayuda al sistema a decidir qué partes de la imagen y qué señales internas merecen más peso, de modo que pueda enfocarse en indicios sutiles pero importantes que distinguen, por ejemplo, el estómago de las ansas del intestino delgado. Finalmente, una etapa de decodificador cose estas pistas de nuevo en una máscara completa y nítida que muestra los tres órganos.

Prueba de exactitud y eficiencia

El equipo afinó de forma sistemática cómo entrenaron el sistema —probando distintos métodos de optimización, números de ciclos de entrenamiento y formas de dividir los datos para validación. Su mejor configuración utilizó un optimizador llamado RMSprop, validación cruzada en cuatro pliegues y 30 rondas de entrenamiento. En pacientes de prueba retenidos, el modelo etiquetó correctamente más del 99 por ciento de los píxeles en conjunto y mostró una fuerte superposición con los contornos dibujados por expertos. Una medida de solapamiento ampliamente usada, la puntuación Dice, alcanzó alrededor del 94 por ciento de media entre los tres órganos, mientras que una medida relacionada, Intersección sobre Unión, llegó a aproximadamente el 92 por ciento. Igual de importante para su uso hospitalario, el sistema es relativamente ligero: tiene unos 8,3 millones de parámetros entrenables y puede procesar una rebanada MRI típica de 224×224 en aproximadamente 31 milisegundos, lo bastante rápido para ofrecer soporte casi en tiempo real durante la planificación diaria del tratamiento.

Qué podría significar esto para los pacientes

En términos cotidianos, este estudio muestra que una IA cuidadosamente diseñada puede trazar de forma fiable el estómago y los intestinos en imágenes MRI, igualando el rendimiento de expertos mientras trabaja mucho más rápido y con mayor consistencia. Esa capacidad podría ayudar a los oncólogos radioterapeutas a ajustar los haces con más precisión alrededor de tejidos sensibles, reduciendo daños y efectos secundarios no deseados durante el tratamiento. Aunque el modelo actual se entrenó con exploraciones de un solo centro y anatomía mayoritariamente sana, ofrece una sólida base para sistemas futuros que incluyan órganos enfermos y datos de múltiples hospitales. Con más pruebas y refinamiento, herramientas como esta podrían convertirse en asistentes rutinarios en la sala de planificación de radioterapia, asegurando discretamente que los rayos que salvan vidas impacten exactamente donde más se necesitan.

Cita: Sharma, N., Gupta, S., Al-Yarimi, F.A.M. et al. Multi-level attention DeepLab V3+ with EfficientNetB0 for GI tract organ segmentation in MRI scans. Sci Rep 16, 7546 (2026). https://doi.org/10.1038/s41598-026-38247-7

Palabras clave: cáncer gastrointestinal, segmentación por MRI, planificación de radioterapia, aprendizaje profundo en medicina, análisis de imágenes médicas