Clear Sky Science · es

Modelos de aprendizaje profundo de alto rendimiento basados en ensamblajes para la recuperación de imágenes médicas en la detección del cáncer de mama

Por qué importan exploraciones más inteligentes para la salud mamaria

El cáncer de mama es uno de los cánceres más frecuentes en mujeres, y las ecografías son una herramienta clave para detectar bultos sospechosos de forma temprana. Pero hoy los médicos deben revisar archivos crecientes de imágenes médicas, y los sistemas informáticos que podrían ayudar a menudo tienen dificultades para “comprender” realmente lo que ven. Este estudio presenta un motor de búsqueda de imágenes más inteligente para ecografías mamarias que no solo encuentra y clasifica tumores con alta precisión, sino que además muestra a los médicos qué partes de la imagen guiaron sus decisiones.

De imágenes simples a comparaciones útiles

Los hospitales almacenan ahora grandes volúmenes de ecografías mamarias, lo que dificulta y ralentiza localizar casos previos que se parezcan a la imagen de un nuevo paciente. Los sistemas anteriores de recuperación de imágenes basados en contenido comparaban imágenes usando rasgos básicos como brillo o textura, que a menudo no coincidían con la forma en que los radiólogos razonan sobre la enfermedad. Los autores buscan cerrar esta brecha entrenando un sistema de aprendizaje profundo con una colección ampliamente utilizada de 830 imágenes de ultrasonido mamario, agrupadas en tejido normal, tumores inocuos (benignos) y tumores peligrosos (malignos). Su objetivo es doble: clasificar una nueva exploración en uno de estos tres grupos y luego recuperar automáticamente exploraciones similares anteriores para orientar el diagnóstico.

Enseñar a una IA híbrida a ver patrones

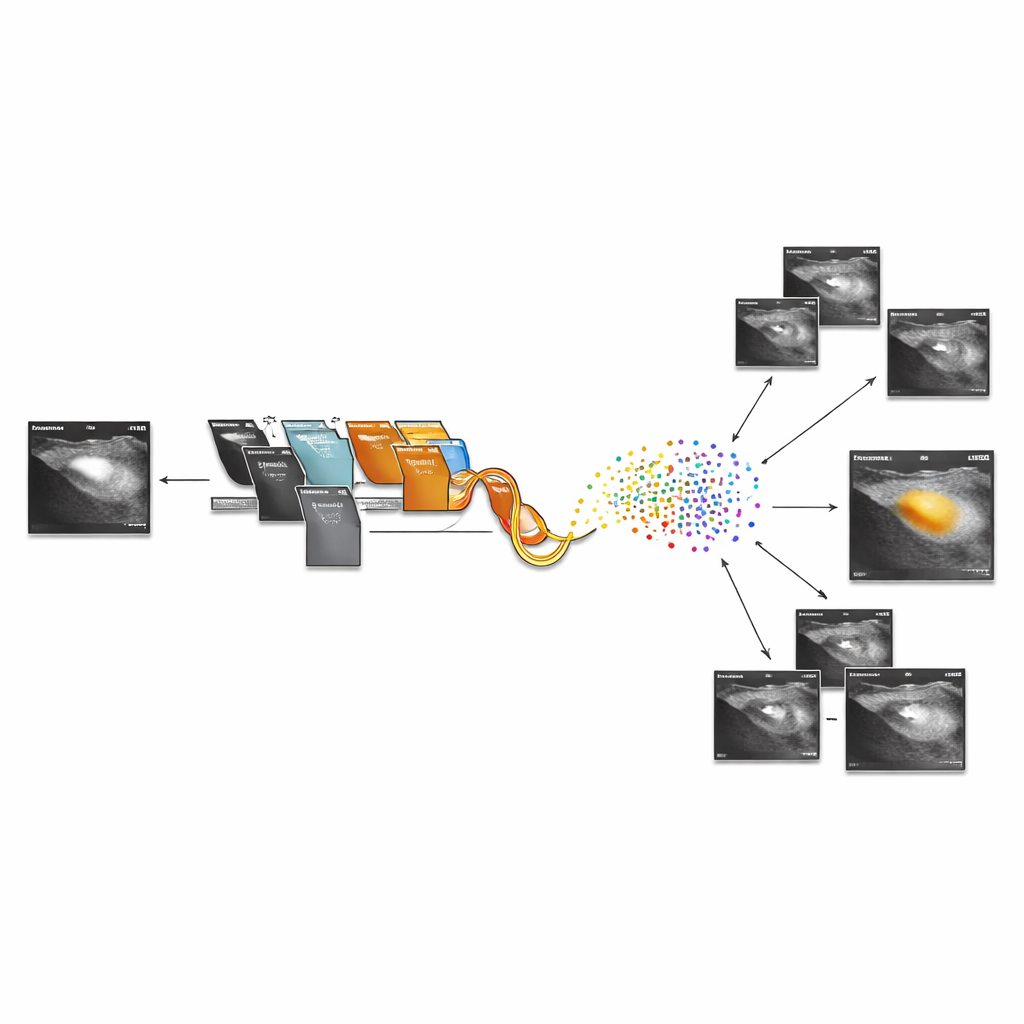

El equipo construye un modelo “híbrido” que combina tres tipos de redes neuronales, cada una con un papel diferente. Una red convolucional se especializa en leer los patrones espaciales de una ecografía, como la forma de un bulto o la nitidez de sus bordes. Una red recurrente, más usada para secuencias como el habla, se adapta para tratar filas de píxeles como una especie de señal ordenada, ayudando al sistema a notar cambios sutiles a lo largo de la imagen. Sobre estas, un componente de IA explicable genera mapas de calor que resaltan las regiones de la imagen más responsables de una decisión, de modo que los clínicos puedan comprobar si el modelo se está centrando en el tumor y no en el fondo irrelevante.

Limpiar, ampliar y organizar los datos

Antes del entrenamiento, los investigadores preparan cuidadosamente las imágenes de ultrasonido. Eliminan duplicados y bordes poco útiles, convierten las exploraciones a un formato común en escala de grises, recortan regiones en blanco y redimensionan todo a un cuadrado pequeño estándar para que el modelo pueda procesar los datos con eficiencia. Cada imagen se etiqueta como normal, benigna o maligna, y se disponen máscaras que delinean las regiones exactas del tumor. Dado que los conjuntos de datos médicos suelen ser pequeños, amplían artificialmente esta colección rotando, volteando, haciendo zoom y ajustando el contraste, haciendo crecer el conjunto de entrenamiento de 548 a 3.840 imágenes. Esta variación controlada enseña a la red a afrontar las múltiples apariencias que los tumores pueden presentar en distintas máquinas y pacientes.

Cómo el sistema clasifica y busca

Una vez entrenado, el modelo híbrido convierte cada ecografía en una huella numérica compacta tomada de la penúltima capa de la red. Las imágenes con huellas similares tienden a mostrar patrones tisulares parecidos, por lo que el equipo puede calcular distancias sencillas entre esas huellas para encontrar las coincidencias más cercanas en la base de datos. El sistema primero predice si la nueva exploración es normal, benigna o maligna, y luego recupera casos visual y clínicamente similares, proporcionando al radiólogo una galería de imágenes de referencia. El módulo de explicabilidad superpone regiones de colores cálidos sobre la exploración original, mostrando dónde “miró” la red para llegar a su conclusión, lo que puede generar confianza y apoyar la enseñanza y las segundas opiniones.

Qué significan los resultados para los pacientes

En pruebas sobre el conjunto de ecografías mamarias, el enfoque híbrido alcanza alrededor del 99 % de precisión en clasificación y supera a varios modelos de aprendizaje profundo líderes que se basan en una sola arquitectura. También muestra un comportamiento estable a través de múltiples divisiones de entrenamiento y prueba, lo que sugiere que su rendimiento no es fruto de una casualidad en una única partición del conjunto de datos. Para los pacientes, esto implica que, en el futuro, un radiólogo podría no solo obtener una lectura asistida por ordenador altamente fiable de una ecografía, sino también ver al instante casos pasados similares y las partes precisas de la imagen que suscitaron preocupación. Si bien los autores señalan que siguen haciendo falta ensayos clínicos más amplios y pruebas en otros tipos de imágenes, su trabajo apunta hacia un uso de la IA en la detección del cáncer de mama más transparente, fiable y eficiente.

Cita: Fawzy, A.E., Almandouh, M.E., Herajy, M. et al. Ensemble-based high-performance deep learning models for medical image retrieval in breast cancer detection. Sci Rep 16, 8723 (2026). https://doi.org/10.1038/s41598-026-38218-y

Palabras clave: ultrasonido de mama, recuperación de imágenes médicas, aprendizaje profundo, detección de cáncer de mama, IA explicable