Clear Sky Science · es

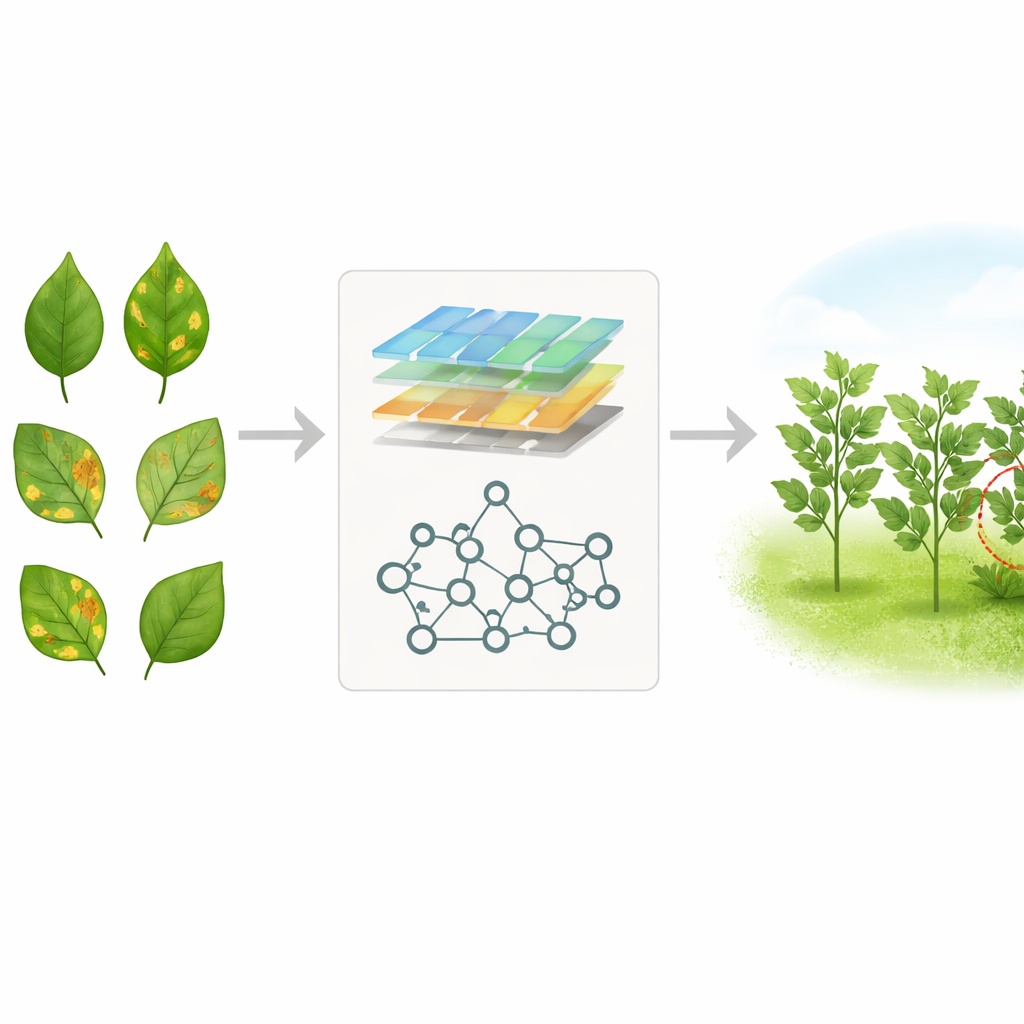

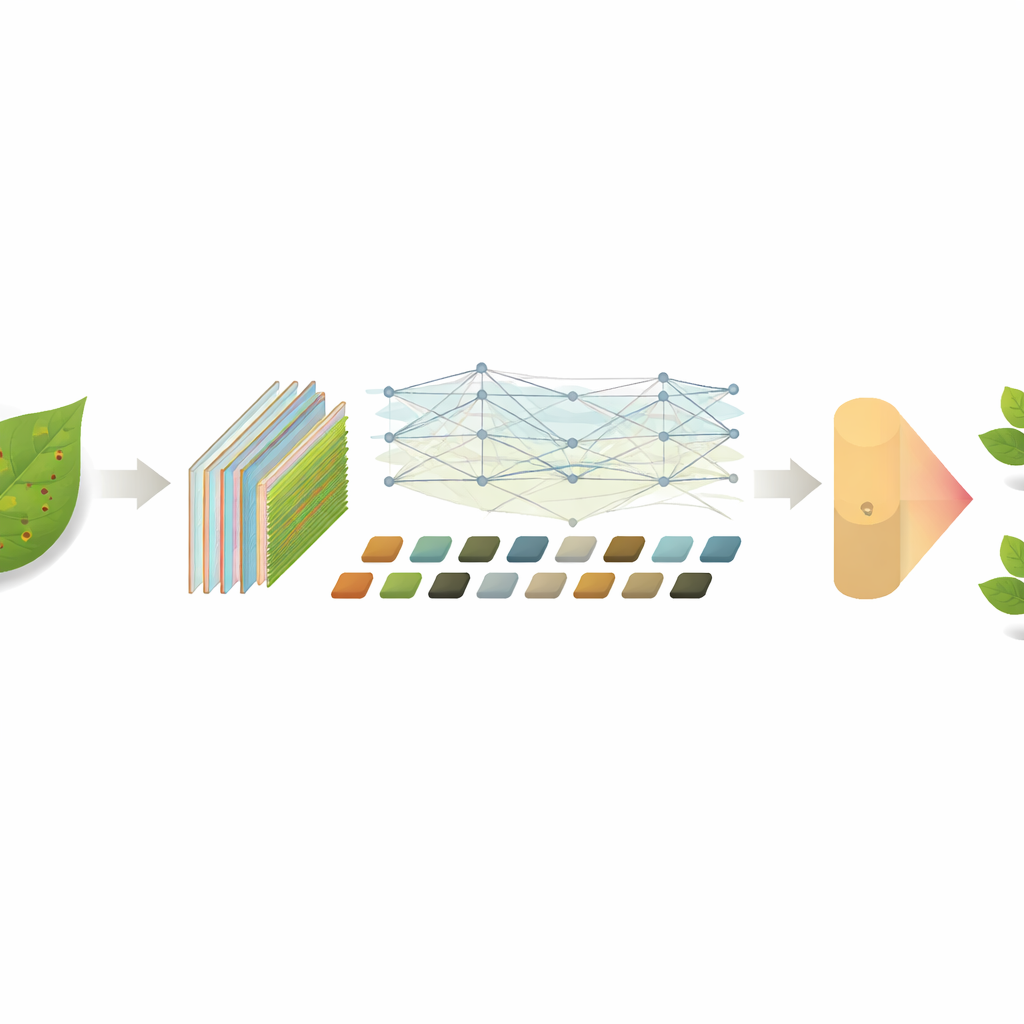

Un marco híbrido de aprendizaje profundo que utiliza modelos convolucionales y transformadores para una clasificación robusta de enfermedades de plantas

Por qué importa detectar plantas enfermas

Las enfermedades vegetales destruyen silenciosamente una gran parte de la comida mundial cada año, reduciendo los rendimientos, afectando los ingresos de los agricultores y amenazando la seguridad alimentaria. Detectar estas enfermedades de forma temprana es difícil: los campos son extensos, los expertos en fitopatología escasean y muchos síntomas son sutiles. Este artículo explora cómo un nuevo tipo de inteligencia artificial puede aprender a reconocer docenas de enfermedades foliares a partir de fotografías sencillas, ofreciendo una vía hacia herramientas para teléfonos inteligentes o cámaras de campo que ayuden a los agricultores a actuar antes de que los problemas se propaguen.

De la conjetura humana a ojos digitales

El diagnóstico tradicional se basa en la inspección visual de las hojas por personas y, a veces, en el envío de muestras a un laboratorio. Ese proceso es lento, subjetivo y a menudo no está disponible en zonas rurales. En la última década, los investigadores han entrenado programas informáticos para interpretar imágenes de hojas. Los sistemas anteriores requerían que ingenieros diseñaran manualmente indicadores visuales, o empleaban modelos de aprendizaje profundo llamados redes neuronales convolucionales que sobresalen en captar texturas, colores y bordes. Estos métodos mejoraron la precisión, pero seguían teniendo dificultades cuando los signos de la enfermedad eran tenues, se extendían por la hoja o se parecían entre distintas enfermedades. El nuevo estudio plantea si combinar dos enfoques modernos de IA puede ofrecer respuestas más fiables en estos casos difíciles.

Combinando dos formas de ver

Los autores construyen un sistema híbrido que fusiona una red convolucional con un modelo de imagen más reciente conocido como vision transformer. La primera parte, EfficientNet-B7, actúa como una lupa, escaneando las fotos de las hojas en busca de detalles finos como pequeñas manchas, venas y cambios de color. Su salida se remodela y se pasa a un transformador (ViT-B16), diseñado para notar cómo se relacionan diferentes regiones de la imagen a larga distancia. Al convertir las características detalladas en una serie de pequeños parches y permitir que el transformador valore cómo cada parche interactúa con todos los demás, el sistema puede comprender tanto las imperfecciones locales como el patrón general sobre la superficie de la hoja. Esta combinación pretende imitar cómo un agrónomo experto examina de cerca una lesión mientras considera su ubicación y el contexto.

Enseñando al sistema con miles de hojas

Para entrenar y evaluar su modelo, los investigadores utilizaron una gran colección pública de 21.534 imágenes que muestran 38 condiciones diferentes, incluyendo muchas enfermedades y hojas sanas de cultivos como manzano, tomate, vid y maíz. Estandarizaron las fotos a un tamaño común y aplicaron trucos digitales —como rotaciones, volteos y zooms— para simular las condiciones desordenadas de los campos reales. El modelo primero aprende patrones visuales generales a partir de datos de imagen existentes y luego se ajusta finamente con esta colección vegetal. Durante el entrenamiento, el equipo sigue no solo la precisión global, sino también la frecuencia con la que el sistema identifica correctamente cada enfermedad y su capacidad para evitar falsas alarmas, asegurando que el rendimiento se mantenga tanto en clases comunes como en las menos frecuentes.

Qué tan bien funciona el enfoque híbrido

Al evaluarlo con imágenes no vistas, el modelo híbrido clasifica correctamente la salud y las enfermedades de las plantas en el 98,13 por ciento de los casos, y mantiene puntuaciones altas en medidas estrictas de precisión, recuperación y equilibrio entre ambas. Maneja tanto hojas sanas como enfermedades difíciles, aunque los síntomas muy tempranos siguen siendo más complicados. Los autores comparan su sistema con una variedad de alternativas populares, incluidas redes convolucionales independientes, modelos transformadores puros, redes móviles ligeras, detectores rápidos como YOLO y herramientas clásicas como máquinas de vectores de soporte y bosques aleatorios. En estas pruebas cabeza a cabeza, el híbrido sale consistentemente favorecido, superando incluso a competidores fuertes que usan solo EfficientNet o ensamblajes de múltiples redes.

Qué significa esto para las granjas y los alimentos

En términos prácticos, el estudio muestra que combinar dos “vistas” complementarias de una imagen —detalle local nítido y contexto amplio— puede mejorar significativamente la detección automática de enfermedades vegetales. Si bien el sistema actual aún requiere fotos bastante claras y funciona mejor en máquinas con procesadores gráficos, las mismas ideas de diseño podrían adaptarse a versiones más ligeras para teléfonos inteligentes, drones o dispositivos de campo de bajo coste. A medida que estas herramientas maduren, podrían ofrecer a los agricultores orientación rápida y en el lugar sobre qué está atacando sus cultivos y dónde, favoreciendo tratamientos más tempranos, reducción del uso de químicos y cosechas más estables. Para el lector general, el mensaje clave es que cámaras y algoritmos más inteligentes se están convirtiendo en aliados poderosos para proteger el suministro de alimentos del planeta.

Cita: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Palabras clave: detección de enfermedades vegetales, aprendizaje profundo, vision transformer, agricultura de precisión, clasificación de imágenes