Clear Sky Science · es

La construcción y las técnicas refinadas de extracción de grafos de conocimiento basadas en grandes modelos de lenguaje

Mapas más inteligentes para decisiones complejas

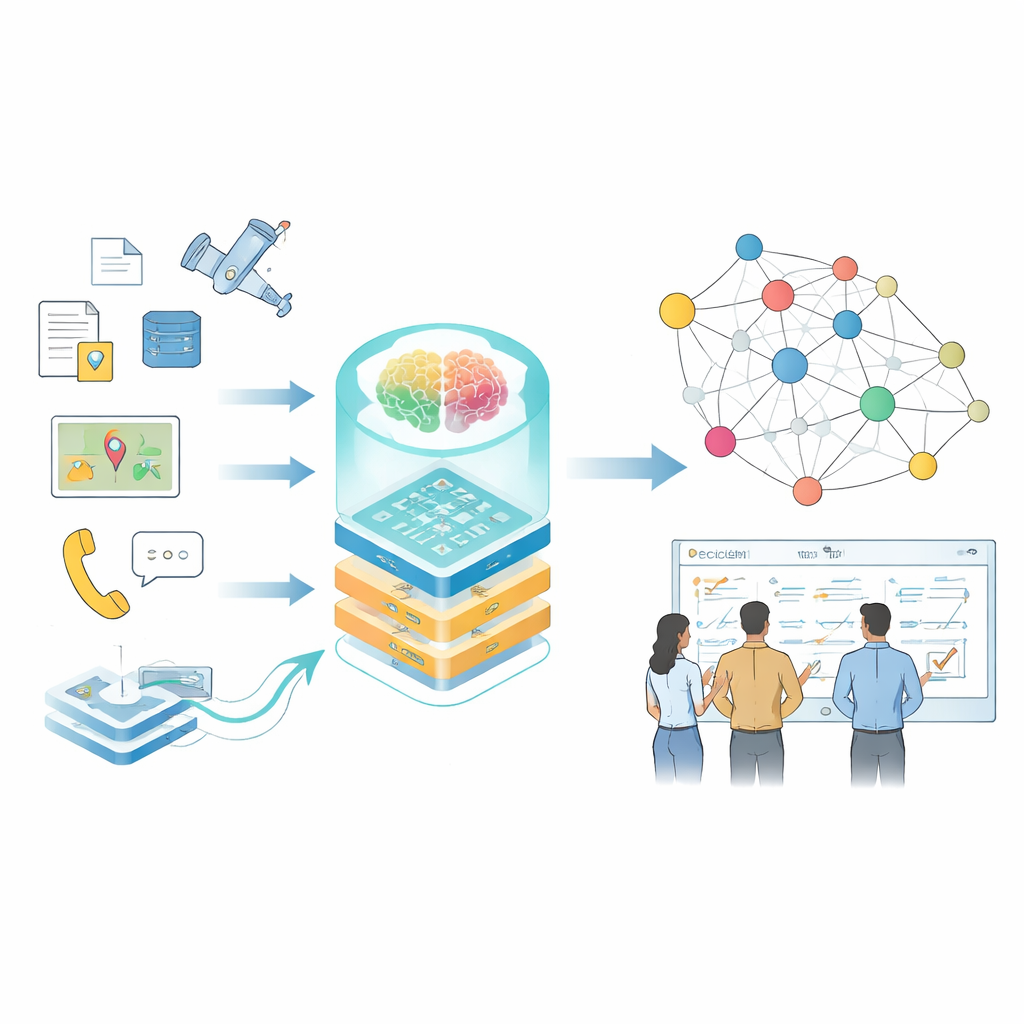

Las decisiones modernas en campos de alta responsabilidad—como operaciones a gran escala, gestión de infraestructuras o respuesta a desastres—dependen de interpretar rápidamente enormes cantidades de información dispersa. Manuales, flujos de sensores, informes y simulaciones cuentan parte de la historia, pero rara vez están organizados de forma que humanos o máquinas puedan utilizarlos con facilidad. Este artículo presenta una forma de convertir esa información fragmentada en «mapas de conocimiento» vivos impulsados por grandes modelos de lenguaje, de modo que planificadores y analistas puedan formular mejores preguntas y obtener respuestas más rápidas y fiables.

De hechos dispersos a conocimiento conectado

Los autores se centran en los grafos de conocimiento, una forma de representar información como una red de hechos conectados—quién hizo qué, con qué sistema y bajo qué condiciones. En entornos cotidianos, estos grafos ya impulsan motores de búsqueda y sistemas de recomendación, pero los dominios especializados plantean retos mayores: los datos son sensibles, la terminología es densa, los formatos van desde informes en texto libre hasta registros de sensores, y las condiciones cambian con rapidez. Las herramientas tradicionales que dependen de reglas escritas a mano o de modelos pequeños tienen dificultades para seguir el ritmo, y los modelos de lenguaje de propósito general a menudo interpretan mal términos técnicos o pasan por alto relaciones sutiles que son relevantes para decisiones del mundo real.

Enseñar a los grandes modelos de lenguaje una nueva especialidad

Para abordar esto, el estudio afina un modelo base potente con un conjunto de datos diseñado cuidadosamente y específico del dominio. El conjunto toma como fuente comunicaciones de mando, manuales de equipo, escenarios simulados y literatura experta. Antes de que cualquiera de estos materiales llegue al modelo, se desensibiliza intensamente: coordenadas concretas se convierten en ubicaciones relativas, nombres de unidades pasan a códigos genéricos y la lógica sensible se enmascara parcialmente preservando los patrones generales. Los datos se almacenan en un formato estructurado que describe la situación global, las tareas específicas (como planificación, clasificación de amenazas o respuesta a preguntas) y los vínculos entre ellas. Esta estructura permite que el modelo aprenda no solo hechos aislados, sino también cómo distintas tareas comparten contexto.

Capas de adaptación para distintas tareas

En lugar de reentrenar cada parámetro del modelo de lenguaje—un proceso costoso y arriesgado—los autores usan una técnica llamada adaptación de bajo rango, organizada en varias capas que se centran en diferentes aspectos del problema. Una capa captura la terminología y los conceptos básicos, otra incorpora reglas y restricciones operativas, y una tercera se especializa en adaptarse a tareas particulares, como la planificación o la evaluación de amenazas. Un componente de control separado, la red de «enrutamiento», examina cada pieza de entrada y decide qué combinación de estos adaptadores ligeros debe usar el modelo. Este diseño permite al sistema cambiar de tarea de forma eficiente conservando tanto la capacidad lingüística general como la pericia específica del dominio.

Construir y verificar la red de conocimiento

Sobre el modelo afinado, los autores diseñan una canalización híbrida para construir el grafo de conocimiento en sí. Primero, los datos crudos se limpian y estandarizan para que términos y formatos sean consistentes. Luego, métodos basados en reglas y plantillas elaboradas por expertos extraen las entidades y eventos más evidentes. El modelo de lenguaje afinado interviene para manejar trabajos más complejos: sintetizar informes desordenados en resúmenes concisos, identificar actores clave y equipos, e inferir relaciones como cadenas de causa y efecto o coordinación entre unidades. Cada hecho extraído se puntúa desde varios ángulos—qué tan bien encaja con patrones conocidos, qué tan sólidamente se conecta con otros hechos y si se alinea con rutas de razonamiento de varios pasos a través del grafo. Solo se añaden los resultados de alta confianza, y los de baja confianza se marcan para revisión.

Mejoras comprobadas en precisión y fiabilidad

El equipo evalúa su enfoque en tres tareas centrales que reflejan necesidades del mundo real: responder preguntas complejas sobre normas y equipos, proponer planes de acción para situaciones dadas y clasificar distintos escenarios de amenaza por gravedad. En estas tareas, el modelo adaptado supera de forma consistente a sistemas generales bien conocidos, incluidos modelos de última generación con entrenamiento mucho más genérico. Responde más preguntas correctamente, produce planes más realistas y clasifica las amenazas con mayor precisión. El grafo de conocimiento resultante es a la vez grande y altamente conectado, con más del 90 por ciento de sus hechos almacenados superando controles de confianza estrictos y ayudando a los planificadores a tomar decisiones acertadas más rápidamente.

Por qué esto importa de cara al futuro

Para un lector no especialista, el mensaje clave es que los modelos de lenguaje pueden transformarse de hábiles conversadores en analistas cuidadosos y especializados—si se entrenan con los datos adecuados, se constriñen con reglas claras y se verifican constantemente por calidad. Este trabajo muestra cómo hacerlo en un dominio sensible y de rápida evolución mientras se protege la información privada. El marco no solo organiza el conocimiento disperso en una red utilizable, sino que también mantiene esa red actualizada y fiable, ofreciendo un plan para futuros sistemas de apoyo a la decisión en cualquier campo donde acertar en decisiones complejas realmente importe.

Cita: Peng, L., Yang, P., Juexiang, Y. et al. The construction and refined extraction techniques of knowledge graph based on large language models. Sci Rep 16, 8104 (2026). https://doi.org/10.1038/s41598-026-38066-w

Palabras clave: grafo de conocimiento, gran modelo de lenguaje, apoyo a la decisión, adaptación de dominio, desensibilización de datos