Clear Sky Science · es

APMSR: un sistema inteligente de preguntas y respuestas para biología sintética potenciado por prompting adaptativo y recuperación de conocimiento multisource

Respuestas más inteligentes para una nueva clase de biología

La biología sintética promete combustibles más limpios, fábricas más ecológicas y nuevos tratamientos médicos, pero la ciencia avanza tan deprisa que incluso los expertos tienen dificultades para mantenerse al día. Este estudio presenta APMSR, un sistema inteligente de preguntas y respuestas diseñado para ayudar a los investigadores a encontrar rápidamente respuestas fiables sobre un microbio clave para biocombustibles, Zymomonas mobilis. Al combinar modelos de lenguaje grande con fuentes seleccionadas cuidadosamente, tanto en línea como locales, el sistema pretende ofrecer respuestas precisas y actualizadas en lugar de conjeturas seguras pero incorrectas.

El reto de formular buenas preguntas

Los científicos ya dependen de motores de búsqueda y bases de datos en línea, pero estas herramientas a menudo devuelven largas listas de artículos en lugar de respuestas directas. Los modelos de lenguaje grande (LLM) pueden hablar con fluidez sobre muchos temas, sin embargo, en campos de rápido movimiento como la biología sintética pueden pasar por alto descubrimientos recientes o incluso inventar información. Los autores se centran en el problema práctico de responder preguntas a nivel experto sobre Z. mobilis, una bacteria apreciada por convertir azúcares en etanol de forma eficiente. En este contexto, las respuestas erróneas no solo son molestas: pueden desviar experimentos e inversiones en la dirección equivocada.

Orientar la IA con las instrucciones adecuadas

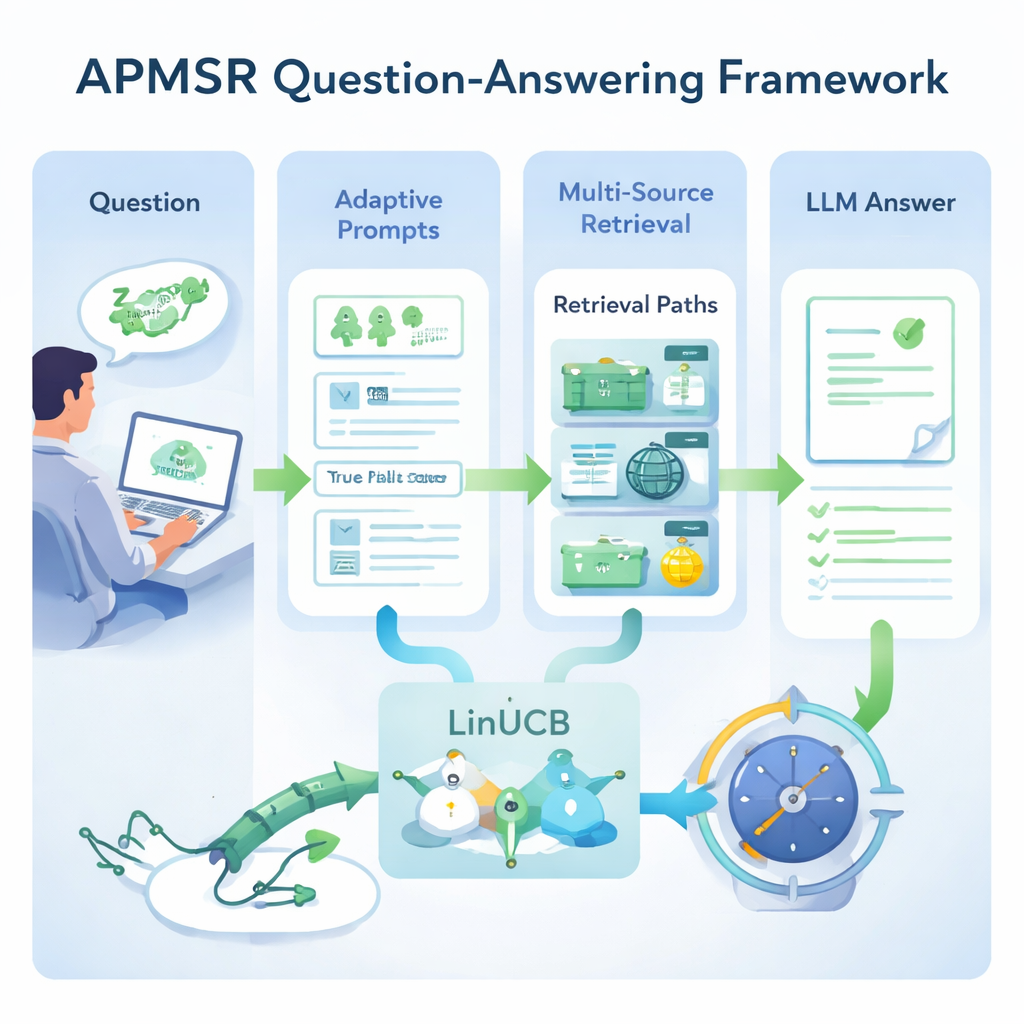

Una idea central en APMSR es que cómo se le pide algo al modelo importa tanto como qué se le pide. En lugar de usar una instrucción única y fija, el sistema primero pide al LLM que identifique qué tipo de pregunta está viendo —por ejemplo, un ítem de opción múltiple o una afirmación de verdadero/falso. Una vez reconocido el tipo, APMSR selecciona automáticamente una “plantilla de prompt” correspondiente que indica al modelo cómo razonar y cómo formatear su respuesta. Las preguntas de opción múltiple, por ejemplo, se inducen a comparar las opciones con cuidado, mientras que las de verdadero/falso se encaminan a verificar la corrección de una afirmación y a explicar por qué. Este prompting adaptativo ayuda a mantener el modelo enfocado y reduce las respuestas divagantes o fuera de tema.

Elegir el mejor lugar para buscar hechos

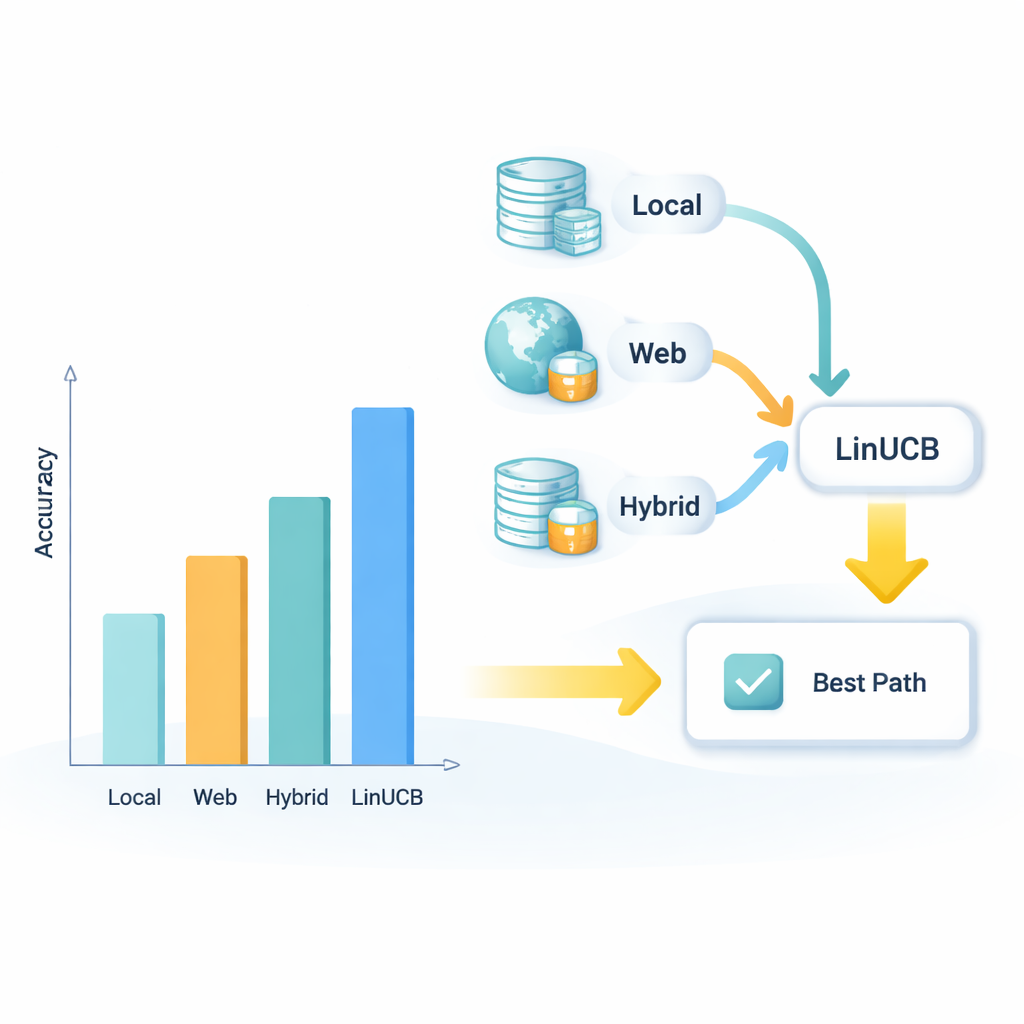

Unas buenas instrucciones por sí solas no bastan; el sistema también debe mirar en los sitios correctos. APMSR se conecta a tres tipos de fuentes de información: una biblioteca local de artículos científicos curados, recursos web en vivo y un híbrido que fusiona ambos. Para cada consulta de usuario, el sistema trata estas tres opciones como “caminos” en competencia y usa una estrategia matemática llamada LinUCB, desarrollada originalmente para equilibrar riesgo y recompensa en problemas de toma de decisiones. LinUCB puntúa qué tan bien parece funcionar cada camino en base a preguntas previas y sus resultados, y luego selecciona el camino con mayor probabilidad de proporcionar una respuesta correcta mientras todavía prueba alternativas de vez en cuando. Con el tiempo, este bucle de retroalimentación enseña al sistema qué combinaciones de fuentes suelen ser más fiables para diferentes estilos de preguntas.

Poner el sistema a prueba

Para comprobar si estas ideas realmente ayudan, el equipo construyó un conjunto de prueba especializado de 220 preguntas de nivel experto sobre Z. mobilis, divididas por igual entre formatos de opción múltiple y verdadero/falso, todas derivadas de estudios revisados por pares. Compararon tres configuraciones: un LLM desnudo sin documentos externos, un sistema estándar aumentado con recuperación usando solo una base de datos local, y su diseño completo APMSR. La precisión aumentó del 54% del modelo desnudo al 80% con recuperación estándar, y luego al 93% una vez añadidos los prompts adaptativos y el selector de caminos basado en LinUCB. El sistema optimizado también superó a un modelo existente centrado en biología sintética llamado SynBioGPT por aproximadamente 19 puntos porcentuales, lo que sugiere que una orquestación inteligente de prompts y recuperación puede importar más que simplemente entrenar un modelo más grande.

Qué significa esto para el trabajo futuro en laboratorio

Para los no especialistas, la conclusión principal es que los autores han construido una especie de “copiloto de investigación” que no solo se expresa con fluidez, sino que además sabe cuándo comprobar múltiples fuentes y cómo estructurar su propio razonamiento. Al afinar tanto la forma en que se plantean las preguntas como la forma en que se recopila la información, APMSR reduce drásticamente las respuestas engañosas en un campo complejo y en rápida evolución. Aunque el sistema actual se centra en un único microbio y en preguntas tipo cuestionario, el mismo enfoque podría extenderse a áreas más amplias de la biología y más allá, ayudando a científicos, ingenieros y quizá en el futuro a clínicos a formular mejores preguntas y recibir respuestas de IA más fiables.

Cita: Wang, J., Cao, Z., Tian, Z. et al. APMSR: an intelligent QA system for synthetic biology empowered by adaptive prompting and multi-source knowledge retrieval. Sci Rep 16, 7331 (2026). https://doi.org/10.1038/s41598-026-38006-8

Palabras clave: biología sintética, respuesta a preguntas, modelos de lenguaje grande, generación aumentada por recuperación, Zymomonas mobilis