Clear Sky Science · es

Enfoque estable basado en diagonal para redes neuronales cuánticas recurrentes en la identificación de sistemas no lineales

Enseñar a las máquinas a comprender sistemas desordenados

Muchos de los sistemas que dan forma a nuestra vida —desde motores eléctricos en electrodomésticos hasta el flujo de aire turbulento e incluso algunos procesos médicos— se comportan de forma compleja y no lineal. Eso significa que pequeños cambios en sus entradas pueden producir respuestas sorprendentemente grandes o caóticas. Predecir y controlar estos sistemas es difícil, pero vital para la eficiencia, la seguridad y el ahorro de energía. Este artículo presenta un nuevo tipo de máquina de aprendizaje que combina ideas de la computación cuántica, las redes neuronales y la teoría de la estabilidad para modelar estos comportamientos complejos con mayor precisión y fiabilidad.

Por qué los modelos ordinarios se quedan cortos

Las herramientas de modelado tradicionales a menudo asumen que causa y efecto son ordenados y proporcionales, lo que funciona bien para sistemas simples o casi lineales. Pero muchos sistemas reales tienen memoria, retroalimentación y umbrales que hacen que su comportamiento sea altamente no lineal. Las redes neuronales clásicas han ayudado, pero traen sus propios problemas. Las redes feed-forward, donde la información viaja en una sola dirección, son buenas para tareas estáticas pero luchan cuando las señales pasadas importan. Las redes recurrentes, que retroalimentan la información para crear memoria, pueden captar comportamientos variables en el tiempo, pero tienden a ser difíciles de entrenar, propensas a la inestabilidad y computacionalmente costosas cuando cada neurona se conecta con todas las demás.

Mezclando ideas cuánticas con bucles simples

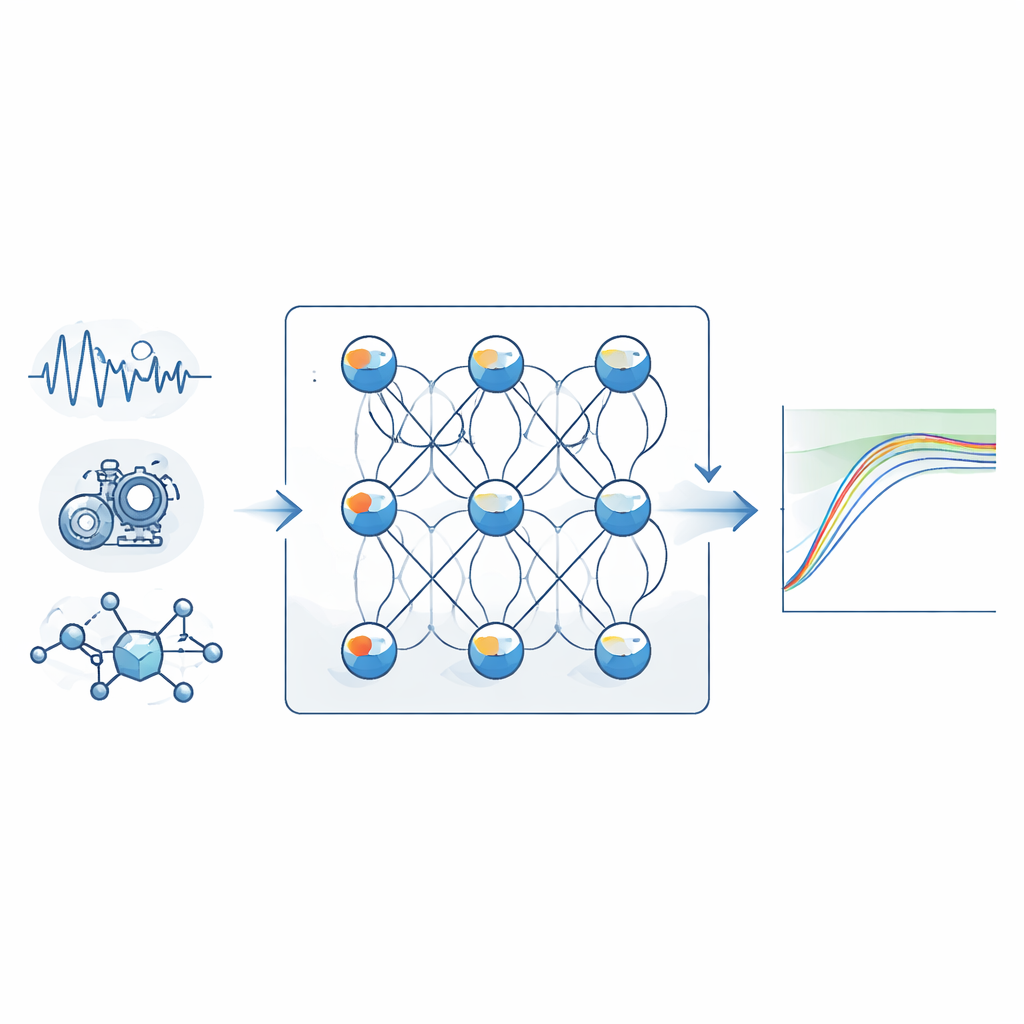

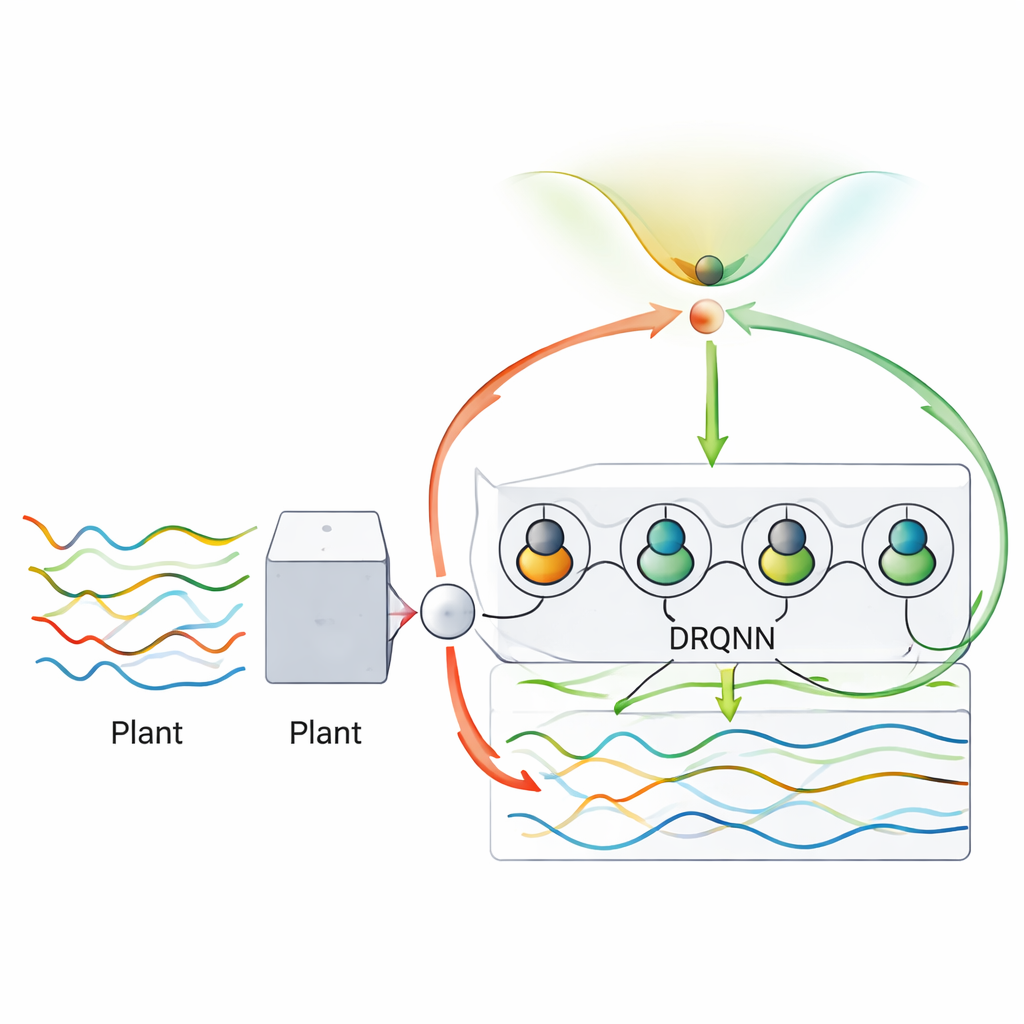

Los autores proponen una red neuronal cuántica recurrente diagonal con estabilidad de Lyapunov, abreviada DRQNN-LS. En su núcleo, esta red todavía se parece a una red neuronal de tres capas conocida: entradas, una capa oculta y una salida. Pero dos giros la hacen especial. Primero, las unidades ocultas se comportan como bits cuánticos simplificados, cuyos estados internos se describen usando cantidades similares a fases en lugar de números simples. Esta representación inspirada en la cuántica permite que cada unidad codifique información más rica de forma compacta, mejorando la capacidad de la red para aproximar relaciones complejas. Segundo, en lugar de una maraña de enlaces de retroalimentación, cada neurona oculta solo se retroalimenta a sí misma. Esta recurrencia “diagonal” conserva la memoria necesaria para seguir patrones temporales mientras reduce drásticamente el número de conexiones que deben ajustarse.

Mantener el aprendizaje estable y bajo control

Un reto importante al entrenar cualquier red recurrente es mantener el aprendizaje estable: si los pesos cambian con demasiada agresividad, la salida del modelo puede explotar u oscilar; si cambian demasiado despacio, el entrenamiento tarda una eternidad y puede atascarse. Aquí los autores se apoyan en la teoría de estabilidad de Lyapunov, un marco matemático desarrollado originalmente para analizar la seguridad de sistemas físicos. Construyen una función especial, similar a una energía, que combina el error de modelado y el tamaño de los parámetros de la red. Al derivar cuidadosamente cómo cambia esta función en el tiempo, obtienen reglas automáticas para actualizar los pesos y los parámetros internos de la red de modo que la “energía” global solo pueda disminuir. Esto produce tasas de aprendizaje adaptativas que se aceleran o desaceleran por sí mismas, garantizando la convergencia sin necesidad de ajuste manual.

Poniendo a prueba la nueva red

Para demostrar que DRQNN-LS es más que una buena idea sobre el papel, los autores la prueban en tres tareas muy diferentes. Primero, modelan un sistema no lineal matemático con comportamiento conocido, comprobando qué tan cerca puede seguir la red su salida. Segundo, abordan el mapa de Henon caótico, un referente clásico donde pequeños cambios en las condiciones iniciales pueden producir trayectorias radicalmente distintas. Tercero, aplican el método a datos reales de un pequeño motor de corriente continua, un dispositivo ruidoso y práctico cuyos mecanismos internos no se conocen completamente. En cada caso comparan el nuevo enfoque con varios modelos neuronales existentes, incluidas redes recurrentes diagonales clásicas y versiones anteriores inspiradas en la cuántica entrenadas con reglas gradiente más simples.

Mejor precisión, robustez y tolerancia al ruido

En los tres ejemplos, DRQNN-LS produce de forma consistente errores de predicción más bajos y un mejor ajuste a las señales reales que los métodos competidores, incluso cuando los datos se corrompen deliberadamente con ruido considerable. Aunque el nuevo modelo requiere algo más de cómputo por paso —porque rastrea estados recurrentes de inspiración cuántica y evalúa la actualización basada en Lyapunov—, los tiempos de ejecución siguen siendo lo bastante pequeños para el uso en tiempo real en procesadores modernos. Los resultados sugieren que combinar una estructura recurrente simplificada, estados de neuronas al estilo cuántico y aprendizaje matemáticamente garantizado como estable produce una herramienta potente y práctica para entender y predecir dinámicas no lineales en el mundo real.

Qué implica esto de cara al futuro

Para los no especialistas, la conclusión es que estamos aprendiendo a construir gemelos digitales más inteligentes y confiables de sistemas físicos desordenados. DRQNN-LS ofrece una forma para que una máquina aprenda el comportamiento de un proceso complejo directamente a partir de datos, asegurando a la vez que su aprendizaje no “se dispare” ni divague de forma impredecible. Esa combinación de flexibilidad y estabilidad podría resultar valiosa en campos que van desde el control industrial y la robótica hasta los sistemas de energía y, quizás, el modelado biológico o médico, donde el comportamiento no lineal y las mediciones ruidosas son la norma.

Cita: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Palabras clave: identificación de sistemas no lineales, red neuronal cuántica, red neuronal recurrente, estabilidad de Lyapunov, modelado de dinámicas caóticas