Clear Sky Science · es

Un marco de aprendizaje profundo para el diagnóstico del cáncer de mama mediante Swin Transformer y la Red de Fusión Multiescala con Doble Atención

Por qué esto importa para pacientes y médicos

El cáncer de mama es uno de los tumores más comunes en mujeres, y las mamografías son la herramienta principal para detectarlo de forma temprana. Sin embargo, interpretar estas radiografías es difícil, incluso para expertos, y los indicios sutiles pueden pasarse por alto. Este estudio presenta un nuevo sistema de inteligencia artificial (IA) diseñado para ayudar a los radiólogos a identificar el cáncer de mama con mayor fiabilidad mediante la combinación de dos formas potentes de “mirar” las mamografías: una que capta la visión global y otra que amplía los detalles minúsculos.

El reto de ver tanto el bosque como los árboles

Los sistemas de IA modernos ya asisten en la lectura de imágenes médicas, pero la mayoría se basa en un solo tipo de modelo. Las redes neuronales convolucionales son eficaces para detectar patrones locales, como bordes definidos o pequeños puntos brillantes. Los vision transformers, una familia más reciente de modelos, destacan por comprender las relaciones a lo largo de toda la imagen. Las mamografías, no obstante, requieren ambas capacidades a la vez: el cáncer puede manifestarse como diminutas calcificaciones o sutiles distorsiones y su significado depende de cómo esos signos encajan en la estructura general del pecho. Al mismo tiempo, los conjuntos de datos reales de mamografía suelen ser relativamente pequeños y desequilibrados, con muchos menos casos cancerosos que exámenes normales, lo que facilita que los sistemas de IA sobreajusten o adquieran sesgos.

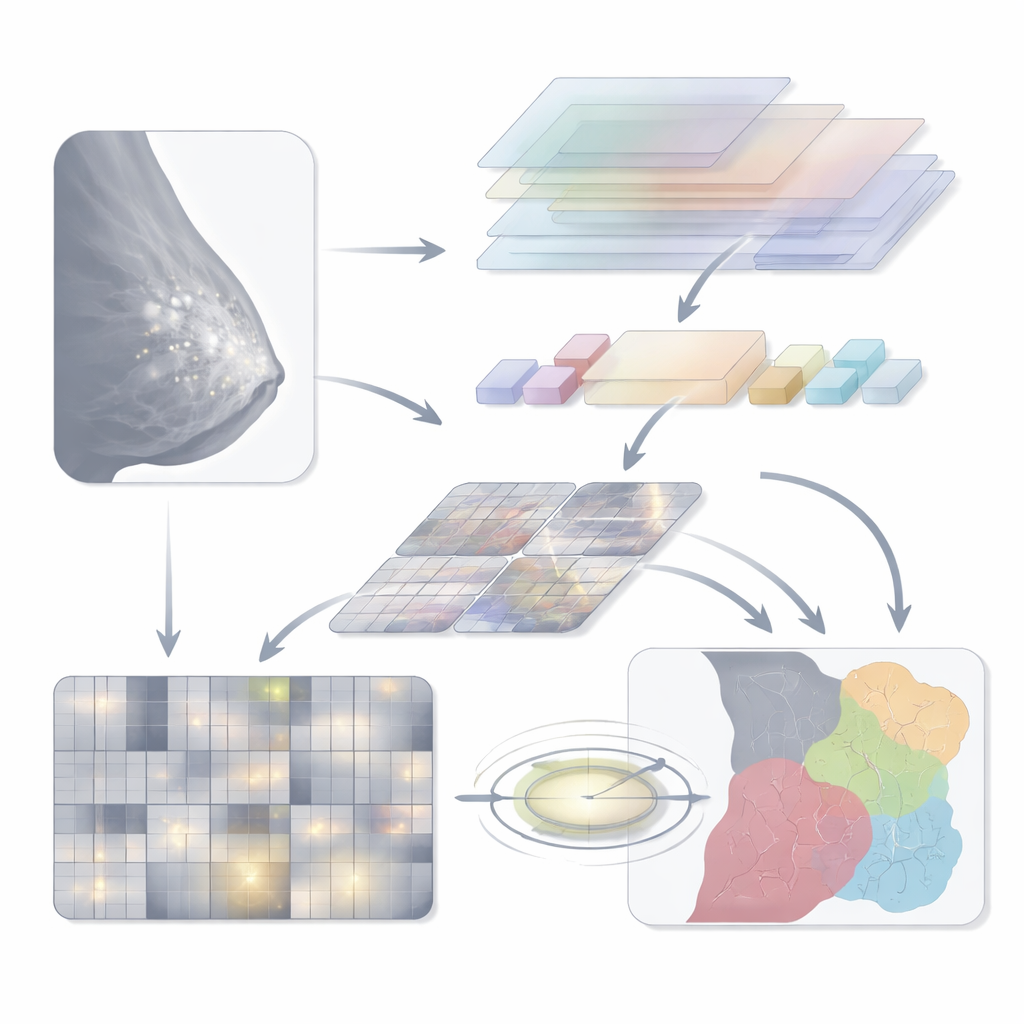

Una IA de dos vías que ve en amplio y en detalle

Los autores presentan un modelo híbrido que denominan Swin‑DAMFN, diseñado explícitamente para fusionar visión global y local. Una rama se basa en el Swin Transformer, que divide la mamografía en ventanas y utiliza un mecanismo de atención para capturar contexto de largo alcance: cómo se relacionan las distintas partes del pecho entre sí. La segunda rama es una red convolucional personalizada, la Red de Fusión Multiescala con Doble Atención (DAMFN). Esta rama está afinada para captar detalles extremadamente finos, como microcalcificaciones y pequeñas distorsiones del tejido. En su interior, bloques especializados analizan la imagen a múltiples escalas y direcciones, y luego emplean módulos de atención para enfatizar las regiones que parecen más informativas clínicamente mientras atenúan el tejido de fondo.

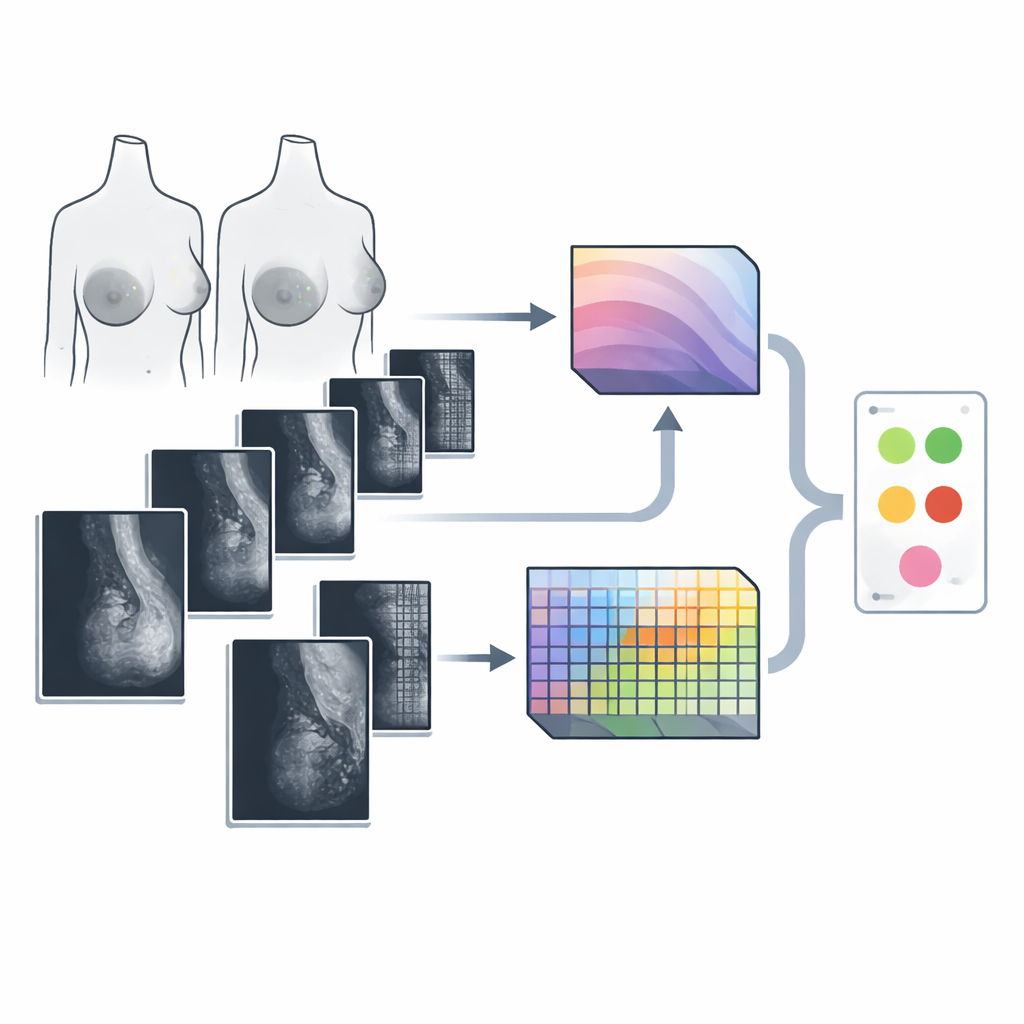

Enseñar al sistema con más y mejores imágenes

Dado que los conjuntos de mamografías reales son limitados y están sesgados hacia casos no cancerosos, los investigadores reforzaron los datos de entrenamiento de dos maneras complementarias. Primero, emplearon un tipo de modelo generativo llamado GAN condicional para sintetizar parches de mamografías realistas, especialmente para las categorías malignas poco representadas. Estas imágenes generadas ayudan a equilibrar las clases y a exponer al modelo a más variaciones en la apariencia de la enfermedad. Segundo, aplicaron cambios fotométricos—pequeños ajustes aleatorios en brillo, contraste y nitidez—a imágenes reales y sintéticas. Esto obliga a la IA a centrarse en patrones anatómicos reales en lugar de en variaciones superficiales de iluminación o ruido, mejorando su capacidad para generalizar a exploraciones nuevas.

Cómo encajan las piezas durante el diagnóstico

Durante el análisis, una mamografía preprocesada se alimenta simultáneamente a ambas ramas. El Swin Transformer produce un resumen compacto de la estructura global, mientras que DAMFN ofrece un mapa rico en características locales. Estos se alinean en tamaño y se fusionan en una sola representación. Un bloque ligero de “atención triplete” refina aún más esta fusión comprobando de forma cruzada canales y dimensiones espaciales, orientando el foco del modelo hacia las áreas con mayor probabilidad de contener enfermedad. Finalmente, una cabeza de clasificación sencilla promedia la información y genera una predicción entre varias clases, como tejido normal, hallazgos benignos o distintos tipos de lesiones malignas.

Qué significan los resultados en la práctica

El equipo evaluó Swin‑DAMFN en dos conjuntos de datos públicos ampliamente utilizados, CBIS‑DDSM y MIAS, y lo comparó con muchos modelos de aprendizaje profundo populares. Su sistema alcanzó alrededor del 99 % de precisión en CBIS‑DDSM y casi el 99 % en MIAS, con sensibilidades (capacidad para detectar cánceres) y especificidades (evitar falsas alarmas) igualmente altas. Estudios de ablación cuidadosos mostraron que cada componente—las ramas duales, la fusión basada en atención y la estrategia de aumento de datos—contribuyó a estas mejoras. Aunque los autores señalan que aún se necesita validación más amplia con datos hospitalarios diversos, los hallazgos sugieren que sistemas híbridos de IA como Swin‑DAMFN podrían convertirse en asistentes valiosos para el cribado del cáncer de mama, ayudando a los radiólogos a detectar lesiones peligrosas antes y con mayor consistencia, a la vez que reducen la carga de trabajo e incertidumbre.

Cita: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Palabras clave: cáncer de mama, mamografía, aprendizaje profundo, modelos transformer, IA en imagen médica