Clear Sky Science · es

Detección de objetos en tiempo real para vehículos aéreos no tripulados basada en vision transformer y computación en el borde

Ojos más inteligentes en el cielo

Los vehículos aéreos no tripulados —drones— se están convirtiendo rápidamente en herramientas habituales para tareas como inspeccionar puentes, monitorizar el tráfico y buscar personas desaparecidas. Pero para que un dron sea realmente útil en estas labores críticas, debe hacer más que grabar: tiene que reconocer objetos pequeños en tiempo real mientras vuela con una batería limitada y un pequeño ordenador a bordo. Este artículo presenta una nueva forma de dotar a los drones de una “vista” más nítida y rápida combinando una técnica de IA avanzada llamada vision transformer con el uso inteligente de servidores de borde cercanos, de modo que objetos pequeños como peatones, bicicletas y automóviles puedan detectarse con rapidez y fiabilidad desde el aire.

Por qué a los drones les cuesta ver detalles pequeños

Desde gran altura, personas y vehículos pueden reducirse a apenas unas decenas de píxeles en un fotograma. Los sistemas de redes neuronales tradicionales empleados en drones están diseñados para ejecutarse con rapidez en chips de bajo consumo, pero a menudo pasan por alto estos objetos diminutos o fallan cuando cambian la iluminación o el ángulo de visión. Los modelos más recientes basados en vision transformer, tomados prestados del procesamiento de lenguaje, son mucho mejores captando la escena en su conjunto y distinguiendo pequeños detalles en fondos complejos. El problema es que suelen exigir una gran potencia de cálculo, muy por encima de lo que una plataforma voladora puede acarrear. Los autores se propusieron cerrar esta brecha: conservar la visión precisa del transformer, pero hacerlo lo suficientemente ligero para ejecutarse en tiempo real en un dron, y derivar trabajo adicional a un servidor de borde cercano solo cuando las condiciones lo permitan.

Una mente partida: dron y borde trabajando juntos

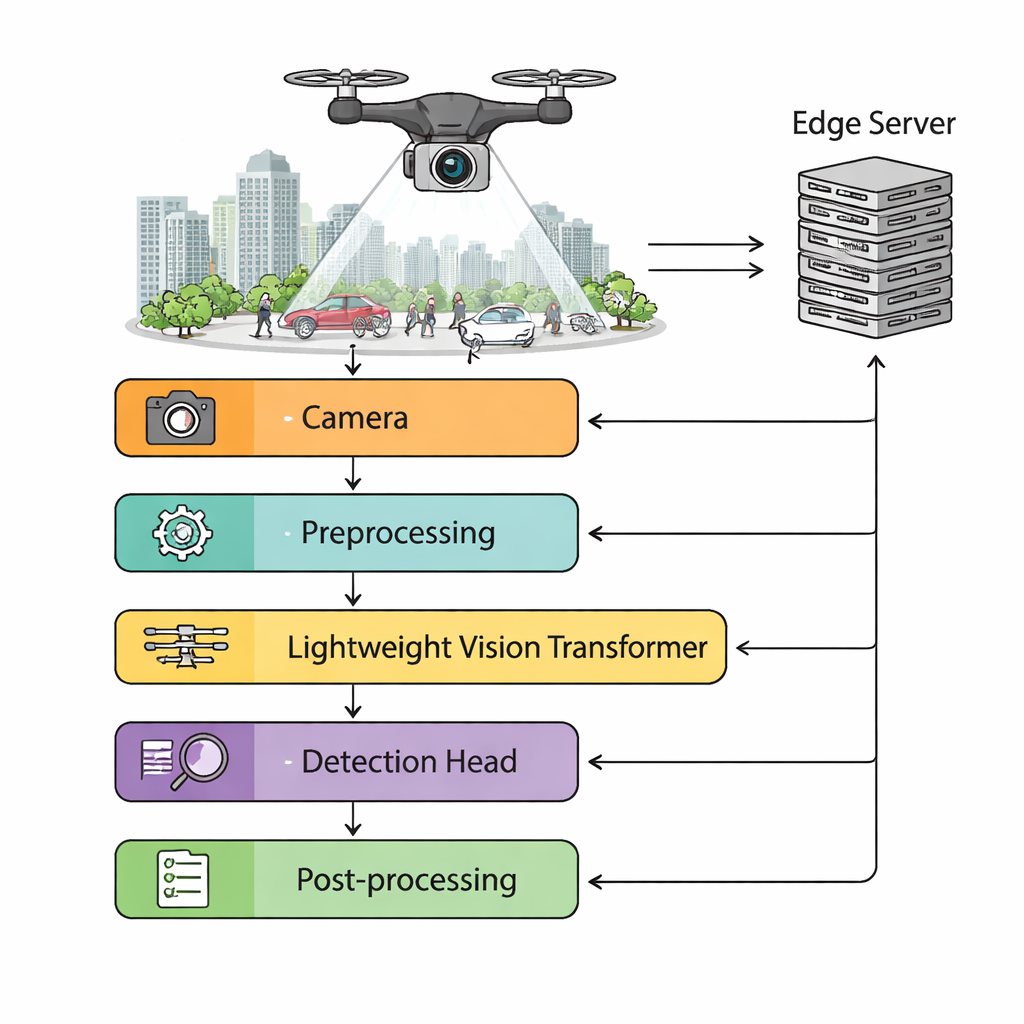

El marco propuesto reparte el trabajo entre el dron y un ordenador de borde en tierra. La cámara del dron transmite vídeo en alta definición a un módulo de preprocesamiento a bordo que estabiliza la imagen temblorosa, ajusta el brillo y redimensiona dinámicamente las imágenes según la potencia de cálculo disponible. Un vision transformer ligero extrae características ricas de cada fotograma y alimenta una cabeza de detección que predice dónde están los objetos y qué son. Un programador supervisa la latencia de la red inalámbrica, el nivel de batería y la carga de procesamiento. Cuando el enlace con tierra es rápido y estable, tareas más costosas —como procesar lotes de fotogramas o ejecutar modelos adicionales para aumentar la precisión— pueden trasladarse al servidor de borde. Cuando la conexión se degrada, el sistema cambia automáticamente a procesamiento completamente autónomo a bordo para que el dron nunca tenga que “volar a ciegas”.

Recortar el modelo sin perder visión

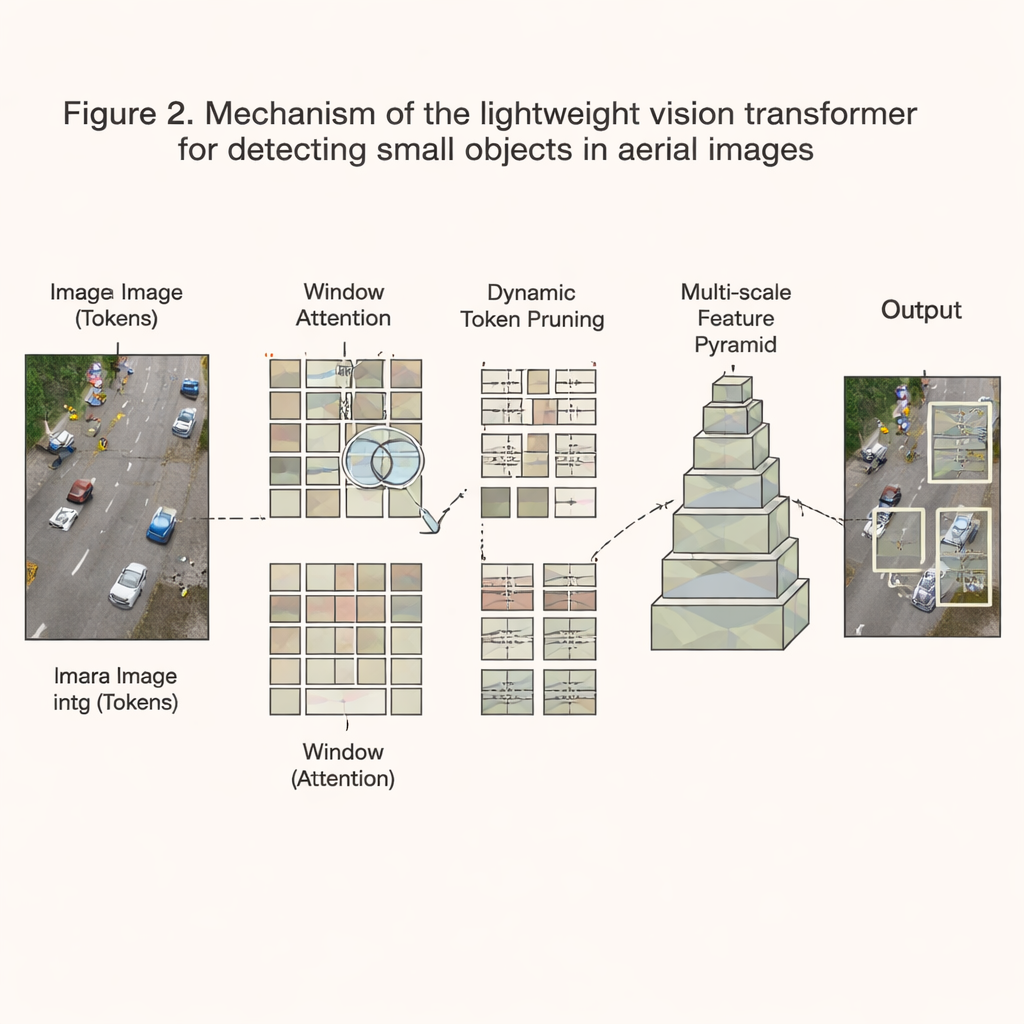

Para hacer el transformer lo bastante pequeño y rápido, los autores rediseñan su funcionamiento interno. En lugar de permitir que cada parte de la imagen se compare con todas las demás —un proceso que crece de forma explosiva con la resolución— restringen la atención a ventanas locales que se deslizan por la imagen, reduciendo así el coste computacional a niveles manejables. Además, un esquema dinámico de poda evalúa constantemente qué regiones de la imagen contienen información útil y cuáles son mayormente fondo vacío. Los tokens considerados poco informativos se descartan pronto, ahorrando tiempo y memoria, mientras que las escenas complejas y con mucho ruido conservan más detalle. El modelo también construye una pirámide de características a múltiples escalas para que tanto peatones diminutos como vehículos más grandes puedan detectarse en el mismo fotograma. Combinado con una cuantización cuidadosa (usando menos bits por número), poda de canales y optimizaciones de software a bajo nivel, estos cambios reducen las operaciones requeridas en alrededor de dos tercios mientras preservan más del 94 % de la precisión original.

Poniendo el sistema a prueba

El equipo evalúa su diseño en un gran conjunto de datos aéreo ensamblado a partir de benchmarks públicos de drones y miles de imágenes recién recopiladas sobre ciudades, suburbios y zonas rurales en diferentes estaciones y condiciones de iluminación. En un ordenador embebido popular en drones, el NVIDIA Jetson Xavier NX, su sistema funciona a unos 39 fotogramas por segundo —suficiente para operación en tiempo real— mientras logra mayor precisión que detectores ligeros ampliamente usados, como variantes de YOLO. En particular, es significativamente mejor detectando objetos pequeños, con una ganancia de aproximadamente siete puntos porcentuales en precisión media respecto a redes convolucionales convencionales. Ensayos de campo de una semana en una plataforma comercial de drones muestran que el sistema mantiene el rendimiento pese a la vibración de la cámara, cambios de iluminación y fluctuaciones en la conectividad inalámbrica, y que puede cambiar de modo asistido por el borde a completamente a bordo de forma fluida durante vuelos reales.

Qué significa esto para misiones reales con drones

En términos sencillos, este trabajo demuestra que es posible dotar a los drones de una visión más nítida y fiable sin acoplarles un ordenador del tamaño de un centro de datos. Al rediseñar el vision transformer para que sea esbelto, enfocándose selectivamente en las partes más informativas de cada imagen y asociando el dron con un servidor de borde cercano cuando es posible, los autores entregan un detector que ve más, falla menos y aún así funciona en tiempo real dentro de estrictos presupuestos de energía y memoria. Esto hace que tareas como búsqueda y rescate, evaluación de desastres e inspección de infraestructuras sean más seguras y eficaces, porque los drones pueden distinguir mejor detalles pequeños y críticos —como una persona varada o un cable dañado— justo cuando cada segundo cuenta.

Cita: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Palabras clave: drones, detección de objetos, computación en el borde, vision transformer, imágenes en tiempo real