Clear Sky Science · es

Marco de aprendizaje por refuerzo adaptativo para la optimización sostenible de microrredes en entornos urbanos áridos

Mantener las luces encendidas en una ciudad del desierto

Imagine gestionar una ciudad moderna donde los días de verano superan regularmente los 40 °C, los aires acondicionados funcionan a toda potencia y las líneas eléctricas se esfuerzan por abastecer la demanda. Esa es la vida cotidiana en lugares como Riad, Arabia Saudí. Este artículo explora cómo un nuevo tipo de sistema de control inteligente, inspirado en la forma en que los ordenadores aprenden a jugar videojuegos complejos, puede coordinar paneles solares, turbinas eólicas, baterías, generadores diésel y la red principal para abastecer una ciudad así de forma más económica y con menos contaminación.

Por qué importan las redes eléctricas pequeñas

En lugar de depender únicamente de grandes plantas eléctricas lejanas, muchas ciudades recurren a «microrredes»: redes locales pequeñas que combinan distintas fuentes de energía e incluso pueden compartir electricidad con sus vecinas. En regiones cálidas y secas esto es especialmente importante: la demanda de refrigeración sube y baja con el tiempo, la energía solar llega en picos durante el día y el viento puede ser débil o impredecible. Los sistemas de control tradicionales tienden a seguir reglas o horarios fijos y no reaccionan bien ante cambios bruscos, como un pico en el uso del aire acondicionado o un día de polvo que bloquea el sol. El resultado es energía limpia desperdiciada, más combustible quemado en generadores diésel y facturas más altas.

Un cerebro que aprende para el sistema eléctrico

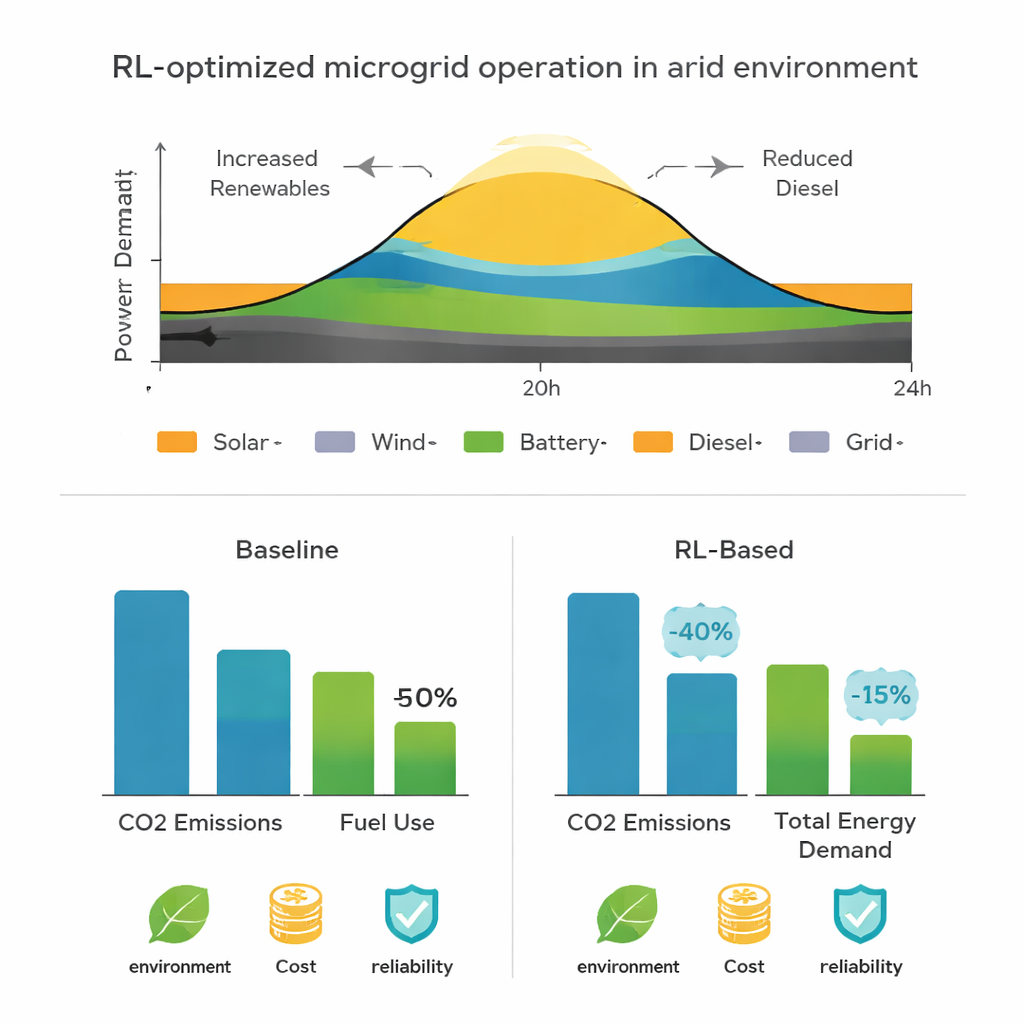

Los investigadores construyeron un modelo informático detallado de cinco microrredes interconectadas que representan edificios y distritos típicos de Riad—viviendas grandes y pequeñas, manzanas de usos mixtos y zonas comerciales. Cada microrred tenía su propia mezcla de paneles solares, pequeñas turbinas eólicas, respaldo diésel y almacenamiento en baterías, además de un enlace a la red eléctrica mayor. Usando software de energía en edificios (EnergyPlus), generaron datos hora por hora durante un año completo: consumo eléctrico, temperatura, radiación solar y velocidad del viento. Sobre esto añadieron un “agente” de aprendizaje por refuerzo—un cerebro de software que observa el estado del sistema (demanda, carga de baterías, disponibilidad de sol y viento, estado de los generadores) y decide qué hacer a continuación: cargar o descargar baterías, encender o apagar generadores diésel, importar o exportar energía y compartir electricidad entre microrredes.

Cómo el sistema aprende a tomar mejores decisiones

El aprendizaje por refuerzo funciona por ensayo y error. En la simulación, el agente prueba distintas acciones de control hora a hora y recibe una recompensa o penalización según lo que ocurre. La recompensa combina tres ideas simples: mantener bajos los costes, asegurar el suministro y evitar desperdiciar o ignorar la energía renovable. Si sus decisiones conllevan uso caro de diésel, cortes de energía o energía solar sin aprovechar, el agente recibe una penalización. Si logra cubrir la demanda con más sol y viento, menos emisiones y operación estable, recibe una recompensa. Tras decenas de miles de rondas de entrenamiento, el agente descubre gradualmente estrategias que equilibran estos objetivos. Una vez entrenado, puede tomar decisiones en tiempo real en apenas unos milisegundos.

Qué pasa cuando el desierto responde agresivamente

Para evaluar si este enfoque realmente ayuda en un clima extremo, el equipo lo probó bajo condiciones realistas y estresantes. El modelo reprodujo las variaciones estacionales de Riad, con fuerte demanda de refrigeración en verano y cargas más suaves en invierno. El controlador basado en aprendizaje siguió con precisión el consumo horario y anual (explicando alrededor del 90–94% de la variación), lo cual es crucial para anticipar picos. Redujo las pérdidas energéticas en un día típico y desplazó más del suministro hacia solar y eólica, usando baterías para suavizar los huecos. Cuando los investigadores simularon eventos como una tormenta de polvo que reduce de golpe la generación solar o una ola de calor que eleva fuertemente la demanda, el sistema respondió descargando baterías, coordinando el uso de diésel y compartiendo el excedente entre microrredes—todo sin dejar a los usuarios sin suministro.

Aire más limpio y facturas más bajas

Más allá de mantener el suministro, el estudio examinó el impacto ambiental mediante un análisis del ciclo de vida centrado en la operación diaria. En comparación con una configuración tradicional basada en reglas, el sistema adaptativo redujo las emisiones de dióxido de carbono en aproximadamente un 14%, disminuyó la contaminación formadora de ácido en torno a un 14% y abarató el consumo energético total en cerca de un 10%. Estas mejoras provienen principalmente de un menor uso de generadores diésel y de un mejor aprovechamiento de la energía renovable y del almacenamiento local. En términos sencillos, dotar a la microrred de un «cerebro» que aprende le permitió extraer más trabajo útil de cada unidad de energía limpia, depender menos del combustible y seguir siendo fiable incluso cuando el clima del desierto actúa en contra.

Cita: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Palabras clave: microrredes, aprendizaje por refuerzo, energía renovable, gestión energética, ciudades áridas