Clear Sky Science · es

Planificación de trayectorias autónoma para imágenes ecográficas intercostales con robótica mediante aprendizaje por refuerzo

Robots que ayudan a los médicos a ver entre las costillas

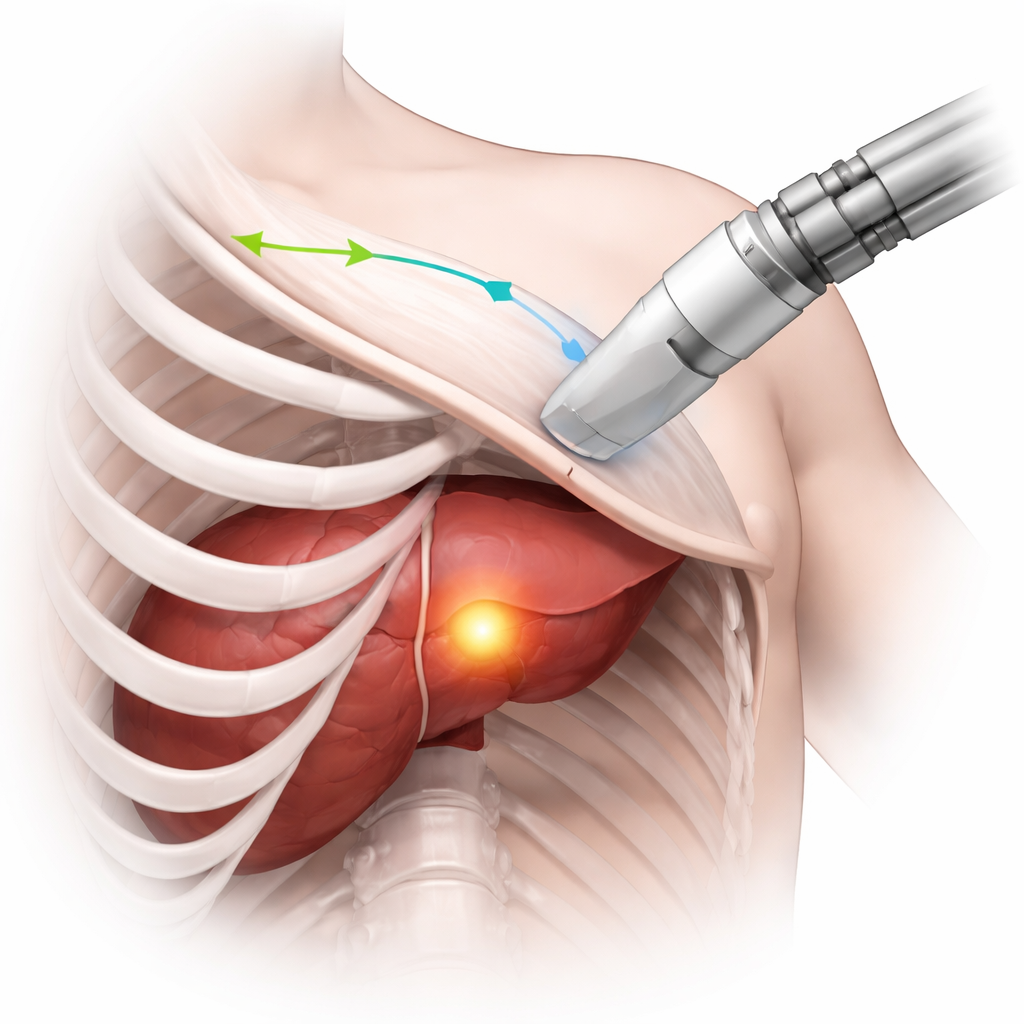

Cuando los médicos usan ecografía para vigilar órganos como el hígado o el corazón, las costillas suelen estorbar y generan sombras oscuras que ocultan detalles críticos. Obtener una vista clara depende en gran medida de la habilidad y la experiencia de la persona que sostiene el transductor. Este estudio explora cómo un robot, guiado por inteligencia artificial, puede planificar automáticamente una trayectoria de exploración ecográfica entre las costillas para que los tumores y otros objetivos se vean de forma clara y consistente, independientemente de quién opere la máquina.

Por qué ver entre las costillas es tan difícil

La ecografía es popular porque es segura, económica y ofrece imágenes en tiempo real. Pero para visualizar órganos situados detrás de la caja torácica, el transductor debe manejarse con cuidado a través de las estrechas aberturas entre las costillas. Si las ondas sonoras golpean el hueso, se bloquean, creando grandes regiones negras en la imagen donde no se ve nada. Los operadores humanos aprenden, mediante entrenamiento y experiencia, cómo inclinar y mover el transductor para evitar esas sombras mientras mantienen la zona de interés en el encuadre. Esto es especialmente importante en procedimientos como la ablación de tumores hepáticos, donde los cirujanos deben comprobar repetidamente que el tumor completo ha sido tratado. El desafío es convertir esta habilidad delicada y tridimensional en algo que un robot pueda hacer de forma autónoma.

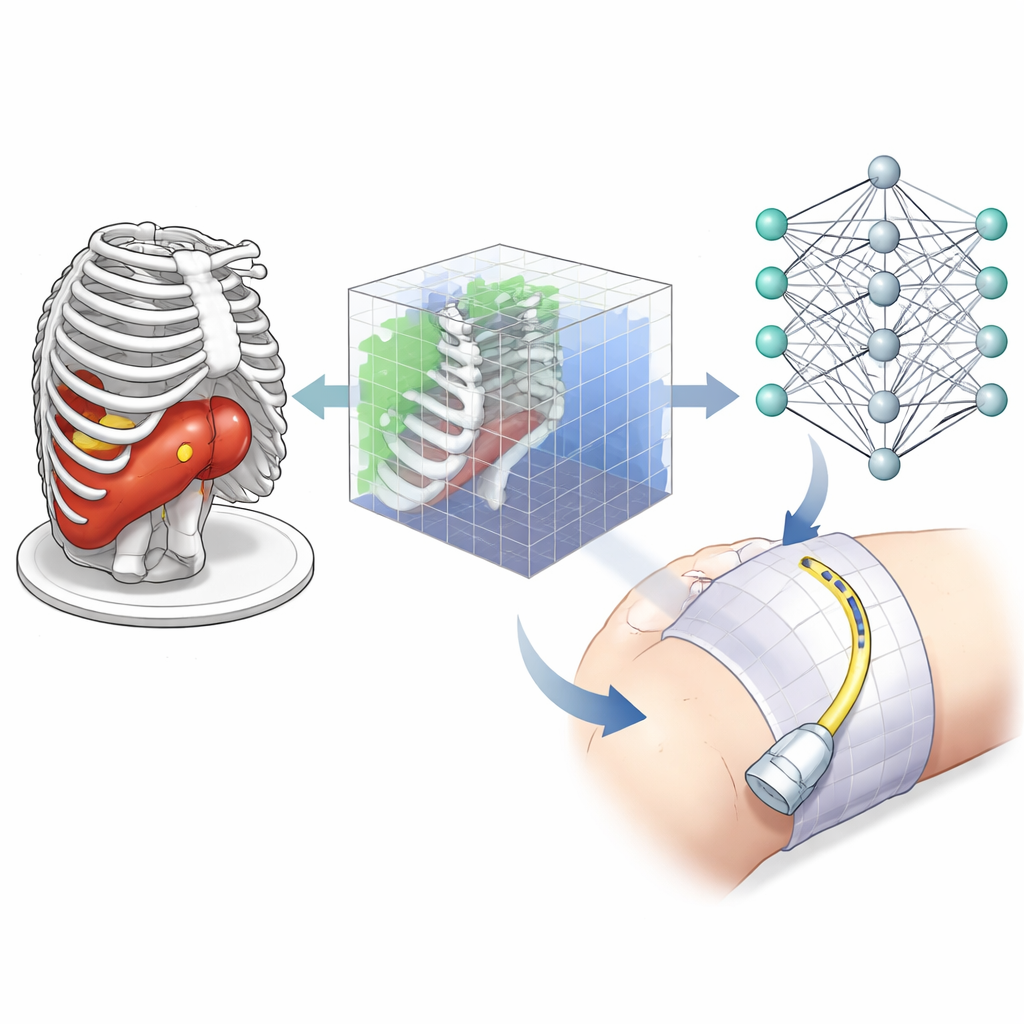

Enseñar a un robot con pacientes virtuales

En lugar de aprender directamente a partir de imágenes ecográficas ruidosas y variables, los investigadores construyeron un campo de entrenamiento virtual usando tomografías computarizadas (TC). La TC ofrece un mapa tridimensional nítido de huesos, piel y hígado, y pueden añadirse tumores con distintas formas y ubicaciones para crear muchos escenarios realistas. En este simulador, un transductor ecográfico virtual se desplaza por la superficie de la piel sobre las costillas, y los caminos de los haces de ultrasonido se modelan como rayos que atraviesan el tejido blando pero son bloqueados por el hueso. Este modelo, simple pero realista, indica al sistema qué partes de un tumor son visibles, cuánto se atenúa la señal al viajar y dónde aparecen sombras.

Cómo decide el sistema de aprendizaje dónde explorar

El equipo empleó una forma de inteligencia artificial llamada aprendizaje por refuerzo, en la que un «agente» aprende por ensayo y error a elegir acciones que conducen a mayores recompensas. En cada paso, el agente ve una representación 3D compacta de la escena alrededor del tumor: qué diminutos volúmenes contienen tumor, cuáles contienen hueso y cuáles son atravesados por los rayos ecográficos simulados. A continuación puede mover o inclinar el transductor virtual en pequeños incrementos, o alternar entre un modo de «exploración» y un modo de «registro» usado para construir la vista 3D final. La recompensa que recibe combina tres objetivos: cubrir la mayor parte posible del volumen objetivo, mantener el transductor lo suficientemente cerca para reducir la pérdida de señal y evitar regiones donde los rayos son bloqueados por hueso, lo que generaría imágenes inútiles con sombras.

Poner el método a prueba

Para comprobar si la estrategia aprendida se generaliza más allá de los ejemplos de entrenamiento, los investigadores la probaron con nuevas TC y nuevas formas de tumores que el agente nunca había visto. En estas pruebas, un plan de exploración se consideró exitoso si al menos el 95% del volumen objetivo quedaba imagenado dentro de un número limitado de pasos. En objetivos pequeños, medianos y grandes, el sistema alcanzó tasas de éxito de hasta el 95%, manteniendo además un alto porcentaje de vistas libres de sombras y distancias razonables entre el transductor y el tumor. El método también funcionó cuando hubo múltiples objetivos a cubrir, como focos tumorales residuales dispersos en el hígado, aunque el rendimiento descontó ligeramente a medida que la tarea se volvía más compleja.

De la simulación al quirófano

Por ahora, el trabajo se centra en planificar la trayectoria más que en mover físicamente un robot real. Las trayectorias se generan sobre TC específicas del paciente o sobre «atlas» de TC genéricos que pueden luego ajustarse a la anatomía individual usando técnicas de registro existentes. En el futuro, este módulo de planificación se espera combinar con control robótico, compensación de movimiento por la respiración y una simulación de imágenes ecográficas más realista. Para un lector no especialista, la conclusión clave es que este enfoque podría hacer que la monitorización ecográfica durante procedimientos como el tratamiento de tumores hepáticos sea más fiable y menos dependiente de la pericia del operador, al permitir que un robot busque rutas inteligentes y sin sombras entre las costillas para mantener todo el objetivo a la vista.

Cita: Bi, Y., Qian, C., Zhang, Z. et al. Autonomous path planning for intercostal robotic ultrasound imaging using reinforcement learning. Sci Rep 16, 6356 (2026). https://doi.org/10.1038/s41598-026-37702-9

Palabras clave: ecografía robótica, aprendizaje por refuerzo, imagen de tumores hepáticos, exploración intercostal, robótica médica