Clear Sky Science · es

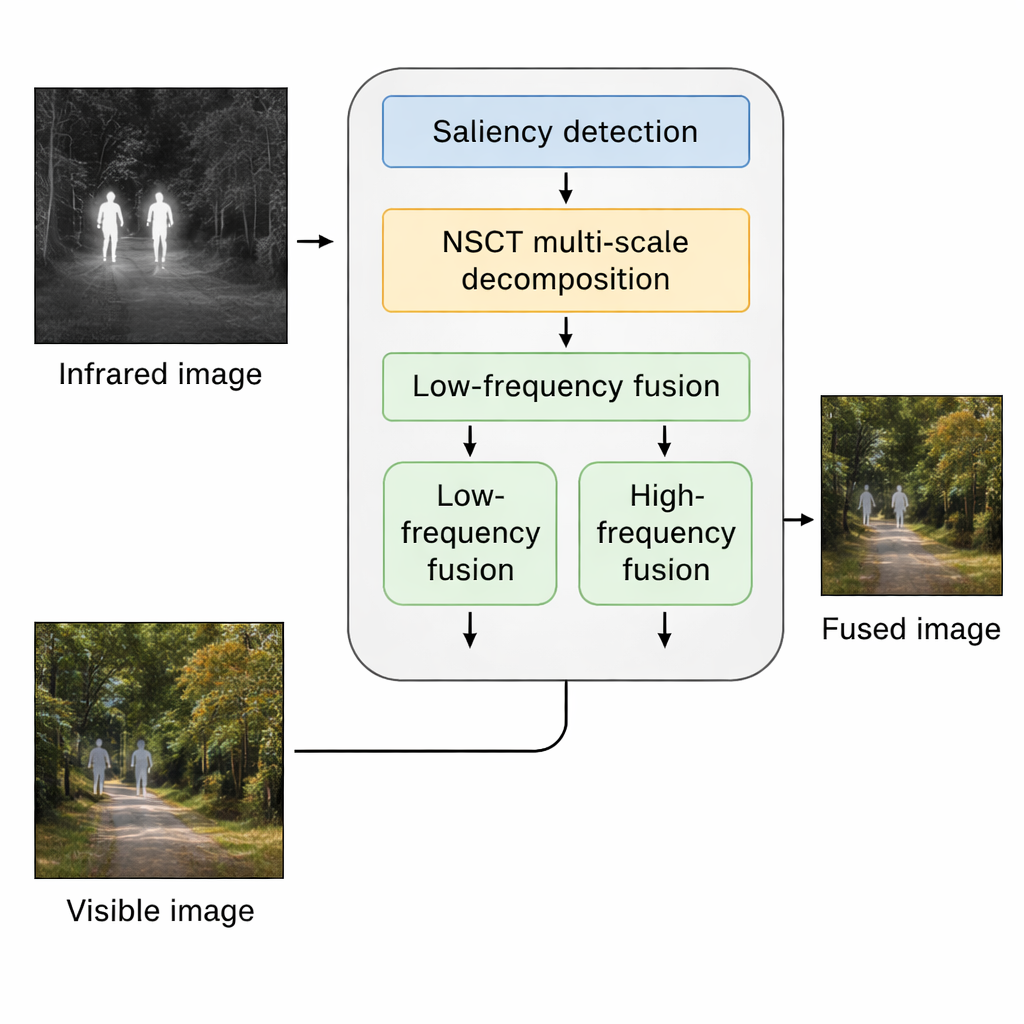

Algoritmo de fusión de imágenes infrarrojas y visibles basado en NSCT y detección de saliencia FT mejorada

Ver en la oscuridad y a través del desorden

Las cámaras modernas nos ofrecen vistas nítidas y coloridas del mundo, pero tienen dificultades en niebla, oscuridad o deslumbramiento—exactamente cuando más necesitamos una visión fiable para la conducción, la vigilancia, el rescate o los drones. Los sensores infrarrojos, que capturan calor en lugar de color, sobresalen en estas condiciones adversas pero producen imágenes borrosas y con pocos detalles. Este artículo presenta una forma de combinar inteligentemente imágenes infrarrojas y de luz visible para que la imagen final muestre tanto detalles nítidos como personas u objetos claramente destacados, incluso en escenas difíciles.

Por qué dos ojos son mejores que uno

Las cámaras de luz visible registran texturas finas y fondos ricos, pero su rendimiento colapsa de noche o en sombras intensas, y los objetivos pueden fundirse con entornos de color similar. Las cámaras infrarrojas hacen lo contrario: detectan cuerpos cálidos y objetos emisores de calor sobre fondos oscuros, de día o de noche, pero pierden gran parte de la estructura sutil de edificios, árboles y carreteras. Fusionar estos dos tipos de imágenes puede, en principio, ofrecer lo mejor de ambos mundos. Sin embargo, muchos métodos de fusión existentes o bien apagan el contraste, suavizan los bordes de los objetos, o permiten que patrones ruidosos del infrarrojo opaquen los detalles útiles de la imagen visible.

La idea central: dejar que las partes importantes destaquen

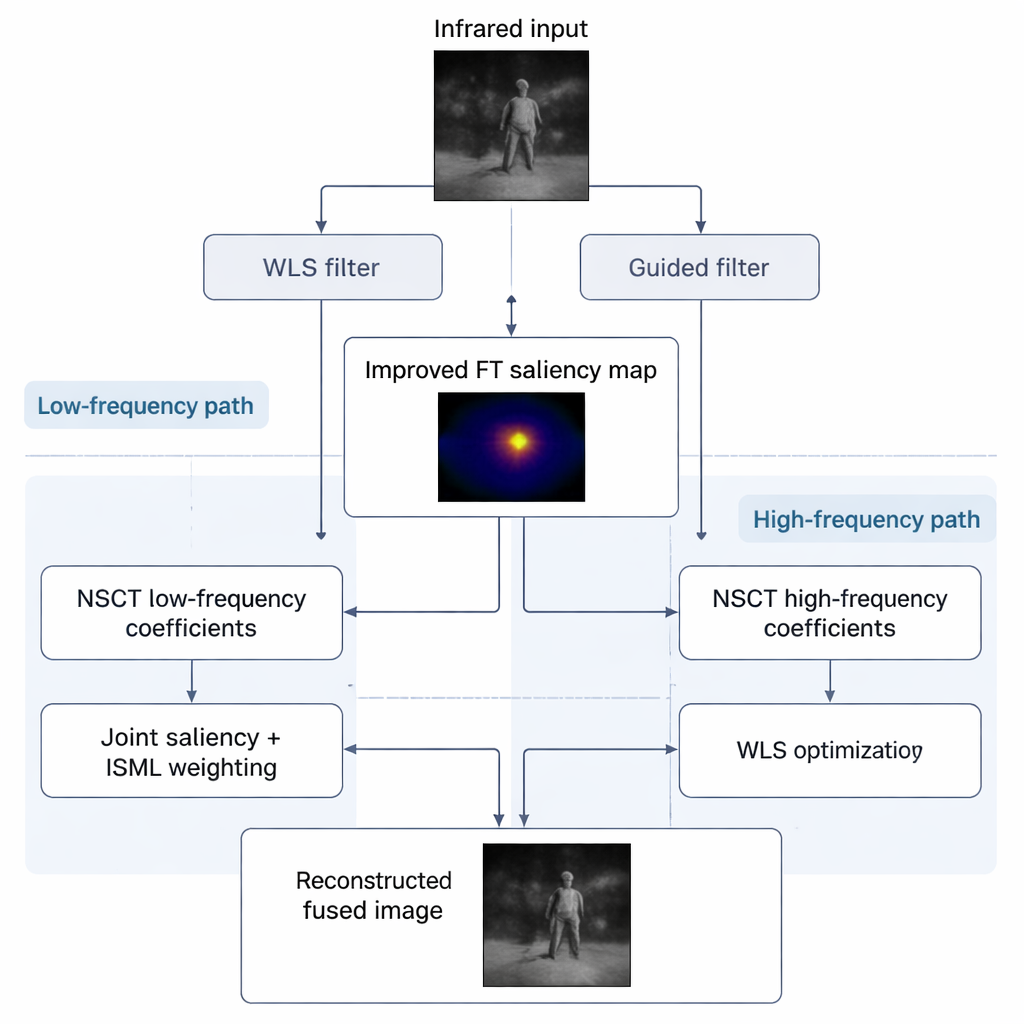

Los autores abordan la fusión como un problema de resolución de conflictos entre los dos tipos de imagen. Se centran en tres cuestiones recurrentes: adivinar qué regiones son realmente importantes ("salientes"), equilibrar el brillo general entre objetivos calientes del infrarrojo y fondos brillantes visibles, y preservar texturas delicadas mientras se suprime el ruido infrarrojo. Para ello refinan una técnica popular llamada detección de saliencia afinada en frecuencia, que intenta imitar el sistema visual humano resaltando regiones que atraen naturalmente nuestra atención. En lugar de confiar en un simple desenfoque, usan un par de filtros más inteligentes—uno que suaviza manteniendo los bordes y otro que realza el contraste—para trazar un mapa más limpio y más nítido de dónde están los objetivos infrarrojos interesantes.

Separando formas gruesas y detalles finos

Una vez que el algoritmo sabe dónde se encuentran los objetivos infrarrojos clave, descompone tanto las imágenes infrarrojas como las visibles en capas que separan estructuras gruesas de detalles finos mediante una herramienta matemática llamada Transformada Contourlet No Submuestreada (NSCT). Las capas de baja frecuencia contienen patrones amplios de brillo, como el cielo, las carreteras o las paredes, mientras que las capas de alta frecuencia capturan bordes, texturas y pequeñas características. Para las capas gruesas, el método mezcla información usando tanto el mapa de saliencia infrarroja mejorado como una medida basada en Laplaciano de cuán definidas están las estructuras locales. Esto ayuda a evitar imágenes lavadas donde o bien los objetos cálidos dominan la escena o bien el fondo visible ahoga objetivos importantes.

Mantener las texturas nítidas, controlar el ruido

Las capas de alta frecuencia requieren una estrategia distinta, porque en ellas conviven tanto la textura útil como el ruido molesto. Aquí el método primero selecciona, región por región, el sensor que ofrece más detalle local. Luego refina esta elección inicial con un procedimiento de mínimos cuadrados ponderados que se inclina hacia las texturas de luz visible más limpias e informativas, sin dejar de permitir que pasen patrones infrarrojos significativos. El resultado es una imagen fusionada donde las ramas de los árboles, los bordes de los edificios y las marcas viales se ven nítidos, pero los artefactos moteados del infrarrojo se reducen.

Mejores imágenes, mejores decisiones automáticas

El equipo probó su enfoque en varios conjuntos de datos públicos y en sus propias imágenes con poca luz, comparándolo con técnicas tradicionales y métodos modernos de aprendizaje profundo. La inspección humana mostró que sus imágenes fusionadas tenían fondos más claros, mayor contraste y objetivos más evidentes, especialmente en pasillos tenues, calles nocturnas y escenas exteriores congestionadas. Las medidas objetivas de contenido informativo, nitidez y contraste mayormente favorecieron al nuevo método o mostraron un equilibrio sólido entre métricas. De manera crucial, cuando estas imágenes fusionadas se alimentaron a un sistema popular de detección de objetos (YOLOv5s), la precisión, la exhaustividad y la exactitud de la detección mejoraron de forma notable. En términos sencillos, el algoritmo no solo produce imágenes más atractivas; también ayuda a los sistemas automatizados a encontrar personas y objetos con mayor fiabilidad. Esto sugiere que una fusión más inteligente de imágenes infrarrojas y visibles podría desempeñar un papel clave en una conducción autónoma más segura, una vigilancia más eficaz y robots más fiables que operen en la oscuridad o en entornos visualmente complejos.

Cita: Fan, X., Kong, F., Shi, H. et al. Infrared and visible image fusion algorithm based on NSCT and improved FT saliency detection. Sci Rep 16, 7144 (2026). https://doi.org/10.1038/s41598-026-37670-0

Palabras clave: fusión infrarrojo-visible, saliencia de imagen, imaginología multi‑sensor, visión nocturna, visión por ordenador