Clear Sky Science · es

Canal de procesamiento de imágenes para la caracterización con IA de megalibrerías de nanopartículas

Por qué las partículas diminutas necesitan ayuda de grandes datos

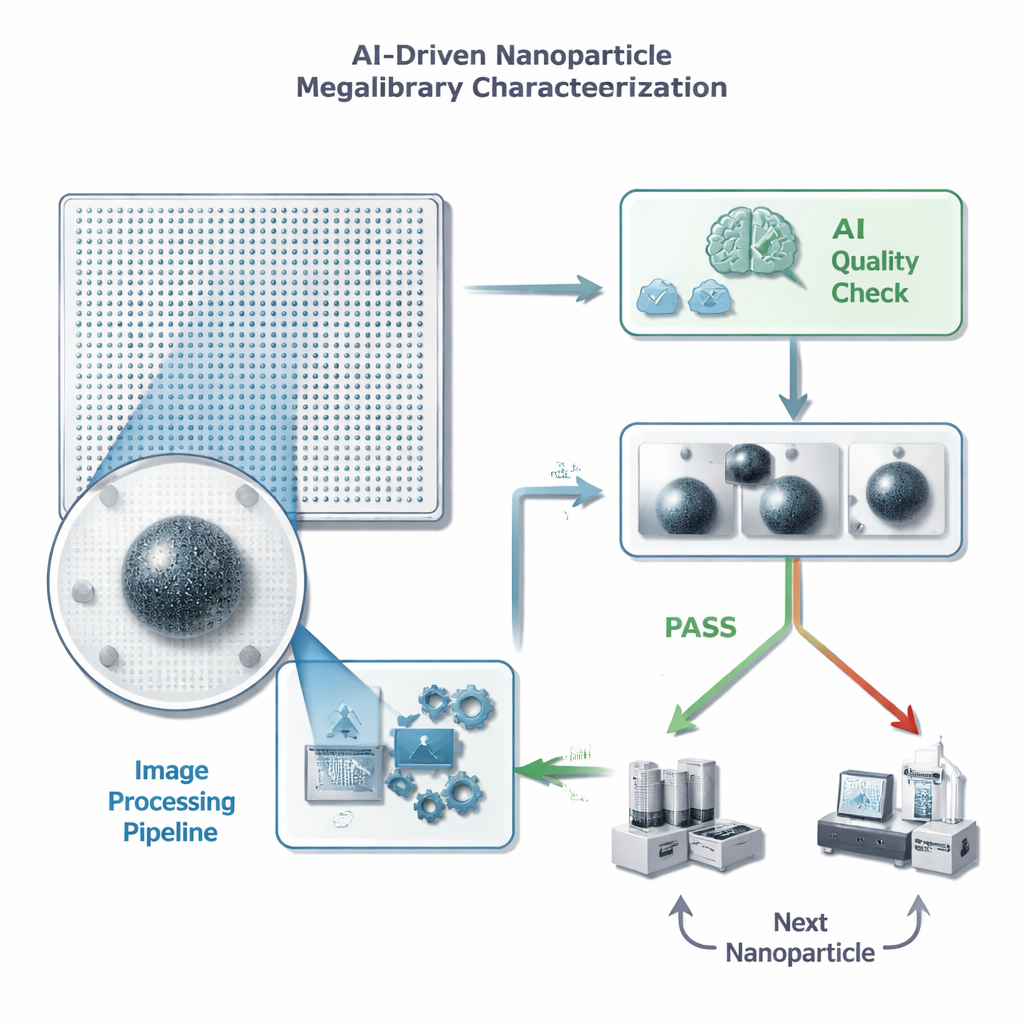

La ciencia de materiales moderna depende cada vez más de fabricar y ensayar enormes cantidades de partículas minúsculas para descubrir mejores catalizadores, baterías y otros materiales avanzados. Nuevos métodos pueden ahora hacer crecer millones de nanopartículas distintas en un solo chip, pero comprobar la calidad de cada una mediante un microscopio produce muchas más imágenes de las que cualquier humano puede revisar razonablemente. Este artículo describe cómo los investigadores construyeron una canalización automatizada de procesamiento de imágenes e IA que clasifica rápidamente las imágenes de nanopartículas “buenas” frente a las “malas”, reduciendo costes de cálculo y acelerando los experimentos sin sacrificar la fiabilidad de las decisiones.

De imágenes interminables a decisiones rápidas

Cada nanopartícula en un chip “megalibrería” ocupa una posición conocida y puede ser fotografiada por un microscopio electrónico. Antes de que los científicos inviertan tiempo y costosas mediciones de seguimiento en una partícula, necesitan una comprobación rápida de calidad: ¿hay exactamente una partícula bien enfocada en el encuadre, sin desorden ni artefactos que distraigan? Los autores plantean esto como una tarea simple de aprobar/reprobar para un modelo de aprendizaje automático, pero con límites estrictos sobre cuánto tiempo puede dedicar por imagen—menos de medio segundo, porque un solo chip puede contener millones de partículas. También subrayan que los falsos positivos son especialmente perjudiciales: si la IA aprueba por error una imagen mala, se malgastan tiempo y almacenamiento en mediciones detalladas inútiles, mientras que perder ocasionalmente una partícula buena es menos dañino para el progreso general.

Limpiar la vista antes de que la IA mire

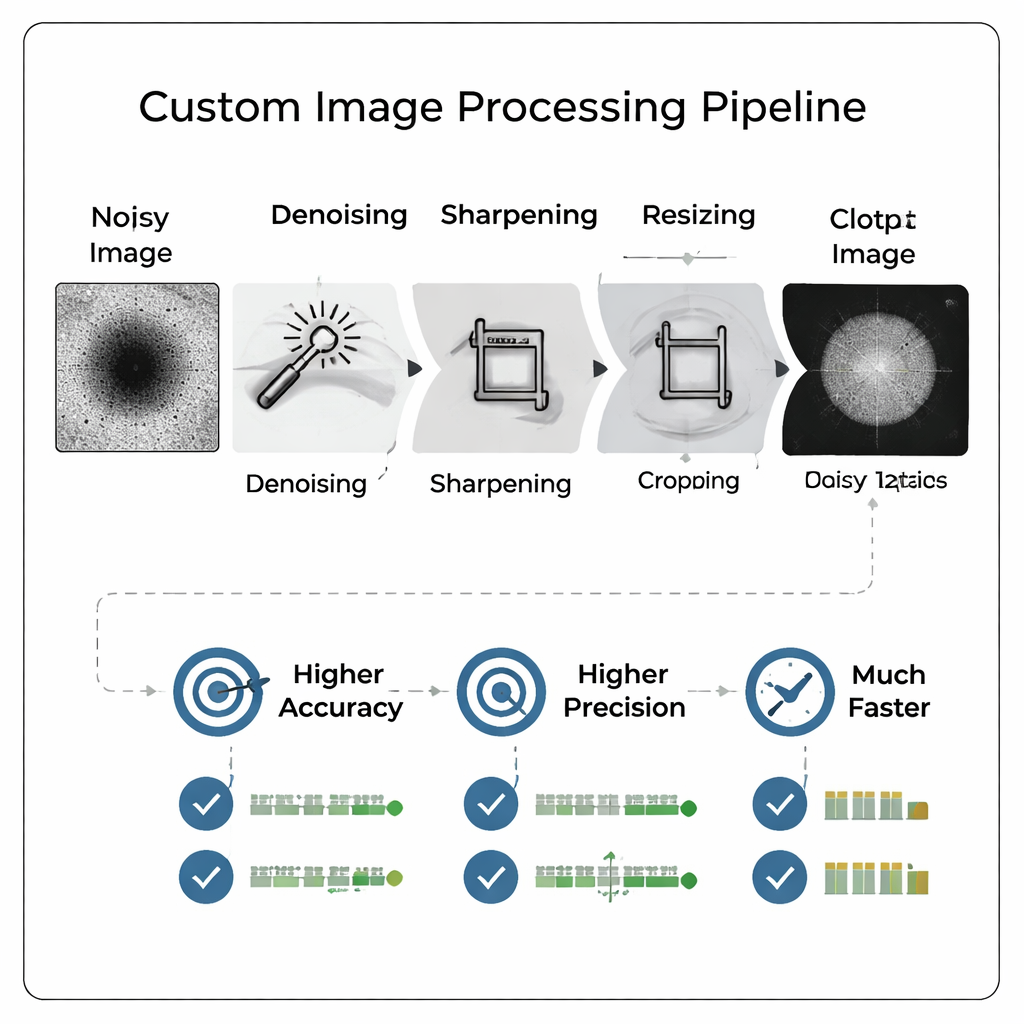

En lugar de introducir imágenes crudas y ruidosas del microscopio directamente en una red neuronal grande y compleja, el equipo diseñó una canalización de procesamiento de imágenes personalizada que primero “limpia” las fotografías. La canalización elimina el ruido de fondo, realza los bordes, recorta ajustadamente alrededor de la partícula y luego reduce la imagen a un tamaño mucho menor. De forma crucial, este preprocesado hace que las características débiles sean más fáciles de ver y emula el aspecto de una imagen con mayor ampliación sin volver a capturar la muestra. El resultado es una imagen compacta y de alto contraste que puede alimentarse a una red neuronal relativamente simple, reduciendo tanto el tiempo de entrenamiento como las necesidades de almacenamiento mientras se preservan los detalles relevantes para las evaluaciones de calidad.

Imágenes más inteligentes superan a modelos más grandes

Los investigadores compararon rigurosamente muchas variantes de la canalización y resoluciones, entrenando en total 800 modelos diferentes para ver cómo afectan el tamaño y el procesamiento de la imagen al rendimiento. Encontraron que imágenes cuidadosamente procesadas a resoluciones moderadas (por ejemplo, 128×128 píxeles) permitían que una pequeña red neuronal convolucional superara a un modelo previo mucho mayor que se había descubierto mediante búsqueda automatizada de arquitecturas y entrenado con imágenes completas de 512×512. La precisión mejoró en más de 13 puntos porcentuales, mientras que la recuperación—la capacidad de detectar correctamente las partículas buenas—aumentó en más de 18 puntos porcentuales. La precisión positiva, la medida clave para evitar esfuerzos desperdiciados en partículas malas, alcanzó alrededor del 96%, y también mejoró la métrica combinada de rendimiento que prefieren los autores.

Hacer más con muchos menos datos

Uno de los resultados más llamativos es que el procesamiento importa más que el tamaño bruto de la imagen. Cuando el equipo comparó modelos entrenados con imágenes simplemente “reducidas” frente a las que usan la canalización completa personalizada, las imágenes procesadas ganaron de forma consistente—even cuando se redujeron a tamaños extremadamente pequeños como 16×16 píxeles. De hecho, el mejor modelo que usó imágenes procesadas de 16×16 superó al mejor modelo que usó imágenes sin procesar de 128×128 en casi todas las métricas. La canalización también ayudó especialmente a bajas ampliaciones del microscopio, donde las imágenes normalmente son más difíciles de interpretar. Dado que las imágenes a menor ampliación se adquieren más rápido, esto permite a los laboratorios escanear chips más rápidamente sin sacrificar la calidad de las decisiones.

Decisiones más rápidas para laboratorios autodirigidos

Al combinar un procesamiento de imágenes inteligente con un modelo de IA esbelto, los autores redujeron los tiempos de entrenamiento de muchas horas en un superordenador a menos de un minuto en una sola unidad de procesamiento gráfico. Una vez entrenado, el sistema puede procesar y clasificar una nueva imagen en unos 75 milisegundos, muy por debajo del objetivo de 500 milisegundos y mucho más rápido que un revisor humano. En términos prácticos, esto se traduce en un cribado rápido y fiable de megalibrerías de nanopartículas, ayudando a los investigadores a centrar instrumentos caros en los candidatos más prometedores. A medida que los laboratorios avanzan hacia sistemas de descubrimiento más automatizados y “autoconducidos”, enfoques como este—limpiar los datos primero y luego aplicar IA optimizada—ofrecen una forma potente de convertir flujos de imágenes abrumadores en información científica accionable.

Cita: Day, A.L., Wahl, C.B., dos Reis, R. et al. Image processing pipeline for AI-driven nanoparticle megalibrary characterization. Sci Rep 16, 7675 (2026). https://doi.org/10.1038/s41598-026-37566-z

Palabras clave: nanopartículas, procesamiento de imágenes, aprendizaje automático, descubrimiento de materiales, microscopía electrónica