Clear Sky Science · es

Un nuevo enfoque basado en aprendizaje por refuerzo para la previsión a corto plazo de carga y precios en los mercados energéticos

Por qué importa predecir la electricidad de mañana

Cada vez que accionas un interruptor, una vasta red de centrales eléctricas, mercados y ordenadores trabaja entre bastidores para mantener la electricidad disponible y asequible. Si los operadores de la red pueden predecir con precisión cuánta energía consumirán las personas y cómo evolucionarán los precios en las próximas horas, pueden evitar apagones, reducir el despilfarro y ahorrar dinero para todos. Este artículo explora una nueva forma de hacer esas predicciones a corto plazo usando técnicas desarrolladas originalmente para aprender a jugar y a controlar robots.

Estimaciones más inteligentes para un mundo energético cambiante

La demanda y los precios de la electricidad pueden variar drásticamente de una hora a otra. Olas de calor, episodios de frío, días festivos y los costes de los combustibles empujan el sistema en distintas direcciones. Las herramientas de predicción tradicionales, como las líneas de tendencia simples o incluso modelos estándar de aprendizaje automático, a menudo tratan el problema como un ajuste unidireccional a datos pasados. Les cuesta cuando las condiciones cambian rápidamente o cuando muchos factores interactúan de forma compleja. Los autores sostienen que las redes eléctricas modernas, especialmente las con una creciente proporción de energías renovables, necesitan herramientas de previsión capaces de adaptarse sobre la marcha y de aprender directamente de sus aciertos y errores.

Un agente que aprende en el mercado eléctrico

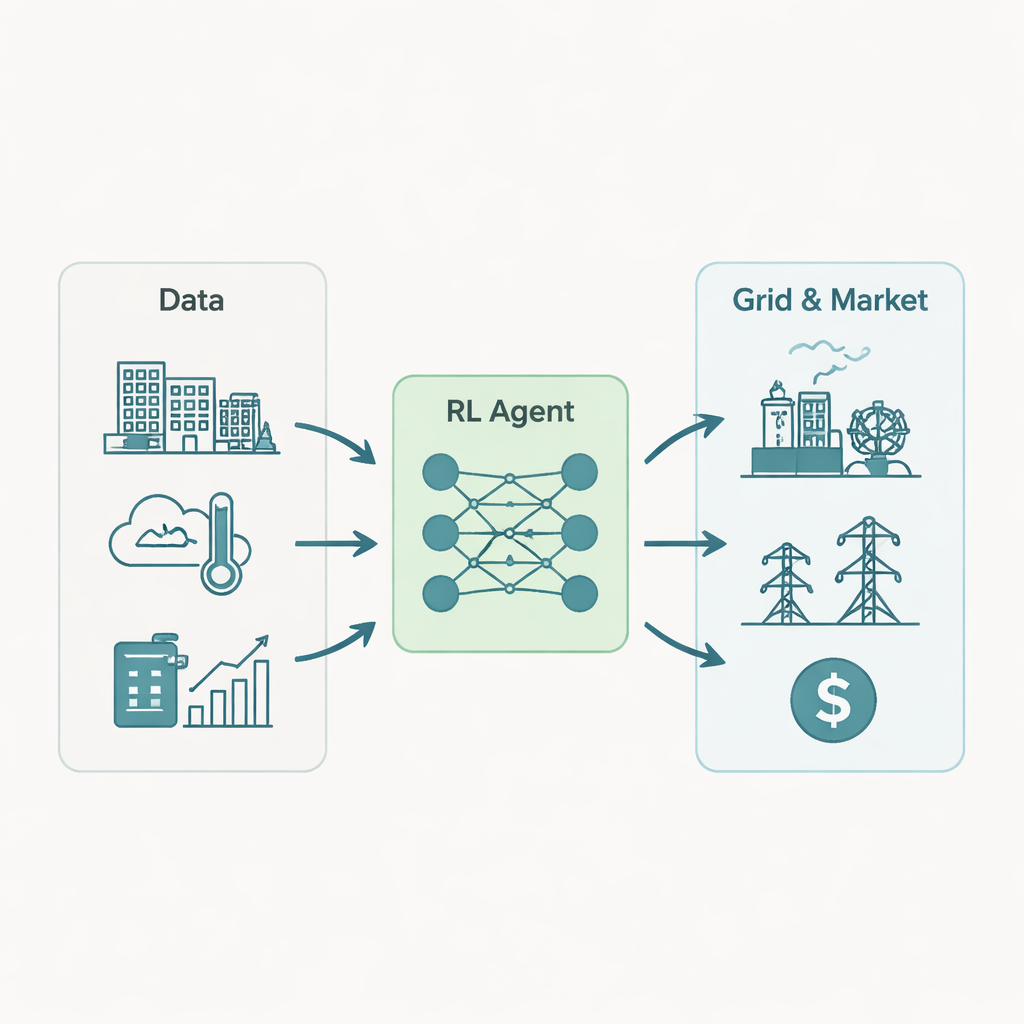

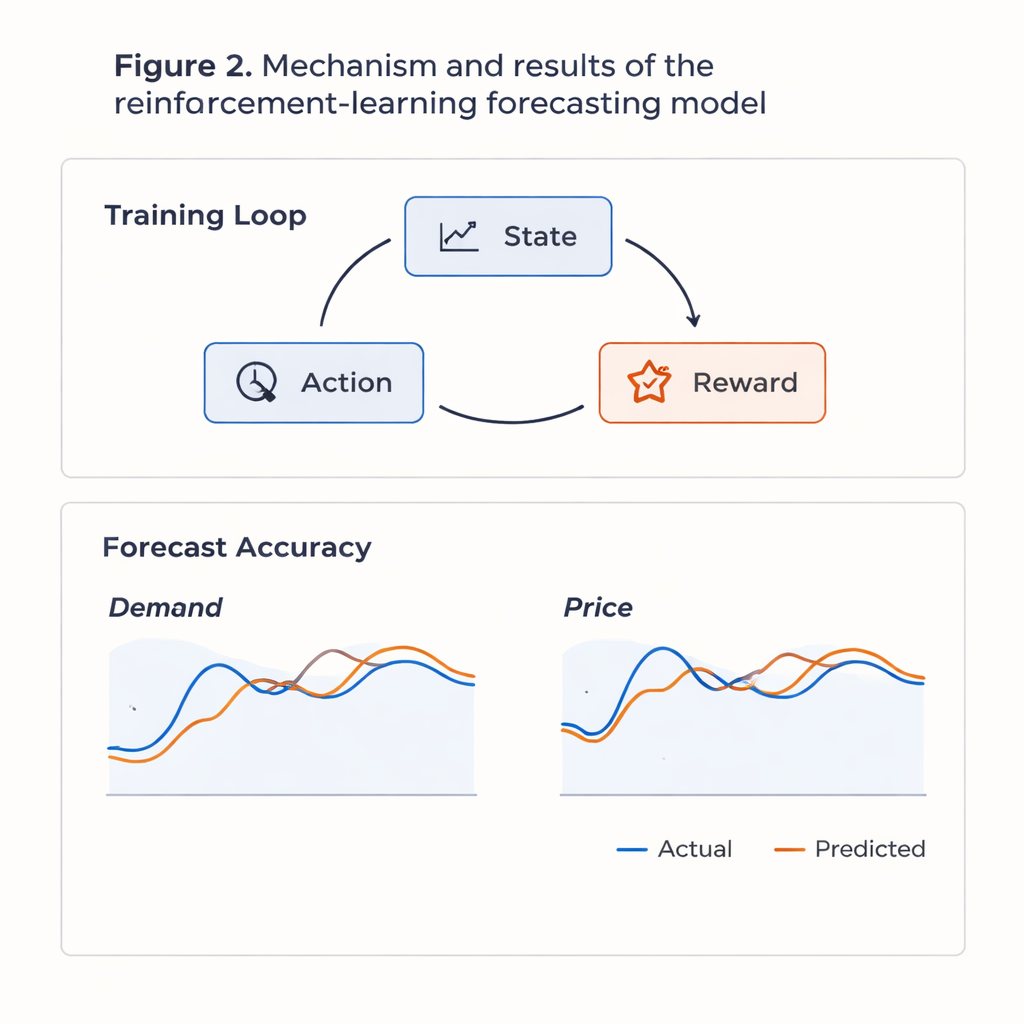

Los investigadores reconvirtieron la previsión en un juego de toma de decisiones. En cada hora, un “agente” informático observa la situación actual: la demanda de energía reciente, precios pasados, temperatura, humedad, día de la semana, festivos y costes de combustible. A continuación elige una acción: su mejor estimación para la demanda y el precio de la electricidad en la próxima hora. Cuando llegan los valores reales, el agente recibe una puntuación basada en cuánto se equivocó: los errores grandes se castigan y los pequeños se recompensan. Con el tiempo, el sistema busca una estrategia que maximice su puntuación a largo plazo, no solo la precisión de un solo paso. Para manejar las numerosas entradas, los autores utilizan un esquema de aprendizaje profundo por refuerzo basado en un Deep Q‑Network, un tipo de red neuronal que estima lo adecuada que es cada acción posible en cada situación.

De datos sin procesar a previsiones fiables

Para probar su enfoque, el equipo recurrió a datos reales de PJM Interconnection, un importante mercado eléctrico estadounidense que cubre partes del Medio Oeste y la Costa Este. Utilizaron unos tres años de registros horarios (2021–2023), que incluían precios de mercado, demanda eléctrica, observaciones meteorológicas e índices de precios de combustibles. Antes del entrenamiento limpiaron los datos, completaron los valores faltantes raros, eliminaron atípicos inusuales y escalaron todo a rangos comparables. También emplearon técnicas estadísticas para comprimir el gran conjunto de características de entrada manteniendo la mayor parte de la variación útil. El agente de aprendizaje se entrenó mediante pases repetidos sobre este historial, pasando gradualmente de la prueba y error aleatoria a explotar los patrones descubiertos.

Cómo rindió el agente de aprendizaje

Al compararlo con métodos de previsión ampliamente usados —incluyendo ARIMA (un modelo tradicional de series temporales), redes LSTM y el popular algoritmo XGBoost—, el sistema de aprendizaje por refuerzo salió adelante. En datos de prueba retenidos que el modelo nunca había visto, redujo los errores porcentuales medios en demanda y precio en aproximadamente un 15–20% frente a estas referencias. Las previsiones siguieron de cerca los ciclos diarios de invierno y verano y reflejaron las variaciones generales de precios, aunque el modelo aún tuvo dificultades con los picos de precio más agudos y raros y con comportamientos inusuales en festivos. El análisis de la estrategia aprendida mostró que el agente descubrió implícitamente un patrón económicamente sensato: tras observar precios muy altos, tendía a esperar una demanda ligeramente menor en la siguiente hora, emulando una respuesta de la demanda real sin que se le indicara explícitamente.

Qué significa esto para el uso diario de la energía

Para los no especialistas, el mensaje clave es que este enfoque basado en el aprendizaje puede ayudar a los operadores de la red a gestionar los sistemas eléctricos con más fluidez y menor coste. Previsiones a corto plazo más precisas permiten a generadores y operadores de mercado programar plantas con mayor eficiencia, integrar fuentes renovables con menos sorpresas y reducir el riesgo de picos de precio o faltas repentinas. Aunque el método demanda muchos datos y es intensivo en cálculo, y aún requiere refinamiento para eventos extremos, apunta hacia un futuro en el que los mercados eléctricos estén guiados por herramientas adaptativas y auto‑mejorables que aprenden continuamente del comportamiento siempre cambiante de consumidores, clima y costes de combustible.

Cita: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Palabras clave: previsión de redes inteligentes, predicción de precios de la electricidad, aprendizaje por refuerzo, previsión de la demanda energética, deep Q-network