Clear Sky Science · es

RiemannInfer: mejorando la inferencia de transformadores mediante geometría riemanniana

Por qué esto importa para los usuarios cotidianos de IA

Los chatbots y asistentes de IA modernos pueden resolver problemas matemáticos, redactar ensayos e incluso explicar temas médicos, pero aún no comprendemos completamente cómo llegan a sus conclusiones —ni cómo hacer que razonen con mayor fiabilidad. Este artículo presenta “RiemannInfer”, una nueva forma de mirar dentro de los modelos de lenguaje grandes (LLM) tratando su actividad interna como movimiento sobre una superficie geométrica curva. Esa perspectiva no solo ofrece una imagen más intuitiva de cómo piensan estos sistemas, sino que además hace que su razonamiento sea más rápido y más preciso.

Convertir el pensamiento de la IA en un viaje geométrico

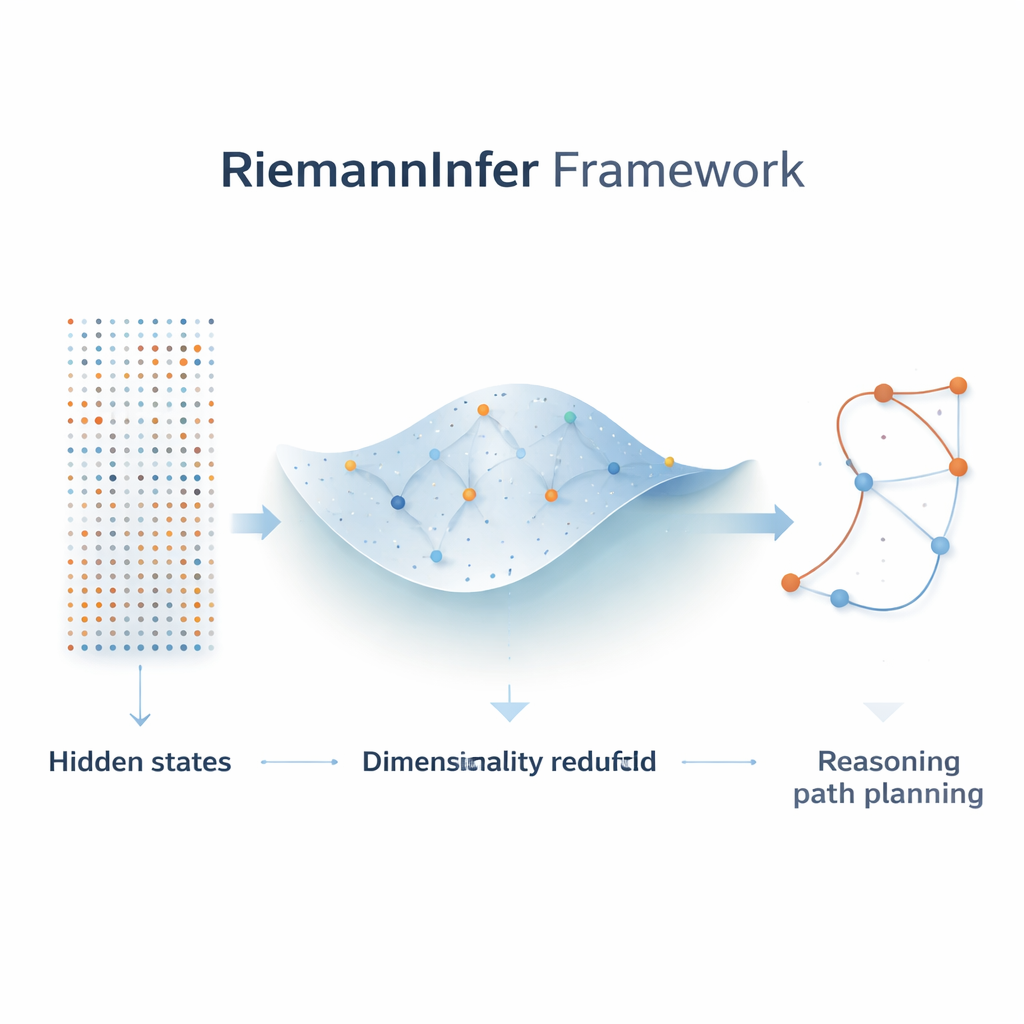

Dentro de un LLM como GPT-4 o Llama, cada palabra de una frase se representa mediante un vector de alta dimensión, y capas de “atención” deciden con qué intensidad las palabras se influyen entre sí. Los autores observan que estos estados ocultos pueden verse como puntos en un espacio vasto cuya forma global codifica la comprensión del lenguaje del modelo. En lugar de tratar el razonamiento como una serie de cálculos de probabilidad sobre textos, lo reinterpretan como un problema de encontrar caminos: el modelo viaja desde un estado inicial (la pregunta) hasta un estado final (la respuesta) a lo largo de una ruta en ese espacio. Utilizando herramientas de la geometría riemanniana —la matemática de las superficies curvas— construyen una variedad curva que captura cómo los patrones de atención doblan y estiran este paisaje interno.

Comprimir la complejidad sin perder la visión global

Dado que el espacio interno bruto de un LLM es enorme, el primer paso en RiemannInfer es reducirlo preservando su estructura esencial. Los autores combinan técnicas de topología, que estudia cómo se conectan los puntos, con un popular algoritmo de reducción de dimensionalidad llamado UMAP. Antes de reducir el número de dimensiones, analizan la “forma” del conjunto de estados ocultos para asegurar que los patrones clave de conectividad sobrevivan a la compresión. El resultado es un espacio de dimensión reducida donde las relaciones importantes entre tokens —por ejemplo, qué palabras prestan mucha atención unas a otras— se conservan en gran medida. Este mapa geométrico compacto hace viable realizar cálculos precisos sobre distancias, caminos más cortos y curvatura.

Construir un mapa curvo a partir de la atención

La innovación central es traducir los pesos de atención en una medida geométrica de distancia. Cuando el modelo presta mucha atención entre dos tokens, RiemannInfer los trata como cercanos en la variedad; la atención débil los sitúa más separados. A partir de estas relaciones, los autores definen una métrica —una regla matemática que determina longitudes y ángulos— y la usan para calcular geodésicas, el equivalente curvo de las líneas rectas, así como la curvatura, que mide cuánto se dobla el espacio. La atención multi‑cabeza se convierte de forma natural en una mezcla de métricas múltiples, cada una capturando un aspecto distinto de la estructura lingüística, como la gramática o el significado. Con esta construcción, las decisiones del modelo pueden interpretarse como la elección de caminos particulares a través de un paisaje cuyos picos y valles reflejan dónde la información está densa o dispersa.

Planificar rutas de razonamiento de bajo esfuerzo

Una vez construida la variedad, los autores reformulan el razonamiento como la búsqueda de un camino “fácil” desde la pregunta hasta la respuesta —uno que minimice el trabajo total realizado en el trayecto. Toman una analogía del alpinismo: ascender por una ruta empinada y accidentada requiere más energía que seguir una cresta más suave hasta la misma cima. En el contexto del LLM, la curvatura ejerce el papel de pendiente, y el trabajo de razonamiento del modelo corresponde a cuánto se reduce su incertidumbre interna a lo largo de un camino. Usando fórmulas aproximadas para geodésicas y curvatura, combinadas con un algoritmo eficiente de búsqueda en grafos (el algoritmo de Dijkstra), RiemannInfer identifica rápidamente rutas que minimizan este trabajo, guiando efectivamente al modelo hacia cadenas de pensamiento más eficientes.

Qué muestran los experimentos en modelos reales

Los autores prueban RiemannInfer en varios LLMs de vanguardia, incluidos GPT-4o, Llama-3-405B y DeepSeek-V2-400B, a través de exigentes benchmarks de matemáticas y razonamiento como GSM8K, MATH500, StrategyQA y AGIEval. En todos los casos, envolver estos modelos con el marco RiemannInfer aumenta su precisión en unos pocos puntos porcentuales —números pequeños pero significativos en la frontera del rendimiento— mientras mantiene o mejora ligeramente la velocidad. Una comparación con un método más simple y puramente lineal muestra que ignorar la geometría curva de los estados ocultos perjudica dramáticamente el rendimiento, subrayando la importancia de la visión de la variedad.

Visión general: dar al razonamiento de la IA una sensación física

Para un lector no especializado, la conclusión clave es que los autores han convertido los opacos procesos internos de los modelos de lenguaje grandes en algo más tangible: un viaje a través de un paisaje curvo donde un buen razonamiento corresponde a seguir senderos suaves y de bajo esfuerzo. Al fundamentar los patrones de atención y los pasos de razonamiento en conceptos geométricos y físicos —distancia, curvatura y trabajo— RiemannInfer ofrece tanto una vía práctica para mejorar resultados como un puente conceptual entre la IA y la física de espacios continuos. Aunque los métodos actuales son aproximados y quedan muchos detalles por refinar, este marco apunta hacia futuros sistemas de IA cuyos procesos de pensamiento puedan analizarse, optimizarse y quizá incluso diseñarse usando el lenguaje de la geometría y la física.

Cita: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Palabras clave: modelos de lenguaje grandes, aprendizaje profundo geométrico, variedad riemanniana, mecanismos de atención, eficiencia del razonamiento