Clear Sky Science · es

SSG–CAM: mejorar la interpretabilidad visual mediante gradientes de segundo orden refinados y fusión evolutiva multilayer

Por qué importa ver dentro de la IA

Los sistemas modernos de reconocimiento de imágenes pueden detectar tumores, señales de tráfico o diminutos parásitos en células sanguíneas con velocidad sobrehumana, pero rara vez nos muestran exactamente por qué tomaron una decisión. Este comportamiento de “caja negra” resulta especialmente preocupante en medicina y en ámbitos críticos para la seguridad, donde una suposición errónea puede tener consecuencias graves. El artículo presenta una nueva forma de hacer que los modelos de aprendizaje profundo se expliquen visualmente con mayor claridad y fiabilidad, ayudando a los humanos a ver qué partes de una imagen impulsaron realmente la decisión de la IA.

De mapas de calor difusos a explicaciones más nítidas

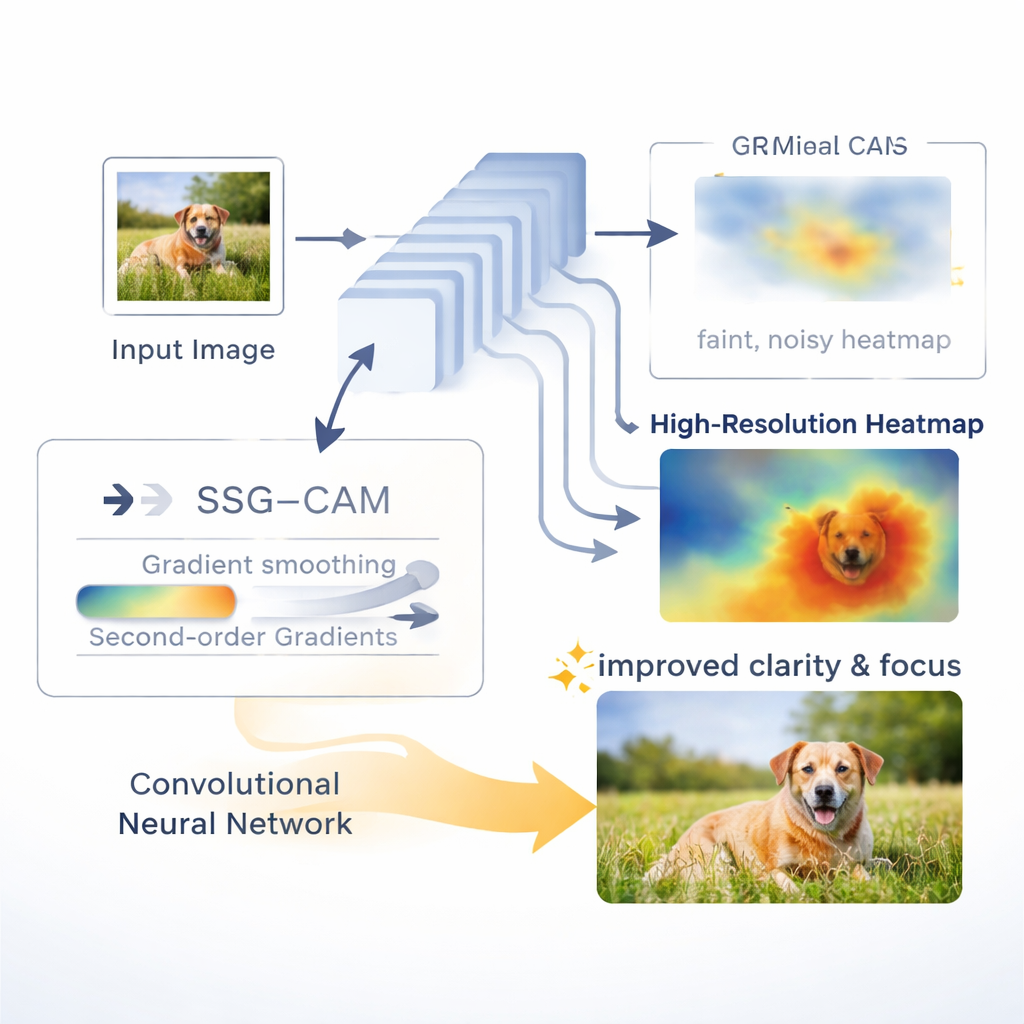

Una familia popular de herramientas, llamada mapas de activación por clase o CAM, convierte el funcionamiento interno de una red neuronal en mapas de calor coloridos superpuestos en la imagen original. Las regiones brillantes muestran dónde “miró” el modelo para decidir, por ejemplo, que una imagen contiene un pájaro o una célula enferma. Los métodos CAM existentes suelen basarse en señales de gradiente simples de primer orden dentro de la red. Estas señales pueden ser ruidosas o llegar a “saturarse”, es decir, dejar de cambiar incluso cuando los detalles de la imagen siguen siendo relevantes. Como resultado, los mapas de calor pueden iluminar grandes zonas de fondo, pasar por alto detalles finos o dar explicaciones inconsistentes entre capas.

Una segunda mirada más suave a lo que ve la red

Los autores proponen Smooth Second-Order Gradient CAM, o SSG–CAM. En lugar de depender solo del primer impulso de los gradientes, SSG–CAM también analiza cómo cambian esos gradientes: la información de segundo orden. Esta capa adicional de sensibilidad ayuda a revelar qué características realmente sustentan la decisión de la red, reduciendo el riesgo de que evidencia importante se diluya. Para domar el ruido aleatorio, SSG–CAM suaviza los gradientes con un filtro gaussiano, de forma similar a cómo un desenfoque de cámara elimina salpicaduras manteniendo las formas. Finalmente, combina las señales suavizadas de primer y segundo orden de manera que enfatiza respuestas fuertes y fiables y suprime las débiles o inconsistentes, produciendo mapas de calor más limpios y concentrados.

Dejar que los algoritmos elijan las mejores capas

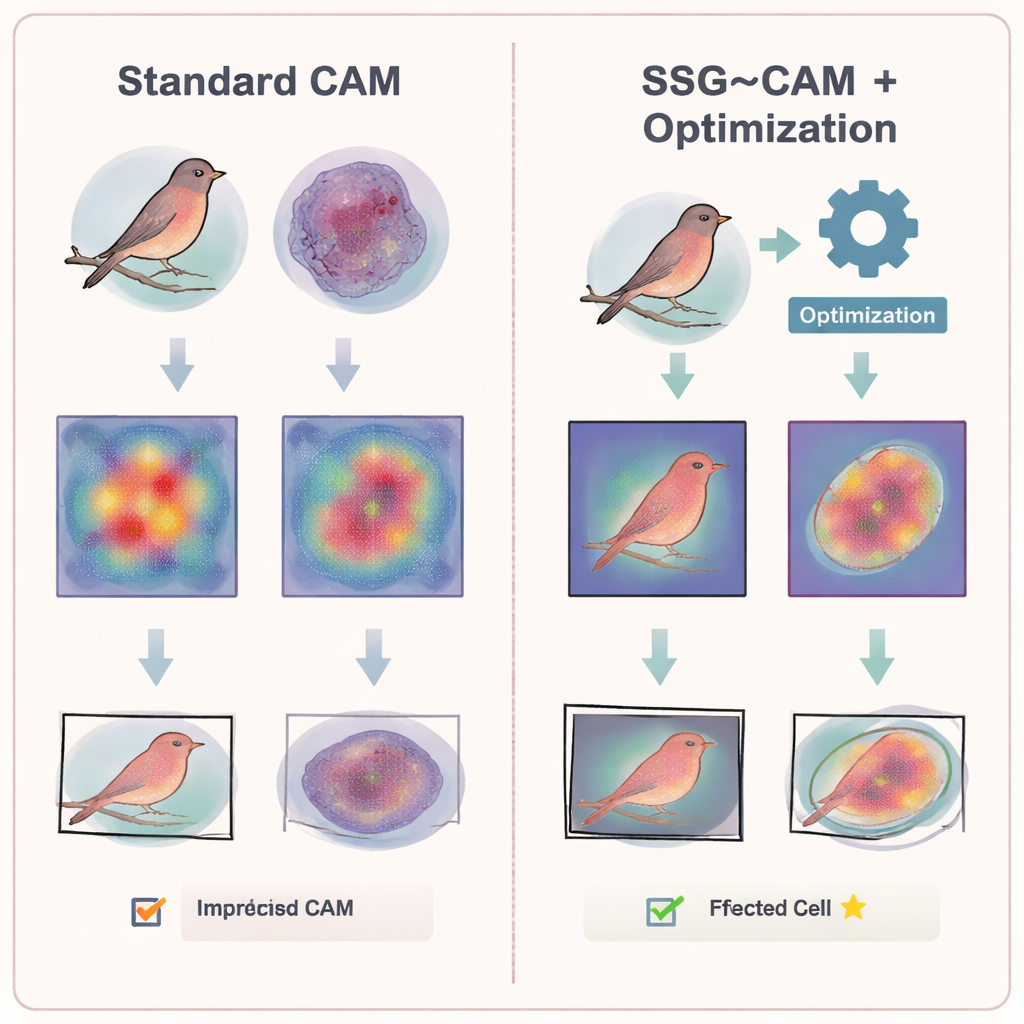

Las redes profundas no piensan en un solo paso: las capas iniciales capturan bordes y texturas, mientras que las capas más profundas codifican objetos o conceptos completos. Muchos métodos CAM intentan fusionar información de varias capas, pero a menudo con reglas fijas o seleccionadas manualmente. El estudio muestra que apilar ingenuamente todas las capas puede perjudicar el rendimiento, añadiendo ruido de bajo nivel que difumina la explicación final. Para resolver esto, los autores combinan SSG–CAM con una estrategia de optimización llamada evolución diferencial, creando el marco DE–SSG–CAM. Este algoritmo busca automáticamente entre combinaciones de capas de características y algunos ajustes clave, con el objetivo de encontrar la mezcla que mejor coincida con las formas reales de los objetos en un pequeño conjunto etiquetado. Una vez encontradas, estas configuraciones pueden reutilizarse, ofreciendo explicaciones multilayer sólidas sin un costoso ajuste manual.

Poner el método a prueba

Los investigadores evaluaron SSG–CAM y DE–SSG–CAM en una serie de pruebas exigentes. En benchmarks estándar de imágenes, el nuevo método mejoró la localización de objetos con supervisión débil —dibujar cuadros alrededor de objetos usando solo etiquetas a nivel de imagen— con mayor precisión que varias variantes CAM populares. También mejoró la segmentación semántica con supervisión débil, que pide al modelo etiquetar cada píxel sin proporcionar máscaras detalladas de entrenamiento. En un experimento de “perturbación de imagen”, el equipo difuminó las regiones destacadas por cada método. Cuando eliminaron las áreas seleccionadas por SSG–CAM, la precisión de la red cayó más, lo que indica que esas regiones resaltadas eran verdaderamente críticas para la decisión del modelo, no meros puntos decorativos.

Encontrar diminutos parásitos en células sanguíneas

La aplicación más destacada proviene de la imagen biomédica. Los autores usaron su enfoque para localizar parásitos de la malaria dentro de imágenes de glóbulos rojos, una tarea en la que las regiones infectadas pueden ser minúsculas e irregulares. Usando solo etiquetas de infección a nivel de imagen para el entrenamiento, DE–SSG–CAM produjo pseudo-máscaras que coincidían estrechamente con los contornos dibujados por expertos, alcanzando una media de Intersection over Union del 62,38 % —un resultado sólido para un problema tan desafiante y débilmente etiquetado. El marco también se transfirió bien a otro tipo de red, ResNet34, demostrando que la técnica no está ligada a una única arquitectura y puede adaptarse a distintos diseños.

Qué significa esto para los usuarios cotidianos

Para no especialistas, el mensaje clave es que estos métodos hacen que el “razonamiento” de la IA sea más visible y digno de confianza. SSG–CAM ofrece mapas de calor más nítidos y menos ruidosos que coinciden mejor con lo que los humanos considerarían el objeto o la lesión real, mientras que DE–SSG–CAM aprende automáticamente cómo combinar información de diferentes profundidades de la red. Juntos, acercan las explicaciones visuales a algo en lo que médicos, ingenieros y reguladores pueden confiar cuando preguntan: “¿Por qué el modelo dijo que esta imagen muestra enfermedad —o peligro?”

Cita: Chen, Z., Zhang, Y.J., Pan, L. et al. SSG–CAM: enhancing visual interpretability through refined second-order gradients and evolutionary multi-layer fusion. Sci Rep 16, 6848 (2026). https://doi.org/10.1038/s41598-026-37278-4

Palabras clave: IA explicable, mapas de activación por clase, visualización de aprendizaje profundo, análisis de imágenes médicas, localización de objetos