Clear Sky Science · es

Cuando los LLM hablan ZigBee: explorando modelos de baja latencia y razonamiento para la generación de tráfico de red

Los hogares inteligentes necesitan ensayos creíbles

A medida que nuestras casas se llenan de luces inteligentes, enchufes y sensores, la conversación invisible entre ellos se convierte a la vez en una comodidad y en un posible punto débil. Los ingenieros que diseñan y aseguran estos sistemas necesitan formas seguras de “ensayar” cómo se comportan las redes en condiciones del mundo real, incluidos fallos raros y ciberataques. Este artículo explora si los modelos de lenguaje modernos —los mismos usados en chatbots— pueden reconvertirse para generar tráfico de red realista en hogares inteligentes, ofreciendo a los investigadores un nuevo banco de pruebas potente sin tener que grabar cada escenario posible en casas reales.

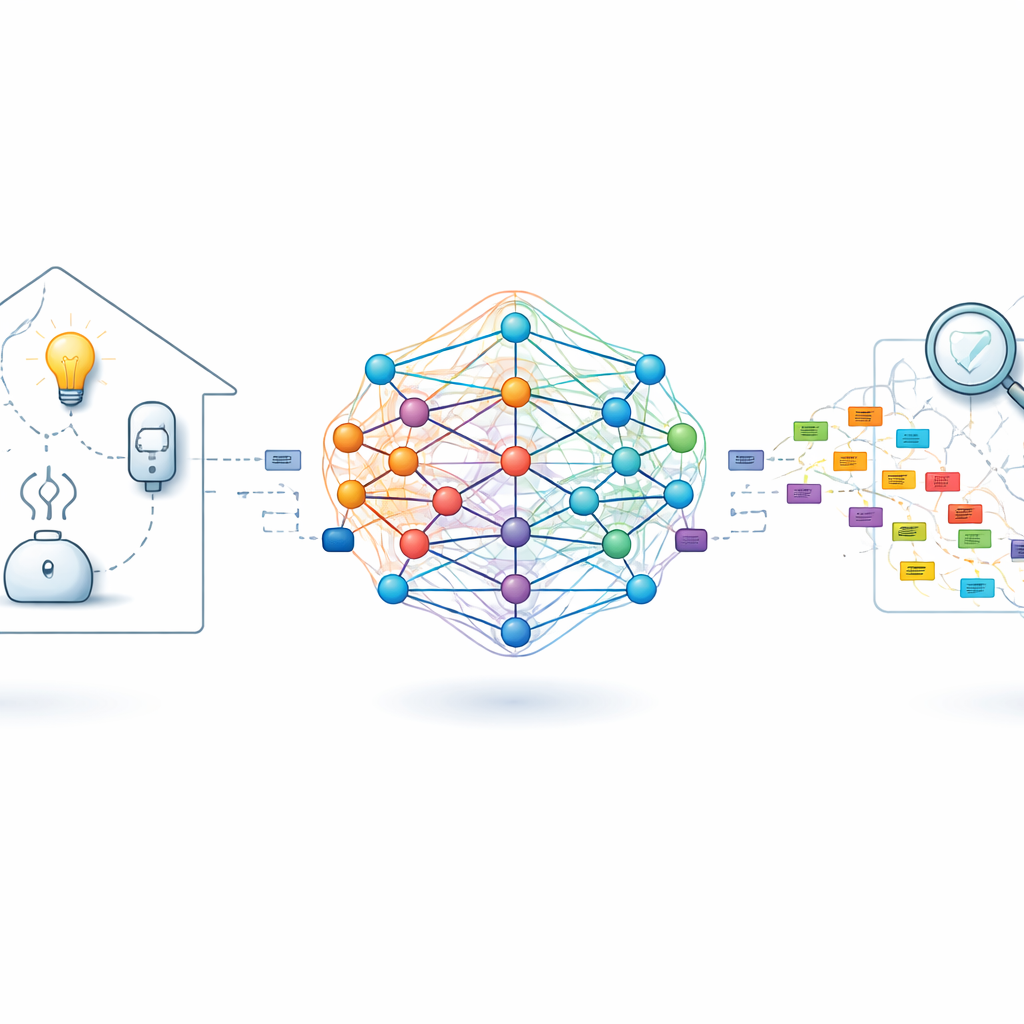

Del lenguaje humano a las conversaciones entre dispositivos

El estudio se centra en ZigBee, un estándar inalámbrico popular en bombillas inteligentes, enchufes y detectores de movimiento. En lugar de generar texto ordinario, los autores introducen paquetes ZigBee de ejemplo —registros con marcas temporales de quién habló con quién y qué campos de protocolo se usaron— en modelos de lenguaje grandes (LLM) de OpenAI, en concreto GPT‑4.1 y GPT‑5. Estos modelos tratan cada paquete como una “oración” estructurada y aprenden patrones sobre cómo se comunican los dispositivos y el hub central a lo largo del tiempo. El objetivo no es solo imitar estadísticas básicas como el tamaño medio de paquete, sino producir tráfico nuevo que cumpla las reglas estrictas de ZigBee, use direcciones de dispositivo válidas y preserve tiempos y patrones de petición‑respuesta realistas.

Dos experimentos: habla unidireccional y diálogo completo

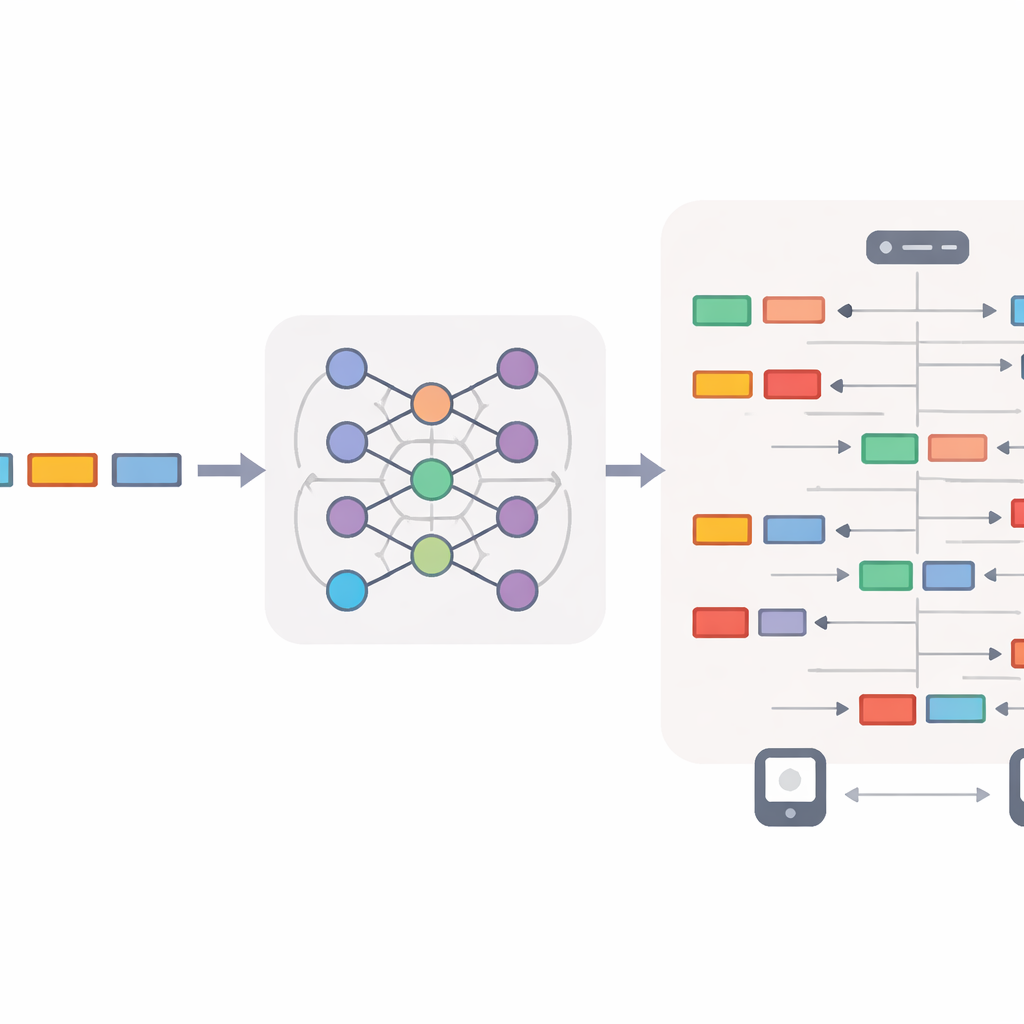

Para poner a prueba la idea, los investigadores diseñan dos experimentos principales usando un gran conjunto de datos real de hogares inteligentes llamado ZigBeeNet, que contiene alrededor de 25 millones de paquetes recogidos de 15 dispositivos durante 20 días. En el primer experimento estudian la comunicación unidireccional de una bombilla inteligente al hub, entrenando al LLM usando solo los primeros diez minutos de tráfico real como ejemplos. En el segundo, avanzan a un escenario más verosímil donde la bombilla y el hub intercambian mensajes en ambas direcciones, incluidas transmisiones (broadcasts) del hub. En ambos casos, se muestran al modelo un pequeño conjunto de paquetes de ejemplo dentro del prompt (aprendizaje few‑shot) y se le pide generar tramos más largos de tráfico completamente nuevo que puedan convertirse de nuevo en archivos estándar de captura de paquetes e inspeccionarse con herramientas de red habituales.

Guiando el modelo con reglas y controles humanos

Dado que un campo mal situado o una marca temporal fuera de orden puede romper la ilusión de realismo, el equipo construye un cuidadoso sistema de prompting y retroalimentación. Primero filtran y exportan los paquetes reales, luego elaboran prompts que especifican direcciones de dispositivo permitidas, tipos de mensaje y formatos de tiempo. En una fase inicial, un experto humano revisa la salida del modelo buscando problemas como direcciones inválidas, números de secuencia imposibles o huecos en el tiempo. En lugar de corregir manualmente los paquetes, traducen estos hallazgos en reglas de prompt más estrictas —por ejemplo, prohibir que un dispositivo se envíe a sí mismo o exigir que el conteo de paquetes se mantenga dentro de un rango realista. Una vez que las reglas son estables, los prompts se “congelan” y se reutilizan sin cambios para que los experimentos posteriores sean totalmente automáticos y reproducibles.

Poniendo a los LLM frente a generadores más antiguos

Para ver si los LLM aportan realmente valor, los autores comparan GPT‑4.1 y GPT‑5 con dos enfoques clásicos de aprendizaje profundo: redes neuronales recurrentes (RNN) y redes generativas antagónicas (GAN), ambos adaptados para generar secuencias estilo ZigBee. Evalúan todos los modelos en múltiples dimensiones: qué tan bien los tiempos entre llegadas coinciden con el tráfico real, si los paquetes decodifican correctamente en herramientas estándar, si se respetan las reglas de protocolo y los roles de los dispositivos, la frecuencia de repetición de paquetes y la frecuencia con que copian exactamente ejemplos de entrenamiento. Los resultados muestran que ambos modelos GPT producen tráfico casi perfectamente decodificable y conforme al protocolo con baja divergencia respecto a los patrones temporales reales, mientras que las RNN luchan con el orden a largo plazo y las GAN con frecuencia crean tráfico irrealmente denso o semánticamente inválido, especialmente en comunicación bidireccional y duraciones largas.

Cuando más “pensar” no ayuda

El estudio también investiga una pregunta sorprendente: ¿mejora la realidad del tráfico darle al GPT‑5, orientado al razonamiento, más “tiempo de pensamiento” interno? Al ajustar el esfuerzo de razonamiento oculto de GPT‑5 de bajo a alto, los autores encuentran que un mayor esfuerzo hace al modelo más lento y más verboso, pero no mejora, y a veces empeora, la aproximación de su tráfico a la realidad. GPT‑4.1, un modelo más rápido y no centrado en el razonamiento, iguala o supera consistentemente a GPT‑5 en métricas clave de calidad mientras usa menos recursos computacionales. En simulaciones prolongadas de 30 minutos, ambos LLM mantienen el comportamiento correcto de ZigBee, pero las líneas base clásicas RNN y GAN se desvían fuertemente en tiempos y corrección del protocolo.

Qué implica esto para hogares inteligentes más seguros

Para el público no especialista, el mensaje principal es que los modelos de lenguaje modernos pueden aprender no solo conversaciones humanas sino también la “lengua” de los dispositivos de hogares inteligentes, generando tráfico creíble y conforme a reglas bajo demanda. El trabajo muestra que un modelo relativamente rápido y de baja latencia como GPT‑4.1 ya puede servir como generador de tráfico de alta fidelidad para pruebas y evaluación de seguridad, reduciendo potencialmente la necesidad de capturar datos sensibles del mundo real. También subraya que el razonamiento más complejo y pesado no siempre es mejor: para tareas técnicas estrechamente estructuradas, los modelos más simples y eficientes pueden ser la opción más inteligente. Con la publicación del código y los datos por parte de los autores, este enfoque podría ayudar a investigadores de todo el mundo a someter a estrés los sistemas de hogar inteligente, mejorar la detección de intrusiones y explorar nuevos diseños de red en un entorno seguro y sintético.

Cita: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Palabras clave: IoT para el hogar inteligente, generación de tráfico ZigBee, modelos de lenguaje grandes, pruebas de seguridad de redes, datos de red sintéticos