Clear Sky Science · es

Diagnóstico diferente de cáncer de mama BI-RADS usando MobileNetV1 y transformer de visión basado en inteligencia artificial explicable (XAI)

Detectar el riesgo de cáncer antes

El cáncer de mama es más tratable cuando se detecta precozmente, sin embargo la lectura de mamografías es una tarea difícil y con presión de tiempo. Este estudio describe un nuevo sistema de inteligencia artificial (IA) diseñado no solo para detectar signos de cáncer en mamografías con muy alta precisión, sino también para mostrar a los médicos exactamente qué zonas de la imagen mamaria influyeron en sus decisiones. Al combinar dos técnicas modernas de análisis de imagen de forma inteligente, el sistema pretende apoyar a los radiólogos con segundas opiniones rápidas, fiables y transparentes.

Por qué es tan difícil leer mamografías

Las mamografías son imágenes de rayos X de la mama usadas para buscar signos tempranos de cáncer. Los radiólogos asignan a cada examen una puntuación BI‑RADS, una escala estandarizada que va desde hallazgos normales hasta claramente cancerosos. En mamas densas, donde hay mucho tejido glandular, las zonas sospechosas pueden ocultarse o parecerse a estructuras inocuas. Muchas herramientas informáticas previas se centraron solo en decisiones simples de sí/no sobre cáncer, tuvieron dificultades con el rango completo de categorías BI‑RADS o funcionaron como una caja negra, dejando a los médicos sin saber por qué se tomó una decisión concreta.

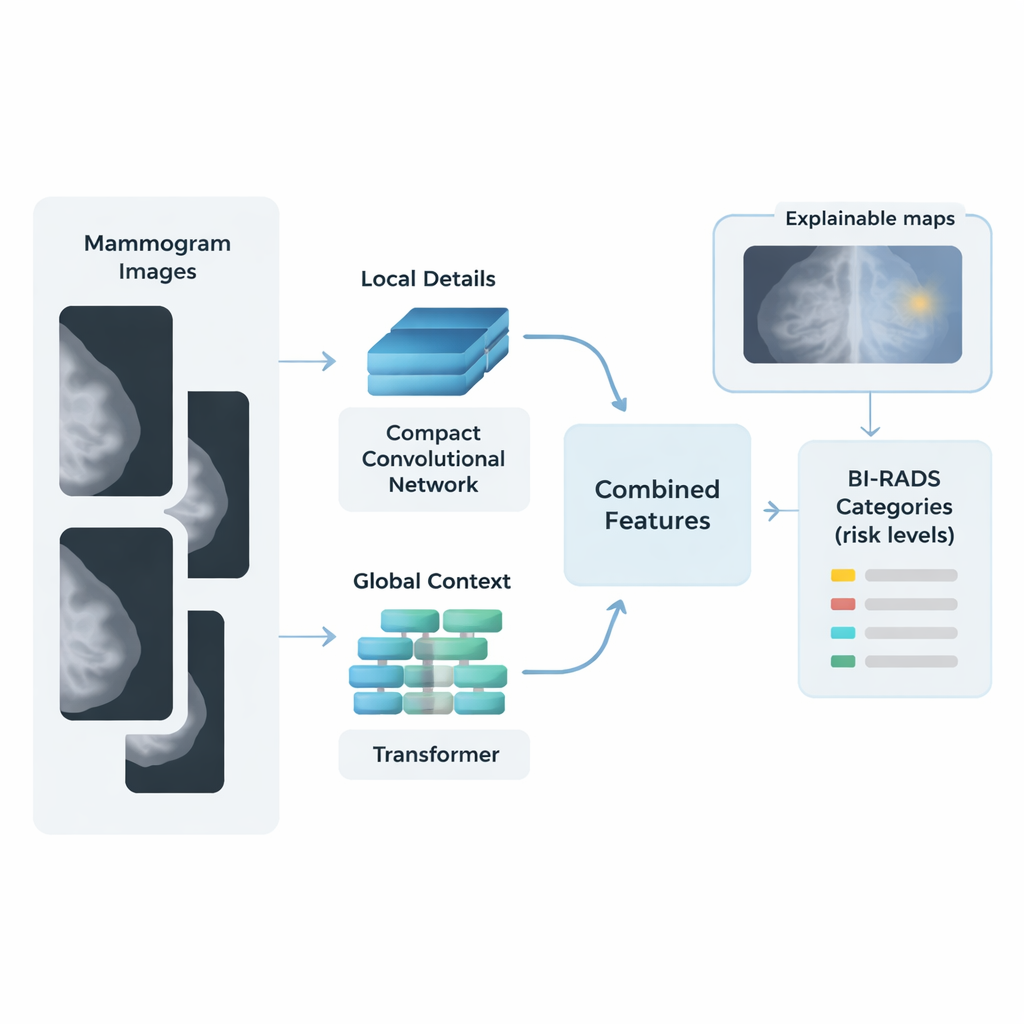

Combinando dos maneras de “mirar” una imagen

Los investigadores construyeron un marco híbrido de IA que imita cómo un lector humano cuidadoso podría inspeccionar una mamografía: primero examinando pequeños detalles y luego considerando el panorama general. Una parte del sistema, basada en una red compacta llamada MobileNetV1, se concentra en detalles locales como microcalcificaciones y bordes nítidos de lesiones. Una segunda parte, un transformer de visión, divide la imagen en parches y analiza cómo se relacionan los patrones en toda la mama, capturando la estructura general del tejido y distorsiones sutiles. Las características de estas dos “corrientes” se fusionan después en una única descripción enriquecida de cada imagen.

Limpiar, equilibrar y simplificar los datos

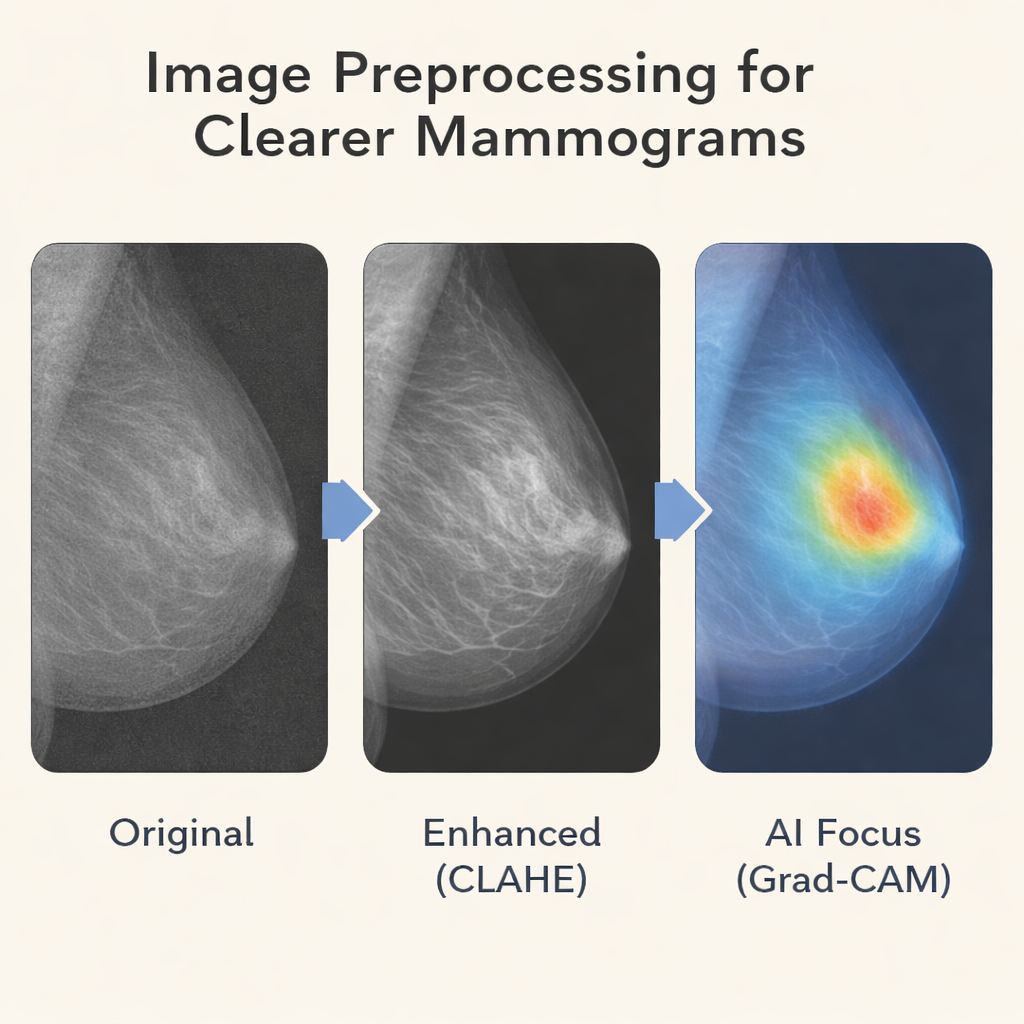

Antes de que las imágenes entren en la canalización de IA, pasan por varios pasos de preparación. El equipo mejora el contraste usando un método que realza estructuras sutiles sin exagerar el ruido, facilitando la visualización de manchas tenues. Las imágenes se redimensionan y normalizan para que el sistema las vea de forma consistente. Para compensar que algunas categorías BI‑RADS, como los casos claramente malignos, son relativamente raras, los autores usan trucos de aumento de datos como pequeñas rotaciones y volteos y aplican entrenamiento consciente de clases para que las categorías menos comunes sigan influyendo durante el aprendizaje. Tras la extracción de características por las dos corrientes, una herramienta matemática llamada análisis de componentes principales comprime esta información, conservando lo más relevante mientras reduce la complejidad.

De las características a las puntuaciones de riesgo, con explicaciones

Para el paso final, en lugar de confiar en un clasificador neuronal pesado y opaco, los autores utilizan muchos modelos de regresión logística sencillos combinados en un conjunto por “bagging”. Cada modelo ofrece una forma directa de conectar las características de la imagen con los niveles de riesgo BI‑RADS, y su votación mayoritaria aporta estabilidad y resistencia al sobreajuste en un conjunto de datos relativamente modesto. Probado en más de 6.000 mamografías del conjunto de datos de cáncer de mama de la Universidad King Abdulaziz, el sistema híbrido alcanzó más del 99 % de precisión, sensibilidad y especificidad en las cuatro categorías BI‑RADS clave que abordó: normal, probablemente benigno, sospechoso y maligno.

Permitir que los médicos vean lo que la IA ve

Para hacer sus decisiones comprensibles, el sistema emplea técnicas de IA explicable conocidas como Grad‑CAM y Grad‑CAM++. Estas producen mapas de calor coloreados superpuestos a la mamografía, destacando las regiones que más influyeron en la puntuación BI‑RADS predicha. En los casos malignos, las áreas resaltadas suelen alinearse con masas o agrupaciones de calcificaciones señaladas por radiólogos expertos; en las imágenes normales hay poca o ninguna activación focalizada. Esta retroalimentación visual ayuda a los clínicos a juzgar si el modelo está prestando atención a características médicamente significativas y puede revelar por qué ciertos casos limítrofes—como tejido denso que imita una lesión—son difíciles incluso para los expertos.

Qué podría significar esto para los pacientes

El estudio muestra que, en un único conjunto de datos clínicos, este sistema de IA explicable de doble corriente puede clasificar mamografías en múltiples niveles de riesgo con una precisión comparable y, en algunos aspectos, superior a muchos métodos previos. Si bien aún debe probarse en poblaciones más diversas y en distintos hospitales, el enfoque apunta hacia herramientas de IA que no solo son altamente precisas, sino también lo suficientemente rápidas para clínicas con mucho trabajo y lo bastante transparentes para ganarse la confianza de radiólogos y pacientes. En la práctica, dichos sistemas podrían actuar como un par extra de ojos expertos: señalando hallazgos sutiles, reduciendo cánceres no detectados y apoyando conversaciones más claras y seguras sobre el riesgo de cáncer de mama.

Cita: Abdelsabour, I., Elgarayhi, A., Sallah, M. et al. Different BI-RADS breast cancer diagnosis using MobileNetV1 and vision transformer based on explainable artificial intelligence (XAI). Sci Rep 16, 7190 (2026). https://doi.org/10.1038/s41598-026-37199-2

Palabras clave: cáncer de mama, mamografía, inteligencia artificial, transformer de visión, IA explicable