Clear Sky Science · es

Evaluación de las vulnerabilidades de sistemas de marcha mediante PPO y ataques adversarios generados por GAN

Por qué importa engañar un patrón de marcha

La mayoría de nosotros reconocemos a amigos y familiares por su forma de caminar, incluso a distancia. Los ordenadores ahora pueden hacer algo similar: los sistemas de "reconocimiento de la marcha" analizan el estilo de andar de una persona para identificarla sin huellas dactilares ni escáneres faciales. Estas herramientas se usan cada vez más en seguridad y vigilancia. Este estudio plantea una pregunta inquietante: ¿qué tan fácil es engañar a tales sistemas utilizando cambios diminutos y cuidadosamente diseñados que las personas no notan, pero que las máquinas sí? La respuesta tiene importantes implicaciones para la privacidad, la seguridad y la confianza que podemos depositar en la inteligencia artificial en entornos de alto riesgo.

Cómo los ordenadores leen nuestra forma de andar

El reconocimiento moderno de la marcha se basa en el aprendizaje profundo, la misma familia de técnicas detrás del reconocimiento facial y los vehículos autónomos. En lugar de mirar una sola instantánea, estos sistemas combinan muchos fotogramas de una persona caminando en una única "imagen de energía de la marcha", una especie de silueta difuminada que captura cómo se mueven las partes del cuerpo a lo largo de un ciclo de paso completo. Una red neuronal diseñada ad hoc aprende entonces a distinguir la marcha de una persona de la de otra, incluso cuando cambian la ropa o los objetos que llevan. En pruebas con dos grandes colecciones de investigación de vídeos de personas caminando (los conjuntos de datos CASIA-B y OU-ISIR), el modelo de referencia de los autores identificó correctamente a las personas en más del 97% de los casos: un rendimiento sólido que podría sugerir que la tecnología está lista para un despliegue en el mundo real.

Las pegatinas invisibles que engañan a cámaras inteligentes

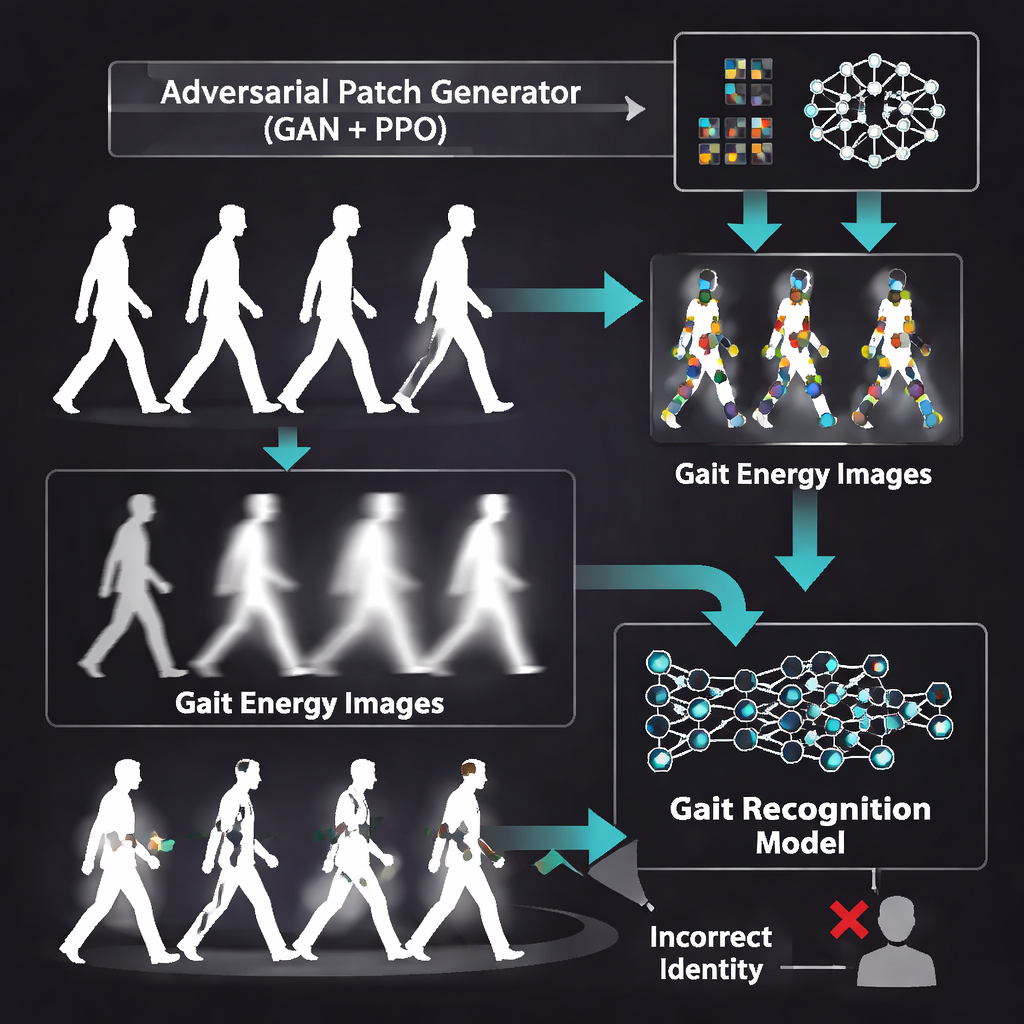

El núcleo del artículo no es construir un mejor sistema de identificación, sino romperlo a propósito para exponer sus debilidades. Los investigadores generan pequeñas "parches adversarios": regiones cuadradas de píxeles alterados que parecen inofensivas, pero están afinadas matemáticamente para confundir a la red neuronal. Para crear estos parches usan una Red Generativa Antagónica (GAN), un tipo de IA que aprende a producir imágenes de apariencia realista compitiendo contra un crítico integrado. La GAN se entrena directamente con imágenes de energía de la marcha para que su salida se integre de manera natural en las siluetas fantasmales. Estos parches están diseñados para ser lo bastante sutiles como para que una persona que mira la forma de andar probablemente no note nada extraño.

Dejar que un agente aprenda a encontrar los puntos débiles

El lugar donde se coloca un parche puede importar tanto como su apariencia. Para descubrir las ubicaciones más dañinas, los autores recurren a un método de aprendizaje por refuerzo llamado Proximal Policy Optimization (PPO). Tratan cada imagen de marcha como un entorno en forma de cuadrícula y permiten que un "agente" de software mueva el parche —arriba, abajo, izquierda o derecha— mientras observa cuánto cae la confianza del sistema de reconocimiento. Cuando una posición provoca que el modelo identifique mal a la persona, el agente recibe una recompensa; cuando falla, se le penaliza. A lo largo de muchos episodios, el agente aprende una política para colocar los parches en regiones especialmente vulnerables de la imagen de la marcha, a menudo cerca de las partes del cuerpo en movimiento de las que el modelo depende más.

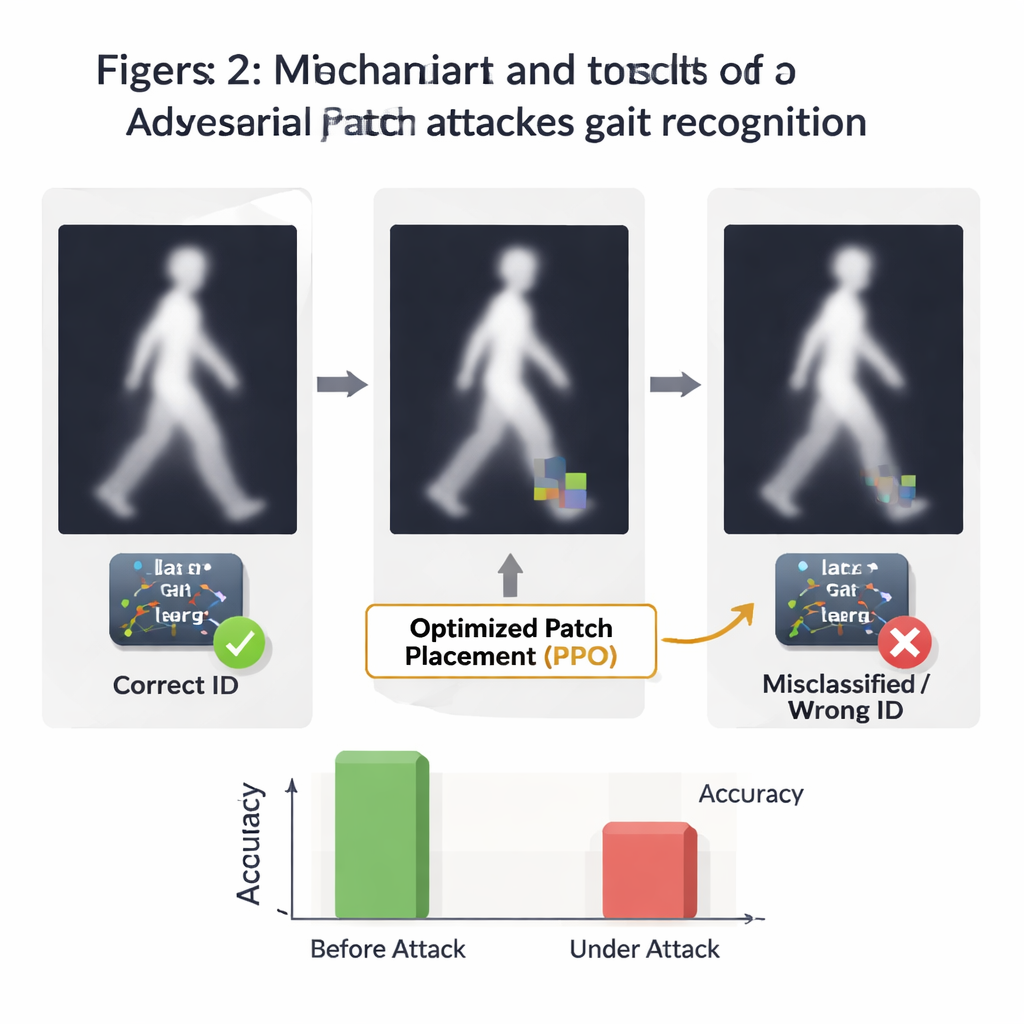

Qué ocurre cuando se desata el ataque

Tras entrenar tanto el generador de parches como la estrategia de colocación, el equipo ataca su propio reconocedor de la marcha de alto rendimiento. En condiciones normales, el sistema muestra una excelente exactitud, pocas falsas alarmas y una fuerte separación entre coincidencias correctas e incorrectas. Sin embargo, una vez que se añaden parches adversarios, el rendimiento cae drásticamente. Dependiendo de cuánta libertad tenga el parche para moverse por la imagen, las tasas de éxito del ataque superan el 60% y la fracción de personas identificadas correctamente puede caer hasta casi un tercio de su nivel original. Curvas que antes mostraban una discriminación casi perfecta entre usuarios genuinos e impostores se desploman hacia la línea del azar, revelando lo fácil que es desviar al modelo sin distorsiones visibles.

Qué significa esto para la seguridad cotidiana

Para los no especialistas, la conclusión es clara: un sistema de reconocimiento de la marcha que parece muy preciso en el laboratorio puede ser sorprendentemente frágil frente a manipulaciones ingeniosas diseñadas por máquinas. El estudio muestra que combinar herramientas generativas de imágenes con aprendizaje por prueba y error puede producir cambios diminutos y casi invisibles que causan errores de identificación graves. Más que una guía para el abuso en el mundo real, el trabajo pretende ser una advertencia y un marco de pruebas. Ofrece a los diseñadores de sistemas una forma de sondear y medir cuán vulnerables son sus modelos, y subraya la necesidad de construir defensas contra tales ataques antes de confiar ampliamente en el reconocimiento de la marcha para vigilancia, control de acceso u otras aplicaciones críticas.

Cita: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Palabras clave: reconocimiento de la marcha, seguridad biométrica, ataques adversarios, aprendizaje profundo, aprendizaje por refuerzo