Clear Sky Science · es

Evaluación comparativa de modelos de reconocimiento de acciones para la detección de autolesiones en conjuntos de datos de estudio y del mundo real

Vigilar a los pacientes con ojos digitales

En los hospitales psiquiátricos, las enfermeras trabajan sin descanso para mantener a los pacientes a salvo, especialmente a aquellos en riesgo de hacerse daño. Sin embargo, ni siquiera el personal más dedicado puede vigilar todas las habitaciones cada segundo. Este estudio explora si la inteligencia artificial (IA) puede ayudar al examinar automáticamente el vídeo de las cámaras de planta para detectar signos tempranos de autolesiones, ofreciendo una capa adicional de protección sin sustituir la atención humana.

Por qué es tan difícil detectar las autolesiones

La autolesión—cualquier daño intencional que una persona se inflige a sí misma—suele ocurrir en momentos breves y ocultos: un rasguño rápido bajo una manta o el uso de una pequeña herramienta fuera de la vista. Las plantas psiquiátricas dependen de revisiones periódicas y de la vigilancia por cámaras, pero los puntos ciegos, la fatiga del personal y la dotación limitada durante la noche o en festivos hacen imposible una vigilancia constante. Al mismo tiempo, grabar y compartir imágenes reales de pacientes plantea serias preocupaciones éticas y de privacidad. Como resultado, los investigadores han tenido muy pocos vídeos realistas para entrenar sistemas de IA que puedan detectar conductas peligrosas en tiempo real.

Construir bancos de prueba más seguros para la IA

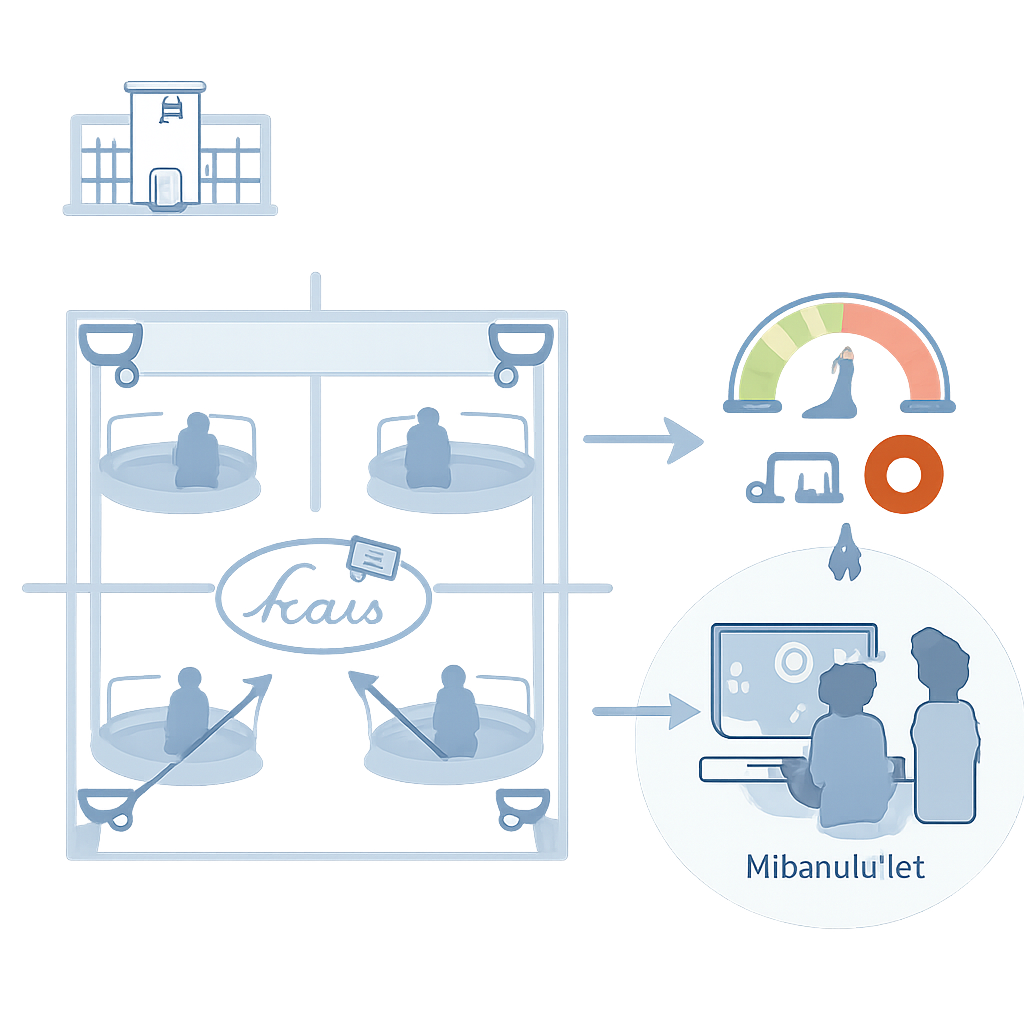

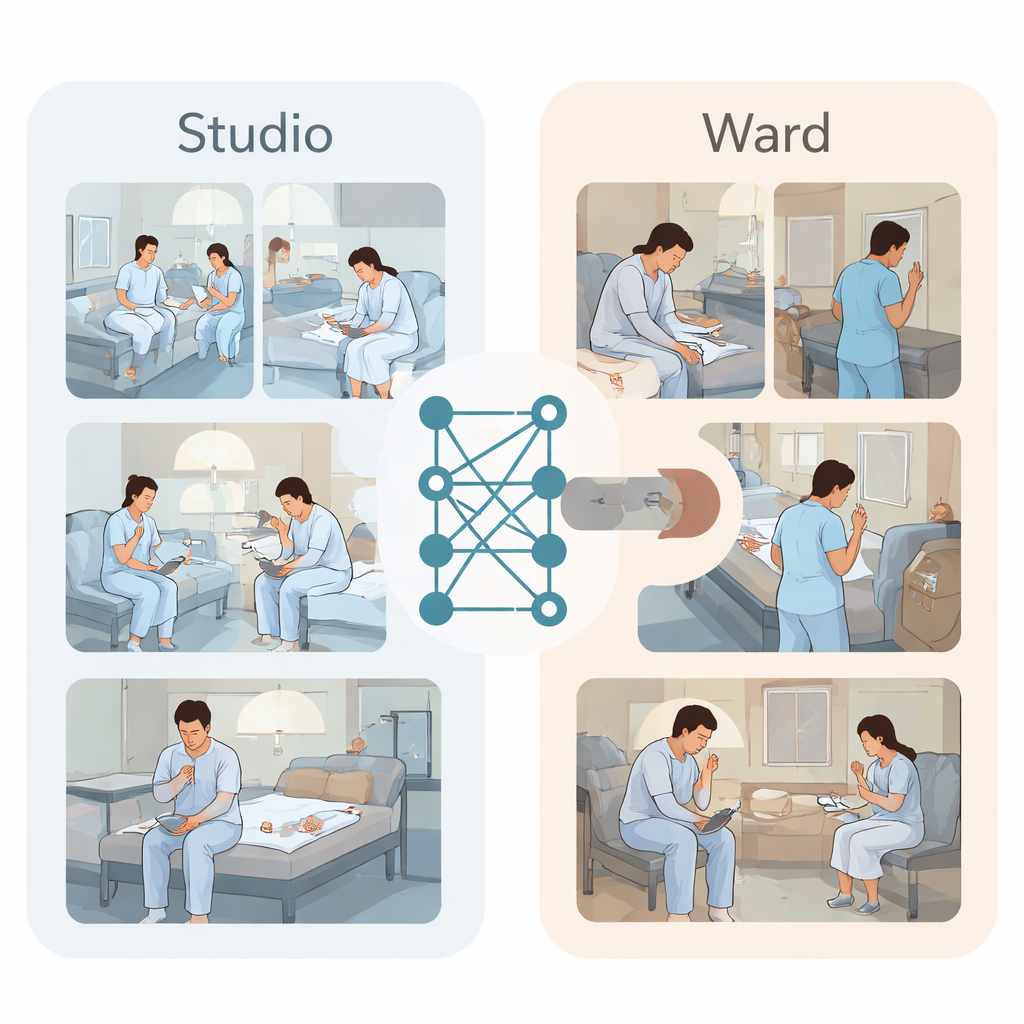

Para romper este estancamiento, los investigadores crearon dos tipos de conjuntos de datos de vídeo. Primero, en un estudio diseñado para asemejarse a una habitación psiquiátrica de cuatro camas, siete actores jóvenes con batas de paciente interpretaron escenas cuidadosamente planificadas. Buscaron objetos cotidianos como tapones de plástico, tubos de bálsamo labial o pequeñas uñas, y luego representaron breves secuencias de movimientos de autolesión en la muñeca, el antebrazo o el muslo, con cámaras cenitales grabando desde todos los ángulos. Expertos etiquetaron cada segmento de vídeo como comportamiento normal o autolesión, construyendo una colección limpia y balanceada de 1120 clips. En segundo lugar, el equipo reunió metraje real de vigilancia de plantas psiquiátricas seguras durante diez meses. Los clínicos buscaron en los registros médicos notas sobre conductas como rascarse, hurgarse o cortarse y localizaron el vídeo coincidente. Tras difuminar rostros y eliminar detalles identificativos, reunieron 59 clips que mostraban autolesiones reales y 59 clips normales como comparación.

Probar la mejor IA de vídeo disponible hoy

Con estos conjuntos de datos, el equipo evaluó sistemas líderes de reconocimiento de acciones—programas informáticos diseñados para entender lo que las personas hacen en un vídeo. Algunos se basaban en redes convolucionales más antiguas, que analizan secuencias cortas de fotogramas, mientras que modelos más recientes basados en transformadores usan mecanismos de atención para conectar patrones en el espacio y el tiempo. Todos los modelos se entrenaron únicamente con los vídeos de estudio para decidir si un clip mostraba autolesión o comportamiento normal. Es importante destacar que los investigadores emplearon un esquema de prueba estricto: en cada ronda, se apartaban como datos de prueba completamente nuevos todos los clips de un mismo actor, asegurando que los algoritmos no pudieran limitarse a memorizar a personas individuales.

Cuando los vídeos limpios de laboratorio se enfrentan a la realidad desordenada

En el metraje ordenado del estudio, el modelo transformador más avanzado, llamado VideoMAEv2, destacó. Equilibró correctamente errores por omisión y falsas alarmas mejor que los demás, alcanzando una puntuación F1 (una medida combinada de precisión y sensibilidad) de aproximadamente 0,65, mientras que métodos más simples se situaron cerca del azar. Las explicaciones visuales mostraron que este modelo se centraba con precisión en donde una herramienta tocaba la piel, en lugar de distraerse con el movimiento de fondo. Pero una vez que los mismos sistemas entrenados se aplicaron a las grabaciones reales de la planta—sin ningún reentrenamiento—su rendimiento cayó. VideoMAEv2 aún obtuvo mejores resultados que el azar, con una puntuación F1 alrededor de 0,61, pero tuvo particular dificultad con conductas sutiles como hurgarse y rascarse que nunca habían aparecido en los datos simulados, y con pacientes que eran pequeños, estaban lejos de la cámara o parcialmente ocultos.

Qué significa esto para la seguridad del paciente

En conjunto, los resultados revelan una clara brecha de "simulación a realidad". Los sistemas de IA que parecen prometedores en vídeos cuidadosamente escenificados pueden fallar al enfrentarse al desorden, los ángulos extraños y la variedad de comportamientos de la vida hospitalaria real. La contribución principal del estudio no es un producto de seguridad acabado sino un punto de partida: un conjunto de datos de estudio público y bien anotado, un conjunto de pruebas del mundo real recopilado con cuidado y una evaluación transparente que muestra dónde fallan los métodos actuales. Para los no especialistas, el mensaje es directo: la IA ya puede ayudar a resaltar momentos sospechosos en las retransmisiones de vídeo de las plantas, pero aún no puede confiarse como guardián independiente. Cerrar esta brecha requerirá datos de entrenamiento más ricos y diversos y modelos más inteligentes, desarrollados con la privacidad, la equidad y el juicio clínico como prioridades.

Cita: Lee, K., Lee, D., Ham, HS. et al. Benchmarking action recognition models for self-harm detection in studio and real-world datasets. Sci Rep 16, 6850 (2026). https://doi.org/10.1038/s41598-026-36999-w

Palabras clave: detección de autolesiones, plantas psiquiátricas, reconocimiento de acciones en vídeo, inteligencia artificial en salud, seguridad del paciente