Clear Sky Science · es

Explorando el reconocimiento emocional de los estudiantes y la retroalimentación docente en el aula universitaria de lengua extranjera basado en el modelo AFCNN

Por qué su profesor pronto podría “leer la sala” con IA

Cualquiera que haya pasado por una clase aburrida sabe que el aburrimiento puede matar el aprendizaje de manera silenciosa. Sin embargo, los docentes a menudo solo cuentan con su intuición para adivinar cómo se sienten los estudiantes en el momento. Este estudio explora una forma nueva de proporcionar a los profesores universitarios de lenguas extranjeras una especie de “panel emocional” impulsado por inteligencia artificial (IA). Al leer las expresiones faciales de los estudiantes en tiempo real, el sistema ayuda a los docentes a ajustar su enseñanza sobre la marcha y, a largo plazo, respalda su crecimiento profesional.

Los sentimientos importan tanto como la gramática

Las clases de lenguas extranjeras no son solo listas de vocabulario y reglas gramaticales. Son espacios sociales donde la confianza, la ansiedad, la curiosidad y el aburrimiento influyen en la eficacia del aprendizaje. Investigaciones previas han mostrado que la formación docente suele concentrarse en métodos y conocimientos de la materia, prestando menos atención a las emociones en clase. Las herramientas tradicionales, como encuestas al final del semestre o conversaciones postclase, llegan demasiado tarde para rescatar una lección con dificultades. Los autores sostienen que, si los profesores pudieran ver cómo cambian las emociones minuto a minuto, podrían responder más rápido: acelerar, reducir el ritmo o cambiar actividades antes de que los estudiantes desconecten mentalmente.

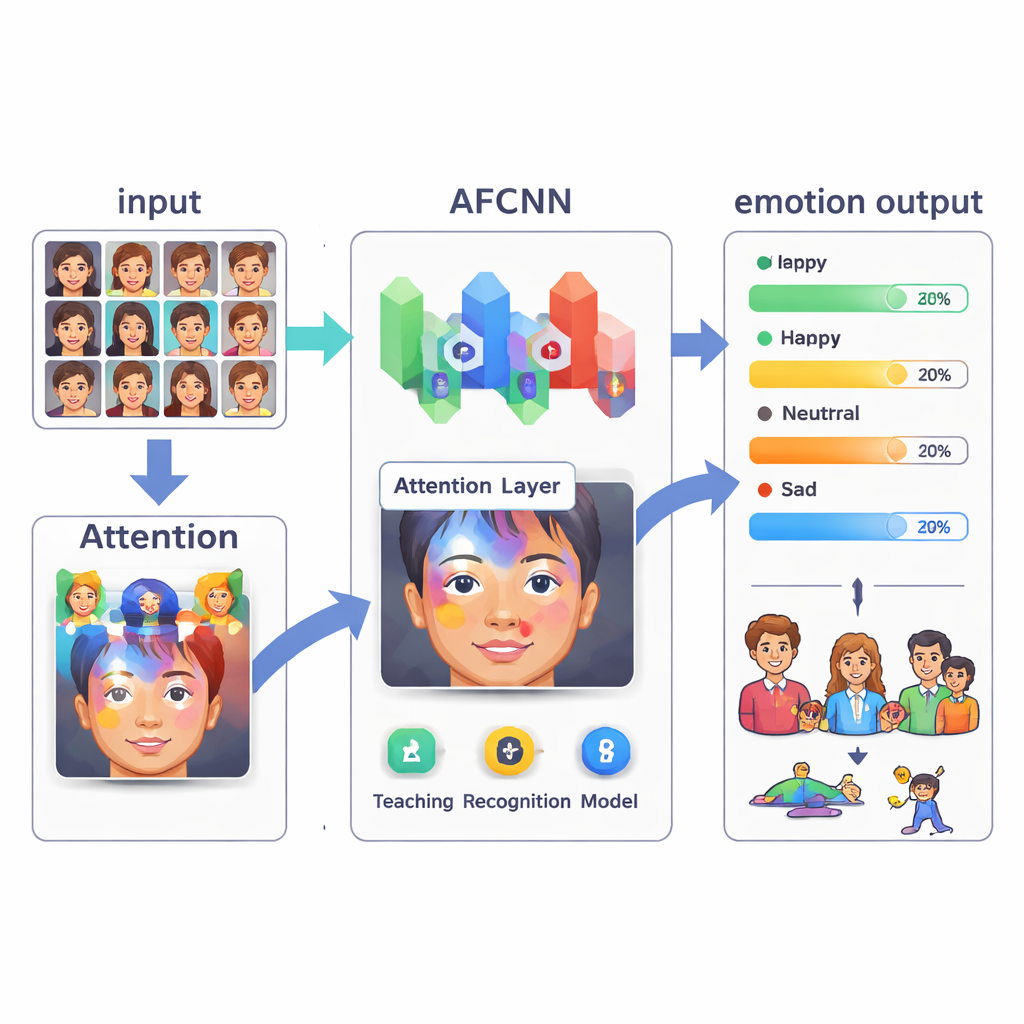

Convertir rostros en señales útiles

El núcleo del estudio es un modelo de aprendizaje profundo llamado Attention Feature Convolutional Neural Network, o AFCNN. En términos sencillos, una cámara en el aula captura los rostros de los estudiantes mientras aprenden. El modelo sigue luego tres pasos: localiza cada rostro, extrae características relacionadas con las expresiones y las clasifica en una de siete emociones básicas, como felicidad, tristeza, miedo o un estado neutral. Un mecanismo especial de «atención» ayuda a la IA a centrarse en las partes más informativas del rostro —como los ojos o la boca— mientras ignora distracciones. A diferencia de enfoques anteriores que funcionan mejor con fotos limpias y frontales, este sistema está diseñado para manejar condiciones más realistas, como vistas parciales, manos sobre la cara o estudiantes mirando de lado.

Qué tan bien funciona realmente el sistema

Para probar el AFCNN, los investigadores lo entrenaron con una colección bien conocida de imágenes faciales etiquetadas con categorías emocionales y ampliaron los datos con ajustes sencillos como rotación y cambios de brillo. Luego compararon su desempeño con dos modelos consolidados de reconocimiento de imágenes, VGG16 y ResNet18. En condiciones claras sin obstrucciones, el nuevo modelo identificó correctamente las emociones en torno al 81% de las veces y destacó especialmente en el reconocimiento de expresiones felices y neutrales, alcanzando alrededor de la mitad del 80% en precisión. Cuando los rostros estaban parcialmente bloqueados —por cabello, manos o sombreros— la precisión bajó para todos los sistemas, pero AFCNN aún superó a los demás y mostró resultados más equilibrados entre distintas emociones, lo que sugiere que es más robusto para aulas reales.

De lecturas emocionales a mejores lecciones

El estudio va más allá de la precisión total y se pregunta si esta tecnología realmente mejora la enseñanza. En un ensayo de un mes con 200 profesores universitarios de lengua extranjera, la mitad usó el sistema de reconocimiento emocional y la otra mitad enseñó como de costumbre. Los docentes con acceso a retroalimentación emocional en tiempo real cambiaron sus planes de enseñanza más del doble de veces durante una lección, reportaron mayor satisfacción con su labor y observaron mayor participación e interacción estudiantil. Los investigadores también diseñaron un mapeo sencillo de patrones emocionales a respuestas sugeridas —por ejemplo, pasar a discusión o repaso cuando aparecen signos de confusión o frustración— desplazando el sistema de la mera observación de emociones a la orientación activa de la actuación docente.

Qué significa esto para las aulas del futuro

En términos cotidianos, esta investigación sugiere que las aulas futuras podrían contar con un asistente silencioso que observe las caras de los estudiantes y susurre al profesor cuando el grupo pierde energía o cuando muchos parecen desconcertados. El sistema AFCNN no es perfecto —aún tiene dificultades con emociones sutiles como el asco o el miedo, y depende de imágenes etiquetadas de alta calidad—, pero demuestra que la IA puede captar tendencias emocionales de forma fiable y que los docentes pueden usar esa información para enseñar con mayor capacidad de respuesta. Para los estudiantes, eso podría traducirse en clases más atractivas y de apoyo; para los profesores, ofrece una nueva herramienta de desarrollo profesional que combina psicología, educación e IA en un entorno de aprendizaje más inteligente y atento a lo humano.

Cita: Shi, L. Exploring students’ emotion recognition and teachers’ teaching feedback in college foreign language classroom based on AFCNN model. Sci Rep 16, 5657 (2026). https://doi.org/10.1038/s41598-026-36747-0

Palabras clave: reconocimiento emocional en el aula, IA en la educación, enseñanza de lenguas extranjeras, desarrollo profesional docente, modelos de aprendizaje profundo