Clear Sky Science · es

Migración de servicios adaptativa consciente de la latencia y la energía en computación en el borde móvil

Por qué importa acercar las aplicaciones a ti

Cada vez que juegas en línea en el coche, transmites indicaciones de realidad aumentada en el móvil o un sensor de una ciudad inteligente envía datos, esas tareas digitales deben procesarse en algún lugar. La computación en el borde móvil (MEC) traslada ese trabajo desde centros de datos lejanos a pequeños servidores ubicados cerca de estaciones base celulares, reduciendo la latencia y haciendo que las aplicaciones respondan mejor. Pero mantener estos servicios cerca de usuarios en movimiento requiere «mover» (migrar) con frecuencia la aplicación en ejecución entre servidores de borde próximos. Mover demasiado desperdicia energía y dinero; mover muy poco genera retraso y frustración. Este estudio explora cómo alcanzar un equilibrio inteligente usando aprendizaje automático avanzado.

Equilibrando rapidez y consumo eléctrico

La mayoría de investigaciones previas sobre migración de servicios en MEC se centraron principalmente en un objetivo: mantener la latencia percibida por el usuario lo más baja posible. Eso suele implicar seguir al usuario mientras se desplaza y trasladar repetidamente su aplicación al servidor más cercano. Sin embargo, cada migración consume energía adicional de comunicación y genera su propia latencia. Muchos métodos anteriores también asumieron abundante capacidad de servidor y condiciones estables, ignorando la realidad de que los servidores de borde tienen recursos limitados, compiten por muchos usuarios y enfrentan cargas y calidad de enlace inalámbrico rápidamente cambiantes. Los autores sostienen que la energía de migración debe tratarse como un objetivo central, al mismo nivel que la latencia, y que las políticas de migración deben adaptarse en línea al movimiento de usuarios, la carga de los servidores y las fluctuaciones de la red.

De un problema matemático a un agente que aprende

Los investigadores primero construyen un modelo matemático detallado de un sistema MEC con múltiples estaciones base, servidores de borde co‑localizados y usuarios móviles. Cada usuario descarga tareas de cálculo a servidores cercanos a través de enlaces inalámbricos. La latencia total del servicio se descompone en tres partes: tiempo para enviar la tarea a la estación base, tiempo de cómputo en el servidor y tiempo adicional si el servicio se mueve entre servidores por la red de interconexión cableada. La energía de migración se modela principalmente en función de la cantidad de datos que deben transferirse cuando un servicio se desplaza. El objetivo global es minimizar tanto la latencia como la energía de migración respetando los límites de capacidad de cómputo de cada servidor y los plazos de cada servicio. Resolver exactamente este problema mixto entero y no lineal es intratable en tiempo real, por lo que el equipo recurre al aprendizaje por refuerzo profundo, donde un agente aprende buenas decisiones interactuando con un entorno simulado.

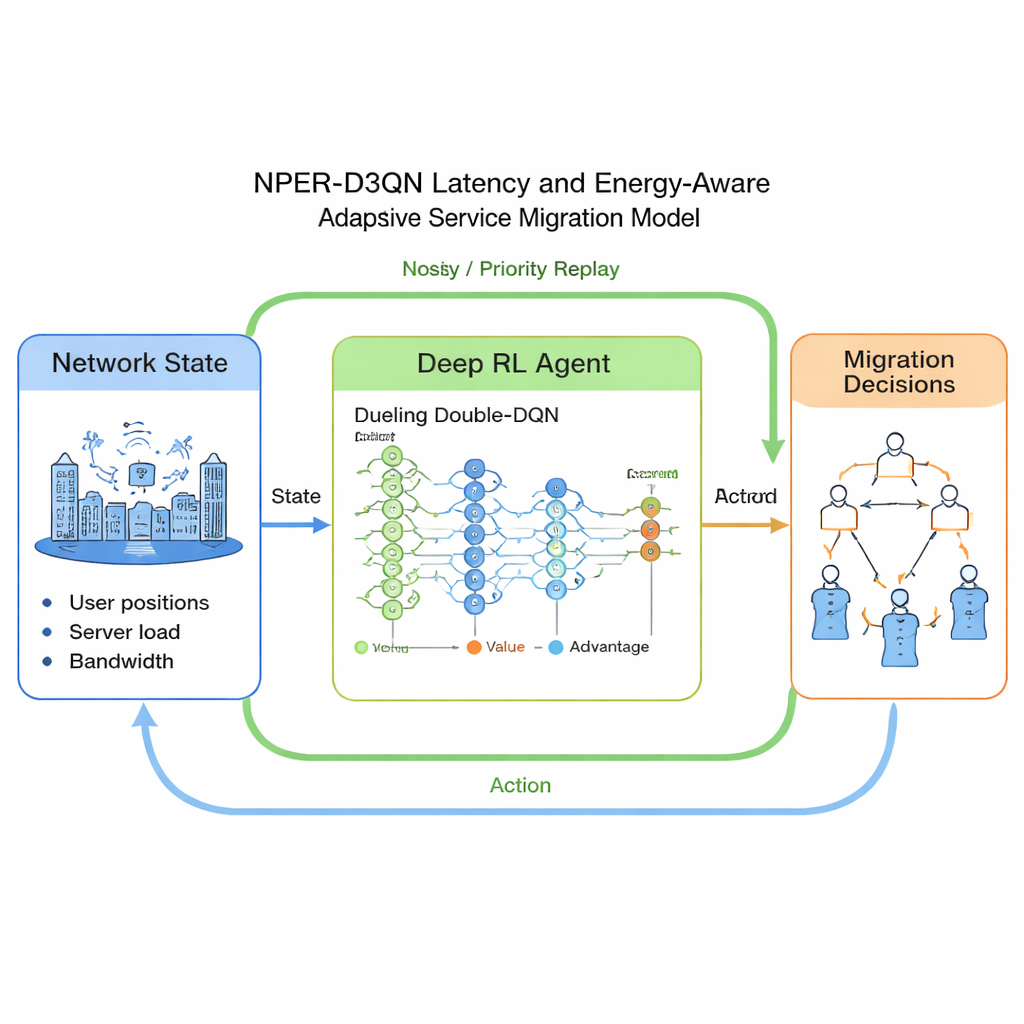

Cómo funciona el cerebro adaptativo de migración

El método propuesto, llamado NPER‑D3QN, es una variante sofisticada de las Deep Q‑Networks (DQN). El "estado" de entrada del agente resume dónde están los usuarios, qué distancia los separa de su estación base servidora, la carga de cada servidor de borde, la capacidad de cómputo disponible, las tasas de datos inalámbricas y el tamaño y la demanda de cálculo de cada servicio. Sus "acciones" son las elecciones de qué servidor de borde debe alojar el servicio de cada usuario en el siguiente intervalo temporal. La función de recompensa fomenta una baja latencia respecto al plazo de cada servicio mientras penaliza la energía de migración, empujando al agente a compensar velocidad frente a consumo eléctrico. Técnicamente, el modelo combina tres ideas: una red dueling que estima por separado el valor de estar en un estado y la ventaja de cada acción, una estructura de "double" Q‑learning que reduce estimaciones demasiado optimistas, y dos ayudas de exploración —redes ruidosas y reproducción priorizada de experiencias— que le permiten aprender más rápido y de forma más fiable en condiciones complejas y cambiantes.

Poniendo el enfoque a prueba

Para evaluar el rendimiento de NPER‑D3QN, los autores simulan una cuadrícula tipo ciudad con decenas de estaciones base y hasta cientos de usuarios móviles que se desplazan aleatoriamente y envían tareas de tamaños variados. Los servidores de borde tienen potencia de cómputo limitada y solo pueden alojar un número fijo de máquinas virtuales, lo que genera colas y contención realistas. Comparan su método con seis referentes de última generación, incluyendo DQN clásico, variantes mejoradas double‑dueling y esquemas que o bien siempre persiguen el servidor más cercano o se centran únicamente en minimizar la latencia. En una variedad de escenarios, NPER‑D3QN converge a buenas estrategias más rápido y logra de forma consistente menor latencia media del servicio, menor consumo energético relacionado con la migración y menos migraciones rechazadas cuando los servidores están llenos. En una prueba a gran escala con 720 usuarios y 96 servidores, reduce la latencia hasta en aproximadamente dos tercios y la energía de migración en más del 90% frente a algunas alternativas, manteniendo el tiempo de cómputo por decisión dentro de límites prácticos.

Qué significa esto para los servicios conectados del futuro

Para quienes no son especialistas, la conclusión es que simplemente acercar las aplicaciones a los usuarios no basta: también necesitamos un control inteligente de cuándo y dónde se mueven los servicios en ejecución. Este trabajo muestra que un controlador basado en aprendizaje puede "malabarear" los objetivos en competencia de capacidad de respuesta, ahorro energético y límite de recursos en el borde sin reglas diseñadas a mano. Si sistemas similares se desplegaran en redes reales, podrían ayudar a los operadores a ofrecer experiencias más fluidas para aplicaciones como conducción autónoma, realidad aumentada inmersiva e IoT industrial, a la vez que reducen la factura eléctrica y la presión sobre la infraestructura. Los autores señalan que su estudio se basa en simulaciones y omite algunos detalles del mundo real, como el consumo completo de energía de los servidores y la monitorización imperfecta, pero representa un paso prometedor hacia una computación en el borde más verde y adaptable.

Cita: Li, L., Lv, J., Wang, S. et al. Latency and energy-aware adaptive service migration in mobile edge computing. Sci Rep 16, 6178 (2026). https://doi.org/10.1038/s41598-026-36711-y

Palabras clave: computación en el borde móvil, migración de servicios, aprendizaje por refuerzo profundo, optimización de latencia, eficiencia energética