Clear Sky Science · es

Algoritmo de Optimización Secante para una optimización global eficiente

Búsqueda más inteligente para problemas difíciles

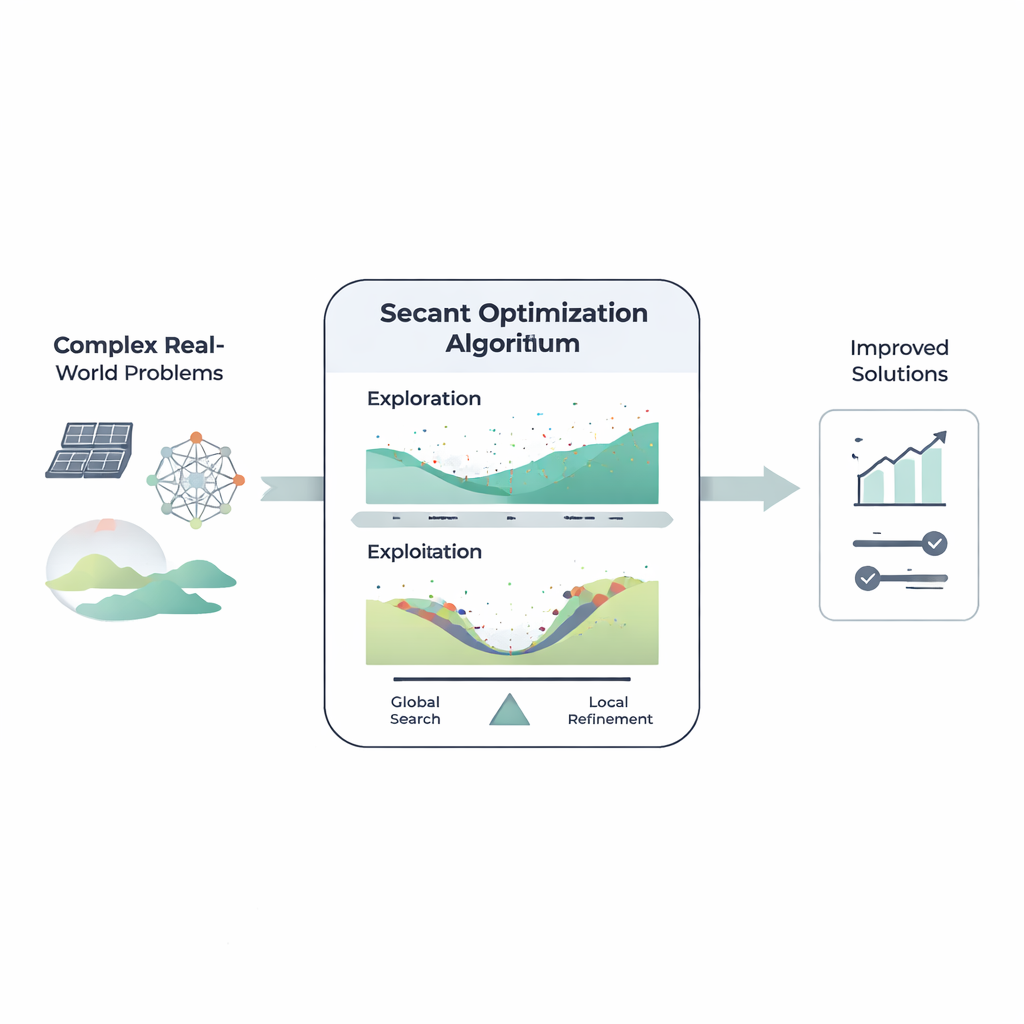

Desde diseñar paneles solares más limpios hasta entrenar sistemas de reconocimiento de imágenes precisos, muchos de los retos actuales se reducen a la misma tarea: explorar un espacio enorme de posibilidades para encontrar una buena solución. Este artículo presenta el Algoritmo de Optimización Secante (SOA), una nueva forma de llevar a cabo esa búsqueda de manera más eficiente. Inspirado en una idea clásica del cálculo pero diseñado para datos reales y ruidosos, SOA pretende ser rápido y fiable cuando los métodos tradicionales se quedan cortos.

Por qué la optimización necesita nuevas ideas

Los problemas modernos de ingeniería y ciencia de datos suelen involucrar docenas o cientos de parámetros ajustables, múltiples objetivos y relaciones enredadas que son difíciles de expresar con fórmulas simples. Las técnicas clásicas que siguen gradientes exactos, como el descenso más pronunciado, pueden fallar cuando el paisaje es áspero, está lleno de trampas locales, o cuando es difícil o imposible calcular derivadas. En respuesta, los investigadores han desarrollado algoritmos “metaheurísticos” que imitan la naturaleza, la física o principios matemáticos para explorar estos paisajes complejos. Estos métodos, como los algoritmos genéticos o los optimizadores por enjambre, han demostrado ser notablemente versátiles, pero aún enfrentan compromisos entre explorar ampliamente y afinar con precisión.

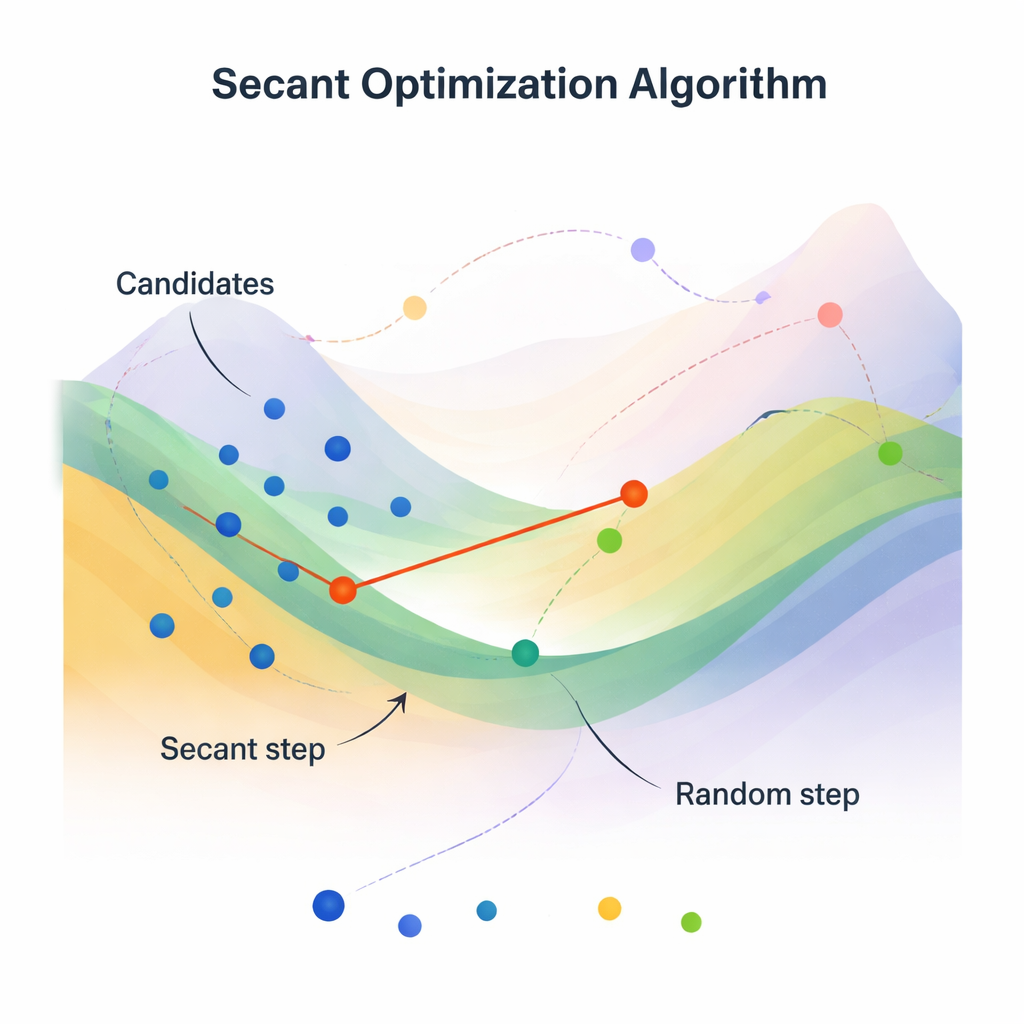

Convertir un truco de libro en un motor de búsqueda

El núcleo de SOA es el método de la secante, un antiguo truco numérico para encontrar donde una curva cruza cero sin necesitar derivadas exactas. En lugar de usar una pendiente calculada con cálculo, el método de la secante traza una línea recta entre dos puntos cercanos de la curva y utiliza esa línea como una pendiente aproximada. SOA generaliza esta idea a muchas dimensiones y a múltiples soluciones candidatas a la vez. Mantiene una población de vectores (posibles respuestas) y los actualiza repetidamente usando pasos tipo secante que aproximan cómo tiende la función objetivo, pero solo a partir de valores de la función. Esto hace que el método sea atractivo en escenarios donde los gradientes son ruidosos, costosos o están indefinidos, como ajustar hiperparámetros de redes neuronales observando el error de validación.

Equilibrar exploración amplia con enfoque preciso

El diseño de SOA separa explícitamente cómo explora y cómo refina. En la fase de exploración, cada candidato se ajusta mediante una regla basada en la secante que combina información de la mejor solución actual, del vector actual y de un par elegido al azar. Esto ayuda a dirigir la búsqueda hacia direcciones que parecen prometedoras, sin ser completamente aleatorio. En la fase de explotación, SOA introduce un “factor de expansión” y aleatoriedad controlada. Empuja soluciones hacia el mejor, la media, el punto más cercano e incluso el más lejano de la población, e incorpora paseos aleatorios. Una regla simple de mutación ocasional mantiene una posición antigua en lugar de la nueva, lo que preserva la diversidad. En conjunto, estos mecanismos ayudan a SOA a escapar de trampas locales mientras converge hacia soluciones de alta calidad.

Pruebas en benchmarks y dispositivos reales

Para comprobar si SOA es algo más que una buena idea en papel, los autores lo evalúan en familias de benchmarks ampliamente usadas conocidas como CEC2021 y CEC2020. Estas funciones están diseñadas para ser exigentes: algunas son de baja dimensión pero llenas de falsos mínimos; otras se extienden a 50 o 100 dimensiones. A través de estas pruebas, SOA se compara con dos grupos de algoritmos competidores, incluidos 11 métodos inspirados en matemáticas y 9 optimizadores recientes o variantes. Usando estadísticas como error medio, variabilidad, curvas de convergencia y pruebas por rangos, SOA iguala o supera consistentemente a la mayoría de los rivales, particularmente en alcanzar buenas soluciones de forma rápida y fiable. Los autores van más allá de las pruebas sintéticas hacia dos tareas reales exigentes: estimar parámetros clave en modelos fotovoltaicos (PV) y ajustar automáticamente los hiperparámetros de redes neuronales convolucionales para varios conjuntos de datos de imágenes.

De paneles solares a redes neuronales

En energía solar, los modelos precisos de celdas y módulos fotovoltaicos son esenciales para predecir la producción y optimizar la operación. El equipo aplica SOA a varios modelos PV estándar, incluidos modelos de diodo único, diodo doble y descripciones completas de módulos. Usando datos medidos de corriente–voltaje, SOA ajusta los parámetros del modelo para minimizar el error y demuestra lograr errores cuadráticos medios inferiores o comparables frente a una variedad de optimizadores establecidos. En experimentos de aprendizaje automático, SOA se emplea para afinar la arquitectura y los parámetros de entrenamiento de una red neuronal convolucional en MNIST y conjuntos de datos de imágenes relacionados. Aquí también, el algoritmo encuentra combinaciones de hiperparámetros que proporcionan precisiones de clasificación competitivas o superiores en comparación con otras estrategias de búsqueda automatizada.

Qué significa esto en la práctica

Para no especialistas, el mensaje principal es que SOA ofrece un nuevo “motor de búsqueda” práctico para problemas de optimización difíciles donde el paisaje es irregular y los gradientes no están disponibles. Al tomar la geometría del método de la secante y embeberla en una búsqueda basada en poblaciones con una aleatoriedad bien equilibrada, el algoritmo a menudo converge más rápido y con mayor precisión que muchas alternativas actuales. Debido a que es relativamente simple, no requiere derivadas y tiene pocos parámetros de ajuste, SOA puede integrarse en una variedad de aplicaciones —desde el diseño de sistemas solares más eficientes hasta la configuración de modelos de aprendizaje profundo— lo que lo convierte en una adición prometedora a la caja de herramientas de ingenieros y científicos de datos por igual.

Cita: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Palabras clave: optimización global, algoritmos metaheurísticos, algoritmo de optimización secante, modelado fotovoltaico, ajuste de hiperparámetros