Clear Sky Science · es

Detección en tiempo real de fuego y humo mediante transformers de visión y aprendizaje espaciotemporal

Por qué importan las alertas de incendio más rápidas

Los incendios en viviendas, fábricas y bosques pueden volverse mortales en cuestión de minutos. Hoy en día, muchas alarmas siguen dependiendo de sensores de calor o humo que solo reaccionan cuando las llamas ya están bien establecidas. Este artículo describe un nuevo sistema de visión por ordenador que puede detectar signos de fuego y humo en las imágenes de cámaras casi al instante, incluso en condiciones difíciles como poca luz o niebla densa. Al combinar varias técnicas avanzadas de inteligencia artificial en un único modelo, los investigadores pretenden ofrecer a bomberos, planificadores urbanos y agencias medioambientales una señal de aviso mucho más temprana —potencialmente salvando vidas, bienes y ecosistemas.

El desafío creciente de detectar llamas

Las ciudades y los bosques modernos están siendo monitorizados cada vez más por cámaras, pero enseñar a las máquinas a reconocer de forma fiable fuego y humo en esas imágenes y vídeos es complicado. Los enfoques tradicionales usan redes neuronales que funcionan bien en imágenes fijas o clips cortos, pero a menudo tienen dificultades en escenas reales y desordenadas. Una sola instantánea puede mostrar algo que parece humo pero que solo es niebla o escape. Los sistemas centrados en vídeo pueden rastrear cómo se mueven las formas en el tiempo, pero tienden a ser lentos y exigir mucho hardware. Como resultado, los modelos anteriores con frecuencia generan falsas alarmas o no detectan señales sutiles y rápidas de peligro—especialmente con iluminación deficiente, humo denso o fondos muy cargados.

Un «vigilante» híbrido de IA para imágenes y vídeo

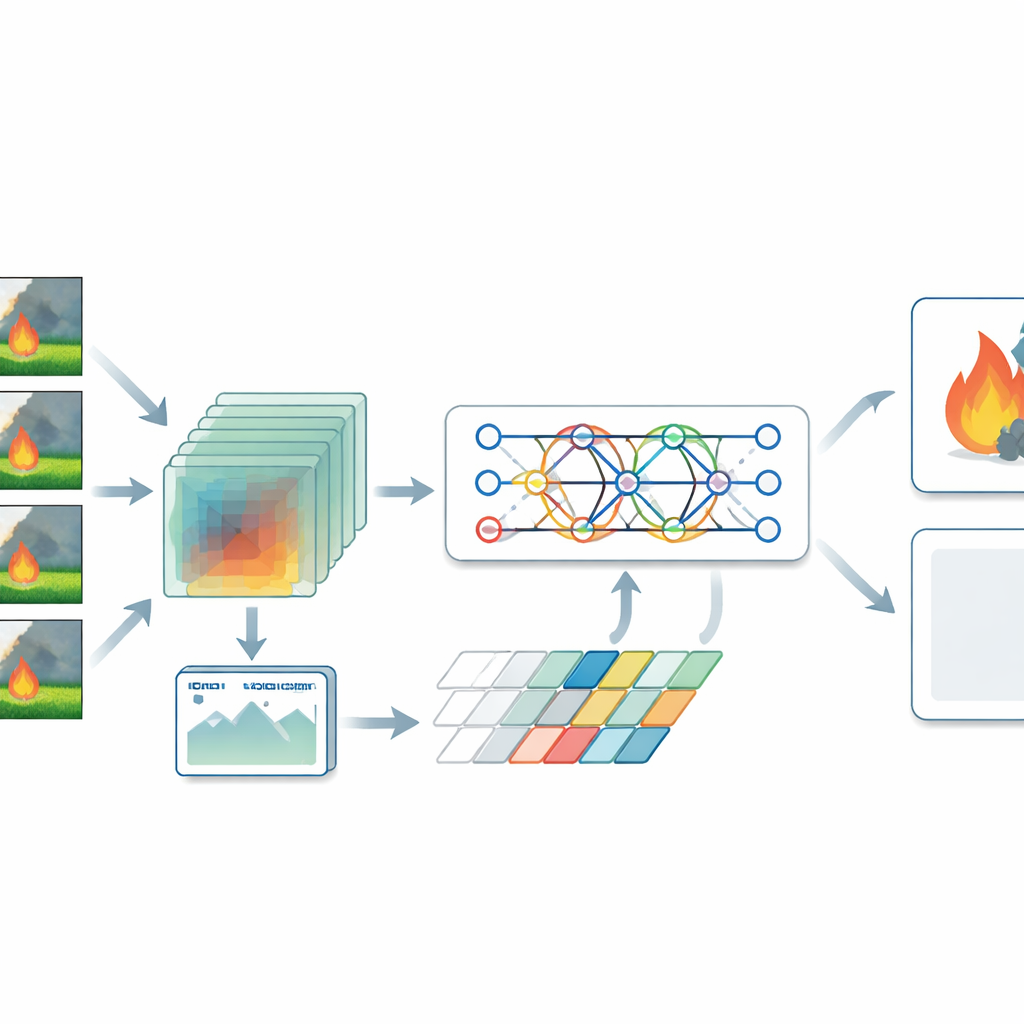

Los autores proponen un modelo híbrido que aborda la detección de incendios como un problema tanto espacial como temporal. Para imágenes fijas usan un tipo de red neuronal llamada transformer de visión, que trata la imagen como un mosaico de regiones y aprende cómo se relacionan áreas distantes entre sí. Esto le ayuda a notar patrones amplios, como jirones de humo que se extienden por un valle o llamas dispersas en un bosque. Para vídeo, el sistema se apoya en una red convolucional tridimensional que procesa pilas de fotogramas a la vez, captando cómo cambian el humo y el fuego con el tiempo. Un codificador transformer examina después esos patrones cambiantes y centra la atención en los momentos y regiones más propensas a indicar peligro, en lugar de dar el mismo peso a cada fotograma.

Mezclar pistas y equilibrar los datos

Un paso clave en el sistema es una capa de fusión que mezcla las pistas detalladas de las imágenes fijas con los patrones de movimiento del vídeo. Al combinar estas vistas complementarias, el modelo puede distinguir mejor los incendios reales de sus imitadores inofensivos, como el resplandor del atardecer, la niebla o las nubes. Los investigadores también observaron que muchos conjuntos de datos públicos contienen muchos más ejemplos de fuego que de no-fuego, lo que puede sesgar un modelo hacia sobrerreporte de llamas. Para contrarrestarlo, generaron una amplia variedad de escenas no incendiarias realistas mediante una cuidadosa aumentación de datos—cambiando brillo, recortando y volteando imágenes, y simulando situaciones como mañanas brumosas o interiores oscuros. Luego entrenaron el modelo con una función de pérdida que equilibra explícitamente los errores en casos de fuego y no-fuego, mejorando la fiabilidad en el uso cotidiano.

Poner el sistema a prueba

Para evaluar su enfoque, los autores lo probaron en dos conjuntos de datos de uso general: uno de casi mil imágenes fijas del NASA Space Apps Challenge y otro de vídeos relacionados con incendios en Kaggle. Tras el preprocesado y el equilibrio, entrenaron y evaluaron su modelo híbrido junto a referencias bien conocidas como ResNet, VGG, LSTM, redes convolucionales 3D puras y varias combinaciones híbridas de estos métodos anteriores. El nuevo sistema alcanzó aproximadamente un 99,2 % de precisión en las imágenes de la NASA y un 98,3 % en el conjunto de vídeos, superando claramente a los modelos tradicionales, que normalmente oscilaban entre mediados de los 80 y mediados de los 90. También funcionó lo suficientemente rápido—decenas de milisegundos por fotograma—y con un tamaño de modelo moderado, lo que lo hace apto para desplegarse en dispositivos edge como GPUs pequeñas y placas embebidas.

Qué significa esto para la seguridad cotidiana

En términos prácticos, esta investigación demuestra que una IA bien diseñada puede vigilar las imágenes de cámaras en tiempo real y responder de forma fiable a una pregunta simple pero vital: «¿Hay fuego o humo peligroso aquí ahora mismo?». Al combinar contextos visuales amplios, movimiento a lo largo del tiempo y atención selectiva a los detalles más significativos, el modelo híbrido reduce drásticamente tanto los incendios no detectados como las falsas alarmas. Con más ajustes y exposición a escenas más variadas—como ciudades densas, espacios subterráneos y condiciones meteorológicas extremas—podría convertirse en una columna vertebral práctica para sistemas de alarma más inteligentes, redes de monitoreo de incendios forestales y herramientas de seguridad industrial que reaccionen más rápido y con mayor precisión que muchas de las soluciones actuales.

Cita: Lilhore, U.K., Sharma, Y.K., Venkatachari, K. et al. Real time fire and smoke detection using vision transformers and spatiotemporal learning. Sci Rep 16, 8928 (2026). https://doi.org/10.1038/s41598-026-36687-9

Palabras clave: detección de incendios, detección de humo, visión por ordenador, modelos transformer, monitorización en tiempo real