Clear Sky Science · es

Un marco automatizado para la educación coránica de personas con sordera mediante clasificación de la postura corporal e integración de la lengua de señas árabe

Abrir un texto sagrado a voces silenciosas

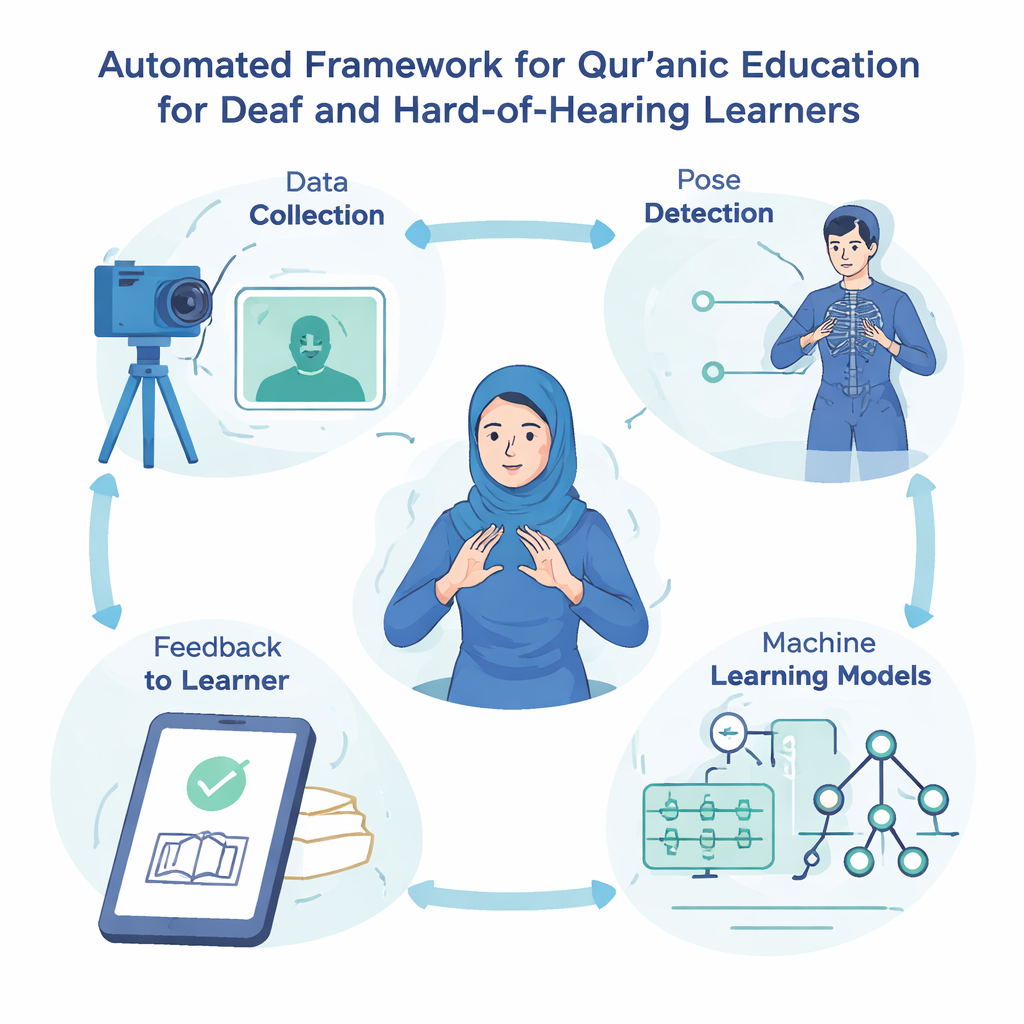

Para muchos musulmanes sordos y con pérdida auditiva, aprender a recitar el Corán puede ser extraordinariamente difícil, porque la enseñanza tradicional depende de escuchar y repetir. Este estudio presenta una ayuda pedagógica basada en tecnología que "ve" los gestos de la Lengua de Señas Árabe y los vincula con versículos de un capítulo breve del Corán. Al convertir los movimientos corporales en un puente entre la lengua de signos y las escrituras, pretende hacer el aprendizaje religioso más inclusivo para millones de personas que se comunican principalmente mediante la lengua de signos.

Por qué se excluye a los aprendices con discapacidad auditiva

Los musulmanes sordos a menudo dependen del gesto y la seña para comunicarse, sin embargo la mayor parte de la educación coránica se basa en el sonido: los profesores recitan en voz alta y los estudiantes imitan la melodía y la pronunciación. Las familias pueden no dominar la lengua de signos, y los intérpretes cualificados son escasos, especialmente para material religioso. Como resultado, muchos creyentes sordos tienen dificultades para acceder al mismo nivel de educación espiritual que sus pares oyentes. Los avances recientes en visión por computador e inteligencia artificial, que pueden reconocer movimientos de manos y cuerpo a partir de imágenes de cámara, ofrecen una vía para cambiar eso al convertir la lengua de signos en algo que una computadora pueda entender y responder en tiempo real.

Convertir gestos en unidades enseñables

Los investigadores se centraron en Sūrat al-Ikhlāṣ, un capítulo breve pero teológicamente denso que muchos musulmanes memorizan desde temprano. Trabajando con instituciones que atienden a usuarios sordos en Egipto, registraron 2.054 imágenes de gestos de la Lengua de Señas Árabe que corresponden a palabras coránicas individuales de este capítulo. Para evitar confusiones sobre el significado y la pronunciación, cada gesto fue etiquetado tanto en escritura árabe como en un sistema de transliteración estandarizado ampliamente usado en estudios islámicos académicos. Este etiquetado cuidadoso asegura que el sistema vincule cada seña con el término coránico correcto, manteniendo a la vez la flexibilidad necesaria para ampliarse a otros capítulos en el futuro.

Cómo aprende la computadora a ver posturas de oración

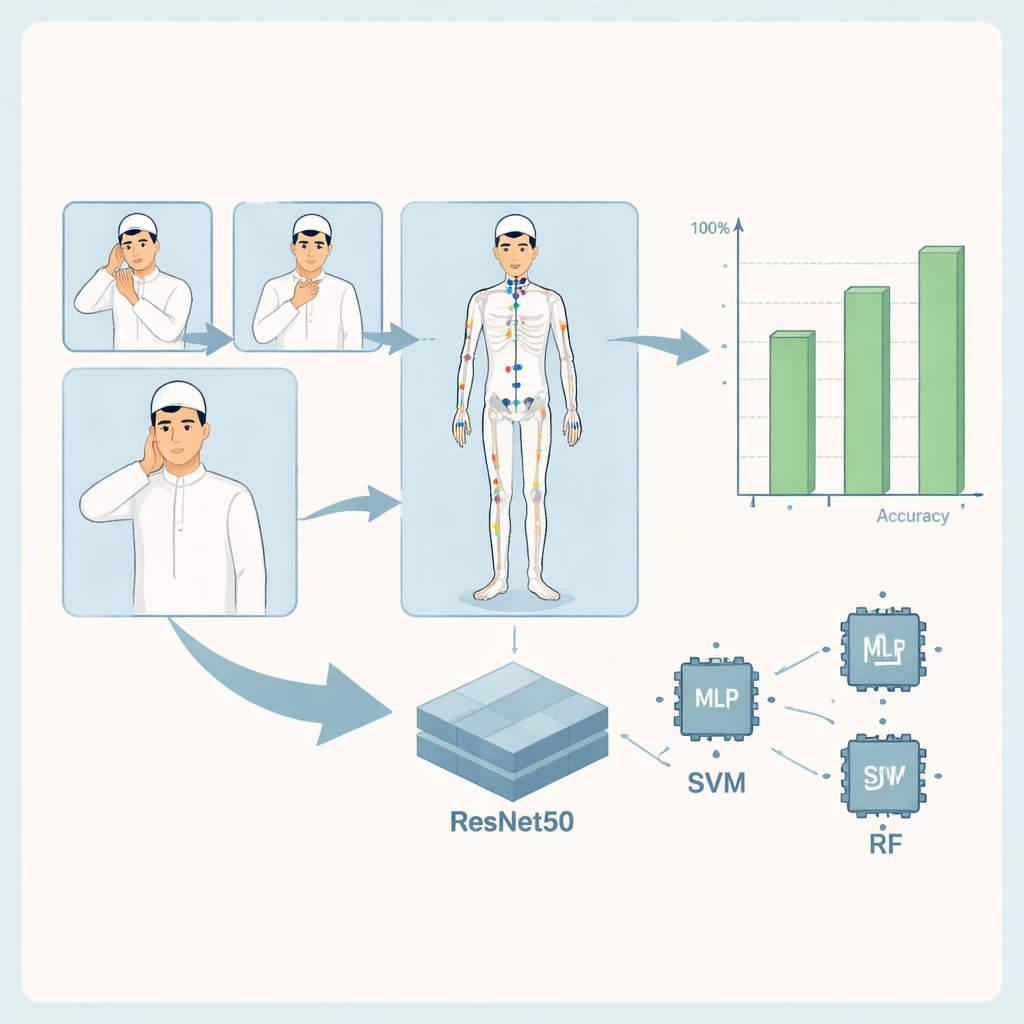

En el núcleo del sistema hay una canalización visual que primero detecta la postura corporal del intérprete de señas y luego clasifica qué palabra coránica se está señalando. Todas las imágenes se redimensionan y limpian a un formato estándar. Un conjunto de herramientas de software llamado MediaPipe identifica 33 puntos clave en el cuerpo —como hombros, codos y muñecas— y rastrea sus posiciones. Estas coordenadas conforman una descripción compacta de cada postura, que se introduce después en tres tipos de modelos de aprendizaje automático: un perceptrón multicapa personalizado (una red neuronal simple), una máquina de vectores de soporte y un bosque aleatorio compuesto por muchos pequeños árboles de decisión. En paralelo, un modelo de aprendizaje profundo más potente, ResNet50, analiza la imagen completa para aprender patrones visuales detallados asociados a cada palabra.

Reconocimiento notablemente preciso de las señas coránicas

Para probar el sistema, los autores dividieron su conjunto de datos en entrenamiento, validación y prueba, y evaluaron qué tan bien cada modelo reconocía los gestos. Todos los enfoques mostraron un rendimiento sólido, con los modelos basados en la postura identificando correctamente la mayoría de las señas entre 14 y 16 clases de palabras coránicas. El modelo de bosque aleatorio, por ejemplo, alcanzó puntuaciones casi perfectas para muchas palabras, con solo algunas confusiones entre gestos visualmente similares. El modelo combinado basado en ResNet50, que mira directamente las imágenes y también se beneficia de la información de la postura, alcanzó un rendimiento casi impecable en los datos de prueba: todas las señas se clasificaron correctamente y las medidas estándar de precisión, exactitud, recuperación y una puntuación de discriminación llamada ROC–AUC alcanzaron sus valores máximos. Estos resultados sugieren que incluso colecciones de imágenes relativamente pequeñas, cuando se preparan con cuidado, pueden respaldar un reconocimiento altamente preciso de la lengua de señas religiosa.

Promesa, límites y el camino por delante

Aunque las cifras de rendimiento son impresionantes, los autores subrayan que se aplican solo a las condiciones controladas de su estudio: un único capítulo, un número limitado de intérpretes y imágenes estáticas en lugar de señas continuas en movimiento. El uso en el mundo real requeriría conjuntos de datos más grandes y variados, mejor cobertura de los movimientos de la parte inferior del cuerpo y pruebas cuidadosas con intérpretes de diferentes regiones. No obstante, el trabajo demuestra que las herramientas modernas de visión y aprendizaje pueden reconocer de forma fiable las señas coránicas y ofrecer retroalimentación instantánea, por ejemplo mostrando una marca de verificación o una animación correctiva cuando un aprendiz realiza un gesto. En términos cotidianos, esto significa que un estudiante sordo podría practicar versos coránicos en señas delante de una cámara sencilla y recibir orientación sin necesidad de un intérprete en vivo —un paso importante hacia hacer el conocimiento sagrado más accesible para todos.

Cita: AbdElghfar, H., Youness, H.A., Wahba, M. et al. An automated framework for qur’anic education of the hearing-impaired using body pose classification and Arabic sign language integration. Sci Rep 16, 5939 (2026). https://doi.org/10.1038/s41598-026-36578-z

Palabras clave: Educación coránica, Lengua de señas árabe, aprendices con discapacidad auditiva, reconocimiento de la postura, tecnología de asistencia