Clear Sky Science · es

Procesamiento de datos de cristalografía serial de femtosegundos en el centro global de datos científicos de KISTI

Por qué los cristales diminutos necesitan grandes ordenadores

Los modernos láseres de rayos X pueden tomar “películas moleculares” de proteínas y otras moléculas disparando pulsos ultracortos y ultrabrillantes a innumerables cristales diminutos. Este enfoque, llamado cristalografía serial de femtosegundos, produce una avalancha de imágenes que revelan cómo se ven y se mueven las moléculas a temperatura ambiente. Pero hay un inconveniente: un solo experimento puede generar terabytes de datos, mucho más de lo que un ordenador de laboratorio típico puede manejar con rapidez. Este artículo explica cómo se construyó y puso a prueba el hub nacional de datos de Corea, GSDC en KISTI, para procesar estos enormes conjuntos de datos de forma eficiente, y qué lecciones prácticas pueden aplicar los científicos para pasar de imágenes sin procesar a estructuras 3D sin demoras prolongadas.

De los destellos del láser a las instantáneas de la estructura

En la cristalografía serial de femtosegundos, un láser de electrones libres de rayos X (XFEL) lanza pulsos rápidos a corrientes o matrices de cristales microscópicos. Cada cristal recibe un solo impacto, produciendo un único patrón de difracción “instantáneo” antes de ser destruido. Para reconstruir la estructura tridimensional completa de la molécula, los científicos deben combinar cientos de miles hasta millones de estas instantáneas. Muchas imágenes son inútiles: algunas no contienen señal, otras muestran varios cristales solapados. Las imágenes útiles (“hits”) deben detectarse, clasificarse y convertirse en datos de intensidad que se puedan fusionar en una estructura de alta calidad. Hacer esto en algo parecido al tiempo real exige computación de alto rendimiento, especialmente cuando el láser funciona a decenas de pulsos por segundo.

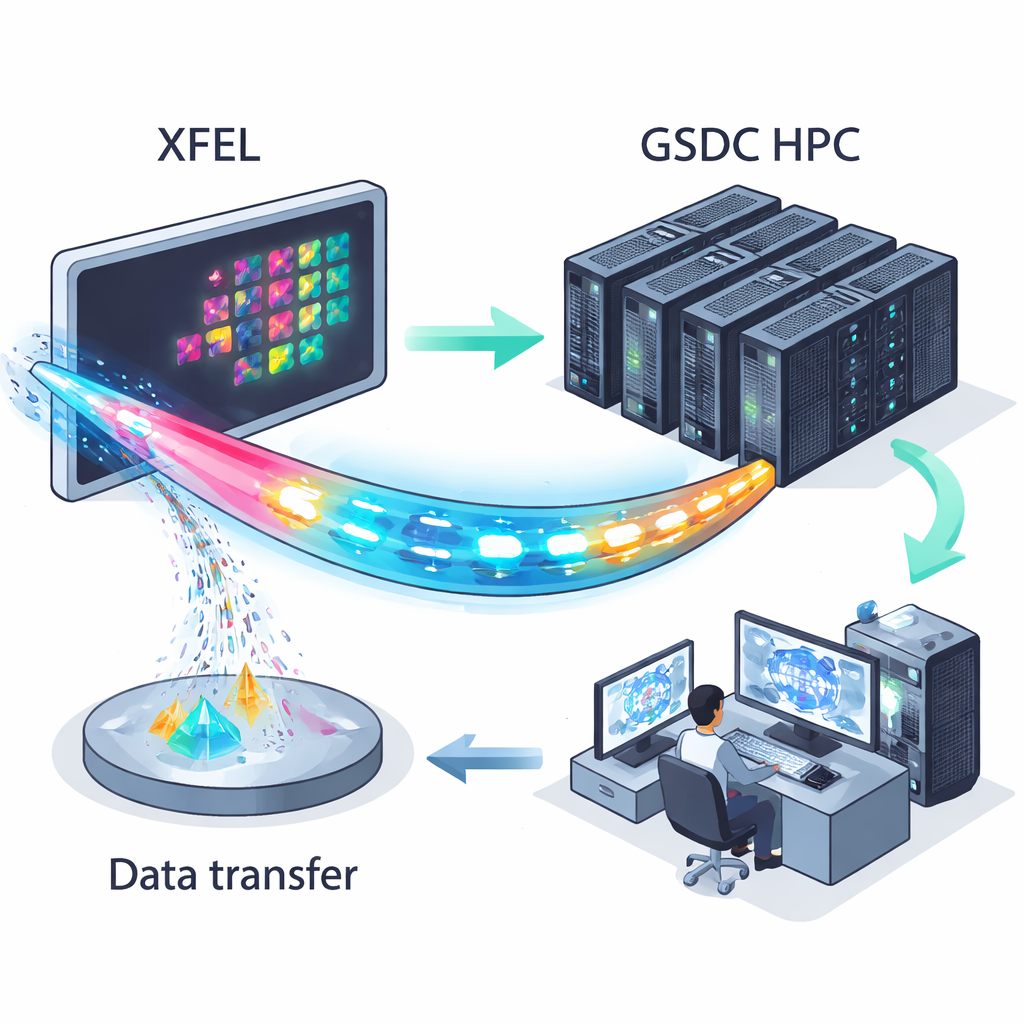

Un hub nacional de datos para experimentos con rayos X

El Global Science Data hub Center (GSDC) en KISTI se creó como una instalación a escala nacional para atender ciencias intensivas en datos, desde física de partículas hasta genómica. Para la cristalografía serial en el XFEL del Laboratorio de Aceleradores de Pohang (PAL‑XFEL), el GSDC opera tres servidores dedicados equipados con docenas de núcleos de CPU, cientos de gigabytes de memoria y un sistema de almacenamiento paralelo de alta velocidad. Durante los experimentos en la estación de nanocristalografía de PAL‑XFEL, las imágenes de difracción se recopilan en un detector rápido de rayos X y se transmiten al GSDC mediante un enlace de 10 gigabits por segundo. Un solo experimento de 12–24 horas puede generar desde varios hasta casi diez terabytes de datos. En el GSDC, los usuarios inician sesión de forma remota, filtran los fotogramas no útiles y ejecutan software especializado —como CrystFEL y sus programas de indexación asociados— para convertir las imágenes en bruto en datos estructurales refinados.

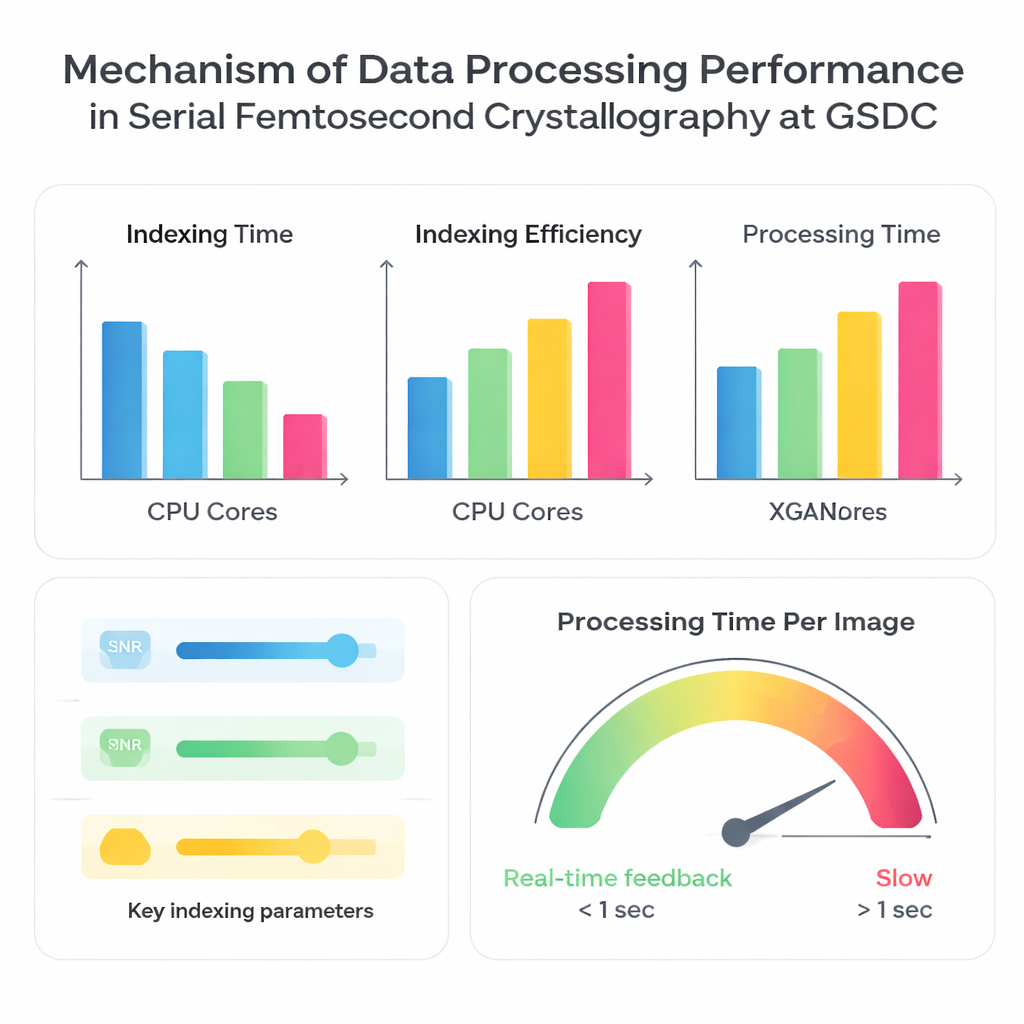

Cuántos procesadores ayudan, y cuándo

Los autores pusieron a prueba el sistema GSDC usando tres conjuntos de datos recolectados previamente de diferentes proteínas. Primero, analizaron cuánto mejora la velocidad de procesamiento cuando se usan más núcleos de CPU en paralelo. Como era de esperar, usar más procesadores redujo el tiempo total necesario para indexar imágenes, pero no de forma perfectamente proporcional. Pasar de 10 a alrededor de 30–40 núcleos de CPU proporcionó ganancias importantes, tras lo cual los beneficios se redujeron. Más allá de ese punto, núcleos adicionales añadían sobrecarga y se veían limitados por factores como el ancho de banda de memoria, la velocidad de entrada/salida al leer muchos archivos pequeños y la coordinación entre numerosas tareas paralelas. Esto deja claro que “más núcleos” no siempre es mejor; existe un punto óptimo donde el hardware se utiliza de forma eficiente sin crear cuellos de botella.

La compensación entre velocidad y completitud

Seguidamente, el equipo comparó cuatro algoritmos de indexación ampliamente usados —XDS, DirAx, MOSFLM y XGANDALF— en la misma plataforma de cálculo. Algunos métodos, como XDS y DirAx, fueron más rápidos en conjunto pero identificaron una fracción menor de imágenes que podían convertirse con éxito en patrones de difracción útiles. Otros, como MOSFLM y XGANDALF, fueron más lentos pero convirtieron más imágenes en datos utilizables y, por lo general, produjeron mejor calidad estadística en el conjunto de datos final fusionado. Los autores también exploraron cómo elecciones simples de entrada influyen tanto en la velocidad como en la tasa de éxito: elevar el umbral señal‑ruido o desactivar la indexación multi‑cristal hizo que el procesamiento fuera más rápido pero redujo cuántas imágenes podían utilizarse; bajar el umbral o habilitar el manejo multi‑cristal tuvo el efecto contrario. De manera crucial, incluso pequeños errores en la geometría del detector —como la distancia entre detector y muestra— provocaban fallos de indexación con más frecuencia y ralentizaban el procesamiento de forma drástica, porque el software intentaba repetidamente y rechazaba soluciones incorrectas.

Qué significa esto para experimentos futuros

Al medir de forma sistemática cómo las decisiones de hardware, los algoritmos de software y los ajustes controlados por el usuario afectan al rendimiento, este estudio convierte un desafío complejo de manejo de datos en un conjunto de directrices prácticas. Para los científicos que planifican experimentos en PAL‑XFEL, muestra cuándo el procesamiento paralelo es más eficaz, qué programas de indexación son mejores para obtener retroalimentación rápida frente a máxima calidad de datos, y por qué la calibración cuidadosa de la geometría del detector importa tanto. Los autores concluyen que GSDC ya permite un procesamiento eficiente y, en algunos casos, retroalimentación en tiempo real durante la recolección de datos, pero que será necesaria una mayor expansión de los recursos informáticos a medida que aumenten las tasas de repetición y el tamaño de los conjuntos de datos. Para los no expertos, el mensaje clave es que hacer “películas” de moléculas no es solo un triunfo de láseres y detectores avanzados: también depende de centros de cálculo bien diseñados que puedan seguir el ritmo de la avalancha de datos.

Cita: Nam, K.H., Na, SH. Serial femtosecond crystallography data processing at the global science data hub center at KISTI. Sci Rep 16, 6786 (2026). https://doi.org/10.1038/s41598-026-36540-z

Palabras clave: cristalografía serial de femtosegundos, láser de electrones libres de rayos X, computación de alto rendimiento, procesamiento de datos, estructura de proteínas