Clear Sky Science · es

Informes científicos: transformador gráfico de atención dual multirrelacional para análisis de sentimientos de grano fino

Por qué importan las pistas diminutas en las reseñas

Las reseñas en línea están llenas de sentimientos mixtos: un restaurante puede tener “comida excelente pero servicio lento”, o un teléfono puede presentar una “pantalla preciosa pero una batería terrible”. Empresas e investigadores quieren que los ordenadores comprendan este tipo de opinión detallada, no solo si una reseña entera es positiva o negativa. Este artículo presenta un nuevo modelo de inteligencia artificial que se concentra en partes específicas de una frase —como “servicio” o “duración de batería”— y determina exactamente cómo se siente la gente respecto a cada una, incluso cuando las pistas están dispersas y son sutiles.

Más allá del sentimiento único para todo

El análisis de sentimiento tradicional trata una frase o reseña como un único bloque de texto y decide si en general es positivo o negativo. Eso funciona para comentarios simples, pero fracasa cuando la gente elogia un aspecto y critica otro en la misma oración. El campo del Análisis de Sentimiento Basado en Aspectos aborda esto preguntando: ¿cuál es el sentimiento hacia cada objetivo específico, como “servicio”, “ambiente” o “personal” en una reseña de restaurante? Métodos anteriores se basaban en reglas hechas a mano o en aprendizaje automático simple que contaba palabras, y luego pasaron a redes neuronales que leen el texto en secuencia, como de izquierda a derecha. Estos modelos secuenciales mejoraron la precisión pero aún perdían vínculos a larga distancia y señales sutiles, especialmente cuando las palabras importantes están separadas o conectadas por términos de contraste como “pero” y “aunque”.

Convertir oraciones en mapas conectados

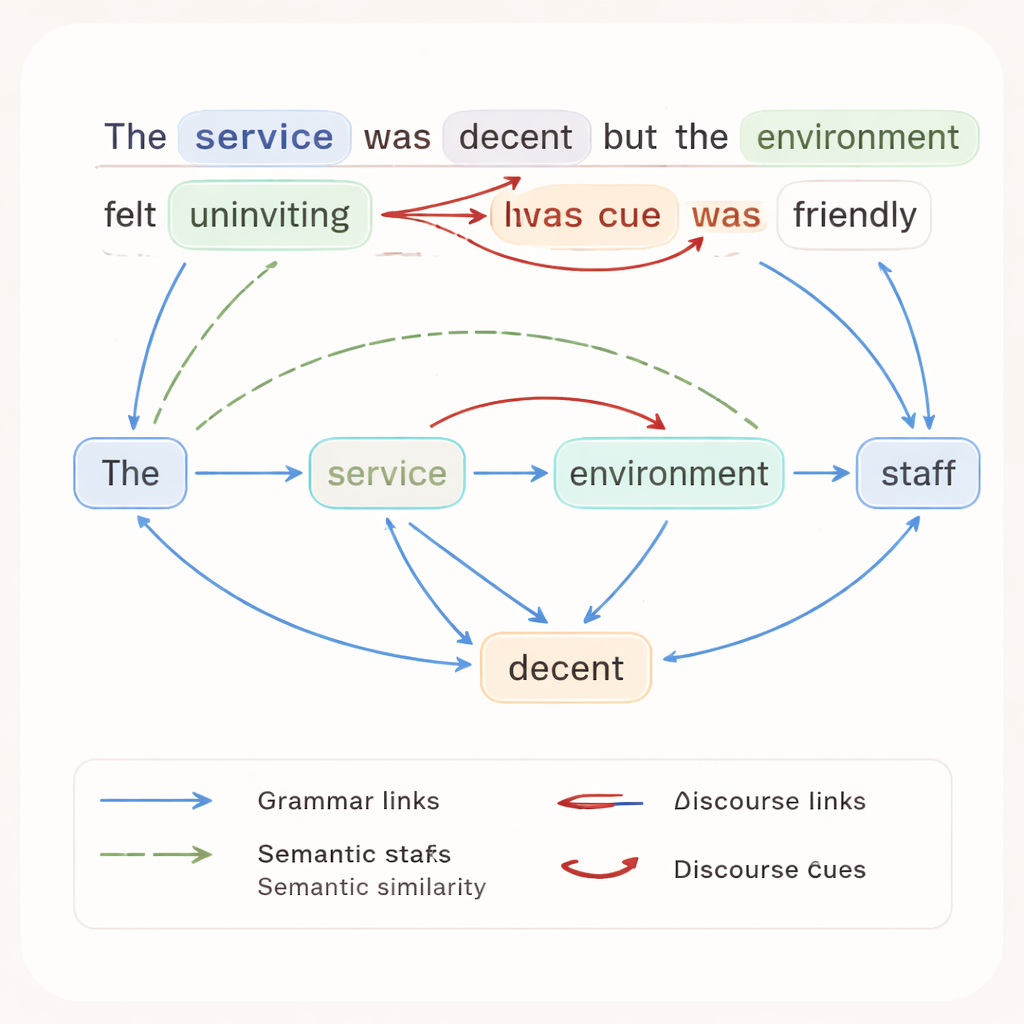

Los autores sostienen que para entender opiniones de grano fino, un ordenador debería ver una frase como una red en lugar de una línea recta. En su enfoque, cada palabra se convierte en un nodo de un grafo y distintos tipos de relaciones forman las aristas. Un conjunto de aristas captura la gramática, como qué palabra es sujeto u objeto. Otro conjunto enlaza palabras similares en significado, incluso si no están contiguas. Un tercer conjunto marca indicios discursivos —palabras como “pero”, “sin embargo” o “aunque” que a menudo señalan un cambio en el sentimiento. En una frase como “El servicio fue aceptable pero el ambiente resultó poco acogedor aunque el personal fue amable”, este grafo muestra cómo el elogio y la crítica se entrelazan alrededor de distintos aspectos.

Un doble foco sobre el contexto y los objetivos

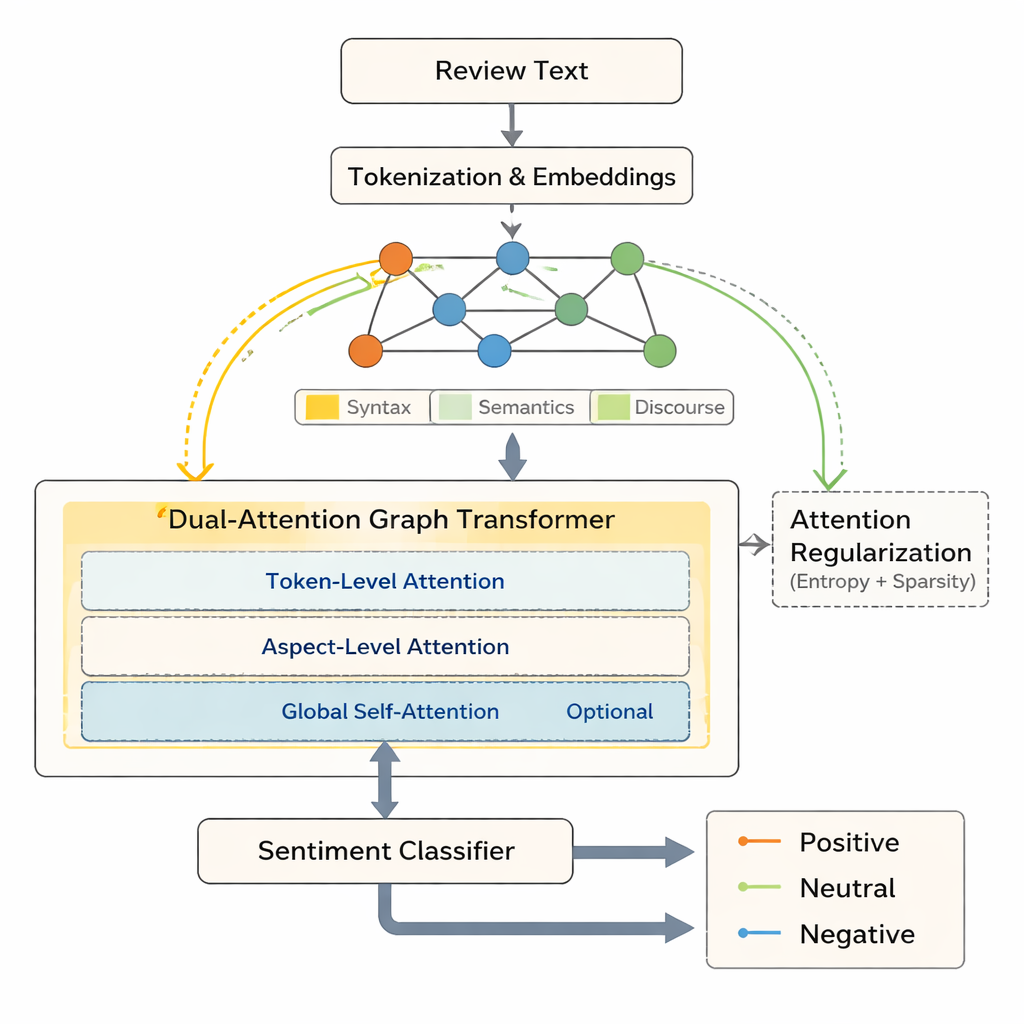

Partiendo de esta vista en grafo, el artículo presenta el Transformador Gráfico de Atención Dual Multirrelacional (MRDAGT). Este modelo utiliza un mecanismo de atención estilo Transformer adaptado a grafos. Una cabeza de atención observa de forma amplia cómo se relacionan todas las palabras de la frase entre sí, reuniendo contexto local útil. Una segunda cabeza de atención se centra específicamente en el aspecto en cuestión —por ejemplo, “servicio” o “ambiente”— y aumenta la influencia de las palabras que moldean la opinión sobre ese objetivo, como “aceptable” o “poco acogedor”. Cuando hay varios aspectos en una misma oración, una capa de atención global opcional ayuda al modelo a ponderar sus interacciones. En efecto, el sistema enciende dos focos coordinados: uno sobre la estructura general de la frase y otro directamente sobre el aspecto cuyo sentimiento intenta juzgar.

Hacer la atención de las máquinas más selectiva y explicable

Una preocupación clave con la IA moderna es que los pesos de atención —los números que indican en qué palabras se fijó el modelo— pueden dispersarse demasiado, dificultando la interpretación de las decisiones. MRDAGT aborda esto con dos fuerzas de regularización. Una penalización de entropía desalienta una atención excesivamente plana, empujando al modelo a concentrarse más nítidamente en unas pocas palabras importantes. Al mismo tiempo, un término de esparsidad L1 empuja muchos enlaces de atención hacia cero, recortando conexiones débiles y ruidosas. Juntas, estas fuerzas crean una “esparsidad focalizada”: el modelo tiende a colocar pesos claros y altos en pares palabra–aspecto realmente relevantes mientras ignora las distracciones. Experimentos en tres conjuntos de referencia —reseñas formales de portátiles, reseñas complejas de varias oraciones y publicaciones informales en Twitter— muestran que MRDAGT supera de forma consistente a sistemas fuertes existentes en aproximadamente uno o dos puntos porcentuales de precisión, además de producir mapas de atención más limpios y más interpretables.

Qué supone esto para la minería de opiniones en el mundo real

Para los no especialistas, la conclusión es que este modelo ofrece una forma más precisa y fiable de extraer opiniones de textos desordenados del mundo real. En lugar de limitarse a decir que una reseña es “mayormente positiva”, MRDAGT puede informar por separado que los clientes valoran la velocidad de un dispositivo pero no su batería, o que los comensales aprecian al personal de un café mientras se quejan del ruido. Debido a que sus patrones de atención coinciden con la intuición humana —centrándose en palabras de contraste, adjetivos sentimentales y términos de aspecto—, es más fácil para los analistas ver por qué el modelo emitió un juicio particular. Los autores sugieren que este enfoque puede apoyar mejores decisiones de diseño de productos, una monitorización más precisa de redes sociales y futuras extensiones a muchos idiomas e incluso a datos multimodales como audio e imágenes, todo ello manteniendo el proceso de razonamiento relativamente transparente.

Cita: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Palabras clave: análisis de sentimiento basado en aspectos, redes neuronales de grafos, atención de transformador, minería de opiniones, procesamiento del lenguaje natural