Clear Sky Science · es

Una red colaborativa de atención múltiple para la detección en tiempo real de objetos pequeños en imágenes UAV

Por qué importa detectar detalles diminutos desde el cielo

Con los drones cada vez más empleados para monitorizar el tráfico, responder a desastres y tareas de seguridad, deben ser capaces de detectar con fiabilidad objetos muy pequeños —como coches, bicicletas o personas— vistos desde gran altura. En estas vistas aéreas, los objetivos tienen solo unos pocos píxeles de ancho y se pierden con facilidad entre sombras, reflejos y fondos complejos. Este artículo presenta un nuevo sistema de visión por computador, llamado Red Colaborativa de Atención Múltiple (CMA-Net), diseñado para detectar objetos pequeños en imágenes de drones de forma rápida y precisa, lo bastante para su uso en tiempo real.

Retos de ver cosas pequeñas desde lo alto

Detectar objetos pequeños en imágenes de drones es más difícil que en fotos habituales de calle. Debido a que los drones vuelan alto y captan escenas desde muchos ángulos, vehículos y personas aparecen diminutos y borrosos, y la iluminación puede cambiar rápidamente. Los detectores tradicionales de dos etapas pueden ser muy precisos pero suelen ser demasiado lentos para uso en tiempo real en plataformas voladoras con capacidad de cómputo y ancho de banda limitados. Los métodos rápidos de una sola etapa funcionan en tiempo real, pero tienden a pasar por alto objetivos pequeños porque sus detalles se van diluyendo a medida que la imagen se procesa capa tras capa. Los autores sostienen que una mejor detección de objetos pequeños requiere formas más inteligentes de combinar información entre escalas y de centrar la atención computacional en las zonas más informativas de la imagen.

Construyendo una escalera de características más inteligente

CMA-Net parte de una columna vertebral de procesamiento de imágenes muy usada, ResNet-50, y añade una Red de Pirámide de Características Bidireccional Eficiente (E-BiFPN). Esta estructura crea una especie de escalera de mapas de características a diferentes tamaños, permitiendo al sistema mezclar detalles finos de las capas iniciales con contexto más abstracto de capas profundas. A diferencia de diseños previos, E-BiFPN recorta capas de alto nivel innecesarias y añade un bloque de procesamiento ligero especial que usa convoluciones parciales para reducir el cómputo. Un esquema de fusión ponderada aprende cuánto confiar en las características superficiales frente a las profundas en cada escala, de modo que la información frágil sobre coches diminutos o peatones se refuerza mientras se reduce el ruido del fondo.

Enseñar a la red dónde mirar

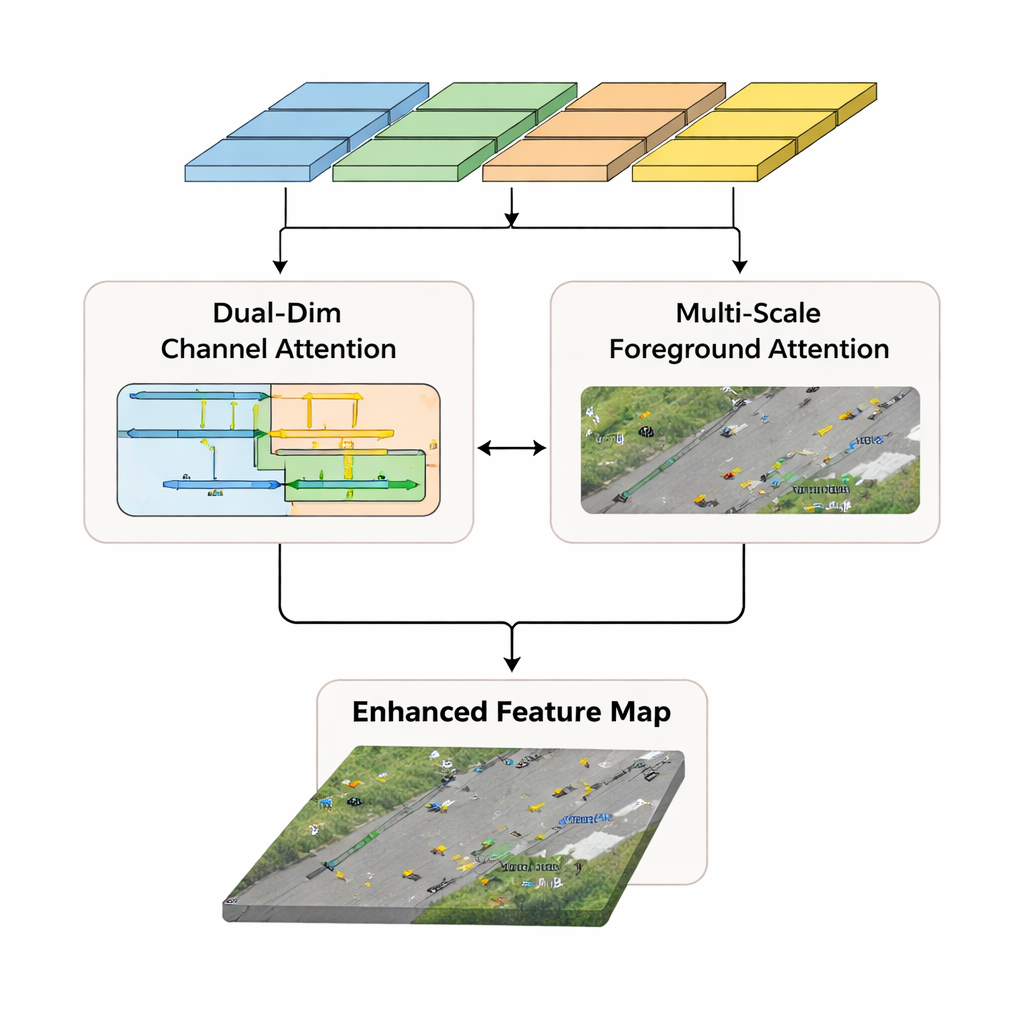

Más allá de reorganizar las características, CMA-Net usa mecanismos de atención que imitan cómo los humanos se concentran en las partes relevantes de una escena. Un módulo de Atención de Canal Doble-Dimensional (DDCA) analiza las características por separado a lo largo del ancho y la altura de la imagen, en lugar de comprimir todo en un único resumen global. Este diseño ayuda a la red a capturar patrones de largo alcance en direcciones tanto horizontales como verticales, preservando señales de localización que son cruciales cuando los objetos pequeños se mezclan con entornos complejos. En paralelo, un módulo de Atención de Primer Plano Multiescala (MSFA) vincula objetos grandes y fácilmente reconocibles en capas profundas con objetos más pequeños en capas superficiales. Muestreando y fusionando información de tres escalas, MSFA aprende a resaltar regiones de primer plano donde es probable que haya vehículos y a suprimir texturas de fondo confusas.

De características mejoradas a decisiones rápidas

Las salidas de las ramas DDCA y MSFA se combinan en mapas de características ricos y adaptados a objetos pequeños que se envían a una cabeza de detección «sin anclas». En lugar de depender de una cuadrícula densa de cajas predefinidas, esta cabeza predice directamente la categoría y la posición de los objetos, simplificando los cálculos y haciendo el entrenamiento más flexible. Los autores evaluaron CMA-Net en dos conjuntos de datos públicos exigentes para drones, UAVDT y Stanford Drone, que incluyen carreteras concurridas, condiciones meteorológicas variadas y escenas diurnas y nocturnas. CMA-Net alcanzó puntuaciones de precisión del 67,2 % y 62,0 % en estos conjuntos, funcionando a 64 fotogramas por segundo, lo que significa que puede procesar vídeo en tiempo real superando a muchos detectores populares, incluidos algunos de la familia YOLO y modelos más complejos basados en transformadores.

Qué significa esto para el uso real de drones

Para quienes no son especialistas, la idea principal es que CMA-Net mejora de forma notable la capacidad de un drone para detectar objetos pequeños y difíciles de ver sin reducir su velocidad de procesamiento. Al fusionar cuidadosamente información a múltiples escalas y guiar la atención de la red tanto a través de los canales de la imagen como entre primer plano y fondo, el método evita que vehículos y personas diminutos pasen desapercibidos. Esta combinación de precisión y rapidez hace que el enfoque sea prometedor para aplicaciones prácticas como la monitorización inteligente del tráfico, la observación de multitudes y la respuesta a emergencias, donde pasar por alto un objeto pequeño o reaccionar con lentitud puede tener consecuencias graves.

Cita: Yang, J., Yue, X. & Wu, L. A collaborative multi-attention network for real-time small object detection in UAV imagery. Sci Rep 16, 5852 (2026). https://doi.org/10.1038/s41598-026-36440-2

Palabras clave: visión con drones, detección de objetos pequeños, vigilancia en tiempo real, redes de atención, monitorización del tráfico