Clear Sky Science · es

Desacoplamiento de contenido y estilo para generación de imágenes con múltiples estilos usando arquitectura de difusión latente

Por qué importan estilos de imagen más inteligentes

Desde carteles de cine y arte para videojuegos hasta filtros en redes sociales, cada vez esperamos que las imágenes sean visualmente impactantes y altamente personalizadas. Pero en la práctica, muchos sistemas de transferencia de estilo siguen teniendo dificultades: pueden deformar el rostro de una persona, torcer edificios o requerir hardware potente. Este artículo presenta un nuevo modelo de IA que promete estilos artísticos más ricos manteniendo la imagen original intacta y funcionando con eficiencia suficiente para dispositivos de uso cotidiano.

Separar “qué es” de “cómo se ve”

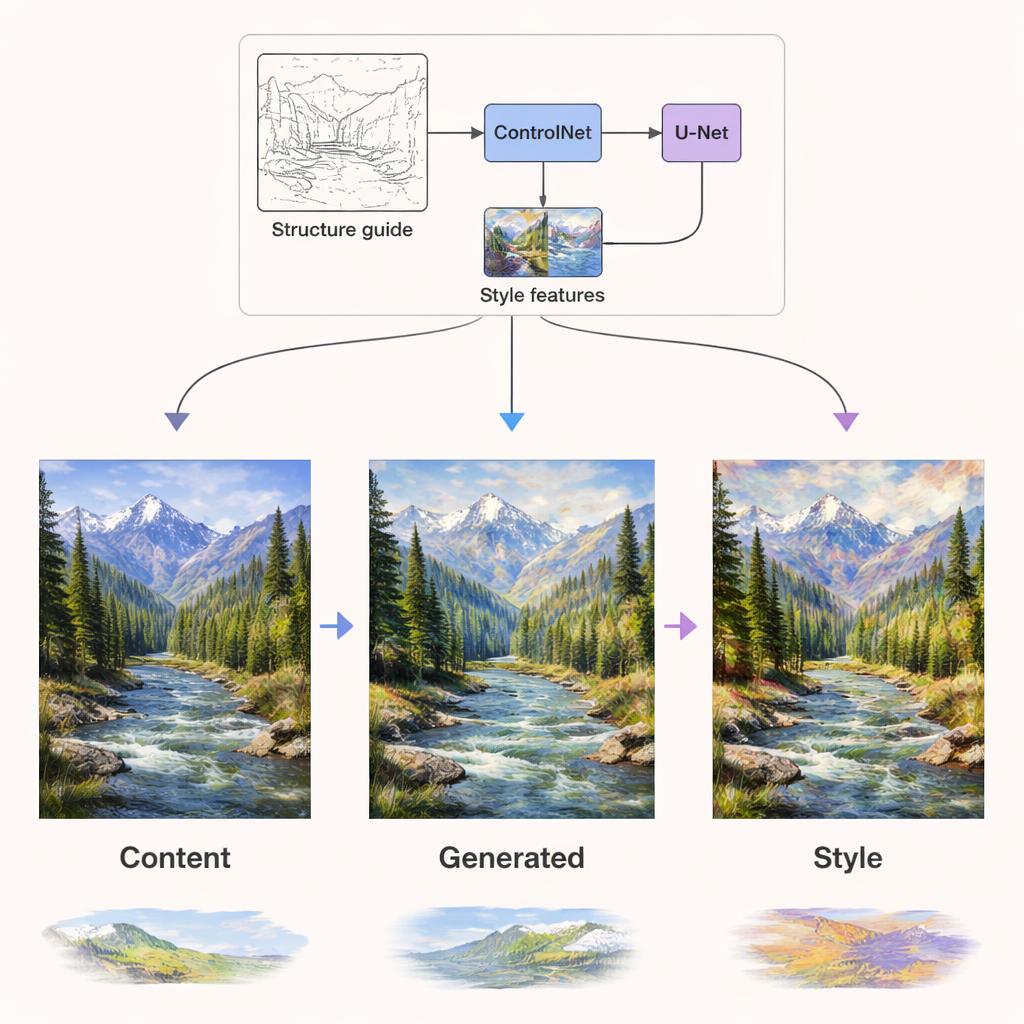

En el núcleo de este trabajo hay un modelo llamado Dual-Condition Lightweight Style Diffusion Model (DCLSDM). Su idea clave es tratar la sustancia de una imagen —los objetos, la disposición y la escena— como un “canal”, y el tratamiento artístico —colores, texturas, pinceladas— como otro, y controlarlos por separado. En lugar de permitir que una sola red mezcle ambos aspectos, DCLSDM emplea dos vías dedicadas: una para el contenido y otra para el estilo. La vía de contenido se centra en comprender las formas y los significados en una imagen de entrada o en una descripción textual, mientras que la vía de estilo se enfoca en aprender el carácter visual de una obra elegida o de una descripción de estilo.

Cómo se construye el nuevo modelo

DCLSDM se basa en modelos de difusión, la misma familia de técnicas detrás de muchos generadores de imágenes modernos. En lugar de trabajar directamente sobre imágenes de resolución completa, opera en un espacio “latente” comprimido, que resulta mucho más eficiente. Un módulo llamado Perceiver IO extrae el contenido: recibe una imagen o un pie de foto y destila la geometría y la semántica de la escena en una representación compacta. Un módulo de estilo separado lee una o más imágenes o textos de estilo y las convierte en vectores de características de estilo. Estas características de estilo pueden mezclarse mediante un esquema de interpolación ponderada, permitiendo transiciones suaves entre, por ejemplo, un aspecto impresionista y uno minimalista sin el habitual promedio “embarrado”.

Mantener la estructura al cambiar el estilo

Dentro de la red de difusión que realmente genera la imagen, los dos tipos de información se inyectan por rutas independientes. Las señales de contenido guían las capas de la red que se ocupan de la estructura —dónde deben estar los bordes, los objetos y la disposición—. Las señales de estilo se introducen mediante capas de atención dedicadas que configuran principalmente texturas, colores y la pincelada. Además, un componente llamado ControlNet añade guía estructural adicional usando mapas de bordes o de profundidad extraídos del contenido original. Esta combinación permite repintar un paisaje veraniego con una paleta invernal, o representar una fotografía como una pintura al estilo de Van Gogh, manteniendo montañas, árboles y edificios en su lugar correcto y sin distorsiones.

Mejor calidad, más estilos, menos cómputo

Los autores prueban rigurosamente DCLSDM en dos conjuntos de datos públicos: WikiArt, que abarca decenas de movimientos artísticos, y Summer2Winter Yosemite, que se centra en cambios estacionales de un paisaje. Comparan su modelo frente a una gama de sistemas de vanguardia usados en investigación e industria. En medidas de similitud estructural, calidad visual percibida y la cercanía de las imágenes generadas a obras reales, DCLSDM obtiene consistentemente las puntuaciones más altas. También funciona más rápido, consume menos memoria y tiene menos parámetros que muchos competidores, y aun así ofrece mezcla flexible de múltiples estilos y soporte tanto para entradas de estilo basadas en imagen como en texto.

Qué significa esto para la creatividad cotidiana

En términos prácticos, este trabajo demuestra que es posible dar a los usuarios control fino sobre cómo se ve una imagen sin sacrificar lo que la imagen muestra —y hacerlo en hardware más modesto. Los diseñadores podrían explorar rápidamente muchos tratamientos artísticos de una misma composición, las aplicaciones móviles podrían ofrecer filtros más ricos que no deformen rostros ni escenas, y proyectos de patrimonio cultural podrían restilar fotos antiguas preservando detalles estructurales cruciales. Al separar claramente contenido y estilo dentro de un marco de difusión moderno, DCLSDM señala hacia un futuro en el que las herramientas creativas de imagen son tanto más potentes como más fiables para el uso diario.

Cita: Chu, K., Shang, Y., Zhang, L. et al. Content style decoupling for multi style image generation using latent diffusion architecture. Sci Rep 16, 6642 (2026). https://doi.org/10.1038/s41598-026-36407-3

Palabras clave: transferencia de estilo de imagen, modelos de difusión, desacoplamiento contenido-estilo, generación de arte digital, generación de imágenes eficiente