Clear Sky Science · es

Fusión por compuertas cooperativas recíprocas de SqueezeNet y ShuffleNetV2 para la detección de cáncer de mama en imágenes histopatológicas

Ayuda más inteligente para el diagnóstico del cáncer de mama

Cuando se detecta un bulto en la mama, los médicos suelen basarse en finas rebanadas de tejido, teñidas y examinadas al microscopio, para decidir si las células son inocuas o cancerosas. Esta inspección minuciosa es el estándar de oro para el diagnóstico, pero es lenta, laboriosa y puede variar entre especialistas. El estudio descrito aquí presenta una herramienta informática que analiza estas imágenes microscópicas mediante inteligencia artificial, con el objetivo de apoyar a los patólogos con segundas opiniones rápidas, coherentes y de alta precisión, manteniendo al mismo tiempo el coste computacional lo bastante bajo para su uso cotidiano en hospitales.

El reto de leer las imágenes de tejido

El cáncer de mama es uno de los cánceres más comunes en el mundo y causa cientos de miles de muertes cada año. La clave para mejores resultados es detectar y caracterizar los tumores de forma temprana, lo que sigue dependiendo en gran medida de la histopatología: examinar cortes de tejido coloreados al microscopio. Sin embargo, muchos patrones tisulares se parecen de forma confusa. Las muestras normales y benignas (no peligrosas) pueden compartir estructuras similares, mientras que los cánceres en estadios iniciales y los invasivos pueden fundirse entre sí. Además, las diferencias en colorantes, iluminación y contraste de imagen de un laboratorio a otro pueden hacer que la misma enfermedad parezca muy distinta. Los programas tradicionales tienen dificultades con estas sutilezas, y muchos sistemas modernos de aprendizaje profundo que funcionan mejor son tan grandes y consumidores de energía que resultan difíciles de desplegar fuera de los principales centros de investigación.

Dos redes compactas trabajando en equipo

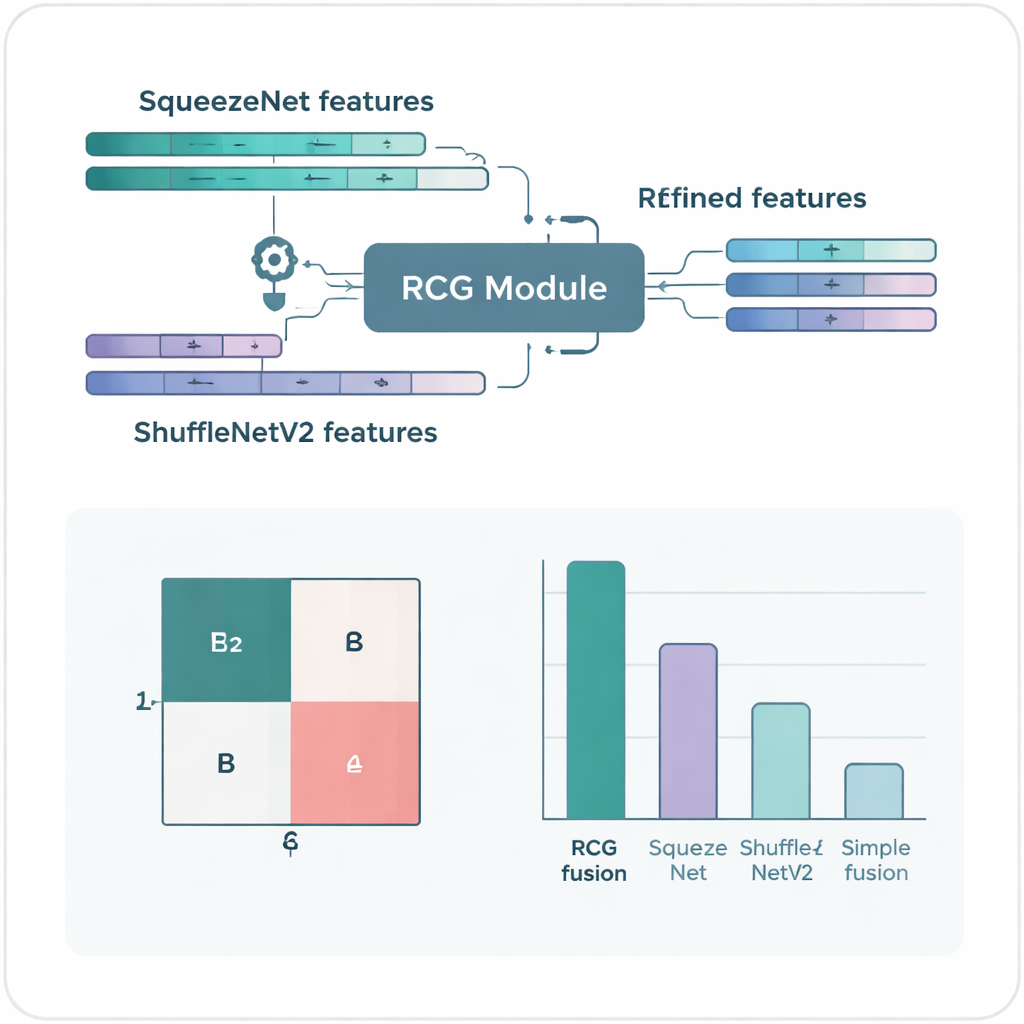

Para abordar este problema, los autores combinan dos redes neuronales compactas existentes, conocidas como SqueezeNet y ShuffleNetV2. Estos modelos fueron diseñados originalmente para reconocer objetos cotidianos en fotografías utilizando muchas menos operaciones que sistemas pesados como los transformers o redes muy profundas. En este trabajo, se vuelven a entrenar para reconocer patrones en imágenes de tejido mamario. Cada red analiza la misma imagen microscópica y aprende a destacar diferentes pistas visuales: variaciones sutiles en la forma de las células, texturas del tejido y disposiciones de color. Por separado, cada modelo rinde bien, pero la verdadera innovación es cómo se fusionan sus puntos fuertes.

Un mecanismo de compuertas que filtra el ruido

La idea central del estudio es un nuevo módulo de “compuertas cooperativas recíprocas” que permite que las dos redes se comuniquen y decidan qué partes de sus señales internas son realmente útiles. En lugar de limitarse a apilar o promediar sus salidas, el sistema de compuertas mide cuánta información aporta cada canal y cuánto es redundante con lo que la red compañera ya ha captado. Los canales que añaden detalles nuevos y útiles se amplifican, mientras que los que repiten información o introducen ruido se atenúan. Este ajuste recíproco ocurre en ambas direcciones, de modo que SqueezeNet afina las características de ShuffleNetV2 y viceversa. El resultado es una representación única y fusionada de cada imagen que es más rica, más limpia y más centrada en las pequeñas diferencias que separan un diagnóstico de otro.

Alta precisión con cálculo ligero

Al evaluarse en dos colecciones de imágenes de cáncer de mama ampliamente utilizadas, ICIAR‑2018 y BreakHis, el sistema fusionado muestra un rendimiento impresionante. En la tarea de cuatro clases —distinguir tejido normal, cambios benignos, cáncer in situ en estadios iniciales y cáncer invasivo— clasifica correctamente el 97 por ciento de las imágenes. Cuando la tarea se simplifica a separar tejido canceroso de no canceroso, la precisión sube al 99 por ciento en ICIAR‑2018 y alrededor del 99,7 por ciento en BreakHis. Estas cifras son superiores a las de muchos métodos más complejos reportados en la literatura, a pesar de que el nuevo modelo emplea relativamente pocos parámetros y requiere una potencia de cálculo modesta, lo que se traduce en predicciones más rápidas y menores requisitos de hardware.

Qué significa esto para pacientes y clínicas

En términos sencillos, los autores han construido un asistente ágil pero potente que puede revisar imágenes microscópicas de tejido mamario y clasificarlas con una fiabilidad cercana a la de un experto. Gracias a su diseño eficiente, es más adecuado para entornos del mundo real, como hospitales regionales o centros de cribado que pueden no contar con servidores de alta gama. Aunque el sistema no sustituye a los patólogos, puede señalar regiones sospechosas, aportar segundas opiniones consistentes y, potencialmente, acelerar el diagnóstico. El trabajo también apunta a una tendencia más amplia: combinando inteligentemente modelos de IA más pequeños y enseñándoles a cooperar en lugar de competir, es posible alcanzar una precisión de primer nivel sin el elevado coste y la complejidad que a menudo dificultan la adopción práctica de la IA médica.

Cita: Khati, B., Mukherjee, S., Sinitca, A. et al. Reciprocal cooperative gating fusion of SqueezeNet and ShuffleNetV2 for breast cancer detection in histopathology images. Sci Rep 16, 5904 (2026). https://doi.org/10.1038/s41598-026-36375-8

Palabras clave: cáncer de mama, histopatología, IA en imagen médica, CNN ligera, diagnóstico asistido por ordenador